記事一覧

心身のバランスを整える - ファスティングとマインドフルネス

パソコンやスマホばかり使っている毎日なので、できるだけカラダを動かしたり瞑想したり、ココロとカラダのバランスには気をつけている。最近はChatGPTに相談しながら週に一度のファスティング(断食)も試しているのでご紹介。

しばらくは空腹感が気になるものの、水分補給をしっかりして、瞑想したり音楽きいたりリラックスすることも大事らしい。終わったあとはカラダが軽くなったような気もするし、体重や体脂肪率も少

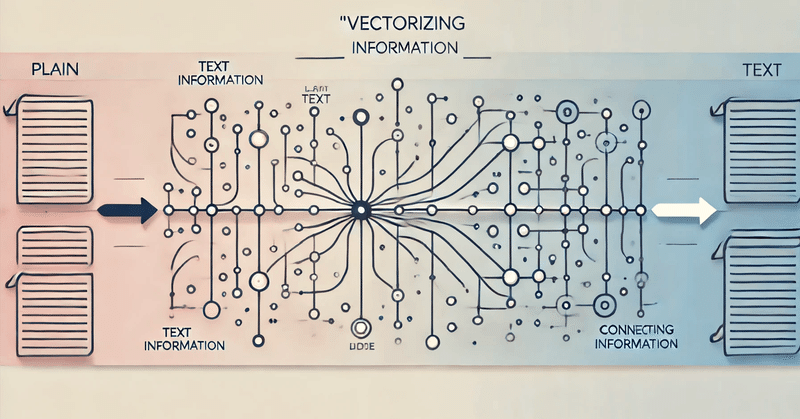

自然言語処理(NLP)- 文字情報をベクトル化するBoW、TF-IDF、Word2Vec、BERT

自然言語処理(NLP)について勉強中。新しいことを学ぶにはChatGPTはとても優秀な先生だ。ときどき間違ったことも言うけど、そこはまだ人間が考える余地があることを、ありがたく思うべきなんだと思う。

NLPでは文字や文章を扱うものの、要するに、文字情報をベクトル化して数値に変換してしまえば、あとは通常のテーブルデータと同じように学習と予測をすればいい、ということらしい。BERTのような高度なモデ

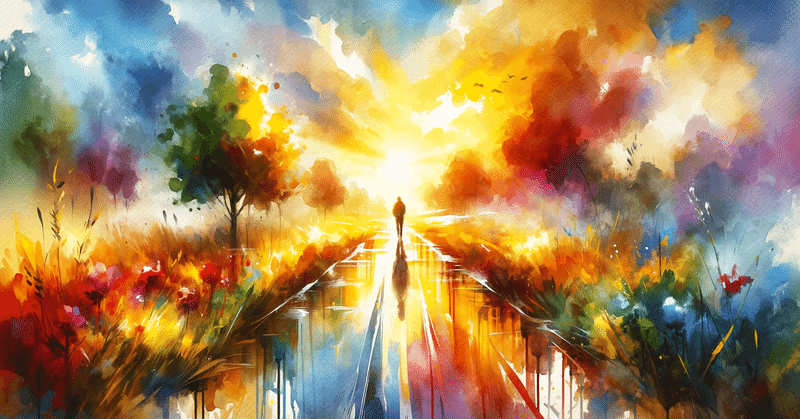

形而上絵画が心地いい - ジョルジョ・デ・キリコと機械学習

東京都美術館の「デ・キリコ展」を観た。 独特な「形而上学的な絵画」を目の当たりにすると不思議と心地いい。機械学習やプログラミングといった論理的思考とは異なる感覚が刺激される体験だったが、どこかで共通点があるようにも感じる。このもやもやした感覚についてChatGPTに訊いてみた。

デ・キリコの絵画と機械学習デ・キリコの形而上学的アートは、日常の風景を超えた、夢のような、時に不安を感じさせる空間を描

機械学習モデルのパラメータ最適化 - Optunaのアルゴリズム

いままでなんとなく使っていたOptunaのパラメータ最適化。グリッドサーチのような総当たりアプローチではなく、効率的なアルゴリズムで計算コストを抑えているとのこと。最適化の効果を最大限にするために、Optunaの仕組みやサンプラー、プルーナーの使い分けを理解しよう。

グリッドサーチとOptunaの違いグリッドサーチは、ハイパーパラメータの候補値をあらかじめ設定し、そのすべての組み合わせを試して最

Voting Regressor - 複数モデルを組み合わせて予測精度を向上するアンサンブル学習

いまさらながらVoting Regressorのアンサンブル学習をChatGPTに教えてもらった。Kaggleで公開されている高スコアのコードの多くがアンサンブル学習を利用している。いままで主にLightGBMを使っていたが、様々なモデルの特性も理解して、課題に応じた組み合わせが必要なんだろう。

アンサンブル学習の基本アンサンブル学習は、複数のモデルを組み合わせることで、それぞれのモデルの予測の

KaggleでExpertに昇格したのでどれくらい価値があるのか(ないのか)訊いてみた

Kaggleのコンペで銅メダルを2つ獲得し、Competition Expertに昇格した。挑戦して1年目の成果としては悪くないが、上位入賞者との差はまだまだ大きい。我ながらがんばったな、と思う反面、スキルの市場価値という観点ではやっとスタートライン立った程度なんだろう。

ChatGPTからのアドバイスは下記のとおり。実務への応用を考えると称号よりもコミュニティへの貢献のほうが大事なのかもしれな

We Are The World - エゴを捨てて世界を変える

「We Are The World」をテーマにしたNetflixのドキュメンタリー「ポップスが最高に輝いた夜」を観た。

たった一晩で収録された奇跡のような楽曲。強烈な個性を持つアーティスト達に向けてレコーディングスタジオの入口には「エゴはここで捨てろ」と書かれていたらしい。

自分のエゴを捨てれば世界を変えることができる、ということなのかも。

ChatGPTに現代の課題への応用を訊いてみた。

W

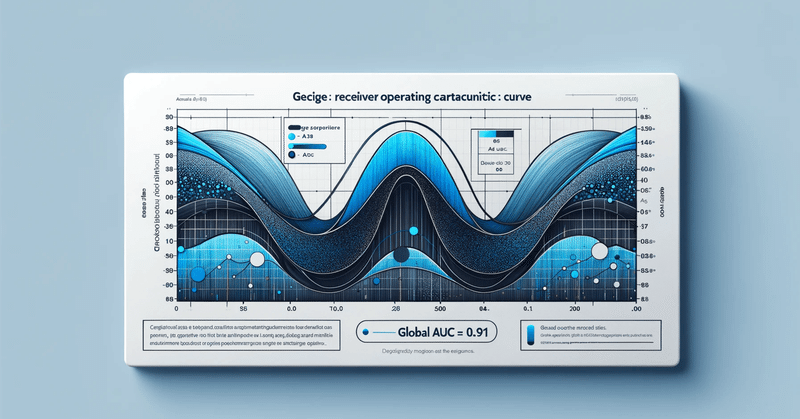

マルチラベル分類問題 - 性能評価指標 AUC(Area Under the Curve)の適用

Kaggle初心者向けPlayground Seriesで、今回のテーマはマルチラベル分類。AUCの考え方がよくわからなくてChatGPTに教えてもらったのでメモ。

AUC(Area Under the Curve)マルチラベル分類では、一つのインスタンスが複数のクラスに属することがあります。この問題に対して、モデルの性能を評価する際には、通常の方法とは異なるアプローチが必要です。

ダミーデー

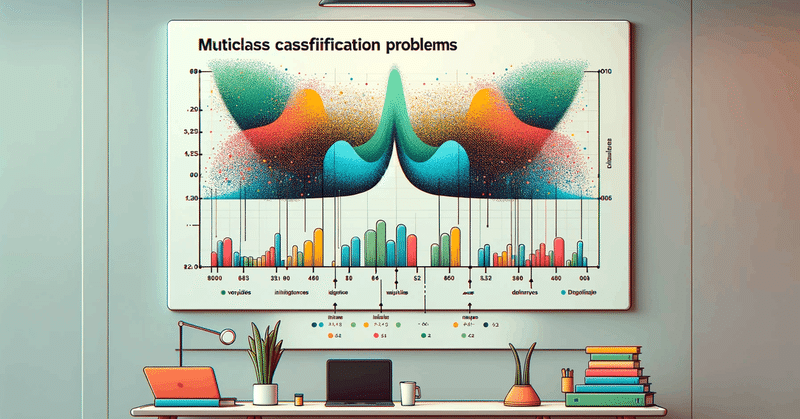

多値分類の閾値調整: Optunaを用いた精度向上

多値分類のコンペが苦手だ。分類問題では後処理での閾値調整が有効らしいけど、その辺の理解がまだ不十分だった。

Kaggleの初心者向けコンペでoptunaを使った閾値調整が使われていたので、ChatGPTにも聞きながら整理してみた。

多値分類問題の閾値調整多値分類モデルは、入力データが各カテゴリに属する確率を出力します。一般に、最も確率が高いカテゴリを予測結果として選びますが、この方法が最良とは限

TEDトーク - 情熱とは、深い愛情のことらしい

エネルギーが足りないときはTEDトークを観るのがいい。

内なる情熱の大切さに気づかされる。

なぜあなたは素晴らしいキャリアを手にすることができないのか

成功、失敗、そして創り続ける力

正則化とは? -機械学習モデルの 過学習を防ぎ、予測精度を最適化する

正則化はモデルが訓練データに過剰に適合することを防ぎ、新しいデータに対する予測精度を高めるための重要な手法らしい。

いままでなんとなくやっていたLightGBMの正規化パラメータ設定についてChatGPTに教えてもらったのでメモします。

正則化とは?L1正則化(Lasso):不要な特徴量の重みを0にして影響を減らす。

L2正則化(Ridge):特徴量の重みを小さくしモデルの複雑さを減らす。

機械学習のための対数変換 - NumPyのlog1p関数

正規分布していない特徴量や目的変数を対数変換することで、予測精度が向上することがある。なんとなく使っていた対数変換について、ChatGPTに教えてもらったのでメモ。

対数とは対数は、ある正の数が別の正の数を何乗したものかを示す数学的操作です。主に、「大きな数値を小さくして扱いやすくする」ために用います。例えば、基数10の対数では、10を何乗するとある数になるかを示します。

基数10の対数関数

多次元データの異常値判定 - Isolation Forest

ChatGPTにIsolation Forestの異常値判定を教えてもらったメモ。特に多次元データセットでの異常値判定は便利なので、特徴量生成に生かしたい。

Isolation Forestとは:多次元データでの異常値検出Isolation Forestは異常値検出に特化した機械学習アルゴリズムで、特に多次元データセットでその能力を発揮します。ランダム分割を利用してデータポイントを孤立させ、異常