【Stable Diffusion WebUI Forge対応】FLUX.1 devで画像生成を極める!初心者でも簡単導入ガイド(1万文字解説!)

FLUX.1 devがStable Diffusion WebUI Forgeに対応!使いやすさ&速さが大幅アップ!

どうも皆さん!新しい靴下、左右どっちがどっちか履くまでわからないタイプの女、葉加瀬あいです!

今回は、FLUX.1 devがStable Diffusion WebUI Forgeに対応したというニュースをお届けします!

また、私のメンバーシップに入門されている方は、今回の記事の内容を動画で確認できます!スキマ時間で最新のAI情報を手軽にキャッチしたい方はこちらからどうぞ!

「Stable Diffusion WebUIって?」「Forgeって何?」と思った方もいるかもしれませんね。

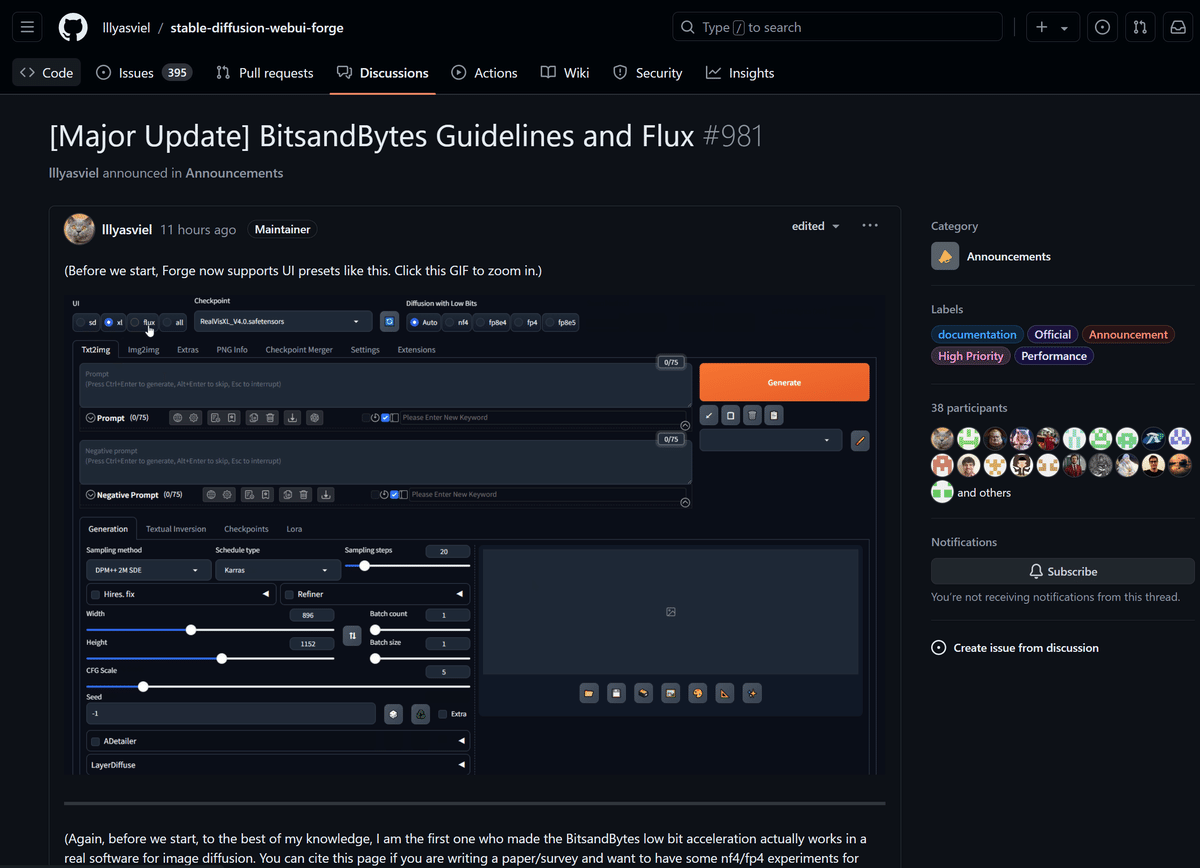

簡単に言うと、Stable Diffusion WebUIは、画像生成AIをブラウザ上で簡単に操作できる便利なツール。

そして、Forgeは、そのStable Diffusion WebUIをさらに使いやすく改良したバージョンなんです。

今回のアップデートで、FLUX.1 devがStable Diffusion WebUI Forgeに対応したことで、使いやすさと処理速度が大幅に向上しました!

具体的には、

bnb版という新しいモデルが使えるように!

画像生成がさらに高速に!

必要な容量が6GBも削減!

画像生成に必要なメモリも効率化!

もう、ワクワクが止まりませんね!

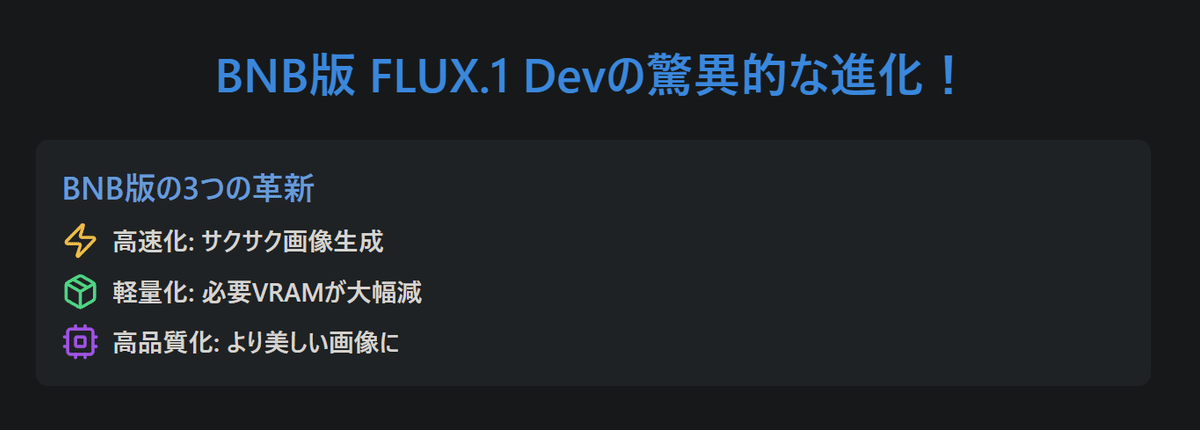

bnb版って何がすごいの?

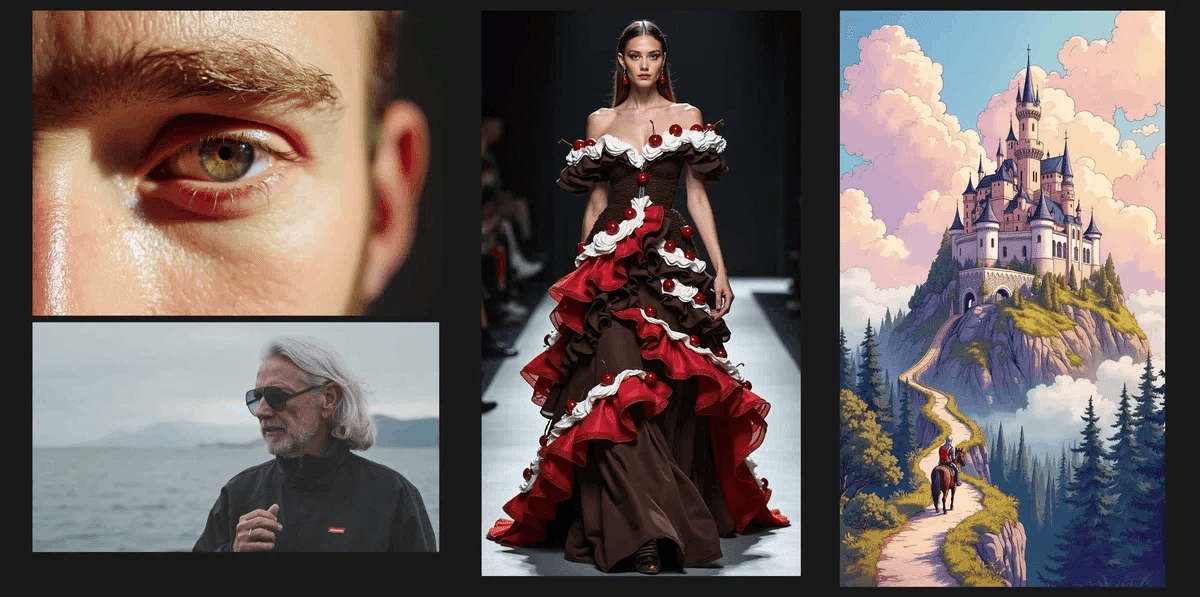

bnb版は、従来のFLUX.1 devよりもさらに高速かつ高品質な画像生成を可能にするモデルです。

しかも、容量も軽量化されているので、あなたのPCやクラウド環境への負担も軽減されます。

以前は、FLUX.1 devを使うには、32GB以上のRAMが必要で、PCが重くなってしまうという問題がありました。

でも、bnb版ならその心配もありません!

より多くのユーザーが、快適にFLUX.1 devを使えるようになったんです。

今回のポイントまとめ:FLUX.1 devがもっと身近に!

今回のアップデートにより、FLUX.1 devは、軽量化、高速化、高品質化という、まさに三拍子揃ったAIモデルへと進化しました!

さらに、Stable Diffusion WebUI Forgeに対応したことで、使いやすさも格段に向上。

今まで以上に、手軽にFLUX.1 devの魅力を体験できるようになりました。

簡単にまとめると、

軽量化:必要なVRAMが少なくて済むので、多くのPCで使える!

高品質:Stable Diffusion WebUIの拡張機能が使える!

高速生成:サクサク画像が作れる!

特に、ADetailerやランダムプロンプト、顔交換など、Stable Diffusion WebUIの便利な拡張機能がそのまま使えるのは、本当にありがたいですよね!

「AI画像生成をもっと手軽に楽しみたい!」そんな願いを叶えてくれるのが、FLUX.1 devなんです。

「AI画像生成に興味はあるけど、難しそう…」と思っていた方も、この機会にぜひFLUX.1 devを試してみてくださいね!

それではさっそく行ってみましょう!

でも、ちょっと待って!FLUX.1 devを使う上での注意点

FLUX.1 devは、つい最近発表されたばかりの最新技術。

そのため、まだまだ設定や使い方に少しクセがあるんです。

「え?そんなの聞いてないよ!」と困ってしまう前に、注意点をしっかり確認しておきましょう!

FLUX.1とStable Diffusion WebUI Forge、もっと知りたい?

FLUX.1やStable Diffusion WebUI Forgeについて、もっと詳しく知りたい方は、ぜひこちらの記事も読んでみてくださいね!

インストール方法や使い方など、基本から応用までしっかり解説しています。

Stable Diffusion WebUI Forgeについて

それでは、FLUX.1 devの実践編、スタート!

準備はいいですか?

ここから、FLUX.1 devの具体的な使い方や注意点を、ステップバイステップで解説していきます。

一緒に、AI画像生成の世界をさらに深く探求していきましょう!

FLUX.1 dev、準備はOK?まずは環境を整えよう!

ワクワクドキドキの実践編! でも、その前に、FLUX.1 devを動かすための準備をしっかりとしておきましょう。 準備不足だと、せっかくの楽しい時間が台無しになっちゃうかもしれませんからね!

ハイスペックPCを持っていないあなたも大丈夫!

FLUX.1 devは高性能なAIモデルなので、VRAMが12GB以上、メモリが32GB程度のハイスペックなPCが必要になります。

もし、あなたのパソコンのスペックが足りない場合は、後ほど解説するクラウド環境の利用がおすすめです。

クラウド環境なら、インターネットを通じて高性能なコンピューターを借りることができるので、自分のパソコンの性能に関係なく、FLUX.1 devを動かすことができるんです! まるで、レンタルした高級車でドライブを楽しむような感覚ですね!

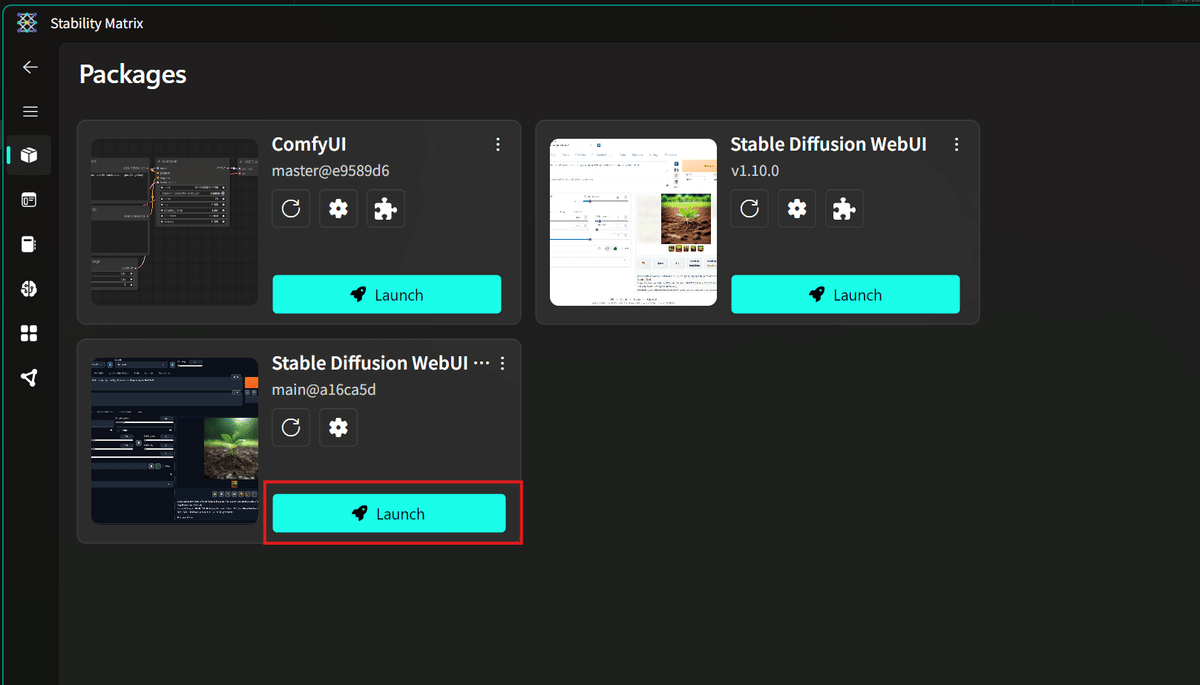

私は今回、ローカル環境でStability Matrixというツールを使って解説していきます。 ローカル環境とは、自分のパソコンの中にFLUX.1 devをインストールして動かす方法のこと。 インターネット環境がなくても使えるので、自分のペースでじっくりと画像生成を楽しめます。

Stability Matrixは、Stable Diffusion Web UIを簡単に管理・使用できる便利なツール。 複雑な設定をしなくても、初心者の方でも安心して使えるように設計されているので、先ほどのPCのスペックを満たしている方は、ぜひ活用してみてくださいね!

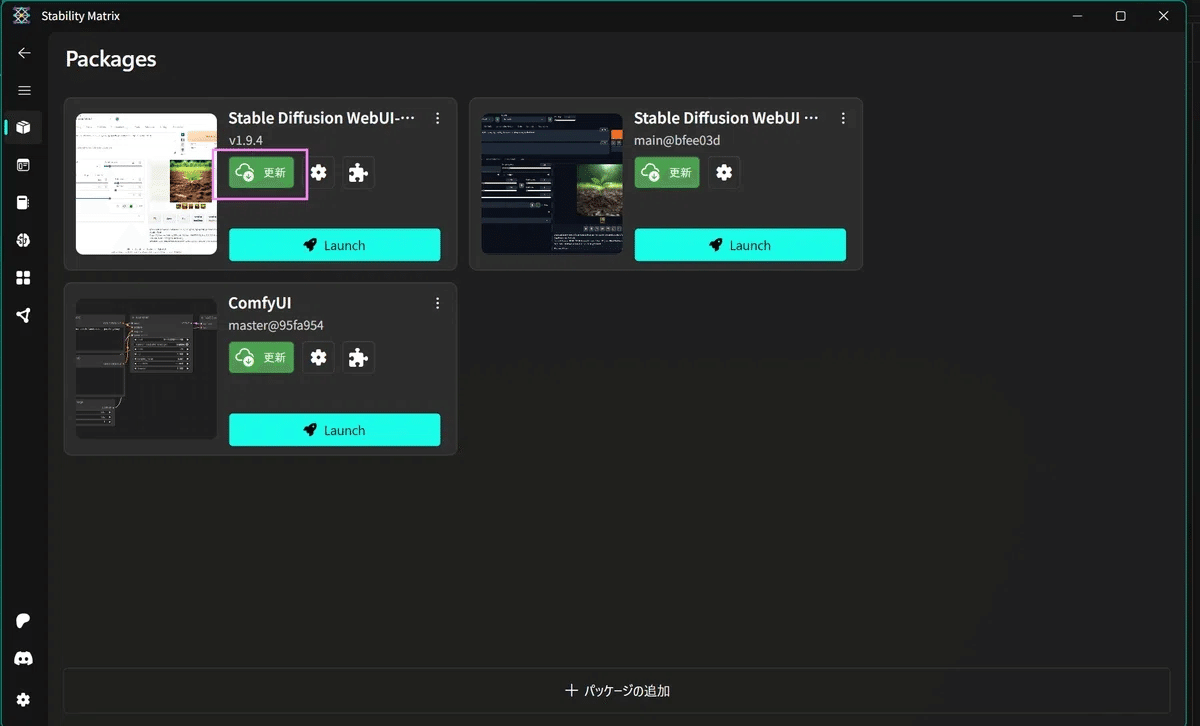

Forgeのアップデートをお忘れなく!

FLUX.1 devを使うには、Forgeを最新版にアップデートしておく必要があります。 アップデートしていないと、FLUX.1 devがうまく動かない可能性があるので、注意してくださいね!

私のようにStability Matrixを使っている方は、更新ボタンをクリックするだけで、自動的にアップデートが完了します。 とっても簡単なので、サクッと済ませてしまいましょう!

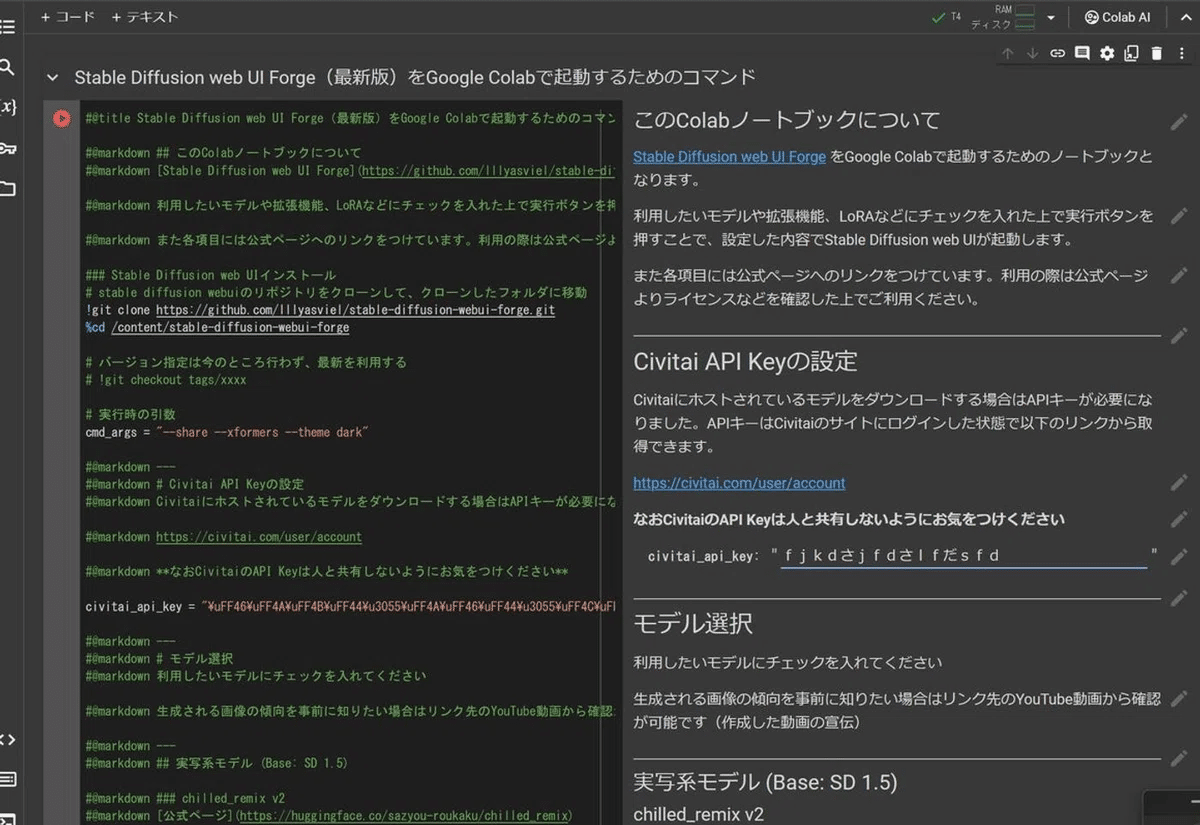

この後解説する、クラウド環境でStable Diffusion Web UIを動かしている方は、ノートブックの中で自動的にアップデートされるようになっているので、特に心配はいりません。 もしエラーが出てしまった場合は、コメント欄で教えてくださいね!

クラウドでも使える!

「Google ColabやPaperspace Gradientを使いたい!」という方もいるかもしれませんね。 もちろん、これらのクラウドサービスでもFLUX.1 devを使うことができます。

Google Colab: Googleが提供する無料のクラウドサービス。ブラウザ上でPythonなどのプログラミング言語を実行したり、機械学習モデルを動かしたりできます。高性能なコンピューターを使えるので、自分のパソコンでは難しい処理も可能になります。

Paperspace Gradient: クラウドコンピューティングとAI開発のためのプラットフォーム。高性能なGPUを使って、機械学習や画像処理などの複雑な作業を行えます。

これらのクラウドサービスを使ったStable Diffusion Web UIの導入方法については、過去の記事で解説していますので、ぜひ参考にしてみてください。

無料で使えるAmazon SageMaker Studio、 Googleコラボよりも優秀なPaperspaceで使用したい方は要望があればまたノートブックを作成したいと思っているので必要があればコメント欄で教えてください!

または、こちらの記事に本家のStable Diffusion WebUIを動かすノートブックは記載しているので、そちらを参考にForge を動かすように修正して使っていただいても大丈夫です!

Amazon SageMaker Studio Labでの使い方: https://note.com/ai_hakase/n/n7dd5c1fd4990?magazine_key=m8e1b089bc489

FLUX.1 dev、いざ起動!Stable Diffusion WebUI Forgeで画像生成AIを体験しよう!

準備が整ったら、いよいよForgeを起動して、FLUX.1 devの世界に飛び込みましょう!

Forgeが起動したら、ラジオボタンでFLUXを選択してください。 すると、FLUX.1 devを使うための推奨設定が自動的に読み込まれるので、とっても便利! まずは、この推奨設定で試してみて、慣れてきたら自分好みにカスタマイズしていくのも良いですね。

— ハカセ アイ🎈 “Note + Youtube” で最新AI技術を解説しています・:*:・。 (@ai_hakase_) August 12, 2024

FLUX.1モデルの選択とダウンロード:あなたのPCに合ったモデルを選ぼう

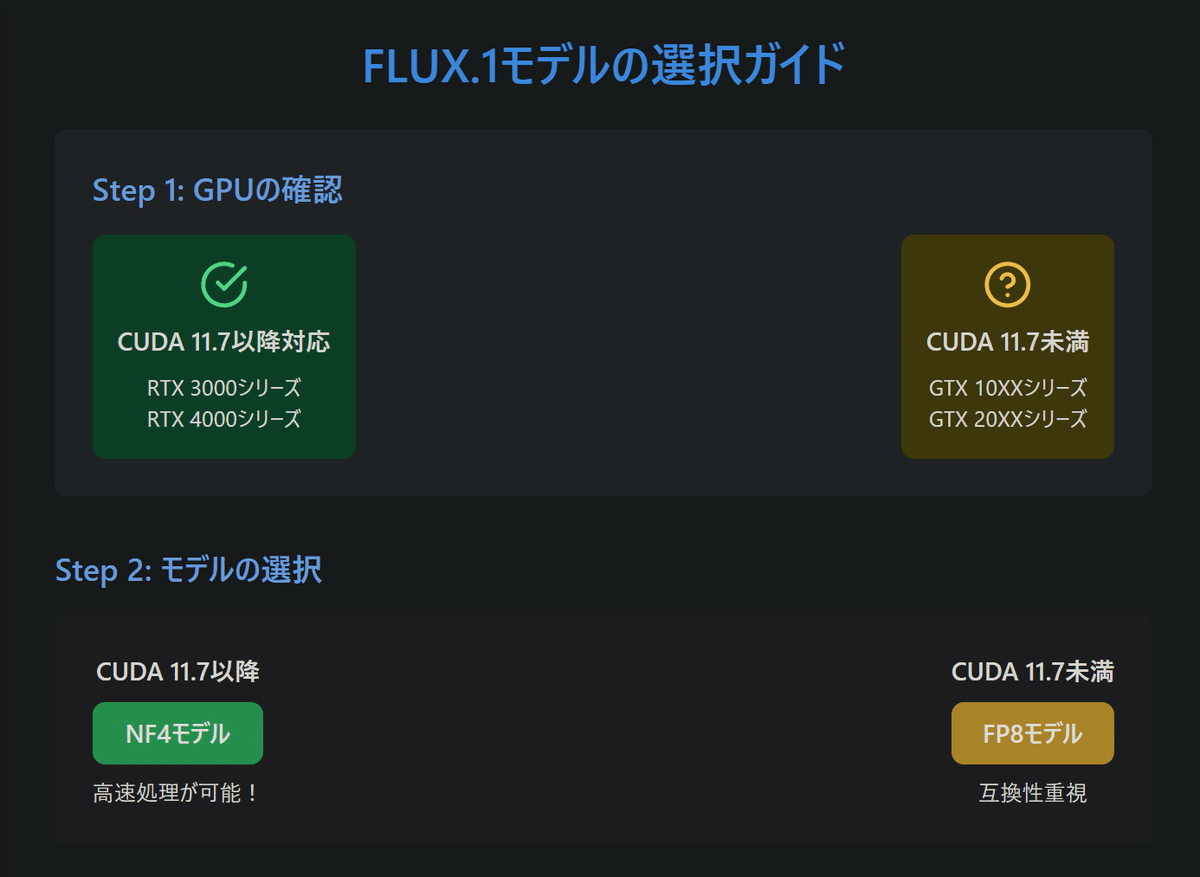

FLUX.1 devを使うには、まずモデルファイルをダウンロードする必要があります。 どのモデルファイルを選べばいいか、一緒に見ていきましょう!

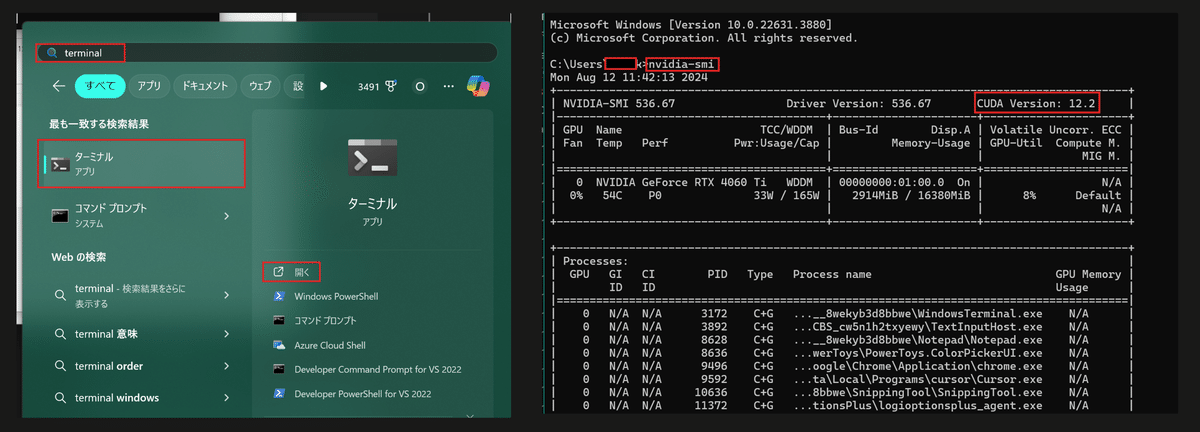

まず、あなたのPCがCUDA 11.7以降に対応しているか確認してください。 ほとんどのRTX 3000シリーズやRTX 4000シリーズのGPUは対応しているので、該当する方はラッキー!

高速処理が可能なNF4というモデルが使えるんです! この場合は、flux1-dev-bnb-nf4.safetensorsというファイルをダウンロードすればOKです。

もし、GTX 10XXやGTX 20XXといった少し古いGPUを使っている場合は、NF4に対応していない可能性があります。

その場合は、flux1-dev-fp8.safetensorsというファイルをダウンロードしてくださいね。 ご自身のPCがCUDA 11.7以降に対応しているかどうかは、Windowsならこちらのようにターミナルというものを開いて「nvidia-smi」コマンドで確認できます。

ちょっと難しい言葉、解説します!

CUDA: NVIDIAが開発した、GPUを使って高速な計算を行うためのプラットフォームです。画像生成AIのような複雑な処理を高速化するために欠かせない技術なんです!

GPU: Graphics Processing Unitの略。主に画像処理を行うための特殊なプロセッサです。最近では、AI処理にも使われるようになり、画像生成に大きな役割を果たしています。

Forgeの設定:積載重量タイプを〇〇にしよう!

Forgeには、積載重量タイプという設定項目があります。 これは、GPUが一度に処理できるデータ量を決めるもの。

ほとんどの場合は、Autoに設定しておけばOK! Forgeが自動的に最適な設定を選んでくれるので、初心者の方でも安心です。

NF4とFP8、結局どっちがいいの?徹底比較!

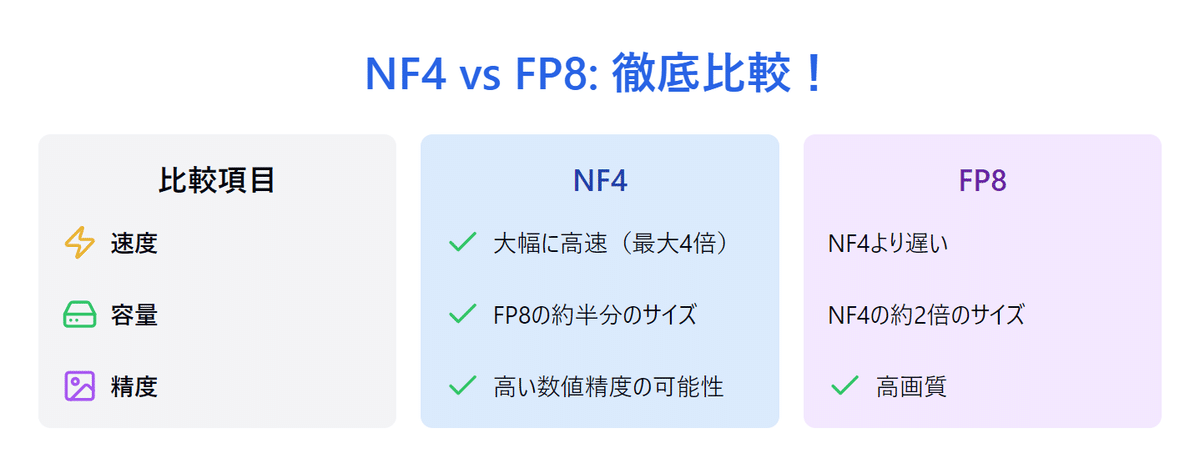

「NF4とFP8、どっちを選べばいいか分からない…」そんな方のために、2つのモデルの違いを詳しく解説します!

速度: NF4は、FP8よりも大幅に高速です。特に、VRAMが6GBや8GBしかないGPUを使っている場合は、NF4の方が1.3倍から最大4倍も速く画像を生成できます。

容量: NF4のファイルサイズは、FP8の約半分です。ストレージ容量が限られている場合は、NF4の方が有利ですね。

精度: NF4は、FP8よりも数値精度が高い可能性があります。つまり、より正確で美しい画像を生成できるということです。

「うーん、でも結局どっちがいいの?」

そう迷っているあなたに、葉加瀬あいの結論をズバリお伝えします!

高速生成を重視するなら → NF4

ストレージ容量が気になるなら → NF4

最高画質を求めるなら → FP8

どちらのモデルも素晴らしいですが、個人的には、バランスの取れたFP8をオススメします。 もちろん、最終的な判断はあなた次第!

ぜひ、両方試してみて、自分に合ったモデルを見つけてくださいね。

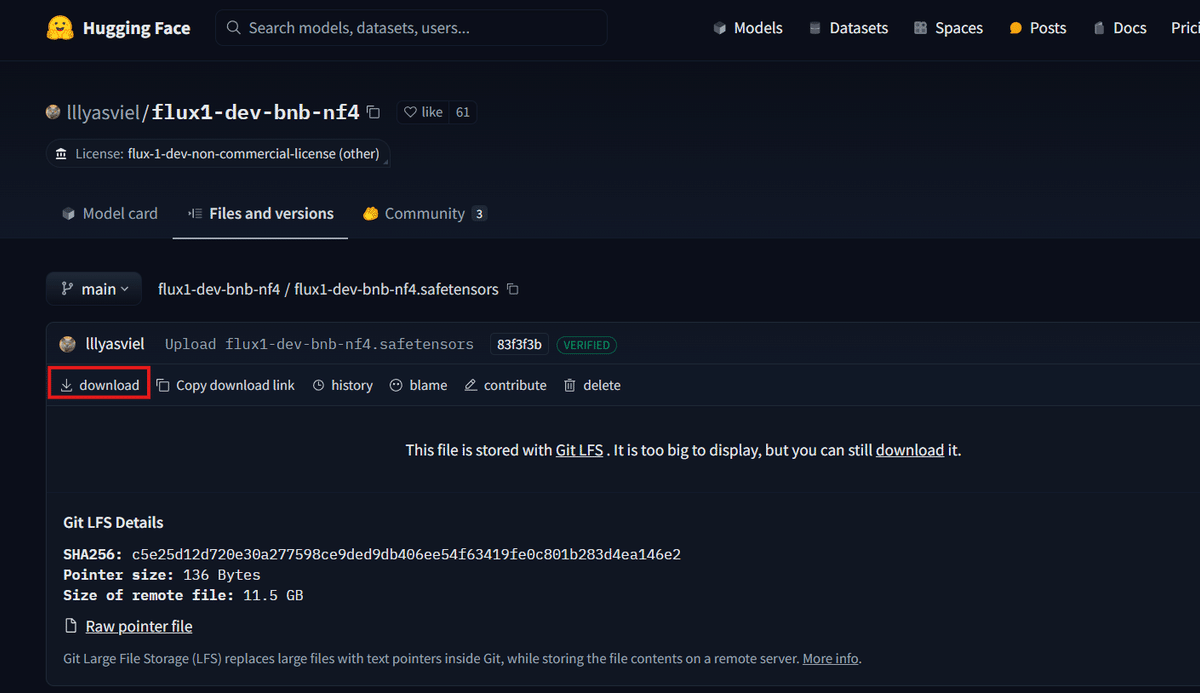

FLUX.1 devをダウンロード!Hugging Faceからモデルをゲット

モデル選びで悩んだら、まずはFP8版を試してみるのがおすすめです。 FP8版のモデルファイルは、以下のリンクからダウンロードできます。

https://huggingface.co/lllyasviel/flux1-dev-bnb-nf4/blob/main/flux1-dev-bnb-nf4.safetensors

Hugging Faceは、AIモデルやデータセットを共有するためのプラットフォーム。 世界中の研究者や開発者が、ここで自分のモデルを公開しているので、AI好きなら要チェックのサイトです!

ちょっと待って!ダウンロードする前に…

FLUX.1 devを動かす前に、いくつか注意点があります。 これを知らずに始めると、時間がかかってしまったり、エラーが出てしまったりするかもしれないので、しっかり確認しておきましょう!

まず、bnb版の速度向上は、デバイスによって効果が異なる場合があります。 一部の環境では、fp16版やfp8版の方が速く、高品質な画像が生成されるという報告もあるんです。

私の環境でも、従来のFLUX.1 devモデルの方が少し速かったので、実際に試してみて、どちらが自分に合っているかを確認するのがおすすめです。

また、bnb版のファイルサイズは約11GB、FP8版は約17GBと、どちらもかなり大きめ。 ダウンロードする前に、PCの空き容量をしっかり確認しておきましょうね!

もう一つ、起動時のオプションに関する注意点があります。xformersという高速化ライブラリは、FLUX.1では動作しないようです。 xformersを使うと、エラーが出てしまう可能性があるので、起動オプションからは外しておきましょう。

「xformersって何?」と思った方は、こちらのコラムをチェック!

FLUX.1 devを使ってみよう!Forgeの設定と使い方

Forgeを起動したら、UIプリセットで「FLUX」を選択してください。 これで、FLUX.1 devに最適な設定が自動的に適用されます。

プロンプトを入力する場所があるので、あなたの創造力を爆発させて、魔法の呪文のように言葉を入力してみてください! ネガティブプロンプトは不要なので、空欄のままでも大丈夫です。画像サイズも忘れずに設定しましょう。

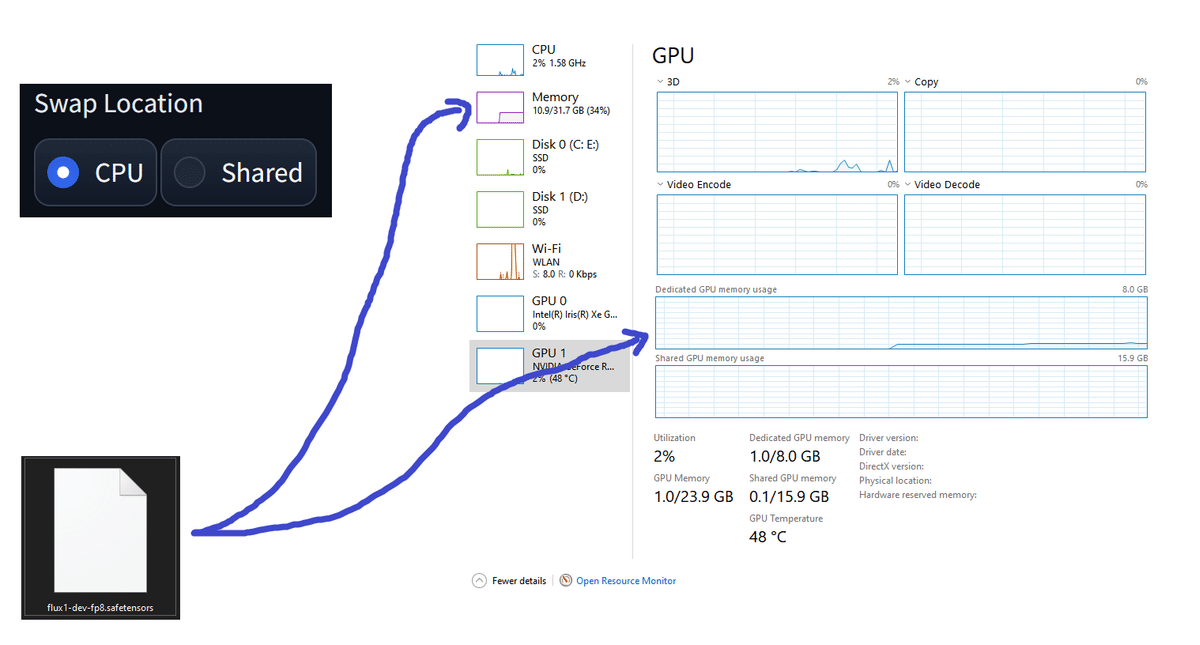

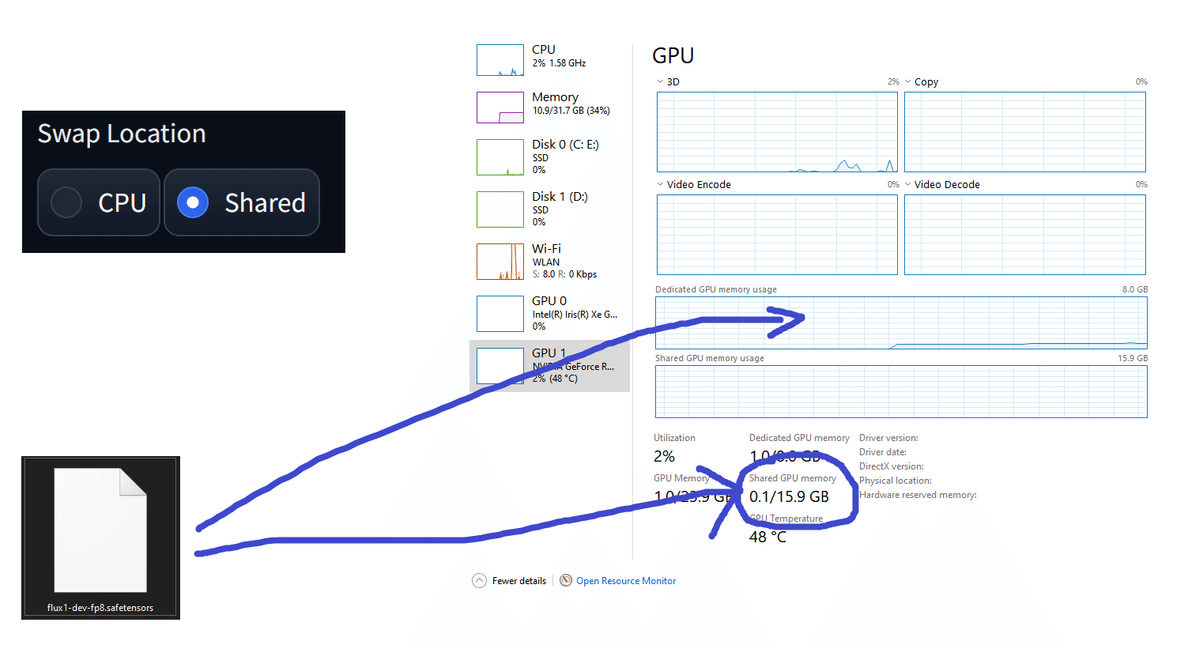

メモリ管理オプション:CPU?それともShared?

FLUX.1 devは多くのメモリを必要とするので、メモリ管理オプションも重要です。

スワップ場所をCPUに設定すると、モデルはCPUメモリとGPUにロードされます。

スワップ場所を「Shared」に設定すると、モデルはGPUと共有メモリにロードされます。

新しいデバイスでは、「Shared」の方が約15%高速に動作する傾向があります。 ただし、一部のデバイスでは、「Shared」に設定するとクラッシュする可能性があるので注意が必要です。

専門用語をおさらい!

スワップ: コンピューターのメモリが足りなくなったときに、ハードディスクの一部をメモリの代わりに使う仕組みのこと。

CPUメモリとGPUメモリ: CPUメモリ(主にRAM)は、CPUが直接アクセスするメモリ。GPUメモリは、GPUが使用する専用のメモリです。

共有メモリ: CPUとGPUの両方がアクセスできるメモリ領域のこと。データのやり取りを効率化できますが、デバイスによっては対応していない場合があります。

これで、FLUX.1 devを使う準備はほぼ完了! いよいよ、画像生成に挑戦していきましょう!

FLUX.1 dev、いよいよ実践!あなただけのオリジナル画像を生成しよう

さあ、準備は整いましたか?いよいよFLUX.1 devを使って、画像生成に挑戦してみましょう!まずは、基本の設定からスタートです。

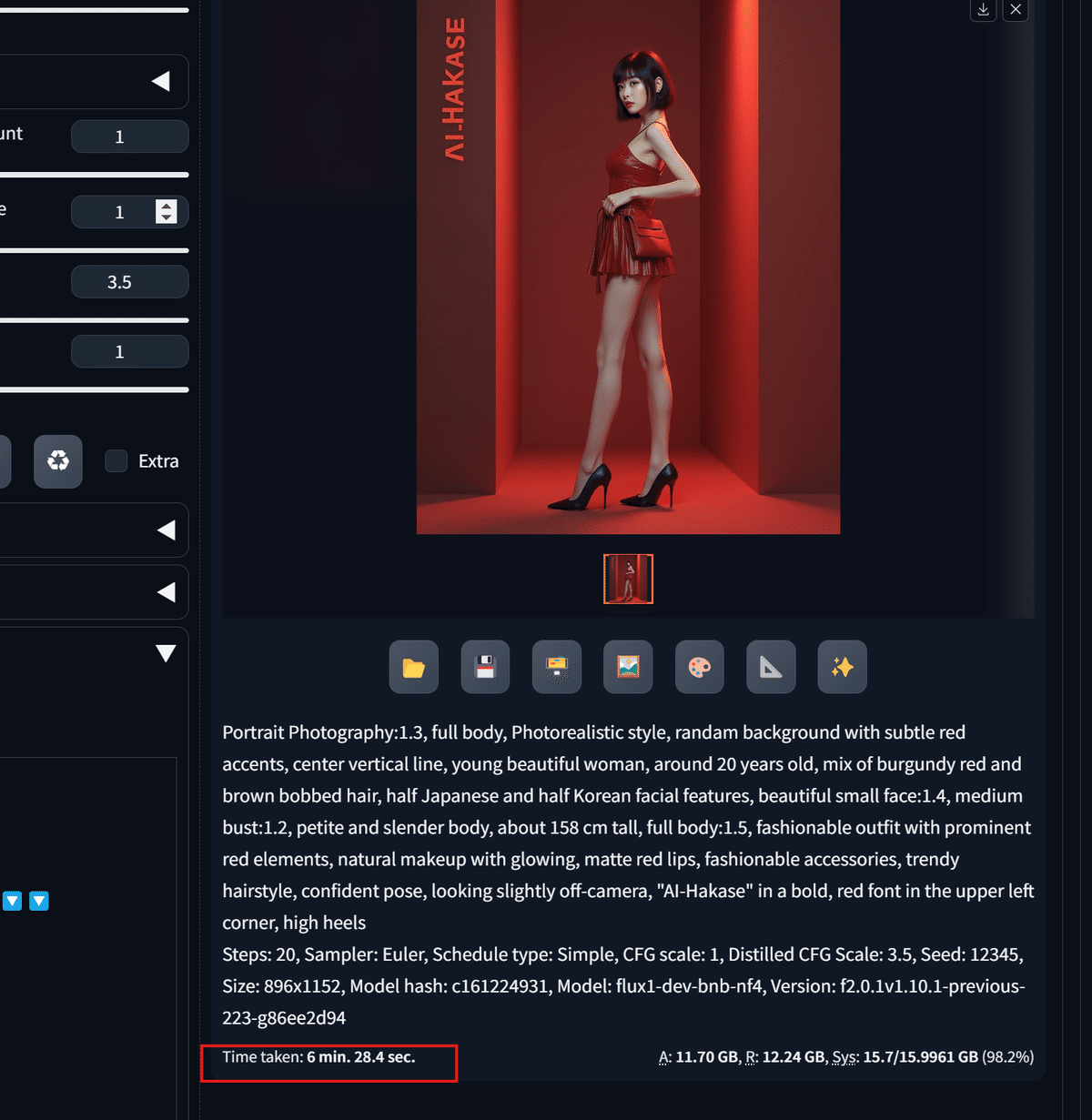

推奨設定でサクッと画像生成!

まずは、私がおすすめする設定を試してみてください。

サンプラー: Euler

サンプリングステップ数: 20

CFGスケール: 1

これらの設定は、現時点での最適な値を参考にしています。 今後のアップデートや、コミュニティでのフィードバックによって、さらに良い設定が見つかるかもしれません。 色々試してみて、あなたにとってベストな設定を見つけてくださいね!

さっそく画像生成してみよう!

プロンプトを入力したら、Ctrl + Enterキーを押すか、「Generate」ボタンをクリックして、画像生成を開始! ドキドキしながら、結果を待ちましょう!

初回の生成は、AIが準備運動をするので、約2分半ほど時間がかかるかもしれません。 でも、2回目以降は1分以内に生成されるので、どんどん新しい画像を作ってみてくださいね!

プロンプトが長すぎると時間がかかる!?

FLUX.1 devは、長文のプロンプトにも対応していますが、長すぎると生成時間が大幅に増加してしまうので注意が必要です。 目安としては、75トークン以内に収めるのがおすすめです。

これは、Forgeがが内部的にFLUX.1 devのプロンプトを拡張処理しているためです。 この処理が、長すぎるプロンプトに対応しきれていないのが原因のようです。 今後のアップデートで改善されることを期待しましょう!

〇〇でプロンプトを拡張!

「もっと色々な画像を作りたいけど、プロンプトを考えるのが大変…」

そんなあなたには、Dynamic Promptsという拡張機能がおすすめです! Dynamic Promptsを使えば、プロンプトの一部をランダムに変化させることができるので、多様な画像を簡単に生成できます。

例えば、「{赤い|青い|黄色い}花」というプロンプトを入力すると、AIは「赤い花」「青い花」「黄色い花」のいずれかをランダムに選んで画像を生成します。 これなら、アイデアが浮かばなくても、色々な画像を作ることができますね!

Dynamic Promptsを使えば、表示上は800トークンほどの長いプロンプトでも、約57秒で画像を生成できました! これはすごい!

ChatGPTやGeminiなどのAIチャットツールを使って、75トークン以内のプロンプトを作成し、Dynamic Promptsでバリエーションを増やすのが、効率的な画像生成のコツかもしれませんね!

他の拡張機能との組み合わせも自由自在!

FLUX.1 devは、他の拡張機能との組み合わせも可能です。 例えば、ControlNetを使えば、ポーズや構図をより細かく指定することができます。

ただし、現時点では、LoRAやControlNetなどをForgeで使うには、少し調整が必要です。 今後のアップデートで、簡単に使えるようになることを期待しましょう! どうしても使いたい方は、ComfyUIというノードベースのインターフェースを使う方法もあります。

ノードベースのUIとは、様々な機能をブロックのように組み合わせて、視覚的に操作できるインターフェースのこと。 プログラミングの知識がなくても、直感的に操作できるので、ぜひチャレンジしてみてください!

これで、FLUX.1 devの基本的な使い方と、より高度な画像生成のためのテクニックをご紹介しました。 あなたも、FLUX.1 devを使って、素晴らしい画像をたくさん生み出してくださいね!

まとめ:FLUX.1 dev、使いこなして画像生成マスターになろう!

今回は、FLUX.1 devの導入方法から使い方、そしてFP8版とFP16版の違いまで、みっちり解説しました! これで、あなたもFLUX.1 devマスターに一歩近づいたはず!

特に重要なポイントは、

FLUX.1 devは、高品質な画像生成と拡張機能との相性が抜群!

自分のPCスペックに合わせて、FP8版かFP16版を選ぼう!

ComfyUIを使って、視覚的にFLUX.1 devを操作できる!

プロンプトの長さに注意!長すぎると生成時間がかかります。

Dynamic Promptsなどの拡張機能を使えば、さらに表現の幅が広がる!

この記事が面白かった、参考になったという方は、ぜひフォローやいいね、高評価をお願いします! 皆さんの応援が、私の励みになります。

また、ほかの記事はジャンル別にマガジンでまとめているので、興味のあるものがあればぜひチェックしてみてください!

入門者の権限でほとんどのすべての動画と記事が読めます⭕️

メンバーシップの詳細や利用ルールについては、以下のリンクから確認できます!

保護猫活動へのご支援のお願い

また、私、葉加瀬あいは今回のようなAI解説以外にも、『動物の保護・殺処分による税金の出費を0にする活動』として、保護猫活動を行っております。

もしよろしければ、少額でも構いませんので、以下のリンクからご支援いただけると幸いです。

【動物の保護・殺処分による税金の出費を0にする活動、保護猫活動のサポート🐾】

🐈️Buy Me Coffee☕:https://www.buymeacoffee.com/okozk/e/159997

皆さんの温かいご支援が、保護猫たちの幸せにつながります。

ご協力、心より感謝いたします。

最後まで読んでいただき、ありがとうございました!

それでは、また次の記事か動画でまたお会いしましょう!

葉加瀬あいでした!

参考文献

今回の記事を作成するにあたり、以下の資料を参考にさせていただきました。

https://github.com/lllyasviel/stable-diffusion-webui-forge/discussions/981

https://huggingface.co/drbaph/FLUX.1-schnell-dev-merged/tree/main

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?