『IP-Adapter Plus』を使いこなそう❗/SDXLのControlNet を使って類似画像を生成❗(Stable Diffusion WebUI with ip-adapter_clip_sdxl_plus_vith)

近年、Stable Diffusion の text2image が高品質の画像を生成するために注目されていますが、テキストプロンプトだけでは、目的の画像を生成するのが難しいことが多くあります。

そこで、画像プロンプトという手法が提案されました。画像プロンプトとは、生成したい画像の参考となる画像を入力として使うことです。

しかし、画像プロンプトを使うには、事前に訓練されたモデルを微調整する必要があります。これには、大量の計算資源と時間が必要です。また、微調整したモデルは、他のモデルやプロンプトと互換性がなくなることがあります。

この問題を解決するために、登場したのがIP-Adapterです。

この記事では、IP-Adapter の特徴や、最新版の『IP-Adapter Plus』にフォーカスして、モデル毎の生成結果の違いについて詳細に説明していきます。

● 前提条件 (Stable Diffusionの使用環境)

この記事は Stable Diffusion WebUI と SDXL が導入されている事を前提に進めていきます。

Stable Diffusion WebUI で SDXL を使用するには『NVDIA製のグラフィックボードでかつ VRAM 16GB 以上を搭載したPC』が必要になり、そのスペックのPCを購入するには 約30万円以上の料金がかかります。

本稿の解説でも、それと同等の使用環境があることを前提に解説を進めます。

とはいっても、Stable Diffusion の利用にいきなり約30万円の初期投資ができる人はそういないと思いますので、私の記事では

Amazon Sagemaker Studio で無料利用。

Paperspace Gradient で課金し、より高性能なGPUマシンで利用。

それでも物足りなくなったらハイスペックPCを購入する。

といった優先順位での利用を推奨しております。

そのため、そのような性能のPCを持たない方は、 私の別の記事で解説している『クラウドサービスから Stable Diffusion WebUI を使用する方法』を使用して、同等の環境で利用することができますので、まずは以下のリンクから登録・導入作業をお願いいたします。

① 【無料】 Sagemaker Studio で利用する方法

こちらの方法は、無料で行うことができ、VRAM 15GB を搭載したGPUマシンを使用することができます。つまり、最新版モデルであるSDXLを使用することができます。

具体的には、Amazon Sagemaker Studio で Stable Diffusion WebUI を使用する方法を詳細に解説しており、 煩わしい導入作業や起動もワンクリックで 行うことができます。

無料であることのデメリットとしては、ベータ版であることと、1日に4時間の使用制限があることが挙げられますが、 1日の利用制限を実質ないことにする方法も解説しています。

『 ひとまずは無料で試してみたい』『 マネタイズできてきたら有料のサービスを利用したい』といった方は、以下のリンクをクリックしてご利用ください。

② 【月額8$】 Paperspace Gradientで利用する方法

こちらの方法は、 月額8$ (約1180円) で行うことができ、VRAM 16GB を搭載した、 さらに高性能なGPUマシンを使用することができます。

具体的には、Paperspace Gradient で Stable Diffusion WebUI を使用する方法を詳細に解説しており、 こちらでも煩わしい導入作業や起動もワンクリックで行うことができます。

また、こちらの方法では 1 日の利用制限等は特になく、当然 SDXL を使用することも可能です。加えて、初月無料で利用する方法も紹介しております ので、費用を抑えることもできます。

『もっと画像生成の時間を短縮したい』『 もう一歩踏み込んでStable Diffusion WebUI を使ってみたい』といった方は、以下のリンクをクリックしてご利用ください。

※ Stable Diffusion の基礎知識に関して

本稿では、Stable Diffusion WebUI の基礎的な部分に関しての解説を省略させていただきます。

Stable Diffusion WebUI の仕組みや基礎・画面説明 などに関しては以下で非常に詳細に解説していますので、以下のリンクをクリックして、是非本稿をお読みになる前にご一読ください。

また、ControlNet という拡張機能の一部分に関して解説を行っていきますが、こちらも基礎的な部分に関しての解説を省略させていただきます。

ControlNet の仕組みや基礎・画面説明 などに関しては以下で非常に詳細に解説していますので、以下のリンクをクリックして、こちらも本稿をお読みになる前に是非ご一読ください。

⚠ 本題に移る前に、メンバーシップの説明をさせてください。

🎈 たった一晩でプロのイラストレーターになれるメンバーシップ 『あいラボ (AI-Labo)』

このブログでは、月980円で私が書いた有料記事が全て読み放題になるメンバーシップに加入することができます。

有料記事では、生成AI を使った創造的なコンテンツをお届けしています。

具体的には、以下のようなものがあります。

どんなPCでも、たとえスマホでも Stable Diffusion XL(SDXL)を無料 or 低額で使用する方法

SDXL を使用するには VRAM16GB 以上のGPUを搭載したPCが必要であり、そのスペックのものを購入しようとすると最低でも30万円はします。

これを、ある方法を利用することで無料もしくは低額で利用できますので、実質 約30万円 が丸々お得になります。

👇 詳細は以下クリック👇(マガジンにまとめてあります。)

SDXL で思い通りの画像を生成して、自分の絵をもっと好きになる方法

Stable Diffusion は最も画像生成の幅が広く大変機能の充実したジェネレーティブAI ですが、使いこなすにはコツがあります。

実は、少し工夫を加えるだけで生成画像のクオリティが格段に良くなるのですが、あまり多くの人はその方法を使っていません。

つまり、その方法を使うだけで、例え初心者であってもすぐに周りを追い越すことができます。その最短距離をお教えします。

👇 詳細は以下クリック👇(マガジンにまとめてあります。)

SNS を自動化して、Stable Diffusion を使ったSNS運用をする方法

SDXLの導入と画像生成のコツがわかったら、次はSNSなどで発信して、ポートフォリオを作り副業にしたり、社会貢献に使ったりなどなど、色々な道があると思います。

そのため、Stable Diffusion の知識に加えて、SNSを自動化する方法も案内しています。ここでは、SNSで毎日決まった時間に画像付きの投稿をする方法などもまとめておりますので、毎日のSNS運用がぐっと楽になるはずです。そうして空いた時間を、画像生成や他の活動に回すこともできます。

👇 詳細は以下クリック👇(マガジンにまとめてあります。)

このように、メンバーシップではこれらの記事が全て読み放題になり、その中には通常は3000円近い有料記事も含まれていますので、今ならそれらも980円で閲覧できる事になります。

今が最もお得な時期になりますので、是非メンバーシップに登録して生成AIの魅力を体験してみてください!

👇 以下をクリックして、すぐに登録できます👇

それでは、続きを解説していきたいと思います。

● IP-Adapterとは

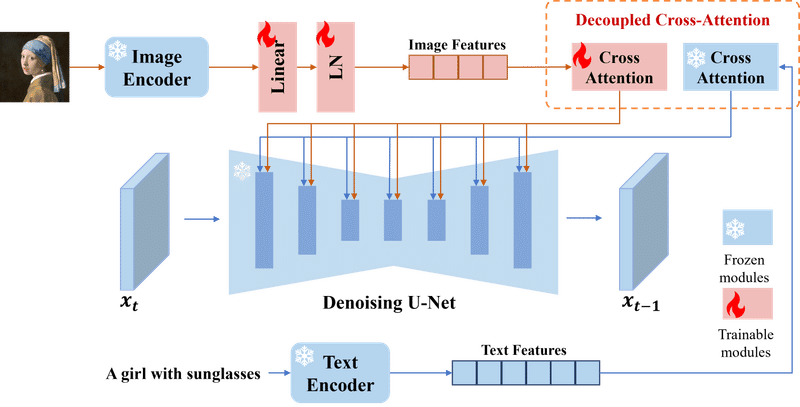

IP-Adapterは、ControlNet の機能のうちの一つで、Stable Diffusion WebUI の text2image に画像プロンプトの機能を追加するための軽量なモジュールです。

クロスアテンションメカニズムというものを採用しており、テキスト特徴と画像特徴の相互作用を分離することで、画像プロンプトとテキストプロンプトのバランスを調整できるようにするものです。

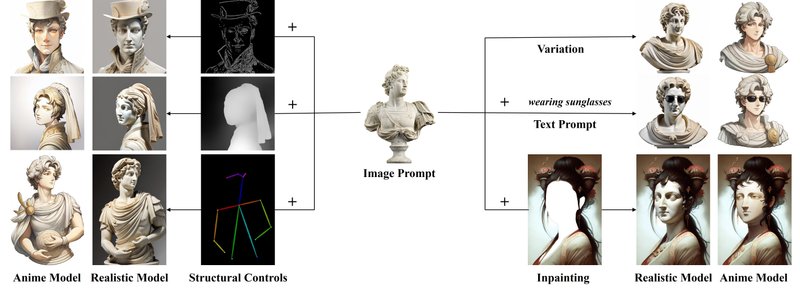

また、IP-Adapterは、わずかなパラメータしか持たず、事前に訓練されたモデルを凍結したまま使用できます。そのため、計算コストが低く、他のモデルやプロンプトとの互換性も保たれますので、画像プロンプトだけでなく、以下のようにテキストプロンプトや他のControlNetなどとも連携して、マルチモーダルな画像生成を実現できます。

● IP-Adapterの生成例

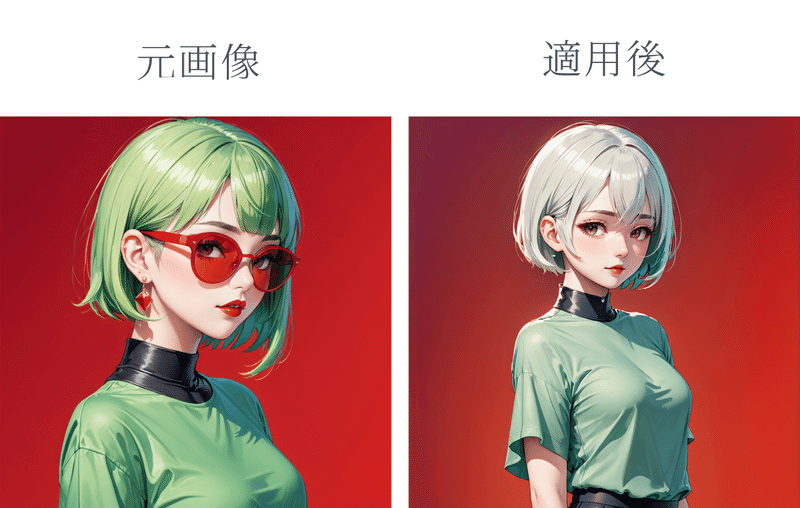

IP-Adapterの生成例を以下に示します。IP-Adapter を使うに当たって、テキストプロンプトとして「1girl,solo,short hair,white hair,full body,portrait」(白髪の女の子)を入力し、画像プロンプトをアップデートします。

今回は『ip-adapter_clip_sdxl_plus_vith』というIP-AdapterIP-Adapterのプリプロセッサを使用して画像が生成しました。

出力された結果が以下になります。

この例では、テキストプロンプトと画像プロンプトの両方が画像生成に影響していることがわかります。

テキストプロンプトに従って、白髪の女の子が表示され、服装は元画像(アップロードした画像)のものがしっかりと反映されていて、全体的に参考画像に近いものになっています。

また後述する、ip-adapter_clip_sdxl やip-adapter_clip_sdxl_plus_vith などのプリプロセッサを使い分けて、元の画像の服装や背景・顔・背景を除くもの など、引き継ぐ項目を使い分けて画像生成することもできます。

● ControlNetの導入方法とアップデート方法

IP-Adapterは、イラストの生成結果を自在に制御することができるControlNetという拡張機能を必要とします。

こちらでは、すでにStable Diffusion WebUIをインストールしている方向けに ControlNetの導入方法とアップデート方法 を簡単に解説していきます。

▫ ControlNetの導入方法

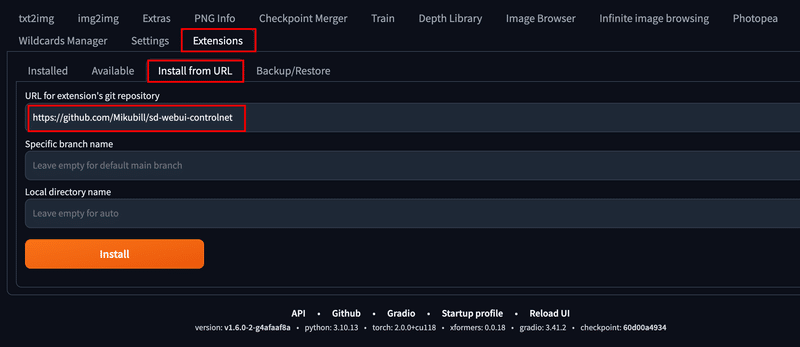

操作画面の上タブから「拡張機能」➡︎「URLからインストール」を選択し、拡張機能のリポジトリのURLに「[https://github.com/Mikubill/sd-webui-controlnet]」を入力します。

インストールのボタンを押すと「Installed」の中に「sd-webui-controlnet」が表示されますので、そこにチェックを入れて、オレンジ色のボタンを押すと適用されます。

▫ ControlNetのアップデート方法

「Installed」を選択し「Check for updates」をクリックします。

何も出力されなかれば、最新のものになります。

"sd-webui-controlnet"が"new commits"になっている場合はアップデートが必要ですので、チェックを入れて「Apply and quit」をクリックします。

また、IP-Adapterを使うためには、Stable Diffusion web UI自体をv1.6.0以降に更新する必要があります。

● IP-AdapterのControlNet Modelのインストール

ここから先は

この記事が気に入ったらサポートをしてみませんか?