記事一覧

AirLLM:405BのmodelをLocalで動かすと

去年の年末頃、比較的大きなLLMのmodelでも各層毎にGPUで計算することで少ないGPUメモリでも動かすことができるAirLLMが公開されました。

その方がLlama 3.1 405B modelを8GB VRAM以下で動作させていたので、試してみました。

概要Llama-3.1-405B

言わずもがな、Meta社の現在最高峰のオープンソース、多言語対応、128Kと長いコンテキスト長のmo

DSPy+CoT, RAG series 4/n

RAGシリーズ4回目。

今回は自動でprompt最適化してくれるDSPyを用いたRAGです。

Prompt Engineeringが面倒だと感じる私の助けになってくれるかもしれません。今回は推論タスクで効果を発揮するCoT(Chain-of-Thought)を用います。

0. 環境

1. HotpotQA Dataset

今回はWikipediaの質問応答DatasetのHotpotQA

Llama-3-ELYZA-JP-8Bを雑に触る

Llama-3-ELYZA-JP-8Bについては下記参照。

0. 環境

1. RAGに使用するDBの準備

下記で作成したDBを流用します。

DBの内容は、Google Patentsで「(semiconductor) country:US after:priority:20230101 language:ENGLISH」でヒットした857件の特許のうち、下記記事でFinFETに分類されたもの

[UI]Chainlitで専門家AI_Local-LLM+Langchain+ChromaDB

LLMのUIにはtext-generation-webuiをはじめ様々なものがありますが、今回はChainlit(GitHub)に下記の記事で作成したDB(Langchain+ChromaDB)を使ってLocal-LLM(Starling-LM-7B-alpha)に回答してもらうChat-UIを作成します。

ほかのユーザーに使用してもらう際に、UIはユーザーの認知容易性の面でメリットがあります。

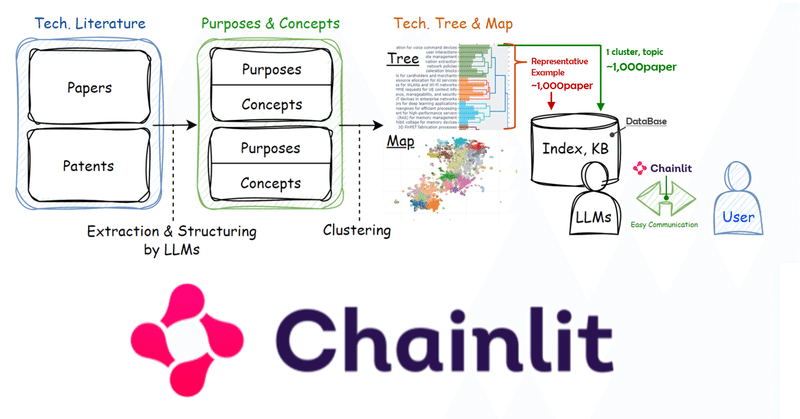

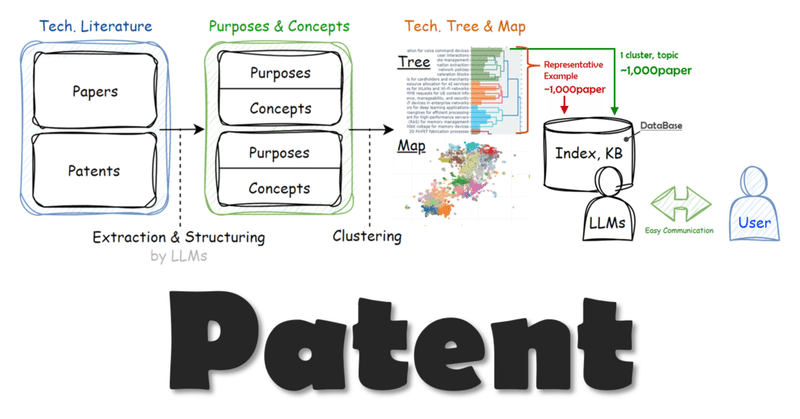

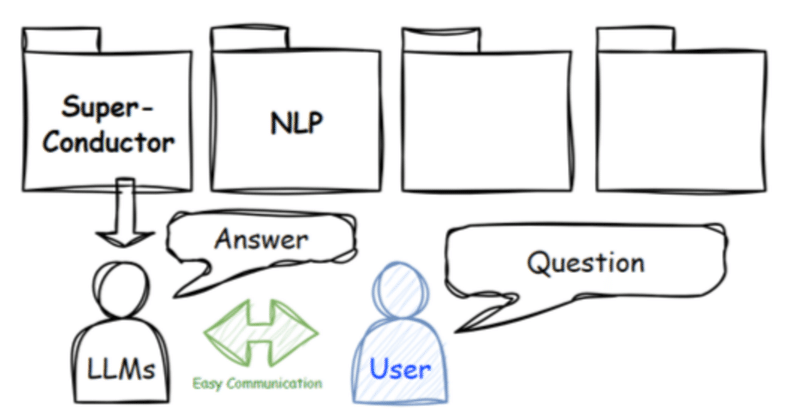

[活用例]Local-LLM+Topic model+Langchain+ChromaDB

今回は集めた特許データをTopic modelで分類し、分類したtopicごとにChromaDBでデータベースを作成、Langchainを使ってRAGを設定し、Local-LLMに回答してもらうフローを整理しました。

フローは上のイメージ図の通り、下記の手順で進めます。

1. 特許からコンセプトを抽出

2. 抽出したコンセプトを分類

3. トピック毎にデータベースを作成

4. RAGの設定

Starling-RM-7B-alphaとZephyr-7B-betaを簡単に比較

今更ですが、Starling-RM-7B-alphaを試してみました。本モデルの詳細は下記でまとめらています。

ベンチマーク

MT Bench, AlpacaEval, MMLUのいずれでもZephyr-7B-betaを上回ります。私個人としてはAlpacaEvalのscoreが高い方が使い勝手が良いように感じています。

0. 環境

1. arXivから論文取得

"super resol

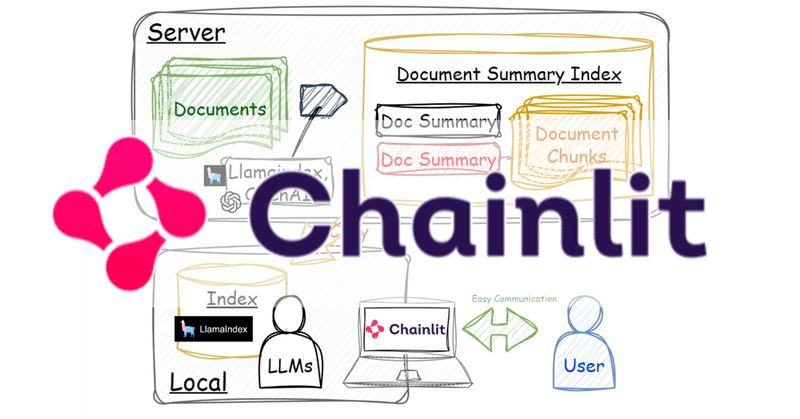

[UI]Chainlitで専門家AIと会話する_Local-LLM+Document Summary Index

LLMのUIにはtext-generation-webuiをはじめ様々なものがありますが、今回はChainlit(GitHub)に下記の記事と同じ方法で作成したindexを使ってLocal-LLMに回答してもらうChat-UIを作成します。

クラウドや高性能PCで作成したindexをそれほど高性能でない別のPC内で活用することができます。ほかのユーザーに使用してもらう際にUIはユーザーの認知容易

Local-LLM+LongLLMLingua, RAG series 3/n

RAGシリーズ3回目。

今回はLlamaindexでLongLLMLinguaを用いたRAGです。

通常のRAGではpromptが長くなりがちで、計算コストが嵩む(ChatGPTなどを使用する場合は費用が嵩む)、性能が低下する(ex.:“Lost in the middle”)、などの課題が生じます。それらの課題を、適切にpromptを圧縮するLLMLinguaとRerankingなどを組み合わ

[雑感]Local-Agentに向けて

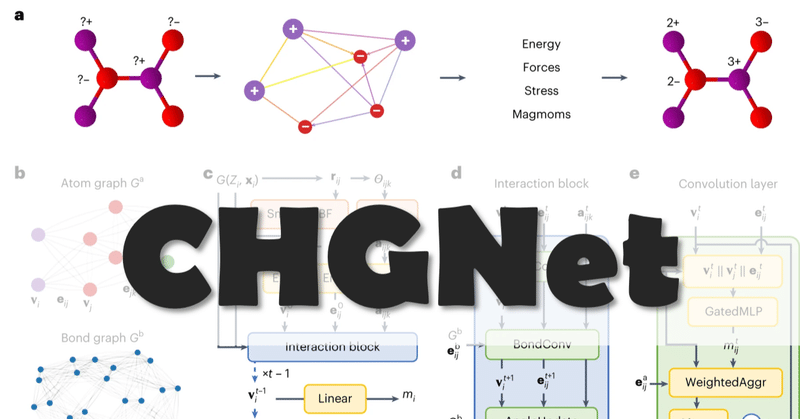

比較的公知になっている知識の代表例が論文と特許です。

この中でも特にtext情報の処理については依然から活発に取組まれてきたものの(tfidf~bert)、今年のLLMの登場・普及によって、その活用が飛躍的に進んだことは周知のことと思います。

特に論文や特許などの自然言語の処理で課題になっていたことの一つに「構造化」があると思います。この構造化に対し、LLMは有効です。目的を聞けば目的を答え、

Local PCに専門家を作る_Local-LLM+Document Summary Index

下記の通常のRAGに対し、LlamaindexのDocument Summary Indexを用いた事例です。

検索に要約文を用い、検索速度をあげつつ、要約文に質問例を追加することでembeddingでの検索の精度をあげることができます。

今回も前回同様に、専門知識が論文や特許になっているような、所謂「研究者」のような専門家チャットAIの実装を試みます。

0. 環境

1. 知識の収集・格納

いつでも手軽に呼び出せる専門家_Local-LLM+RAG活用事例

下記で紹介したLlamaindexのRecursive Retriever + Node Referencesを用いたRAG活用事例です。

専門知識を気軽に活用したくても、大抵、専門知識を持った人材(以下、専門家)は高価で気軽に使えず、課題も多いと思います。

具体的には下記などがあります。

希少で活用頻度が低い

高価で予算が必要

レスポンスが悪い(コミュニケーションに時間を要す)

コミュ