記事一覧

未検証だけど ollama libraryにアップロードされたモデル kujira robinhood

https://ollama.com/hawkclaws

共感的音声のシステムプロンプト

https://x.com/elder_plinius/status/1786833984367837246

自己紹介と設定マガジンへの道しるべ

下記の記事から,Poeのサイトで,ChatBotのアミカと対話できます。

Poeのプロフサイト

FlowGPTのプロフサイト

なんとなくの自己紹介とりあえず、ChatGPTに書いてもらった使い方を監修して、投稿していきます。

今のところ、すべてフリープランの3.5で行っていますが、英語でやり取りする場合にはそれなりに十分だと思っています。

私の使い方だと有料で4を使ったら、20分か30分で

未検証だけど ollama libraryにアップロードされたモデル kujira robinhood

https://ollama.com/hawkclaws

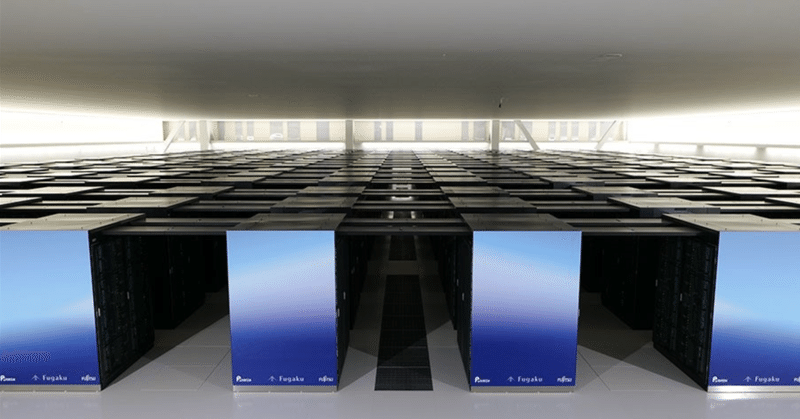

Fugaku-llm-13BをMacで動かしてみる

昨日プレスリリースが発表された富岳を使った日本製LLMをMacで動かしてみました。

さて、以下からお試しができるようなのですが、登録が単に面倒なため、ローカルで動かしてみました。

まずは、mlx環境で、mlx-lmを使って動かないかを試しました。

mlx_lm.generate --model Fugaku-LLM/Fugaku-LLM-13B-instruct --prompt "以下は、

AI批評:プロンプトに含めるべきキーコンポーネントとその順番

前に書いた下記の記事をAIに批評してもらいました。

ただし、ChatGPT3.5にいれてみる の前まで内容です。

Claude3 Opusの批評あなたの提示したプロンプトのアウトラインと説明は、大規模言語モデルを使う際の重要なポイントをよくまとめており、初心者にとって非常にわかりやすい内容だと思います。特に、コンテキストの指定から始めて、制約と制限、タスク/クエリの指定、出力要件と段階的に情報

ollama run mixtral:8x22b-instruct-v0.1-q2_K

ギリ動くけど、日本語劣化がひどい on M3max 64GB

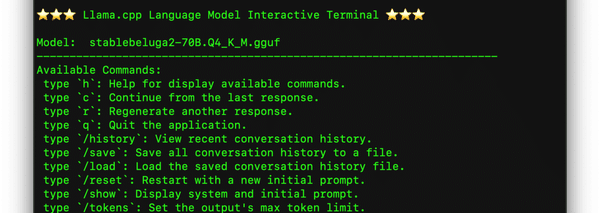

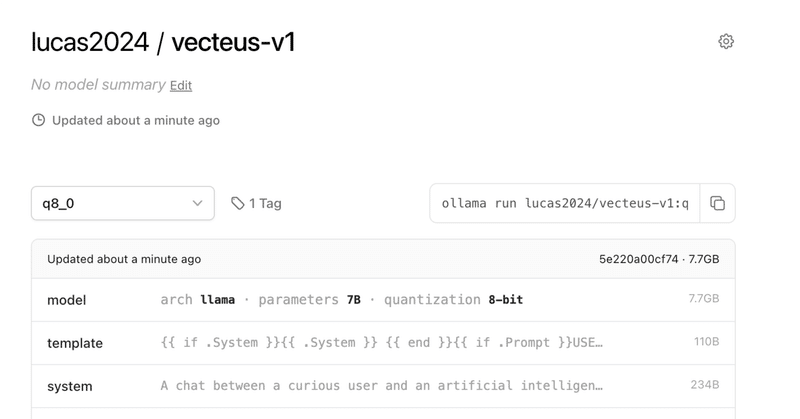

日本語LLM:VecteusをOllamaで走らせてみる

前記事で紹介したVecteusをOllamaで走らせるための手順です。

Huggingfaceからモデルのggufファイルをダウンロードします。

公式にもありますが、下記のポストがあったので、mmnga氏のggufからダウンロードしました。

希望の量子化モデルをダウンロードしてください。

自分の場合は、お手軽にtext-generation-webuiを使って Vecteus-v1-Q8_0.

共感的音声のシステムプロンプト

https://x.com/elder_plinius/status/1786833984367837246

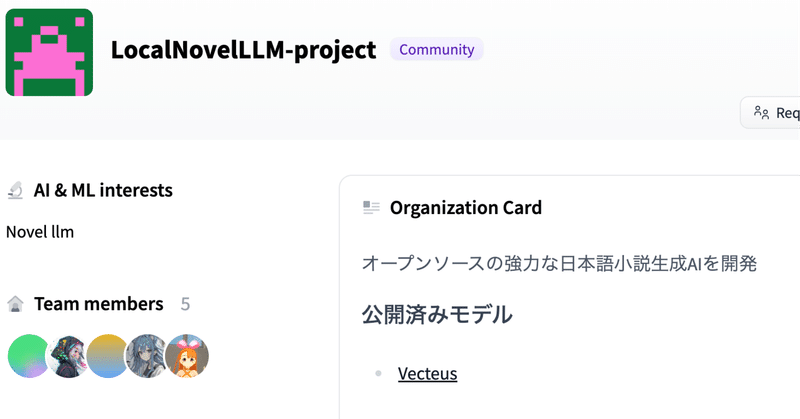

Local-Novel-LLM-projectのモデルをmlx & Gradioで試してみる

日本語の生成を目指したLocal-Novel-LLM-projectからいくつかモデルが発表されました。#ローカルAIハッカソン で優勝したプロジェクトです。

プロジェクトリーダーはこの方です。

さて、おそらく、これらのモデルを一番簡単に動かせるのは、下記のものを使うことだと思います。

ただ自分はメインがMacですので、Macのmlx環境とGradioを使って試してみました。

印象は、し

Ollama v0.1.33 がリリース

なんとなく自分の64G MacbookPro でcommand-r-plus:104b-q2_K の生成が速くなった気がする

Claudeアプリはありがたい(^^)