フェイクニュースとAI

最近は、新型コロナやロシア・ウクライナ戦争の関係で、誤った情報や疑わしい情報が頻繁に飛び交うようになり、何が正しい情報なのかを見極めることが難しくなってきました。

こうした中で、注目されているのが「フェイクニュース」です。

「フェイクニュース」とは、主にウェブサイトやSNSで発信、拡散された真実でない情報のことです。

フェイクニュースは、インターネット普及前から報道機関による虚偽報道などとして存在していましたが、インターネットの普及後は、アフィリエイト(成功報酬型広告)による収益目的や注目を浴びるためのいたずら目的の個人が発信するものが台頭してきました。

しかし、特にフェイクニュースが重要な問題として捉えられるようになった切っ掛けは、2016年のイギリスとアメリカで起きた2つの事件でした。

1.フェイクニュースが原因とされている事件

(1) イギリスの事例

一つは、イギリスのEUからの離脱、すなわちブレグジットの是非を問う2016年6月に実施された国民投票において、離脱派からフェイクニュースが発信、拡散され、国民投票の結果に影響を与えたと言われている事件です。

離脱派のイギリス独立党党首のファラージ氏は、「イギリスのEUへの拠出金が週3億5,000万ポンドに達する。」と主張し、その情報がSNSで拡散された結果、国民投票での離脱派の勝利に大きな影響を与えたと言われています。

しかし、投票後に、実際の拠出金が半分以下に過ぎないことを同氏も認め、投票を有利に進めるためのフェイクニュースだったのではないかと問題になりました。

また、イギリス統計局が「この情報は事実と異なる」と指摘していたにもかかわらず、この情報を聞いたイギリス国民の42%が真実と思い込んでいたという調査結果もあります。

さらに、ロシアが関与したTwitterのフェイクアカウント(実在する他人や実在しない人物に成りすましたアカウント)が残留派を揶揄するツイートを拡散して、国民投票で離脱派が有利になるように政治介入していたという疑惑も持ち上がり、イギリス議会などが調査しています。

(2) アメリカの事例

もう一つは、2016年11月に実施されたアメリカ大統領選挙の際、ヒラリー・クリントン候補の評価を貶める目的で、トランプ陣営や外国からフェイクニュースが発信、拡散され、選挙の結果に影響を与えたと言われている事件です。

Facebookでシェアされたフェイクニュースで最も多かったのが、「ローマ法王がトランプ支持を表明した。」というもので、選挙結果に多大な影響をもたらしたと言われています。

また、2番目に多かったのが「クリントン氏が過激派組織のイスラム国に武器を売った。」というフェイクニュースで、これも選挙結果に少なからず影響を与えたと言われています。

さらに、2016年11月には、「ワシントンD.C.にあるコメット・ピンポンというピザ店がクリントン氏の関与する人身売買や児童買春の拠点となっている。」というSNSのフェイクニュースを信じた男が同店にライフルを持って押し入り、発砲するという「ピザゲート事件」が起こりました。

このようなフェイクニュースが拡散した結果、アメリカ大統領選の最終3か月間に、主要ニュースサイトの選挙ニュースよりもフェイクニュースの方がFacebookで多くのエンゲージメント(シェア、「いいね!」などのリアクション及びコメントの合計数)を獲得していたことが明らかになりました。

また、2016年のアメリカ大統領選挙期間中に、東欧の北マケドニア共和国の人口5万人足らずのヴェレスという町で、140以上のアメリカ政治関連サイトが広告収入を稼ぐ目的で立ち上げられ、大統領選挙に関するフェイクニュースが数多く発信、拡散されていたことが判明しています。

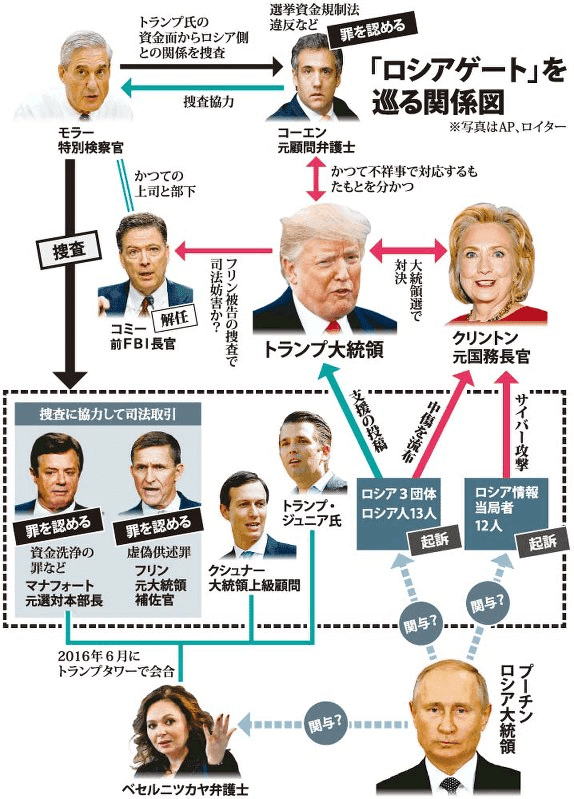

① ロシアゲート

サイバー攻撃による民主党の情報システムへの侵入及びクリントン陣営に不利な電子メールの大量流出、TwitterやFacebookのなりすましアカウントによる世論工作などにロシア政府が関わっていたという疑惑があり、「ロシアゲート」と呼ばれています。

さらに、2020年11月のアメリカ大統領選挙においても、ロシア及びイランによるフェイクニュースなどを利用した選挙干渉があったとアメリカ国家情報会議が報告しています。

② インターネット・リサーチ・エージェンシー(IRA)

2018年2月、アメリカ大陪審は、インターネット・リサーチ・エージェンシー(IRA)などロシア企業3社と13人のロシア人を、2016年のアメリカ大統領選挙に不当に介入した罪で起訴しました。

IRAは、「オリギノのトロール(荒らし)工場)」としても知られるロシアのサンクトペテルブルクに拠点を置く会社で、同社と一緒に起訴された、プーチン大統領に近いロシアの実業家のエフゲニー・プリゴジン氏が出資しています。

IRAは、実在のアメリカ市民の社会保障番号などの個人情報を盗んで、FacebookやTwitterでアメリカ人になりすましたフェイクアカウントを作成し、それらのアカウントからフェイクニュースを発信、拡散して、大統領選挙でトランプ候補を後押しするような政治介入を行ったと見られています。

また、アメリカ連邦議会の調査により、IRAがFacebookに3,000件以上の政治広告を出していたこと、Facebookに約8万件の投稿を行い、約1億2,600万人(アメリカ人口の約4割)のユーザーに拡散された可能性があること、Twitterのボット(自動投稿アカウント)により約140万件のツイートが行われ、約2億8,800万回閲覧されたことなどが判明しています。

IRAの関係者が直接操作していたと見られるTwitterアカウントも2,752件あり、その中には、フォロワーが数万人もいる相当有名なアカウントも複数含まれていたため、驚きをもって受け止められました。

③ ケンブリッジ・アナリティカ事件

ケンブリッジ・アナリティカは、ロンドンに本社を置く選挙コンサルティング会社で、SNSの行動履歴などを基に、対象となる個人に関する情報を詳細に分析することによって、有権者への効果的なアプローチを可能とするマイクロターゲティングを得意としていました。

そして、2016年のブレグジットの是非を問う国民投票やアメリカ大統領選挙において、いずれも勝者側がケンブリッジ・アナリティカを利用していたことから注目を浴びることになりました。

特に、アメリカ大統領選挙の関係では、トランプ陣営の選挙対策本部長であるスティーブン・バノン氏が同社の共同出資者であり、同社のマイクロターゲティング機能を利用して、クリントン陣営切り崩しのためのターゲティング広告を行っていたとされています。

また、同社がFacebookのAPIを利用して5,000万人超のユーザー情報を不正に取得していた疑惑が持ち上がり、2018年5月に同社は破産して業務を停止しました。

この事件は、SNSを通じた個人データ収集によるプライバシー侵害の問題と、その個人データを利用して、選挙における国民の意思が歪められる危険性を明らかにしました。

(3) 日本の事例

① 熊本地震でのデマ情報

日本でも、2016年4月の熊本地震の発生直後に、動物園のライオンが脱走したというフェイクニュースがTwitterで拡散され、いたずらで投稿したという男性が偽計業務妨害容疑で逮捕される事件が起きました。

② Dappi事件

また、2019年から2021年にかけて、与党に批判的なマスメディアや野党議員の批判をネット上で行っていたTwitterアカウントのDappiを自由民主党の関係組織が支援していたのではないかとの疑惑が持ち上がり、国会質問でも取り上げられました。

Dappiのアカウント(@dappi2019)は、2019年6月に開設され、17万人以上のフォロワーがいました。

また、2020年10月に、Dappiは森友学園問題に関連して、「近畿財務局の職員は立憲民主党の小西議員らが1時間吊るし上げた翌日に自殺した」旨の投稿を行い、小西議員らに虚偽に基づく誹謗中傷だとして名誉棄損で訴えられ、現在も裁判は継続中です。

③ 選挙におけるネット工作

また、選挙買収事件で有罪判決を受けた河井議員夫妻が選挙で勝つために、対立候補のネガティブな情報をネットで流したり、自身に対する批判的な書込みを検索しづらくしたりするネット工作を業者に依頼していたという疑惑も持ち上がっています。

日本では、まだ欧米ほど大きな問題にはなっていませんが、今後、フェイクニュースが国の政策や方針に大きな影響を与える事態も予想されるため、今からフェイクニュースに対する対策をしっかりと検討しておくべきでしょう。

(4) 新型コロナとフェイクニュース

未知の感染症である新型コロナウイルス感染症の大流行は、人々の不安や恐怖をあおり、多くの誤情報やフェイクニュースが拡散される温床となりました。

日本でも、「新型コロナウイルスは熱に弱く、お湯を飲むと予防に効果がある。」「新型コロナウイルスは、中国の研究所で作成された生物兵器である。」「新型コロナウイルスは5Gテクノロジーによって活性化される。」などの様々なフェイクニュースがSNSなどを通じて拡散されました。

2020年2月には、「トイレットペーパーは中国産が多いため、新型コロナの影響でトイレットペーパーが不足する。」というフェイクニュースが出回り、実際にスーパーでトイレットペーパーの在庫が無くなるなどの混乱が2か月ほど続きました。

なお、実際には、国内で流通するトイレットペーパーの97%が国産です。

また、アメリカでは、「Microsoft創業者のビル・ゲイツ氏が新型コロナワクチンを利用して人々にマイクロチップを埋め込み、その動きを監視しようとしている。」などの陰謀論が、「Qアノン」と呼ばれるトランプ前大統領支持の陰謀論グループや、反ワクチンのグループなどを中心に拡散され、大きな社会問題となっています。

SNSなどを通じて、大量の不確かな情報が氾濫し、社会に混乱を巻き起こす現象のことを「インフォデミック」と言い、WHOも2020年2月に、インフォデミックの危険性について警告を発しました。

かつて、アメリカの心理学者のオルポートとポストマンは、「重要な問題であって、なおかつ状況が曖昧であればあるほど、デマが拡散される量が増える。」という法則を明らかにしました。

このように、フェイクニュースは、新型コロナ禍のような人々が強い恐怖心や先の見えない不安に囚われている状況で生まれやすく、人々はそれを信じ、伝え合うことで、恐怖や不安を緩和し、あるいは正当化しようとします。

さらに、SNSの普及によって、誰でも簡単に自分の意見を発信することができるようになり、フェイクニュースの拡散を加速する状況が生まれています。

2.フェイクニュースとAI

AIを活用すれば、自動的に大量のフェイクニュースを作り出すことができるようになります。

従来のAIでは、人間が騙されるような自然なフェイクニュースを作り出すことは困難でしたが、最近のディープラーニング技術の発展により、本物と区別することが難しい自然なフェイクニュースを作成できるようになってきました。

(1) AIによるフェイクニュース作成

イーロン・マスク氏らが創設した非営利のAI研究機関のOpenAIが2019年2月に、文章生成AIモデルのGPT-2を発表しました。

GPT-2は、個人が過去に書いた文章を学習して、その個人が書きそうな文章を自動作成するAIモデルであり、人が容易に判別できないほど自然な文章を作成することができます。

OpenAIは、GPT-2がフェイクニュース作成に悪用される危険性を考慮して、発表当時、一度には公開せず、段階的に公開していくという対応が取られました。

GPTの最新バージョンの文章生成AIモデルであるGPT-3が2020年5月に発表され、APIも限定的に公開されました。

GPT-3は、一部の文章や見出しを入力すれば、それに続く文章を自動生成するなどの高度な自然言語処理が可能であり、GPT-2よりも更に人間が書いた文章との判別が難しい自然な文章を作成することができます。

2020年7月には、カリフォルニア大学バークレー校の学生がGPT-3で自動生成したブログ記事を公開して、アグリゲーションサイト(外部のサイトからテーマに沿った情報を収集し、まとめて提供するWebサイト)の「ハッカーニュース」のランキングで1位になり、GPT-3で自動生成されたコンテンツを人間が書いたものだと信じ込ませることが可能だと実証しました。

また、メリーランド大学の研究チームは、GPT-3で自動生成したサイバーセキュリティの脅威に関するフェイクレポートをサイバーセキュリティの専門家などに判定してもらったところ、280件のフェイクレポートのうち220件(全体の78.5%)が誤って本物と判定されたと報告しています。

ジョージタウン大学の研究チームは、十分な資金力があれば、GPT-3のようなシステムによってフェイクニュースの生成を自動化して、適度なクオリティのフェイクニュースを極めて大規模に作り出すことができ、国家レベルで敵対的に使用することも可能だと指摘しています。

GPT-3のようなAIの自動生成した文章は、現時点ではまだ、長い文章になると不自然な点が残っていますが、SNSに掲載されるような短文の場合は、本物と区別することは困難です。

AIの強みは、テーマに沿った文章を自動で大量に作成できることであり、AIによって作成されたフェイクニュースが大量にSNSで拡散されれば、国民の政治的な意見に影響を与え、民主主義の根幹である選挙の結果に影響を与えることにもなりかねません。

日本においても、早急に対応することが必要になるでしょう。

(2) ディープフェイク

ディープフェイクとは、ディープラーニングとフェイクを組み合わせた造語で、AIを用いて実在しないリアルな人物の画像や動画を合成する技術を指します。

特に、GAN(敵対的生成ネットワーク)と呼ばれる機械学習技術を使用して、元となる画像や動画に、異なる人物の画像や動画を重ね合わせることで、実際には存在しない画像や動画を生成できます。

この技術によって、偽の映像で、実際にはやっていない行為をやっているように見せかけたり、実際とは異なる言葉やジェスチャーに変更したりすることが可能となり、フェイクニュースや悪意のあるでっち上げに利用される危険性があります。

ディープフェイクは、2017年の秋頃、deepfakesというハンドルネームの匿名ユーザーが投稿サイトのRedditに、GANを利用してポルノスターの顔と有名人の顔を入れ替えたポルノ動画を投稿したことにより話題になりました。

その後、この動画を作成した機械学習アルゴリズムがGitHubで公開され、ある程度の技術がある人であれば、誰でもかなりの質のフェイク動画を作成できるようになりました。

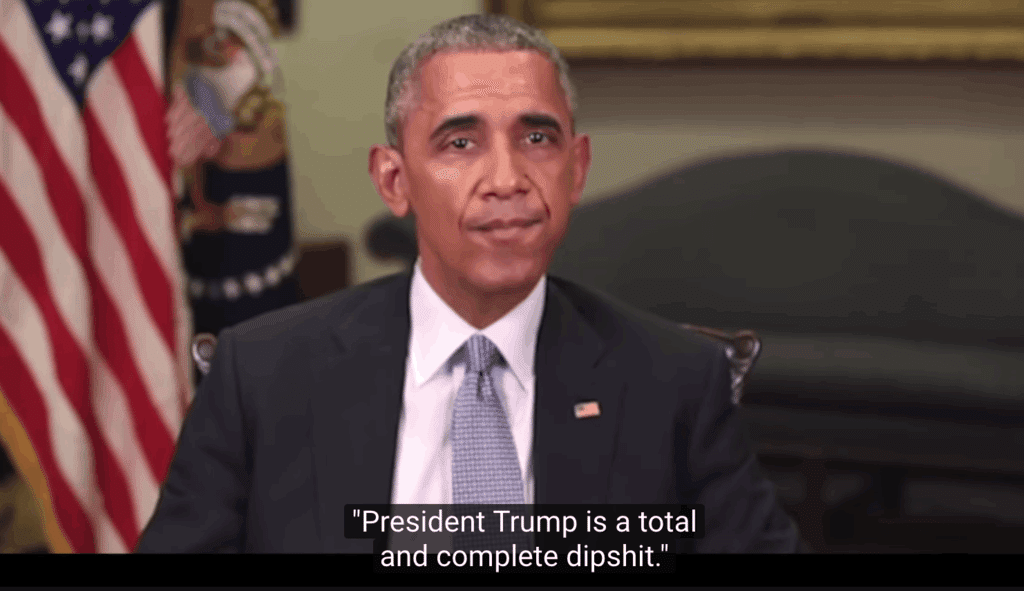

2018年4月には、オバマ元大統領が「トランプは救いようのないマヌケだ。」などと過激な発言を連発するビデオを、米ネットメディアのBuzzFeedがYouTubeに投稿し、世界中の注目を集めました。

これは、映画監督のジョーダン・ビール氏がディープフェイクにより作成したビデオで、ビデオの後半には監督本人が登場し、オバマ元大統領の映像が彼の声真似や表情に合わせて加工されていたことが明かされます。

このフェイクビデオは、ビール氏がディープフェイクの危険性を知らせる公共広告として作成したものですが、フェイク動画であると分かった上で映像を見ても、本人が話しているようにしか見えないほど精巧に合成されています。

また、最近も、ディープフェイク技術を用いて作成されたウクライナのゼレンスキー大統領が国民に降伏を呼びかける偽動画がSNSで拡散され、Facebookを運営するMeta社が削除するという事件が発生しました。

日本では、2020年10月に、自らの有料サイトや海外サイトにディープフェイクによって加工したポルノ動画をアップロードしていた大学生とシステムエンジニアの2人が名誉棄損や著作権法違反の疑いで逮捕されています。

また、2021年2月には、加藤官房長官(当時)が地震に関する記者会見で笑みを浮かべる画像がTwitterで拡散されて、批判の声が相次ぎましたが、後にこの画像がAIによって加工されたディープフェイク画像であることが判明しました。

3.フェイクニュースへの対策

フェイクニュースは、人々が安心・信頼してインターネットサービスを利用することを阻害するだけでなく、有権者の政治的な意見に影響を与え、民主主義の根幹である選挙結果にも影響を与えるおそれがあります。

このことから、諸外国では、フェイクニュースに対する対策が進められています。

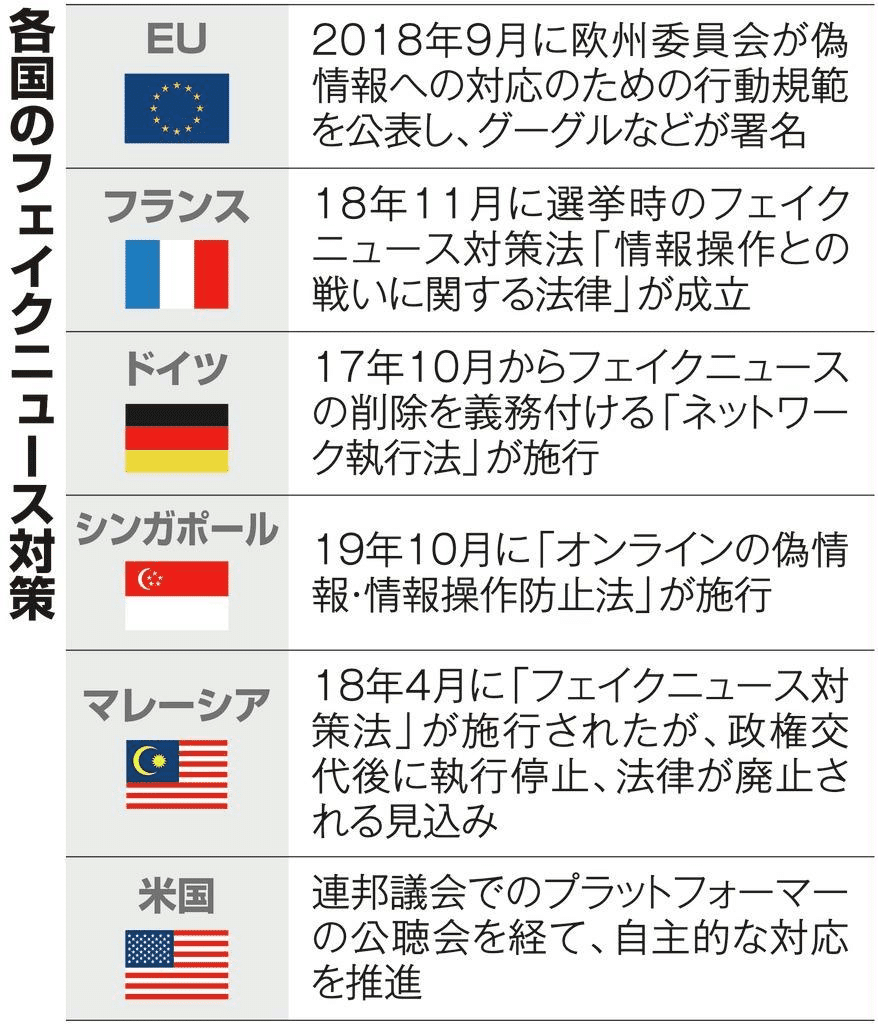

(1) 諸外国の例

アメリカでは、2016年の大統領選挙におけるフェイクニュース問題を契機として、連邦議会で、プラットフォーム事業者(Google、Facebook、Twitterなど)のフェイクニュース対策への取組に対する公聴会が行われ、こうした政府の動きを踏まえて、プラットフォーム事業者による取組が進められています。

EUでも、プラットフォーム事業者に対して行動規範への署名を求め、行動規範に基づく自主的取組を推進しています。

また、各事業者による取組の効果が不十分な場合には、規制措置を講じる可能性もあると示唆しています。

フランスやドイツでは、選挙などに関する偽情報を削除できるような法律を制定していますが、表現の自由や報道の自由を侵害するとの懸念があり、短時間で削除すべきかどうかを判断することの難しさなども指摘されています。

また、マレーシアでは、2018年にフェイクニュース対策法が制定されましたが、政府による恣意的な運用が懸念されて、政権交代後に廃止されました。

(2) 日本のフェイクニュース対策

日本のフェイクニュース対策としては、総務省が「プラットフォームサービスに関する研究会」の中で検討し、2020年2月に最終報告書を公表しています。

フェイクニュース対策としては、法律を制定して、問題となるフェイクニュースを削除できるようにする方法と、プラットフォーム事業者による自主的なフェイクニュース対策を推進する方法がありますが、法律で削除できるようにする場合には、表現の自由などを侵害するとの懸念とともに、短時間で削除すべきかどうかを判断することの難しさなどが指摘されています。

したがって、現在の日本での検討では、プラットフォーム事業者による自主的な取組を進める方針が主流ですが、その実効性や適切さを確保するためには、事業者に対して透明性や説明責任を求めていく必要があります。

また、プラットフォーム事業者を通じた取組以外に、中立公正なファクトチェック機関による情報の真偽の検証(ファクトチェック活動)の推進、人々がフェイクニュースや偽情報に簡単に騙されないようにするICTリテラシーの向上に向けた取組、AI等を活用して、流通する大量の情報の中からフェイクニュースを見つけ出す技術の開発などが必要とされています。

(3) ディープフェイク対策

ディープフェイク対策としては、ディープフェイクで作成された写真や動画を検出するツールなどが開発されています。

Microsoftは2020年9月に、写真や動画の改竄を検知し、本物である可能性をパーセンテージなどで表示することができる「Microsoft Video Authenticator」というツールを発表しました。

Microsoft Video Authenticatorは、顔の上に枠と「信頼スコア」を表示し、この枠が緑色の場合はディープフェイクが使用されていない確率が高く、赤色の場合はディープフェイクが使用されている確率が高いことを意味しています。

枠が赤色の場合はディープフェイクが使用されている確率が高いことを意味しています。

また、2019年12月から2020年5月まで、Facebook、Microsoftや複数の大学などによって、ディープフェイク動画と本物の動画を識別するコンテスト「Deepfake Detection Challenge」が開催されました。

結果は、事前公開動画の識別精度は最高で82.56%、事前に公開していなかった動画の識別精度は最高で65.18%であり、既知のデータの学習で新たな動画の識別に対応することの難しさも明らかになりました。

日本でも、フェイクニュースやフェイク動画などによる高度な攻撃を検出・防御する技術の開発を目的として、JSTのCRESTプログラムの中で、東京大学の越前教授を研究代表者とする「インフォデミックを克服するソーシャル情報基盤技術」の研究開発などが行われています。

4.今後の課題

フェイクニュースはどんどん巧妙化し、また大規模化しており、民主主義の根幹である選挙にも影響を与えるなど、その危険性は高まる一方です。

一方で、強権的なフェイクニュース対策は、表現の自由などを侵害する可能性もあるため、慎重な対応が必要です。

フェイクニュース対策を検討する上での課題としては、フェイクニュースの判定主体、判定基準、大量のコンテンツへの対応などの問題があります。

(1) 判定主体

フェイクニュース対策を行う上で、誰がフェイクニュースを判定するのか、誰に削除権限を与えるのかが重要な問題です。

政府がフェイクニュースを判定する場合、権力者に都合の悪い情報がフェイクニュースと判定されるなど、権力の濫用に繋がり、表現の自由や報道の自由が侵害される恐れがあります。

また、プラットフォーム事業者の自主的な対策に任せる場合でも、その事業者がフェイクニュースを適切に判断できるか、スポンサーや出資者、広告主などの意向に判断が影響されるのではないかという問題があります。

したがって、政府やプラットフォーム事業者から独立した中立公正なファクトチェック機関によるフェイクニュースの判定という方法が有望視されています。

FacebookやGoogle等のプラットフォーム事業者は、既に各国のファクトチェック機関と連携して、コンテンツを評価する取組を始めており、日本でも、2017年6月に、ファクトチェック活動を推進する団体であるファクトチェック・イニシアティブ(FIJ)が設立されるなど、徐々に取組が進められています。

今後の課題としては、ファクトチェック機関の信頼性をどう担保するのか、活動コストを誰が負担するのかといった問題があります。

(2) 判定基準

どこまでをフェイクニュースと認めるのかというのも難しい問題です。

フェイクニュースには、意図的に人々を欺く目的で拡散された「偽情報」と単に事実と異なる「誤情報」がありますが、誤った情報を含むコンテンツをすべて規制するのは、表現の自由との関係で問題があります。

他方、意図的な偽情報のみを規制しようとしても、誤りが意図的なものかどうかを他者が判定することは容易ではありません。

また、名誉棄損や詐欺、偽計業務妨害のような違法な偽情報だけを規制するのでは、米大統領選挙における「ローマ法王がトランプ支持を表明した。」というような、候補者の一方を有利にするようなフェイクニュースを取り締まることはできません。

事実かどうかを判断するのが難しいケースも多いです。

例えば、「コロナワクチンの中に人を操作する5Gのチップが埋め込まれている。」というような情報であれば、科学的にあり得ないのでフェイクニュースだと判定できますが、「コロナワクチンは、数年後に重大な副反応を起こす可能性がある。」というような情報は、容易に検証することができず、判定することが困難です。

根拠が十分でない情報をすべてフェイクニュースとするのかどうかも判断が分かれるところです。

適切な対策を取るためには、判定する人によって判断がばらばらにならないように、専門家や関係者の間でよく議論して、規制すべきフェイクニュース判定の目安となる基準を作成することが必要でしょう。

(3) 大量のコンテンツへの対応

現在、インターネットのウェブサイトやSNSには、膨大なコンテンツがあふれており、その中からフェイクニュースを見つけ出すことは容易ではありません。

GPT-3のようなAI技術によって大量のフェイクニュースが生成、拡散されるようになれば、フェイクニュースに対応することはさらに難しくなります。

このような状況に対応するため、AIを活用して、大量のコンテンツからフェイクニュースを見つけ出して判定するような技術の開発が進められています。

例えば、アメリカのミシガン大学の研究者は、フェイクニュース記事を識別するアルゴリズムベースの検出システムを開発しました。

このシステムは、人間によるフェイクニュース記事の判別成功率が70%であったのに対し、最大76%の成功率でフェイクニュース記事を検出しました。

最終的なフェイクニュースの判定には、未だ人手が必要だとしても、大量のコンテンツの中からフェイクニュースの疑いがある情報をスクリーニングするのには、このような技術が有効です。

将来的には、フェイクニュースを生成、拡散するのにも、そのフェイクニュースを探し出して削除などの対策を取るのにもAI技術が使われるようになり、ネット上でAI同士の攻防が行われるようになるかもしれません。

5.今後の日本が取るべき対策

以上のような課題を踏まえ、日本では、次のようなフェイクニュース対策を取ることが必要でしょう。

名誉棄損、詐欺、偽計業務妨害などに該当する違法なフェイクニュースの拡散に対しては、警察や政府に通報窓口を設けて、厳しく取り締まる。

選挙に影響を与えようとする意図的なフェイクニュースの拡散に対しては、アカウント削除や通信遮断も含めた規制の強化を検討し、必要があれば、公職選挙法を改正する。

プラットフォーム事業者の業界団体の下に自主規制機関を設置し、フェイクニュースの自主規制の仕組みを整備する。

政府あるいは自主規制機関で、規制すべきフェイクニュースの判断基準を示すガイドラインを作成し、関係事業者にガイドラインの活用を勧める。

中立公正なファクトチェック機関を創設する。

ニュース配信事業者による誤った情報の訂正を促す仕組みを整備する。

人々が容易にフェイクニュースに騙されないようにするために、ICTリテラシーを向上させるための教育や周知活動を推進する。

AIを活用して、大量のコンテンツの中からフェイクニュースを検出する技術の開発を進める。

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?