Midjourney を無料で?!しかもControlNetも使える!?構図指定×高品質画像生成!

はじめに

どうも皆さん!朝食はパン派の女、葉加瀬あいです!

今回は、無料でMidjourneyの画像生成ができる方法をご紹介しちゃいます!

しかも、なんとControlNetも使えちゃうんです!構図指定と高品質画像生成が両立できるなんて、すごくないですか?

🔥動画版🔥はこちらから!

Midjourneyって、本当に素晴らしい高品質な画像が生成できて、しかもアーティスティックな雰囲気がたまらないですよね!

— ハカセ アイ🎈 “Note + Youtube” で最新AI技術を解説しています・:*:・。 (@ai_hakase_) September 3, 2024

Midjourneyの魅力と課題

でも、残念ながら欠点もあるんです。

例えば、文字の設定が苦手だったり、

手の描画がまだまだ不完全だったり…。高品質な画像生成の裏側で、まだまだ改善の余地がある印象です。

そして、何と言ってもControlNetのような構図指定ができないというのは、ユーザーにとって大きな負担になっていますよね。

「数打てば当たる」的なアプローチになってしまって、効率が悪いんです。ミュージックビデオを作りたい方なんかは、Midjourneyでランダム性の高い画像生成を行ったり、プロンプトを工夫するのに疲れ果てていたりするんじゃないでしょうか?

そこで今回は、そんなMidjourneyの画像を無料で作れて、しかも手の描画や文字の描画の問題も解決できる方法をご紹介します!

さらに、構図の指定も可能になるので、皆さんはMidjourneyの画像生成の魅力をそのまま活かしつつ、無料で思い通りの画像を生成できるようになるんです!

この画期的な方法について、詳しく解説していきますので、ぜひ最後までご覧ください!

それでは、さっそく始めましょう!

2. Fluxとは:Midjourneyスタイルを再現する新技術

それで、前回の記事では、なんとたった20分でLoRAの学習ができる方法をご紹介しましたね。これ、本当にすごくないですか?!

従来のStable Diffusion 1.5やStable Diffusion XLなどのLoRA学習方法では、20〜30枚程度の画像を学習させるのに5〜6時間もかかっていたんです。でも、今回のFlux(フラックス)では、なんとそれが20分にまで短縮されているんです!しかも、クオリティはとっても高いんですよ!

例えば、こんな感じのオリジナルキャラクターを学習させて、そのキャラクターを一貫して生成できるようになるんです。

すごいですよね!詳しくはこちらの記事から確認してみてくださいね。

そして、これは何を意味するかというと…Face Swap技術を使って画像の顔交換ができれば、アニメキャラクターでもオリジナルキャラクターでも、特定の顔を持つキャラクターを自分で用意して、その顔でLoRAが作れちゃうということなんです!

Face Swapの方法はこちらの記事で詳しく解説していますが、このようにデータセットも自由に準備できて、それをLoRAの学習に使えるのが大きな強みなんです。

先ほど掲載した記事でも解説していますが、私のメンバーシップに登録している方は、こちらの記事で紹介しているLoRAのデータセットの高速準備ワークフローを使えるんです。

つまり、皆さんは好きなだけFlux用のデータセットを20〜30枚ほど準備して、たった20分程度の短時間でオリジナルのLoRAを作ることができるんです!自分だけのオリジナルキャラクターが量産できるなんて、夢みたいじゃないですか?

ただし、注意点もあります!現在のFlux用のLoRAに関しては、Flux dev modelでないと動作しません。つまり、Fluxの他のモデルであるChnnel modelやPro modelでは動作しないんです。さらに、NF4やGGUFモデルなどの、サイズとVRAMの使用量を減らした量子化モデルでも使えません。これは、純粋なFlux dev modelと異なり、トレーニングの方法や画像生成時の計算方法が異なるからなんです。

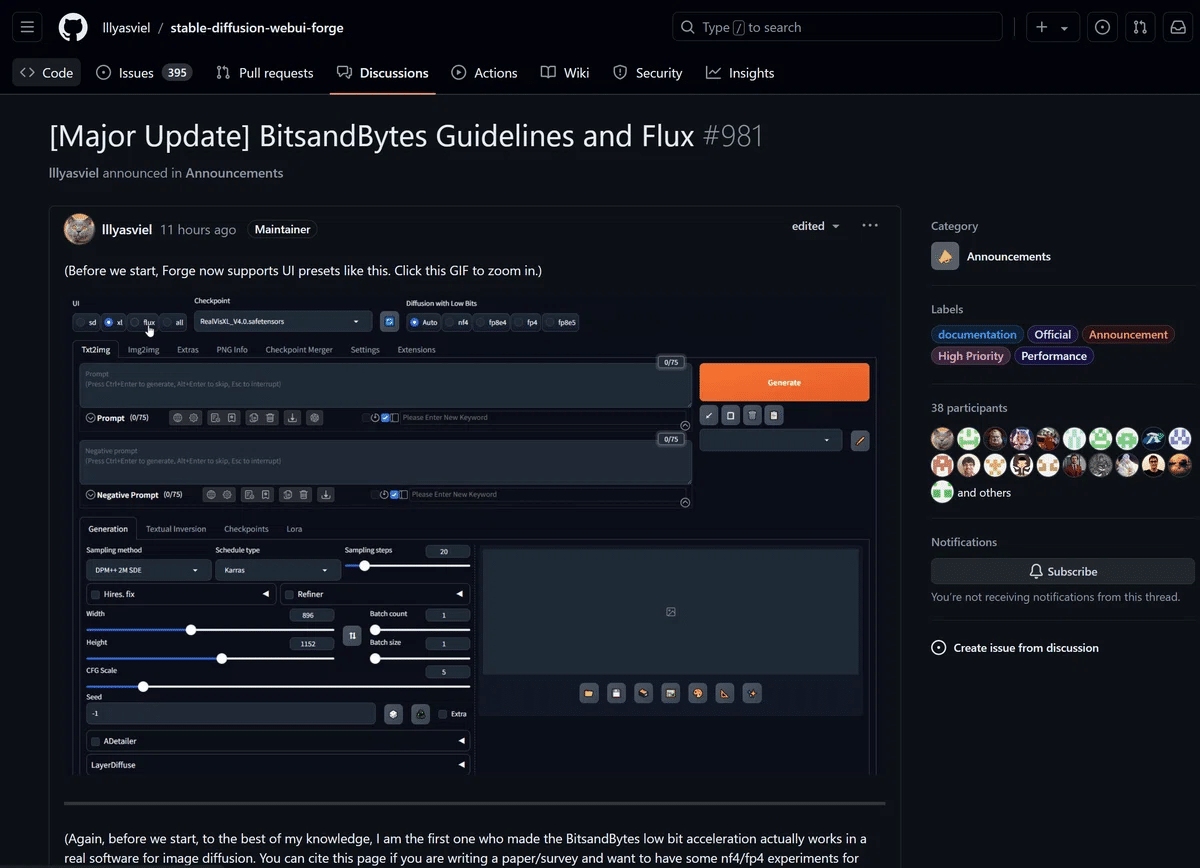

そのため、Flux用のLoRAを使用する場合は、ComfyUIのワークフローを使用するか、

Stable Diffusion Web UI Forgeを使用するかといった方法になります。

ComfyUIの導入方法やStable Diffusion Web UI Forgeの導入方法、その他の最新情報はこちらの記事などでも解説していますので、ぜひチェックしてみてくださいね!

さて、今回は何を解説したいかというと…前回は自分の好きなキャラクターのLoRAを解説したので、今回はスタイル変換に関するLoRAについて詳しく見ていきたいと思います!

スタイル変換って何かというと、例えばアニメスタイルに変換したり、油絵のスタイルに変換したりすることなんです。

— ハカセ アイ🎈 “Note + Youtube” で最新AI技術を解説しています・:*:・。 (@ai_hakase_) September 3, 2024

実は、Fluxの特徴として、圧倒的なパラメーター数と潜在空間の広さがあるんです。これが、LoRAの品質を上げてくれたり、スタイル変換のLoRAとの相性も良くしてくれているんですよ。

もう少し詳しく説明すると、Fluxのパラメーター数は120億なんです!これはStable Diffusion XLのパラメーター数(35億)と比較すると、まるまる3倍以上のパラメーター数を持っているということになります。

このパラメーター数の多さは、学習モデルが持つ潜在空間(latent space)の幅が広がることを意味します。潜在空間が広がると、様々なスタイルの画像を生成したり、多様なプロンプトを使った画像生成ができるようになるんです。

例えば、ちびキャラを作ったり、リアルなキャラクターを作ったり、文字を生成したり、足から頭までのフルボディ画像を生成したりなど、Fluxで柔軟にできるのはこのためなんです!

そして、その性能はそのまま使えるLoRAにも、スタイルを学習させる方向のLoRAにも適用できるので、色々な画風を出したり、逆に特定の画風を学習させたりといったことも得意になってくるわけです。

ということで、今回はその性質を利用して、Midjourneyの画像スタイルを学習させて、それを画像生成させるLoRAを使ってMidjourneyの画像を無料で作れるようにする方法を解説していきます!皆さん、楽しみにしていてくださいね!

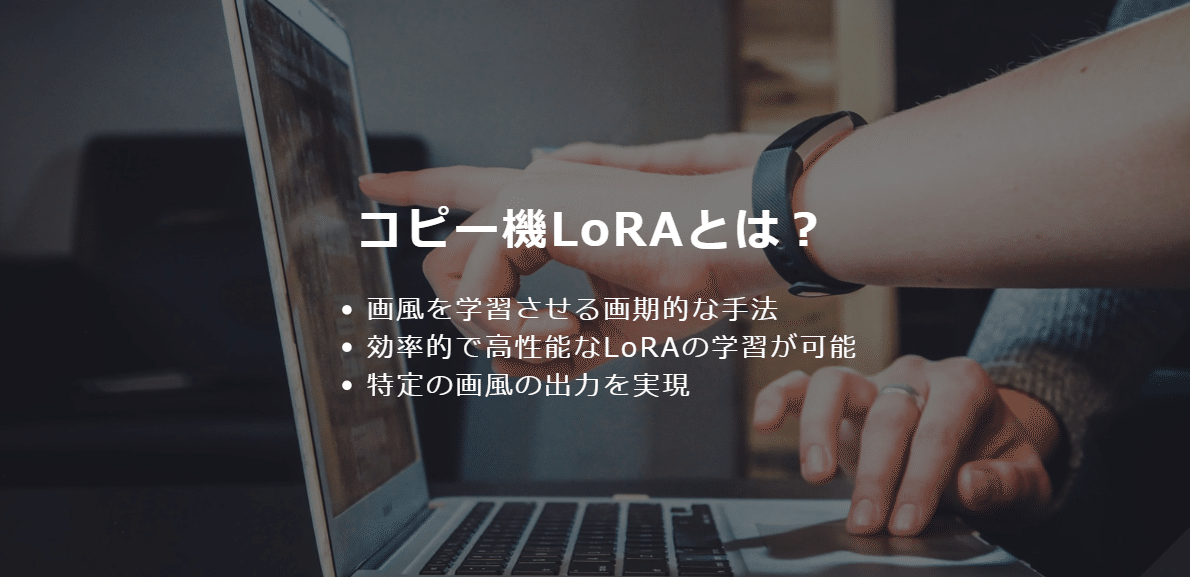

3. コピー機LoRA:効率的な画風学習の新手法

それで、今回は画風を学習させる画期的な手法、「コピー機LoRA」についてもご紹介しちゃいます!これを使うと、なんと効率的で高性能なLoRAの学習ができるんですよ!すごくないですか?

コピー機LoRAって何かというと、元々は雰囲気の異なる2枚の画像を過剰に学習させて、そのLoRAを組み合わせることで、特定の画風の出力を行う手法なんです。従来のLoRA学習では、20〜30枚の画像を30回程度繰り返し学習させるのが一般的でしたが、コピー機LoRAではなんとたった2枚の画像を1000回以上も学習させちゃうんです!

「えっ、それって学習しすぎじゃないの?」って思われるかもしれませんね。実は、この過剰学習がポイントなんです!LoRAを少し「壊した」ような状態にすることで、AIの深層学習の力を借りて、より特定の画風の出力をしやすくするんです。まるで、画風のエッセンスを抽出しているようなものですね!

詳細はこちらからどうぞ!

https://note.com/2vxpswa7/n/n3183ae996a79

そして、この手法とかを用いてFluxでスタイルの学習をさせると…なんと、Midjourneyのようなアーティスティックな画風をFluxで再現できるようになってきたんです!これって、本当にすごいことですよね!

4. Midjourney FLUX LoRA:Midjourneyスタイルの再現

では早速、その方法について詳しく解説していきましょう!まずは、

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?