【今月、新しくやってみたこと】「きのこの山」と「たけのこの里」をAIに学習させてみた

気まぐれで始めた

「毎月の新しいことチャレンジ」

ちょっと遅くなりましたが、

今月(11月)は、「きのこの山」「たけのこの里」の画像を使って、

AIに画像識別させてみました。

(この記事はちょっと長いです&マニアック?な検証が多いです💦)

AIの歴史に軽く言及

AIって実は歴史が古くて、なんと1950年代に始まったのだとか。

でもって、ここ最近のAIブームは主に、

ディープラーニングの登場によるところが大きくて。

かなりざっくり言うと、これまでのAIは、

例えばリンゴの画像を識別するとき、

「色が赤いかどうか?識別して!」

「形が丸いかどうか?識別して!」

これらの特徴を人間が、

予め定義してAIに組み込んでいました

「丸いのを探して」

とAIに指示するとAIが

赤くて丸いものを探し出す!

ところがディープラーニングでは、

画像を何枚かAIにぶち込めば

AIが勝手に学習して特徴を覚えて

自ら学んだ特徴をもとに識別する!

これが画期的!

(自分で学習して特徴を見つけるのが凄い)

「リンゴ」とタグを付けて

AIに学習させる

→AIが自分でリンゴの特徴を見つける

→そして別のリンゴの画像を見せても

→自ら見出した特徴からリンゴと識別

※ディープラーニングは、多層ニューラルネットワークの活用により、2012年に一気にブレイクしました。

ーーーーー

そこで今回は、

「きのこの山」

「たけのこの里」

の画像をAIにぶち込んで学習させ、画像予測させることにチャレンジしてみました。

画像予測に使ったAI

マイクロソフトの『Custom Vision』を使いました。

※『Custom Vision』は、人工知能 やデータ サイエンスのスキルなしでAIを利用できるクラウドベースのサービスです。他にもGoogleの「Cloud AutoML Vision」やAmazon(AWS)の「Amazon Rekognition カスタムラベル」などがあります。

※こちらの記事で『Custom Vision』を使って「きのこの山」と「たけのこの里」の画像予測をしてたのを参考にしました。

先ずはAIに画像をぶち込んで学習させる

今回は、下の5つのチョコの画像をAIに学習させます。

それでは、画像を学習させていきましょう!

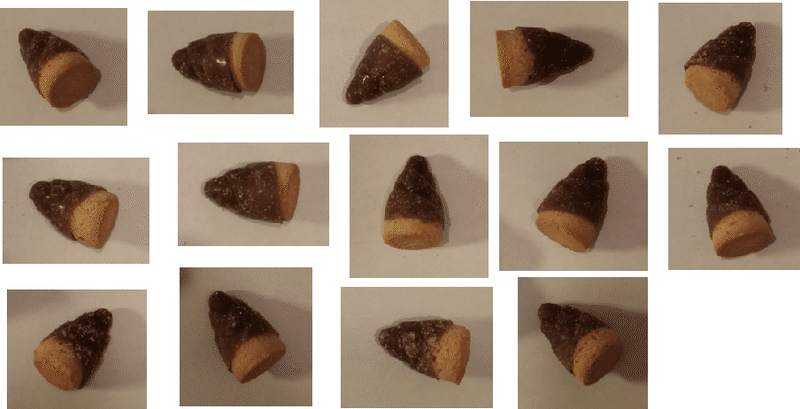

◆きのこの山(13粒)

◆たけのこの里(14粒)

◆CRUNKY(16粒)

◆KitKat(10粒)

◆GABA(食べかけなので6粒)

※この画像を1枚ずつ読み込ませる作業が、地味に面倒くさい。。。

学習結果

Precision(適合率)100%

Recall(再現率) 50%

低くなった

クランキー、キットカット、GABA

この3つの判別は難しいと予測してましたが

(個別の画像では大きさの情報が入らないので)

キットカットの学習結果以外は、いい感じの学習結果でした!

(なせかキットカットは難しかったみたい)

それではいよいよ画像予測!

AIが学習した生成モデルを利用して、色んな画像を予測させてみました。

先ずは、下の写真のような「きのこの山」のノーマルな撮影画像が何の画像なのか?

AIに予測させてみると、

kinoko 99.4%

高確率で「きのこの山」と予測!

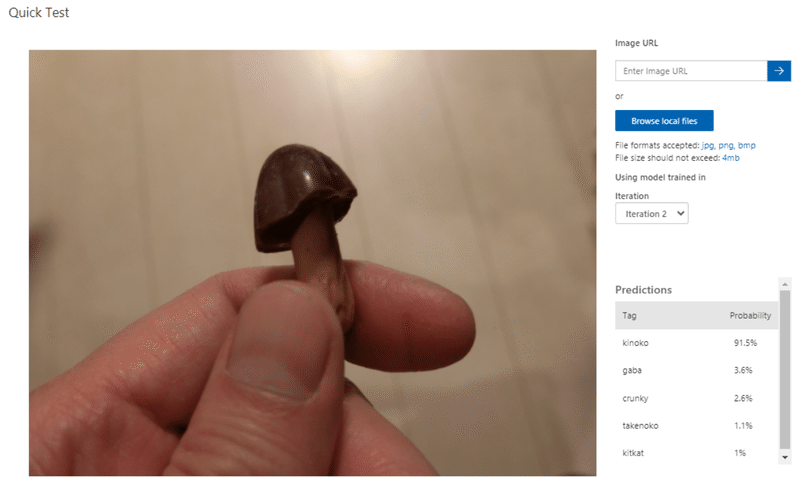

続いて、「きのこの山」を手に持った画像が何の画像なのか?予測させてみると、

kinoko 91.5%

これまた高確率で「きのこの山」と予測!

今度は、ノーマルな「たけのこの里」の画像が、何の画像なのか?予測させてみると、

takenoko 96.7%

高確率で「たけのこの里」と予測!

さらに今度は「たけのこの里」を上からのアングル(このアングルは学習させていない)の画像で、何の画像なのか?AIに予測させてみると、

takenoko 73%

ん?kinoko も24.3%

ちょっと迷いましたね。でもまあ高確率で「たけのこの里」と予測してますね。

さらに今度は、ローアングルからの「たけのこの里」の画像が、何の画像なのか?予測させてみると、

おお!takenoko 91.7%

高確率で「たけのこの里」を予測しました!

続いて、ノーマルな「クランキー」の画像が、何の画像なのか?予測させてみると、

crunky 67.5%

さすがにちょっとクランキーは難しいのか、迷いましたね。

続いて、学習結果では再現率が50%しかなかった、問題のキットカット。

ごくノーマルな「キットカット」の画像が、何の画像なのか?予測させてみると、

おお!全て50%以下とは。完全に迷ってますね。さすがにキットカットはまだ学習不足でうまく予測できませんでした。。。

(もう少し多くの画像を学習させると改善するかもです。。。)

最後にノーマルな「GABA」の画像が、何の画像なのか?予測させてみると、

GABA 72.3%

そこそこいい感じで「GABA」と予測できました!

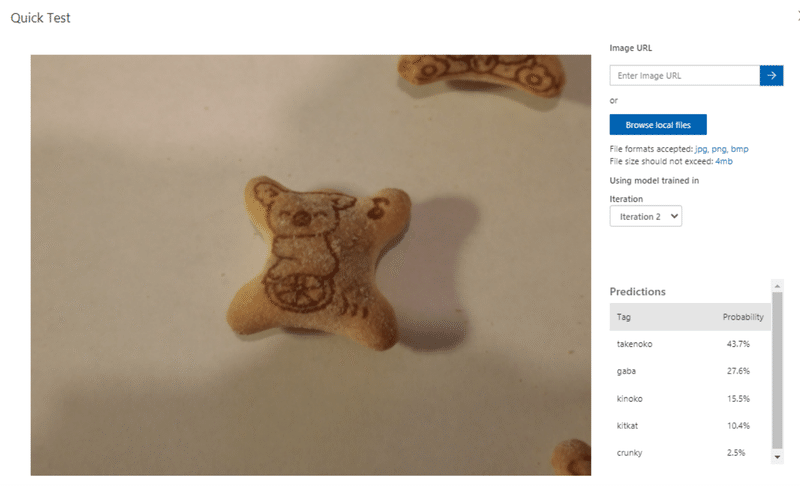

さらにちょっと興味本位で、全く学習させていない「コアラのマーチ」の画像が、何の画像なのか?予測させてみると、

どれも50%以下で、予測できませんでした。

ちなみに takenoko 43.7%と、「たけのこの里」が最も近いとAIは感じたようです。

まとめ

今回はマイクロソフトの『Custom Vision』を使って、AIによる画像予測を体験してみましたが、

驚くほど簡単に最先端の画像識別技術を利用することができました!

この画像識別を使った応用例で(Custom Visionを使ってるわけではありませんか)

なるほど~

と唸ったのは、

パン屋さんのパンを画像識別して、

レジと連動させて自動計算すること

パン屋さんのパンって、確かに種類が多いうえに、それぞれ微妙に値段も違って

まさにレジ打ち泣かせ

でもAIの画像識別を使えば、

トレイに乗ったパンを撮影して瞬時にパンの種類を識別して合計額が計算できます!

◆もうすでに導入されてるみたい

ちなみに本件とは全く関係ありませんが、私は「きのこの山」より「たけのこの里」のほうが好きです😁

◆追加検証

ままのすけさん から頂いたコメント

「はんぶんこにしても認識してくれるのかな(^^♪」

気になったので、完全な「はんぶんこ」ではありませんが、

「きのこの山」の柄(え)の部分と傘(チョコの部分)に分けて

それぞれ、AIで何の画像か?予測させてみました。(きのこの山だけは、予備で買ったものが家にあったので。。。)

~検証結果~

先ずは傘(チョコ)の部分から。

あらら、なんと、71.3%の確率で、

「キットカット」と予測。。。

続いて柄(え)の部分。

おっと、ちゃんと「きのこの山」と予測しました!(91.7%の確率で言い当てました)

なるほど~

AIは「きのこの山」を、柄(え)の部分から判断していたことが、この実験でよく分かりました。

以上、追加検証でした!

※「今月のチャレンジ」過去記事はこちら

この記事が気に入ったらサポートをしてみませんか?