LIFE3.0/マックス・テグマーク

宇宙を研究していた理論物理学者がAIについて考えると、こんなにも大きく常識をこえて未来の世界を想像することができるのかと驚きつつも、ワクワクしながら読むことができた1冊。

『LIFE3.0』は理論物理学者でMITの教授であるマックス・テグマークが、人工知能を3番目の生命の進化系と捉えた上で、宇宙規模における生命と世界のこれからを想像して、その可能性や危険性、僕たち人間が取り組むべき事柄は何かを考えた本だ。

1965年、数学者のアーヴィング・J・グッドは、人間の知能を超えた機械について、こんなことを書いているのだという。

「どんなに賢い人間の知的活動もはるかに凌ぐことのできる機械を、超知能マシンと定義しよう。機械の設計はそのような知的活動のひとつなのだから、超知能マシンはさらに優れた機械を設計することができる。すると間違いなく『知能爆発』が起こり、人間の知能は大きく水をあけられることになるだろう。したがって最初の超知能マシンは、人間が作るべき最後の発明品である」。

今後、知能爆発が起き、多くの面で人間の知能を超える汎用型AIが実現されたときにどんな未来が訪れるのか。その世界の可能性を、倫理や法律、経済、宇宙開発などの多角的な面から検討したのがこの本である。人間を知能をはるかに凌ぐ超知能AIが登場し、世界が人間という制約から解放されたときのことを考える、その想像性の広がりは根本的なレベルで常識をはるかに超えていて下手なSF小説なんか読むよりよっぽど面白かった(実際、最初の章は短編SF小説のような物語ではじまる)。

自らのボディーを設計する生命3.0

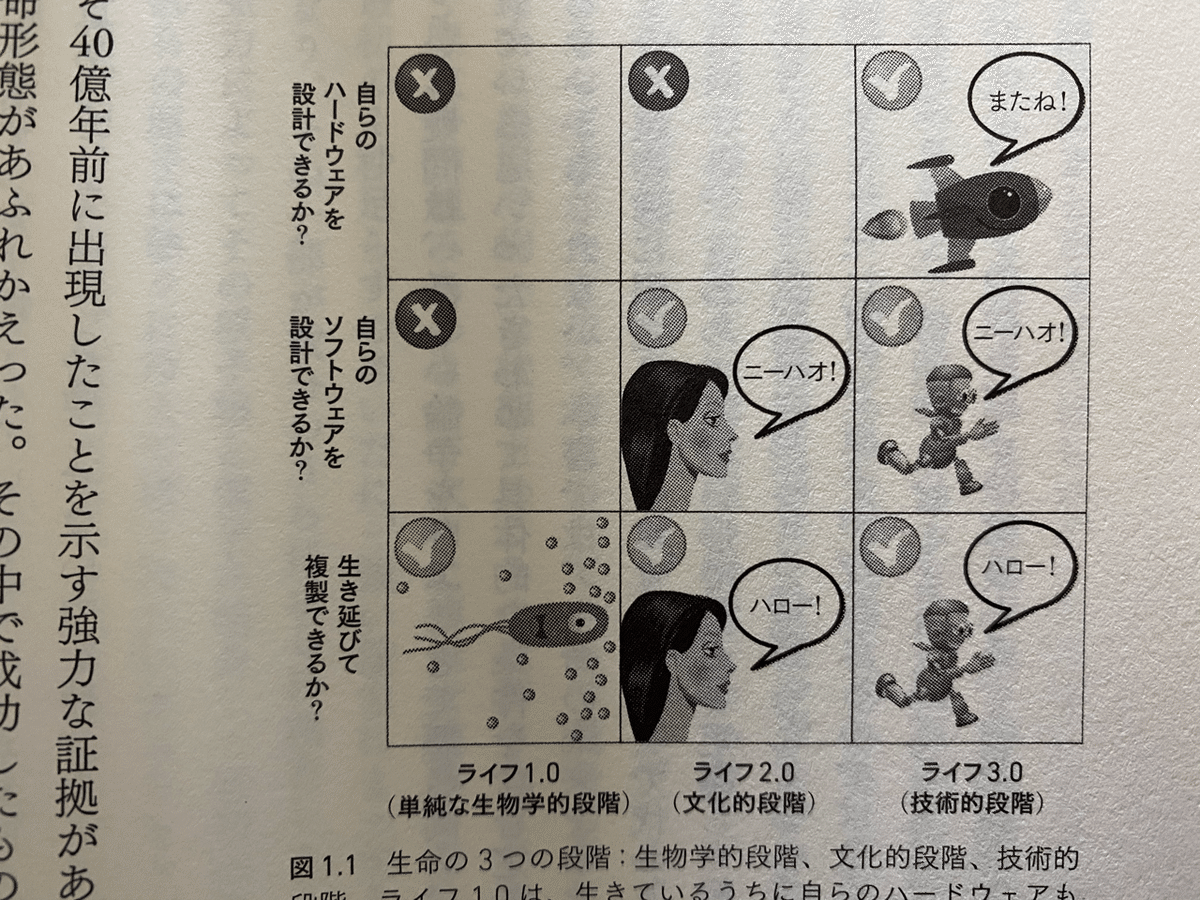

まずタイトルにもなってる、ライフ3.0とはどういう意味での生命のアップデートなのか。

「生き延びて複製できるか?」という単純な生命学的段階の生命をライフ1.0とすると、僕らは「自らのソウトウェアを設計できるか?」という基準を満たしたライフ2.0だと考えることができる。その場合に、テグマークがAIをライフ3.0とする基準は「自らのハードウェアを設計できるか?」というもので、自分が生きるためのボディーを自分自身で設計して作り直すことが可能な状態を想定している。

だから、囲碁の名人に勝てるAlphaGoや自動運転車のAIなど、ある特定の目的において人間に匹敵するか、それ以上の能力をもったAIも、いまだ「自らのハードウェアを設計できない」という観点では、ライフ3.0には至っていない。

逆に、義肢や人工臓器など、身体の一部なら設計できるようになった僕らはすでにライフ2.1くらいにはアップデートされているといえるかもしれない。

という小数点以下の数値が変化するマイナーアップデートは置いておいて、2.0が3.0になるメジャーアップデートがこの本のテーマにするところだ。

物理的観点から見れば、居住場所や機械や新たな生命形態など、未来の生命が作りたいと思うものはすべて、素粒子をある特定の形で組みあわせたものにすぎない。シロナガスクジラがオキアミを、オキアミがプランクトンを再構成したものであるのと同じように、この太陽系全体も、138億年におよぶ宇宙の進化の中で水素を組み替えたものでしかない。重力が水素を組み替えて恒星を作り、恒星が水素を組み替えてもっと重い原子を作り、その原子が重力によって組み替えられてできた地球の上で、科学的および生物学的なプロセスによって原子がさらに組み替えられることで、生命ができたのだ。

テクノロジーの限界に到達した未来の生命なら、そのような粒子の組み換えをもっと高速かつ効率的におこなうことができる。

このような意味で「ハードウェアを設計できる」ということによる、物質=ボディーに制約されない生命というのは、テグマーク自身はそう言及していないが、西洋の伝統的思考のなかでの長年の夢の成就ともいえる。

その意味での未来の生命は、物質に制約されない情報であり計算であるという観点からみるとき、物理的にも光の速さに近い速度での移動(通信?)するものだと想定することができる。宇宙への移住という意味では光速に近い速度で移動した後、移動先の物質を使って新しいボディーを設計・構築し、そこに生命を実装するということすら可能になるのだ。

これは、生命(人間が、ではない)が居住可能な範囲を根本的なレベルで極大化の方向に向かわせる大きな変化だ。

AI研究と宇宙の持続可能性

ライフ3.0の射程は、そのくらい大きい。

とうぜん、そうなると、その大きな変化をライフ2.0である僕たち人間がどう受け止めるか、また、どう方向づけが可能かということが重要になってくる。十分な議論を行い、準備を進めておく必要がある。

「生命の未来研究所(FLI)」を共同で設立したテグマークは、2017年に世界中からAI研究者、法律、哲学、経済など各分野の専門家を集めた国際会議で、AI研究のガイドライン「アシマロAI原則」を発表している。

イーロン・マスクが多額の出資をし、故スティーヴン・ホーキングらが科学顧問を務めるという話題性もあり、当時は、彼らがAIのつくる未来を悲観し否定的であるという誤解がメディアに作り出されたりもしたが、FLIの姿勢に極端な悲観的なところはない。

彼らが示すのは、AIのもつ大きすぎる可能性ゆえに、その研究や利用に携わる人すべてがそれらをどういう方向に導くかが、人類、いや宇宙全体にとって大きな鍵を握ることになるのだということを、人間に課せられた課題だということだ。

つまりはそれは持続可能性を考える上での大きな1ファクターである。

そして、読んで理解したが、それは現在の気候変動よりはるかに影響力が大きい。ことは地球規模の話ではなく、太陽系はおろか、僕らの銀河系すら越えて、複数の銀河を巻き込んで、少なくとも光の速度という限界を持つ僕らが宇宙の歴史の全時間をつかって認識できる最大規模の範囲を含む宇宙の持続可能性の話ですらあるのだから。

ひとたび超知能AIが別の恒星系や銀河へ入植すれば、そこに人間を送り届けるのはたやすい――ただし、そのような目標を持ったAIを作ることができればの話だが。人間に関するすべての情報を光速で送信し、AIがクォークや電子を組み合わせて目的の人間を作ればいい。その方法としてはまず、1人の人間のDNAを記述するのに必要な2ギガバイトの情報を送信して、培養した赤ん坊をAIが育てると言う、比較的低レベルのテクノロジーを使うやり方。もうひとつは、AIがナノテクノロジーを使ってクオークと電子から成人の人間を作り、地球でスキャンした下の人間の記憶をそれに植え込むという方法も考えられる。

未来の生命としての超知能AIが遠い宇宙に入植可能になるだけでなはない。人間さえも、トランスヒューマン的な技術により、遠い宇宙への移住が可能なのかもしれないのだ。こうなると、気候変動やらの観点からの持続可能性の問題はいまとは意味が大きく変わってくる。

しかも、人間が自然から取り出せるエネルギーはたとえ核融合の技術を手に入れたとしても、未来の超知能生命が手に入れることが可能なそれの100分の1なのだそうだ。

未来の生命が手にできるエネルギーが、現在のテクノロジーで可能な量よりも大幅に多いことが確実だ。我々はまだ核融合炉さえ完成させられていないが、未来のテクノロジーはその10倍、もしかしたら100倍も優れた働きをしてくれるはずだ。

そうなればエネルギー問題も問題ではなくなるだろう。

しかし、それが可能になるのは「そのような目標を持ったAIを作ることができれば」という条件がつく。

そう。ここでは、人間を超えた知能をもったAIにどんな目標を持たせるか、そもそも目標を持たせることが可能なのかが問題として浮上してくる。

目標という大きな課題

人工知能の倫理について議論する際、よく話題に出されるトロッコ問題という思考実験がある。

制御不能となった猛スピードで走るトロッコ。その線路の先には5人の人たちが作業をしている。その手前に分岐があり、線路を切り替えれば5人は助かる。しかし、その切り替えた線路の先にも1人の作業者がいる。果たして、どうするのか?という話だ。

これを自動運転車に置き換えた場合、自動運転車の目標として、乗車している人の安全性、道路にいる人の安全性を課して、AIか功利主義的な判断をするとすれば、1人が犠牲になることを選択する可能性が高い。しかし、倫理的にみて、それが正しいのかはかなり微妙だろう。

どう目標をAIに設計するかがむずかしいだけでなく、どのように目標設定をすればよいかも単純ではない。

そもそも目標設定というのは、相手が人間であったとしてもむずかしい問題である。

子供に自分の目標を吹き込む方法は何通りもあるし、私が10代の男の子を2人育てて痛感したように、うまくいく人とそうでない人がいる。納得させる相手が人間でなくコンピュータの場合、この課題は「価値観装填問題」と呼ばれ、子供をしつけるのよりもさらに難しい。

また仮に、うまく目標をインストールできたとしても、時が立てば条件は変わり、目標にすべき事柄の優先度だって変化する。

ましてや、今後の未来の生命3.0と生命2.0の関係において、後者がこれから生まれる生命3.0に対して事前にどんな目標設定をしておけば良いのかは、答えなどあるのかどうかすらわからない問題だ。

継承性の原理に関しても、面倒な問題が生じてしまう。中世以来、奴隷制や女性の権利等に関する倫理的見方がいかに変化してきたかを考えると、1500年前の人たちが今日の世界のありように多大な影響をおよぼすことを、我々は本当に望むのだろうか?

さらに言うなら、最初に定義した目標を生命がずっと変わらず維持できるかという問題だってある。

人間だって、最初の目標が時が変われば別の目標に変化することは当たり前のようにある。ましてや、超知能をもったAIが何故人間の設定した目標をまともに受けとったりするのだろう。

劣った知的存在である我々が大事にしているものを、超人的なAGIも望むに決まっているなどと、本当に自信を持って言い切れるだろうか? それはまるで、4歳児が、大人になってもっとずっと賢くなったら大きなお菓子の家を作って、1日中キャンディーやアイスを食べるんだと空想するようなものだ。同じように地球上の生命も、成長すれば子供じみた希望を捨てるだろう。

さらに上位の目標そのものは変わらなくても、その目標を達成しやすくするためのサブ目標が思わぬ形で、ほかの生物に不利益をもたらすことは往々にしてある。いま人間がほかの生物にとっては不利益でしかないような形で地球環境を壊してしまったように。もちろん、人間の側にだってそんなことをしようとする意図=目標はなかったはずだ。それでも、そのようなことは起こってしまう。

138億年におよぶこの宇宙の歴史を早回しにしていくと、目標指向的な振る舞いにはいくつかの段階があったことがわかるだろう。

1.物質が散逸を最大限に進めようとしているように見える段階。

2.原始的な生命増殖を最大限に進めようとしているように見える段階。

3.人間が増殖でなく、喜びや好奇心や思いやりなど、増殖に役立つよう進化した感情に関わる目標を追求する段階。

4.人間を助けるために作られた機械が、人間の目標を追求する段階。

この4番目の段階はいかにして可能になるのか、どのように設計すれば良いのかが大きな課題なのだ。

どのような結末を望むのか?

その課題に対して答えを出すまでにどのくらいの時間が残されているのだろうか? 囲碁のチャンピオンを破るAlphaGoのような限定された領域で人間をはるかに超える能力をもった特化型のAIは次々に登場しても、不確定な状況において自律的に判断して答えを見つけられる汎用型のAIが登場する気配はまったくない。2045年に訪れるとされたシンギュラリティは果たして本当にその時期に訪れるのか?

「AGIを目指す競争はすでに始まっているが、それがどのように展開するかは見当もつかない」とテグマークも言っている。

しかし同時にこうも続けるのだ。「だからといって、我々がどのような結末を望むのかを考えるのをやめてはならない。我々が何を望むかが、結果に影響を与えるからだ」と。

人間が何を望むのかをまずははっきりさせておく必要がある。その実現をどう超知能AIにも共有するかは別としてもだ。

テグマークは、「あなた自身は、どのような結末を、どのような理由で望むだろうか?」として、こんな質問項目を列挙している。

1.超知能が出現してほしいか?

2.人間がそのまま存在することを望むか? 取って代わられることを望むか? あるいは、サイボーグ、アップロード、シミュレーションになることを望むか?

3.人間または機械を支配したいか?

4.AIが意識を持つことを望むか? あるいは持たないことを望むか?

5.良い経験を最大限に増やして苦難を最小限に抑えることを望むか? あるいは成り行きに任せることを望むか?

6.生命が宇宙に広まることを望むか?

7.あなたが共感できる大きな目的を目指して文明が前進することを望むか? あるいは、たとえあなたにとっては的外れで陳腐な目標に思えても、ある程度満足できる未来の生命形態で良しとするか?

こうした問いをもとに、テグマークは「自由論者のユートピア」「善意の独裁者」「保護者としての神」「征服者」「後継者」「動物園の飼育係」など12の未来のシナリオを提示している。

読んでもらうとわかるが、どのシナリオにも一長一短がある(短所ばかりのシナリオもあるが)。しかし、テグマークが言うとおりで、人間自身が「何を望むか」によって、シナリオは大きく変わってくるし、望まない結果が訪れてしまう可能性は増えるかもしれない。

だからこそのFLI創設というアクションだし、アシロマ原則なのだと思う。

僕らも、むずかしい議論にどこまで参加できるかはわからないけれど、それでもどんな未来を望むかは、人それぞれが考える必要があるだろう。

そのためにもぜひこの本をおすすめしたい。

基本的にnoteは無料で提供していきたいなと思っていますが、サポートいただけると励みになります。応援の気持ちを期待してます。