メガトレンドである「生成AI」…経済や社会に与える影響や生成AIの未来とは――

脳の3層構造から読み解くAIの未来

爆速で進化している生成AI。「そもそも生成AIって何?」、「IT・DXとの関係は?」「どのように利活用されているのか?」、「リスクはないのか?」。経済や社会に与える影響、そしてバックキャスティングで未来について探ってみた――。

1. 生成AIとは?

生成AIとは、コンピュータが機械学習や深層学習などで大量のデータを学習することによって、与えられたデータやパターンから文章や画像、音声など新たなデータを生成する能力を持つ技術のことである。2022年11月30日に公開された生成AIの一つである大規模言語モデル(LLM)を活用したサービスChatGPTはわずか1週間で100万ユーザーに到達し、2023年1月には早くも1億人のアクティブユーザー数を記録したとされている。その普及速度は、FB、X(旧Twitter)、Instagram、Spotify、Dropboxといったサービスよりも圧倒的に早い(図表1)。

公開情報を基に著者作成

ChatGPTが「米医師資格試験に対する正答率が合格ラインに到達」、「米司法試験に対する解答が上位10%のスコアを獲得」、「過去5年分の日本の医師国家試験に合格」といった報道がされたことが普及の一因であろう。Microsoft創業者のビル・ゲイツが「携帯電話やインターネットと同じくらい革命的」と語ったことで、生成AIは市民権を得て、普及に拍車がかかったように思える。現在では様々な分野で活用が進み、新たなサービスが世に送り出されている。公開当初は、チャット型式でのやり取りだけであったが、現在では画像、音声、動画など様々な入力データを扱う(マルチモーダル)ことができるようになっており、日々進化している(図表2)。

公開当初、チャットボックスにプロンプトコマンドを入力するだけだった生成AIだが、現在では出力結果をさらに読み込んで加工する等、LLMの複雑性は増し続けている。そんな複雑化したマルチモーダル型生成AIで例にあげられるのは、Banter AIチャットボットであろう。利用したいユーザーがオンラインサービスにアクセスし、話したい有名人を選択し発話すると、ユーザーの発言内容を踏まえ、あたかも有名人本人が発しそうな内容を生成し、返答してくれる。当該サービスは、後述する生成AIの未来像の一つの姿と言えよう。

https://www.tiktok.com/@banteraiapp/video/7217990799122828587

2. 生成AIとIT・DXの関係は?

「経営者が知るべき「DX後進国日本」の真の課題」でも解説したが、DXとは5階部分の「イノベーションとサービスの多角化」を対象にしたものである(図表3)。

生成AIを2階部分の「コア業務の業務改革および業務の効率化」に利用すれば、人材不足やコスト削減に寄与してくれるだろう。また5階部分の「イノベーションとサービスの多角化」に活用すれば、既存事業で新たなイノベーションが生まれる可能性や生成AIを活用した新たな商品やサービスも誕生する可能性すらある。

注)LLMそのものを開発しているプラットフォーマー、スタートアップ企業、国や学術機関等は対象外としている

3. どんな業務で使われているのか?

辞書ツール事業などを展開するYourDictionaryが、2024年2月16日(米国時間)にChatGPTをどのように使用しているかについて、米国人1,000人に調査を実施している。

Z世代の60%以上が定期的にChatGPTを使用している

業務において4人に1人が利用している

約6%の正社員がChatGPTに仕事を奪われるのではないかと心配しており、特にミレニアルズにその傾向がある

ChatGPTが利用されている業務は、アイデア生成(41%)、文章等コンテンツ生成(20%)、メールへの返信(14%)、コード生成(11%)、レジュメ/カバーレター作成(10%)、プレゼン資料作成(9%)であった。

特に画像生成AIの進化速度は、目を見張るものがある。Midjourney、Stable Diffusion、DALL-E 3等を活用したアート作品やフェイク画像に関する報道がされた。中でもMidjourney V5を利用した「ドナルド・トランプ前アメリカ大統領が逮捕された」というフェイク画像活用したフェイクニュースは、急速に拡散されたことで注目を集めた。こういった生成AIの利活用時におけるリスクについて、次に見ていこう。

4. 生成AI利用時の主な注意点

「2. 生成AIとDXの関係」でも触れたが、2階部分の”コア業務の業務改革および業務の効率化”のために生成AIを利用する際には、2点注意しなければならない事項が存在する。

4-1. ハルシネーション(嘘)

生成AIとのコミュニケーションには、自然言語による指示文である「プロンプト」が必要である。LLMは高度な能力を有するが、指示内容が曖昧な場合、それらしい回答を生成するが、その真偽をLLMが判断できず、結果うそをつく(ハルシネーション)ことが往々にしてある。そのためプロンプトを工夫することで、ハルシネーションの発生リスクを軽減することを意識しておく必要がある。

追加情報の付加:漠然とした依頼や抽象的な表現を避ける

回答の比較:複数回同じ質問をLLMに投げる

出典の提示:根拠となる情報ソースを回答と併せて提示してもらう

4-2. バイアス

プロンプトエンジニアリング(プロンプトを工夫することでモデルの振る舞いをコントロールするテクニック)の教科書と謳われている『Prompt Engineering Guide』では、「例の分布」と「例の順序」について注意を払うよう指摘されている。

「例の分布」とは、例えばLLMに作業指示を与える場合に、ポジティブ、ネガティブそれぞれの例を与える量をある程度バランスさせないと、回答精度に影響が出るというものである。

「例の順序」とは、例えば「例の分布」で説明したポジティブ、ネガティブにあたる文章が登場する順序によって、回答精度に影響を及ぼす可能性があるということを意味している。

5. 生成AI活用時の主な注意点

次に5階部分の”イノベーションとサービスの多角化”に生成AIを活用する際には、事前に検討すべき事項と利用時に注意すべき事項が存在する。

5-1. 事前に検討すべきリスク

まず初めに、生成AIを活用する目的、そしてガイドラインの整備等が必要になるだろう。潜在的リスクとして生成AI利活用時における法規制への対応、著作権の侵害、個人情報の取り扱いがあげられる。

法規制

著作権侵害

個人データの取り扱い

法規制に関しては、各国によって温度差があり、イタリアのように一時的に利用を禁止する措置を取る国もあれば、インドのようにAI開発を後押ししている国も存在する。そのような状況の中、迅速で的確な対応をしたと言えるのがEUである。EUは世界初の包括的AI規制法案につき暫定合意(欧州議会は最終承認済)している。本法は、サードパーティークッキー問題でも大きく取り上げられた一般データ保護規則(GDPR)、デジタルサービス法、デジタル市場法などのデジタル関連法に続くもので、EU内へAIサービスを提供する日本企業にも広く適用され、違反時には重い制裁が予定されている。また日本においても、有名人を名乗る投資詐欺被害が後を絶たない。日本政府はこれまでAI開発についてガイドラインを示すなど企業の自主的な対応に委ねてきたが、安全性のリスクが問題視され始め、人工知能(AI)開発の国内外の大規模事業者を対象にした法規制の検討に入った。

LLMに大量に取り込まれているデータの中には著作権で保護されている情報も含まれている可能性がある。実際、著作権侵害の報告事例も増えており、ニューヨークタイムズや米国の作家によるオープンAIの提訴、中国でも生成AIの生成画像が著作権を侵害しているとして、SNS投稿者が提訴されている。

また個人情報の取り扱いに関しては、プライバシーと公共の安全性に対するリスクがあるとして、EUや米国が問題視している。日本においても個人情報保護委員会がOpenAI社に対して、利用者に個人情報の利用目的について通知するよう注意喚起を行っている。生成AIを活用する予定のある事業者は、個人情報取扱事業者として、利用目的規制を遵守する必要がある。

5-2. 利用時に注意すべきリスク

次に生成AIを利用する際に注意すべき事項として、プロンプト入力時における機密情報や個人情報の漏洩、出力情報の利用に際しての知的財産権侵害、誤情報や倫理規範(差別や偏見等)に即さない情報の混入などが考えられる。

機密情報や個人情報の漏洩

知的財産権侵害

誤情報や倫理規範に即さない情報の混入

生成AIサービスに入力した情報は、学習データに利用される可能性がある。つまり、生成結果に出力されてしまうリスクがあるということだ。一度入力され、学習されたデータの削除は難しく、利用者は細心の注意を払う必要がある。生成AIサービス事業者は前述のようなリスクに配慮しているとされ、オプトイン(学習データへの利用に同意)していない限り、学習データとして利用されることはないとしている。しかし、WEB経由での利用等、API経由で利用しない場合、オプトアウト(学習データへの利用には申請が必要)の対象となってしまう点には留意しなければならない。

知的財産権侵害に関しては、様々な法的解釈があるとされ、現段階で明確なことは言えない。最も注意すべき事項として挙げられることが、生成AIが出力したプログラミングコードをそのまま使用することであろう。実際問題として、そのまま使用できるレベルには至っていないが、OSSのコードも学習データに含まれている可能性があり、注意が必要だ。

そして誤情報の混入やフェイクニュース等、本物と偽物の見分けがつかないディープフェイクの技術(ディープラーニング技術を活用し、実際に存在しない、人物の動画や画像を生成)が使用されることだ。また学習データには差別や偏見等のバイアスがかかっているため、生成される結果に偏りがある点にも注意が必要だ。例えば、Midjourneyで「テック系企業のCEOの画像生成してください」というプロンプトを入力した場合、ほぼ白人男性の画像が生成される。

6. 経済に与える影響:経済的影響は日本のGDPよりも大きい

前項まで生成AIの普及速度やリスク等を概観してきた。明確に言えることは、生成AIで代替可能な業務は、近い将来、生成AIに取って代わられるということだろう。

6-1. 業界と職種への影響

業界を切り口にした場合、金融、保険、情報システム、エネルギー、通信・メディア、小売、教育といった業界が大きな影響を被ると言われている。ゴールドマンサックスのレポート「One-Fourth of Current Work Tasks Could Be Automated by AI in the US and Europe」によれば、生成AIは今後10年間で世界のGDPを7%引き上げる一方、約3億人規模のフルタイム労働者の業務が自動化されるという。欧米においては、約1/4の現業が生成AIに取って代わられることが予測されている。特にリスクの高い職種として、事務系タスクと弁護士、金融、マネジメントなどをあげている(図表4)。以前までの予測では、ホワイトカラーへの影響のみ触れられていたが、最近は物理的なアクチュエーターやロボットとも連携するようになり、ブルーカラーへの影響も懸念されるようになっている。つまり、公表されている肉体労働への影響は、実態よりも小さく見積もられている可能性が高い点には憂慮しておくべきだろう。

"One-Fourth of Current Work Tasks Could Be Automated by AI in the US and Europe",

March 26, 2023

6-2. 影響の大きさ

生成AI震源地となっているOpenAIが公開した論文「GPTs are GPTs: An early look at the labor market impact potential of large language models」によれば、米国労働力の約80%がLLMの導入により、彼らの仕事の少なくとも10%に影響が出る可能性がある一方で、約19%の労働者が仕事の少なくとも50%に影響を受ける可能性があることを示した。また、マッキンゼー・アンド・カンパニーのレポート「The economic potential of generative AI: The next productivity frontier」によれば、生成AIにより労働者の業務時間の約60%から70%が自働化されると分析している。さらに同レポートで経済に与える影響についても触れている。生成AIにより新たに生まれる事業の経済規模は2・6兆から4・4兆ドル、生産性向上の経済的影響は6・1兆から7・9兆ドルと試算している。

7. 社会に与える影響:消費の主体が変わる

前項では生成AIが経済に与える影響について見てきた。簡潔に言えば、業務は、生成AIによるオートメーションにより代替される。では、一般消費者である我々の生活はどのように変化するのであろうか。結論から先に言えば、パーソナライズドされたコミュニケーションが実現すると予測している。

7-1. コンテンツ

例えば動画生成サービスのTavus(米)は、顧客ごとにコンテンツのパーソナライゼーションを可能にしている。商品紹介などの動画を録画し、会話の中で相手の名前や企業名などに置き換えられる部分を指定すれば、あたかも閲覧者だけに作られたかのような動画を生成してくれる。同サービスはMetaやSalesforceなどで既に導入されていると言われており、カスタマーサクセスやリクルーティングなどの用途に効果を発揮している。

7-2. カスタマーサポート

Ada(加)は、LLMを活用することでチャット形式のカスタマーサポートを自動化し、消費者との対応コストを大幅に削減している。予め必要な情報を学習し、消費者から商品に関する質問をされた場合に学習データに基づいた回答をしてくれる。国内にも類似のサービスが存在し、ECサイトや企業のWebサイトで目にされた方も多いのではなかろうか。

7-3. 新たな顧客体験

TLDraw(英)は、デモレベルではあるが、自身の全身画像を送ってファッションのアドバイスをもらったり、食事の画像を送ってヘルスケアや栄養観点でアドバイスをもらったり、冷蔵庫の中の写真を送ってレシピを提案してもらうなどの新たな顧客体験を実現している。またAlibaba(中)は、長年ECサイトの課題であったバーチャル試着を実現しようとしており、モデルの静止画と着用させたいファッションアイテムを選択するとモデルが選択した衣服を着用している画像を生成してくれる。また漫画ワンピースのキャラクターに異なるキャラクターを衣服を着用させ、動画を生成することも可能だ。

つまり、顧客体験そのものが大きく変化すると予想している。現在は消費の主体が人間であるが、消費者個人単位の消費活動データが蓄積されることで個人単位の顧客理解が極限まで進み、単発の消費活動といった点のサポートだけでなく、一生涯寄り添ってくれる存在、つまり面でのサポートを実現する可能性も十分考えられる。誰よりも”あなた”を理解し、休日の過ごし方の提案だけでなく、旅行を検討している場合には必要に応じて旅行チケットの購入や宿泊施設、アクティビティの予約も行ってくれる。またライフステージに応じた提案を行ってくれる可能性もある。お子さんを塾に通わせ、中学受験を検討している方には、進学に必要な費用を事前に計算し、経費削減プランを提示しつつ、学資保険を提案してくれる。

近い将来、人間は個人としての消費活動は行われなくなり、デジタルヒューマンが全ての消費活動を行う、そんな未来が訪れるかもしれない。

8. 生成AIの未来:バックキャスティングで未来を読み解く

自著『日本型デジタル戦略』の中でも触れた、米国の神経学者であるポール・D・マクリーンが提唱した「脳」の構造と進化に関する議論から「AIにできること、できないこと」を改めて整理してみよう。マクリーンの脳の3層構造説によれば、人間の脳は本能や生存に関わる脳幹を土台として、その上に社会性や感情を司る大脳辺縁系、そして思考や論理や認識を司る前頭葉ないし新皮質と進化し、高次の認識を持つようになったという。つまり、AIが発展した未来とは、新皮質の拡張に他ならないのである。

例えば、米Neuralink(脳に直接電極を埋め込みマシンとつなぐ)やDARPA等が共同研究を進めている血中から神経に作用するナノボットのような新皮質とAIを直接つないで通信を可能にするブレイン・マシン・インターフェースの実現により、AIと人間の脳が融合することが予想される。しかもスーパーコンピュータと比較して1億倍超の計算処理速度が予測される量子コンピュータベースの量子AIの商用利用が開始されれば、不治の病とされてきた癌の特効薬や新素材の開発、経済の限界利益の外側にある難解な社会課題解決が一気に進む可能性がある。まるで映画マトリックスのような世界観が5年以上先の中長期的な未来として予想される(図表5)。

しかしながら、遠い未来のように感じる方々もいるだろう。そこで、ここでは現実性の高い5年未満の短期的な未来を題材とする。

8-1. 未来予測①:市場の拡大

日系企業が生成AIに最も期待していることは、言語障壁の撤廃だろう。言語障壁がなくなれば、日系企業の海外進出が加速する。過去、言語障壁のため進出できなかった国や市場調査から漏れていた国々の情報が圧倒的に取得しやすくなり、日系企業からイノベーティブな商品やサービスが多数輩出される可能性がある。これは言語障壁を抱えていた他国にもあてはまり、主要言語とされる英語・スペイン語・中国語等の国々との交流だけでなく、非主要言語の国々とのビジネスが活発化し、過去に例のない企業買収が起こりやすくなるだろう。

例えばSynthesia(英)は、1つの言語で原稿を入力するだけで160種類以上あるAIアバターを選択し、リアルなジェスチャーと発音で話す動画を生成してくれるサービスを提供している。主に社内研修やセールスイネーブルメント、マーケティングに活用するコンテンツなどに実用されており、Heinekenなど5万社以上に導入されている。Synthesia以外にも、ElevenLabs(米)の発話者の発言内容の音源を基に、別の言語に変換して音声生成する技術やMetaのSeamless Expressiveのように声色や喜怒哀楽などの感情を音源から読み取り、別の言語で抑揚をつけた上で音声を生成できるサービスも存在する。

8-2. 未来予測②:生成AIの利用

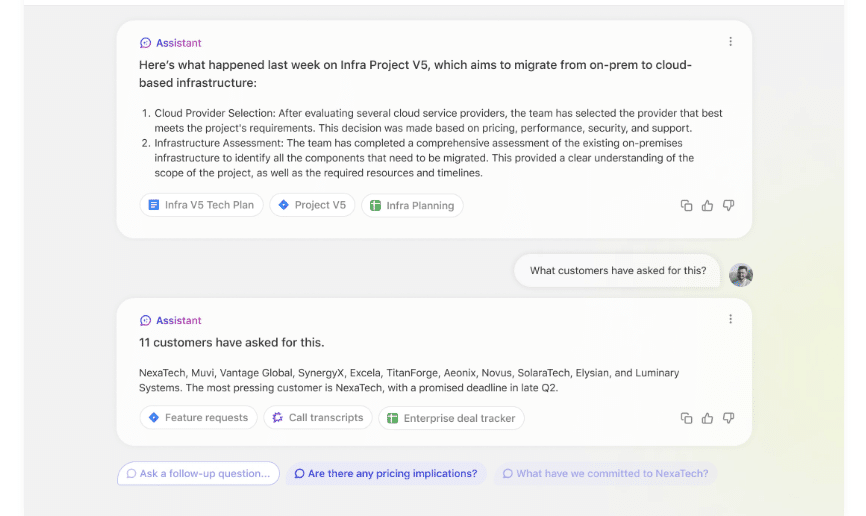

読者の方の中には、ナレッジデータベースの構築やクライアントへの提案時における社内ナレッジの検索に苦労された方もいると思う。Microsoft365やBox、Google Workspace、Slack等に格納されている社内コンテンツの検索に費やす時間は労働時間の約1/4以上という調査結果(IDCによる調査であるが、閲覧費用が必要)もあり、Glean Technologies(米)の生成AIベースのSaaS型のインサイトエンジンであるGleanは、社内ナレッジのような非構造化データを対話型インターフェースで検索できるようにするサービスを提供している。実際に多くの企業で導入が進んでおり、文法チェック・スペルチェック・盗用検出 のためのサービスを提供しているgrammarlyや外国語学習サービスのDuolingoなどでも導入されている。

チャット形式から対話形式によるプロンプト入力へと移行することが進化の一つ目である。もう一つの進化は、未来予測③の中で説明する。

8-3. 未来予測③:生成AIの活用

主に士業、医療、コンサルティングサービス等の高度専門知識を提供している業界が近未来に生成AIによりディスラプトされるかもしれない。特に経験の浅いジュニアスタッフ層は一掃される可能性が高いと言えよう。Sequoia Capital(米)の公開記事「Generative AI: A creative new world」によれば、チャット形式による指示出しはテキストやコード生成の成熟度と関連性が強く、2025年までには平均的な人間よりも良い結果を導き出すと予測している。一方で非構造化データに関しては、マシンパワーやLLMの学習データ、そしてモデリングが大きく関係するものと認識している(図表6)。

"Generative AI: A creative new world",

September 19, 2022

しかし、この未来予測はChatGPT公開前の情報であり、日々劇的な進化を遂げている状況から言えば、参考程度に留めておいた方が良いだろう。つまり、生成AIの未来は、技術的な観点から読み解くべきだと考える。ここから多少テクニカルな内容になることを、ご了承いただきたい。

LLMの活用には2つの手法が存在する。1つ目はRAG(Retrieval Augumented Generation:検索拡張生成)という手法、2つ目がファインチューニングである。

RAG手法とは、LLMのモデルを変更せず、ユーザーの質問と関連性の高い文書を検索・抽出し、プロンプト内部に補助情報を与え、ユーザーへの回答にはプロンプトと関連性の強い情報も含んで回答する方法である(図表7)。

学習データに存在しない情報は、LLMのモデルに存在しないため、正確な回答ができない点がデメリットとして挙げられる。しかし、グラウンディング(回答に必要な補足情報を与える手法)を利用すれば、LLMが学習していない事項でも、与えられた情報を基に回答を生成することが可能となる。つまりグラウンディングを利用すれば、先にあげたハルシネーションを抑制することができるのだ。しかし、与えられたプロンプトから如何にして必要な情報を抽出するのかといった問題が残る。この問題の解決には、RAGのコア技術の1つである「文書のベクトル化」が利用されている。簡潔に説明すると、「文書のベクトル化」とはテキストデータのベクトル変換技術のことで、与えられた補足情報をエンベディングモデル(関連情報をベクトル化し、意味的な距離と関連性を計算)を通して、ユーザーに回答する。

現在、RAGを実現するためのスタンダードツールとして有名なのはLangChainであろう。LLMを使用したアプリケーションを構築するためのフレームワークとして設計されており、必要な機能が一通り提供されている。またAWS、Azure、GCP等の大手クラウドベンダーもRAGプラットフォームを提供している。先の例で挙げたGleanには、このRAG手法が活用されていることがご理解いただけるだろう。

一方ファインチューニングは、独自の学習データを用いてLLMのモデル自体を微調整できる点がRAGとは異なる。RAG手法の活用メリットは、必要な関連情報を都度プロンプトで付与できる点とLLMのモデルを再学習させる必要がないため、安価に活用できる点にある。しかし、大量の情報をプロンプトに付与することができない点と専門特化した領域における活用には向いていない点がデメリットとして挙げられる。そこで、LLMのモデル自体を微調整(専門特化した情報をモデルに組み込む)できるファインチューニングが必要となる。ファインチューニングを行うためには、インストラクション・データ(実施したいプロンプト、参考情報、適切な応答データの集合体の組み合わせで構成)が必要となる。具体的には、SFT(Supervised Fine-Tuning:事前学習された言語モデルを特定タスクに適応させるため、正解付きデータを使用して実行)はモデルのパラメータをプロンプトと出力の関係に基づいて更新するプロセスであり、モデルに対してユーザーが指定したプロンプトに従う方法を示すものである(図表8)。

RAG同様、ファインチューニングにも問題は存在する。それは、開発した機関の価値観や倫理観に沿ったインストラクション・データによりLLMがチューニングされている可能性が高く、開発元のバイアスが少なからず入ってしまう点である。このような問題を解決するためには、アラインメントの調整が必要となる。仮にアラインメントの調整に失敗してしまうと、LLMがユーザーが意図していない回答を返したり、ハルシネーションの増加を引き起こす可能性が高くなるため、注意しながらファインチューニングを進めていただきたい。

スタンフォード大学医学部に勤務するリサーチサイエンティストの阿部氏によれば、"スタンフォード大学は、シリコンバレーのコミュニティと協働し、AI技術の評価及び大学への導入を行っている。この活動の一部として、スタッフ含む関係者に対して特別なバージョンのGPT(Stanford Health Care and Stanford School of Medecine Secure GPT:機密データの取り扱いを許可されたLLM)が提供されている" という。スタンフォード大学のような学術機関では、生成AIのファインチューニングを活用した研究・開発を加速させており、高度専門知識を有する業界も同様の動きを見せている。研究過程の情報は新たな学習データとなり、LLMの性能はさらに向上する。そのため一定程度の成果や効果が見えた段階で、ジュニアスタッフが担うような業務から代替が始まるということは容易に想像できよう。

因みに、RAGとファインチューニングは選択的なものではなく、ハイブリッドで扱うことも可能だ。例えば、専門性よりも一般的なコミュニケーション能力が求められる顧客応対などではRAGで回答を生成し、専門性や企業ブランディングなどを問われる場面ではファインチューニングで回答を生成するということも考えられる。また現在はデザインチームのように、組織横断で新規事業開発等行っているプロジェクトにおいても、各部門で事前にファインチューニングしたLLMを複合的に組み合わせて、最少人数で事業開発を推進することも可能になるだろう。

9. 戦略シナリオ:生成AIの活用が成長のカギ

「8. 生成AIの未来」で導き出した3つの未来予測を、自著『日本型デジタル戦略』で触れた Xモデル(Transformation model)にあてはめてみよう(図表9)。

まず初めに、経営層による生成AIの利用(シナリオ①)/活用(シナリオ②)の意思決定が必要だろう。生成AIの活用には、投資余力(特にモデルの再学習が必要となるファインチューニング)とAI人材が必要となる点にはご留意いただきたい。次に、言語障壁の撤廃状況と環境分析結果より、グローバルへと市場を拡大するのか(シナリオ①’/シナリオ②’)を見定め、ドメイン設定を行う。

また、ハイプサイクルの幻滅期にある生成AI以外の技術も5年以内に啓発期に突入しているだろう。例えば、スマートグラスを活用したデジタルツインやこれまで活用できていなかったオフライン上のデータが生成AIに活用される未来も訪れることが予測される。したがって、過去顧客インサイトを抽出できなかった領域でもデータ収集できるようになり、顧客サービスの質が向上し、量は今後爆発的に増える可能性がある。前述のような予測も環境分析に含めながら、ドメイン設定を行っていただきたい。

10. Next action:何から始めれば良いのか

世の中のほぼ全ての企業にシステムが導入されてきたように、生成AIもほぼ全ての企業で利活用される未来が訪れるだろう。したがって、我々が取り組まなければならないことは、業務に生成AIサービスを組み込み、仕組みを理解し、その上で自社事業に生成AIを活用できないかを探ることだろう。多くの業務は半自動化/全自動化されるため、自社事業の中で生成AIで代替可能な業務を特定することから始めてみることを提案したい。生成AIで代替可能な業務は積極的に代替し、該当業務に携わっていた人材の配置転換を進める。そうすることで「人手不足」の問題は緩和され、コスト削減に繋がり、利益率も改善することが予想されるからだ。

個人的には、現在の業務が生成AIに即時代替されるということは考えていない。しかしながら、生成AIを使いこなせる従業員と使いこなせない従業員との間には業務の幅とパフォーマンスに圧倒的な差が生まれるため、従業員の代替の動きは強まるだろう。この考え方は企業にもあてはまり、生成AIが利活用できない企業や組織は間違いなく淘汰されるであろう。

しかしながら、先に提案した「生成AIで代替可能な業務の特定」すら困難であると嘆く方もいらっしゃるだろう。米国マイクロソフト本社のシニア・ソフトウェア・エンジニアである渡辺氏は “生成AIの利用を推進できない企業には、CDO/CAIOのような伴走者が必要だ” と説いている(図表10)。

出所) https://qiita.com/yoshiwatanabe/items/c7b700b37d7174410b1f?fbclid=IwZXh0bgNhZW0CMTEAAR1liHjoCRacoCt9uwBckWC68OAe-BMhO8pxmnkuIBggEeK7nSITzMNM5aY_aem_AVuv7n57C538o5BJSvGAaPs5EUjmAmASdS-U2ucaIZoBpwjkoxYXMuAdlvi38yHdAANPf72KVM05yTFH9CjL0g-p

だが、CDO/CAIOの役割が担える人材の採用は困難を極めるであろう。なぜなら経営層のAIに対する理解が乏しい状況では変革を推し進められる適切な人選が困難だからだ。また、従業員がChatGPTも利用した経験がないといったような企業も日本の場合は多い。そのような企業にCDO/CAIOを採用し、大上段から社内変革の旗振り役を担わせたとしても、従業員のAIに対するアレルギー反応や現状変更を拒む従業員や会社役員が抵抗勢力となり、企業変革に至らずに計画が頓挫する可能性が高い。では、AIの導入に成功している企業はどうしているのだろうか。そのような企業は、セミナーやブートキャンプへ積極的に参加したり、経営者向けに講師を招きセミナーを開催し、AIに対する理解を深めるところから始めている。なぜなら、経営層のAIに対する理解が一定程度進めば、企業が進むべき方向性が明らかとなり、経営層が旗振り役を担うCDO/CAIOの支援に回りやすくなるからだ。現時点において、「DX後進国」と言われる日本では、前述した進め方が最も現実的であろう。