StanとRでベイズ統計モデリングをPyMC Ver.5で写経~第7章「7.1 交互作用」

第7章「回帰分析の悩みどころ」

書籍の著者 松浦健太郎 先生

この記事は、テキスト第7章「回帰分析の悩みどころ」の7.1節「交互作用」の PyMC5写経 を取り扱います。

説明変数どうしの関係性をモデルに組み込みます。

はじめに

StanとRでベイズ統計モデリングの紹介

この記事は書籍「StanとRでベイズ統計モデリング」(共立出版、「テキスト」と呼びます)のベイズモデルを用いて、PyMC Ver.5で「実験的」に写経する翻訳的ドキュメンタリーです。

テキストは、2016年10月に発売され、ベイズモデリングのモデル式とプログラミングに関する丁寧な解説とモデリングの改善ポイントを網羅するチュートリアル「実践解説書」です。もちろん素晴らしいです!

「アヒル本」の愛称で多くのベイジアンに愛されてきた書籍です!

テキストに従ってStanとRで実践する予定でしたが、RのStan環境を整えることができませんでした(泣)

そこでこのシリーズは、テキストのベイズモデルをPyMC Ver.5に書き換えて実践します。

引用表記

この記事は、出典に記載の書籍に掲載された文章及びコードを引用し、適宜、掲載文章とコードを改変して書いています。

【出典】

「StanとRでベイズ統計モデリング」初版第13刷、著者 松浦健太郎、共立出版

記事中のイラストは、「かわいいフリー素材集いらすとや」さんのイラストをお借りしています。

ありがとうございます!

PyMC環境の準備

Anacondaを用いる環境構築とGoogle ColaboratoryでPyMCを動かす方法について、次の記事にまとめています。

「PyMCを動かすまでの準備」章をご覧ください。

7.1 交互作用

インポート

### インポート

# 数値・確率計算

import pandas as pd

import numpy as np

import scipy.stats as stats

# PyMC

import pymc as pm

import arviz as az

# 描画

import matplotlib.pyplot as plt

import matplotlib.cm as cm

import seaborn as sns

plt.rcParams['font.family'] = 'Meiryo'

# ワーニング表示の抑制

import warnings

warnings.simplefilter('ignore')

データの読み込み

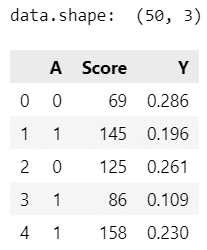

サンプルコードのデータを読み込みます。

### データの読み込み ◆データファイル5.1 data-attendance-1.txtの構成

# A:バイト好き区分(1:好き), Score:学問の興味の強さ(0~200), Y:授業の出席率(1年間)

data = pd.read_csv('./data/data-attendance-1.txt')

print('data.shape: ', data.shape)

display(data.head())【実行結果】

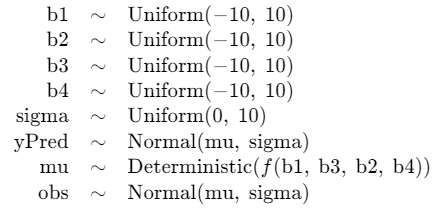

モデルの定義

PyMC Ver.5 で実装します。

モデルの定義です。

### モデルの定義 式7.2

with pm.Model() as model:

### データ関連定義

## coordの定義

model.add_coord('data', values=data.index, mutable=True)

## dataの定義

# 目的変数 Y

Y = pm.ConstantData('Y', value=data['Y'].values, dims='data')

# 説明変数 A

A = pm.ConstantData('A', value=data['A'].values, dims='data')

# 説明変数 Score / 200

Score = pm.ConstantData('Score', value=data['Score'].values / 200,

dims='data')

### 事前分布

b1 = pm.Uniform('b1', lower=-10, upper=10)

b2 = pm.Uniform('b2', lower=-10, upper=10)

b3 = pm.Uniform('b3', lower=-10, upper=10)

b4 = pm.Uniform('b4', lower=-10, upper=10)

sigma = pm.Uniform('sigma', lower=0, upper=10)

### 線形予測子

mu = pm.Deterministic('mu', b1 + b2 * A + (b3 + b4 * A) * Score,

dims='data')

### 尤度関数

obs = pm.Normal('obs', mu=mu, sigma=sigma, observed=Y, dims='data')

### 計算値

yPred = pm.Normal('yPred', mu=mu, sigma=sigma, dims='data')線形予測子$${\mu}$$のところに注目します。

説明変数$${A}$$と$${Score}$$が掛け算の形で関係しあっています。

これが交互作用の記述部分です。

$$

\mu = b_1 + b_2 \times A + b_3 \times Score + b_4 \times A \times Score \\

\Leftrightarrow \mu = b_1 + b_2 \times A + (b_3 + b_4 \times A) \times Score \\

$$

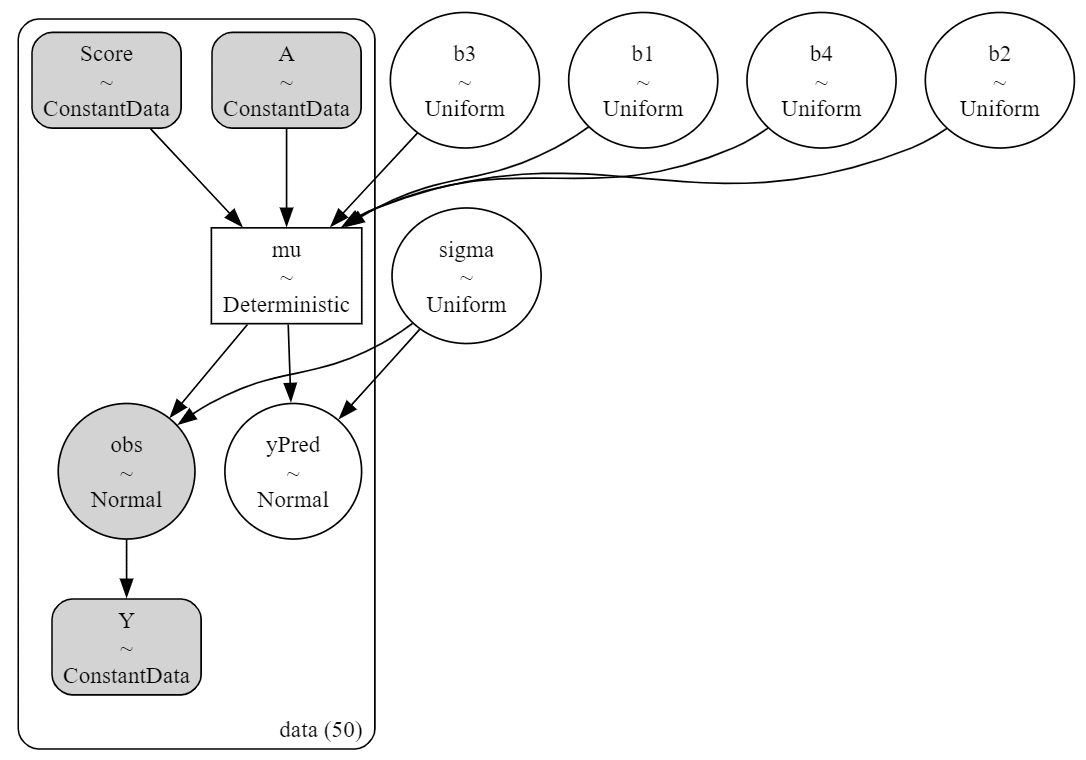

モデルの定義内容を見ます。

### モデルの表示

model【実行結果】

### モデルの可視化

pm.model_to_graphviz(model)【実行結果】

MCMCの実行と収束確認

PythonでMCMCを実行します。

### 事後分布からのサンプリング 20秒

with model:

idata = pm.sample(draws=1000, tune=1000, chains=4, target_accept=0.8,

nuts_sampler='numpyro', random_seed=1234)【実行結果】省略

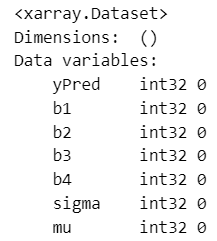

Pythonで事後分布からのサンプリングデータの確認を行います。

Rhatの確認から。

テキストの収束条件は「chainを3以上にして$${\hat{R}<1.1}$$のとき」です。

### r_hat>1.1の確認

# 設定

idata_in = idata # idata名

threshold = 1.01 # しきい値

# しきい値を超えるR_hatの個数を表示

print((az.rhat(idata_in) > threshold).sum())【実行結果】

収束条件を満たしています。

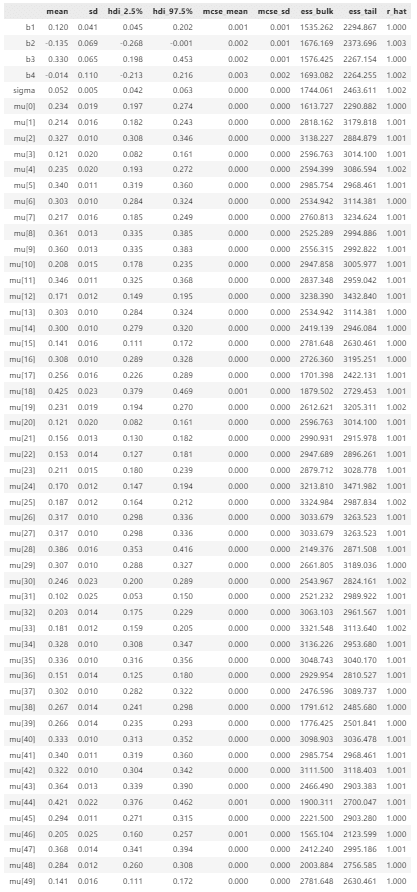

事後統計量を表示します。

### 推論データの要約統計情報の表示

var_names = ['b1', 'b2', 'b3', 'b4', 'sigma', 'mu']

pm.summary(idata, hdi_prob=0.95, var_names=var_names, round_to=3)【実行結果】

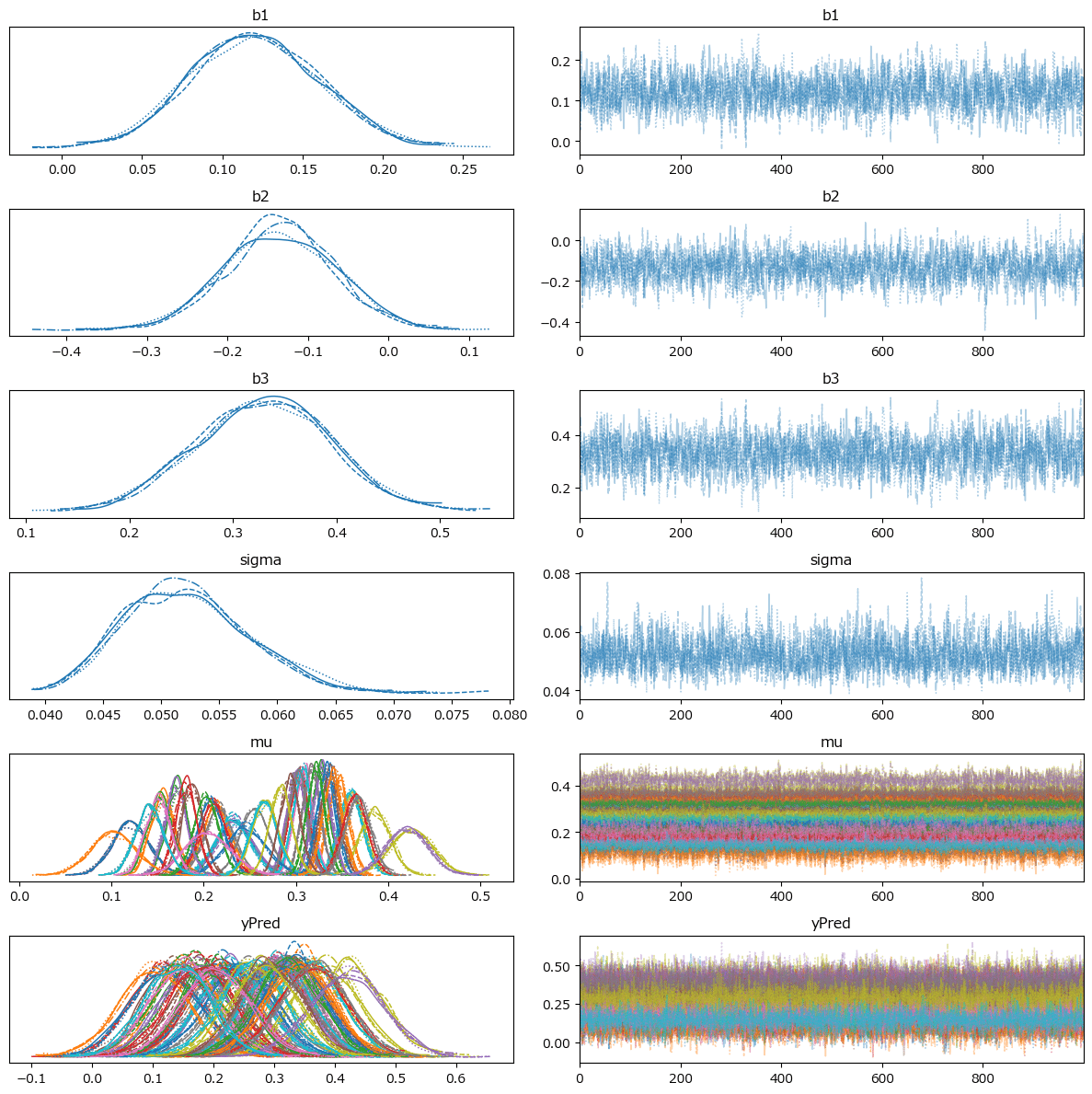

トレースプロットを描画します。

### トレースプロットの表示

var_names = ['b1', 'b2', 'b3', 'sigma', 'mu', 'yPred']

pm.plot_trace(idata, compact=True, var_names=var_names)

plt.tight_layout();【実行結果】

推論結果の分析

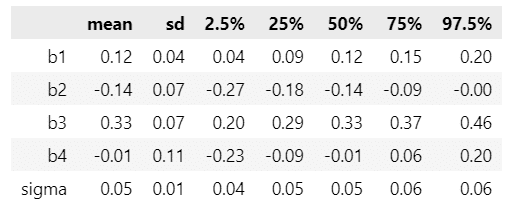

パラメータの事後統計量の要約を算出します。

### パラメータの要約を確認

# mean,sd,2.5%,25%,50%,75%,97.5%パーセンタイル点をデータフレーム化する関数の定義

def make_stats_df(y):

probs = [2.5, 25, 50, 75, 97.5]

columns = ['mean', 'sd'] + [str(s) + '%' for s in probs]

quantiles = pd.DataFrame(np.percentile(y, probs, axis=0).T, index=y.columns)

tmp_df = pd.concat([y.mean(axis=0), y.std(axis=0), quantiles], axis=1)

tmp_df.columns=columns

return tmp_df

# 要約統計量の算出・表示

vars = ['b1', 'b2', 'b3', 'b4', 'sigma']

param_samples = idata.posterior[vars].to_dataframe().reset_index(drop=True)

display(make_stats_df(param_samples).round(2))【実行結果】

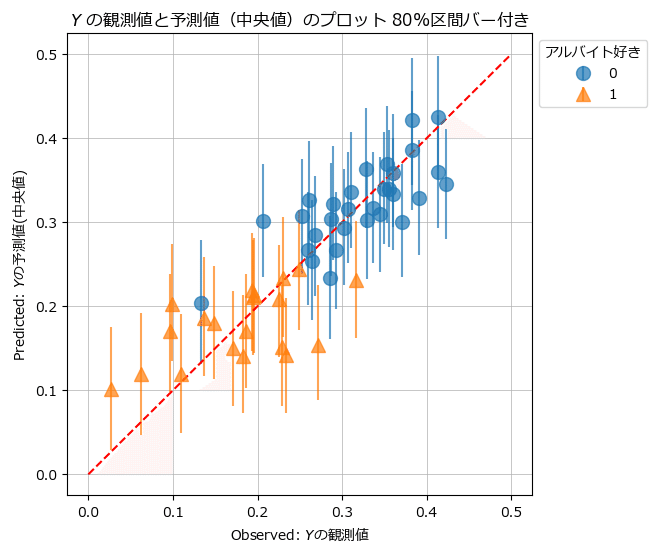

観測値と予測値のプロットを描画します。

### 観測値と予測値のプロット

## 描画用データの作成 yPredの個人別の中央値と80%区間を算出

# MCMCサンプリングデータからyPredを取り出し

y_pred_samples = idata.posterior.yPred.stack(sample=('chain', 'draw')).data

# サンプリングデータの10%,50%,90%パーセンタイル点を算出してデータフレーム化

y_pred_df = pd.DataFrame(

np.quantile(y_pred_samples, q=[0.1, 0.5, 0.9], axis=1).T,

columns=['10%', 'median', '90%'])

y_pred_df = pd.concat([data, y_pred_df], axis=1)

# 中央値と10%点の差、90%点と中央値の差を算出: errorbarで利用

y_pred_df['err_lower'] = y_pred_df['median'] - y_pred_df['10%']

y_pred_df['err_upper'] = y_pred_df['90%'] - y_pred_df['median']

# アルバイト0とアルバイト1に分離

y_pred_A0 = y_pred_df[y_pred_df['A']==0]

y_pred_A1 = y_pred_df[y_pred_df['A']==1]

## 描画処理

# 描画領域の指定

plt.figure(figsize=(6, 6))

ax = plt.subplot()

# アルバイト0の描画(エラーバー付き散布図)

ax.errorbar(y_pred_A0['Y'], y_pred_A0['median'],

yerr=[y_pred_A0['err_lower'], y_pred_A0['err_upper']],

color='tab:blue', alpha=0.7, marker='o', ms=10, linestyle='none',

label='0')

# アルバイト1の描画(エラーバー付き散布図)

ax.errorbar(y_pred_A1['Y'], y_pred_A1['median'],

yerr=[y_pred_A1['err_lower'], y_pred_A1['err_upper']],

color='tab:orange', alpha=0.7, marker='^', ms=10, linestyle='none',

label='1')

# 赤い対角線の描画

ax.plot([0, 0.5], [0, 0.5], color='red', ls='--')

# 修飾

ax.set(xlabel='Observed: $Y$の観測値', ylabel='Predicted: $Y$の予測値(中央値)',

title='$Y$ の観測値と予測値(中央値)のプロット 80%区間バー付き')

ax.legend(title='アルバイト好き', bbox_to_anchor=(1, 1))

ax.grid(lw=0.5);【実行結果】

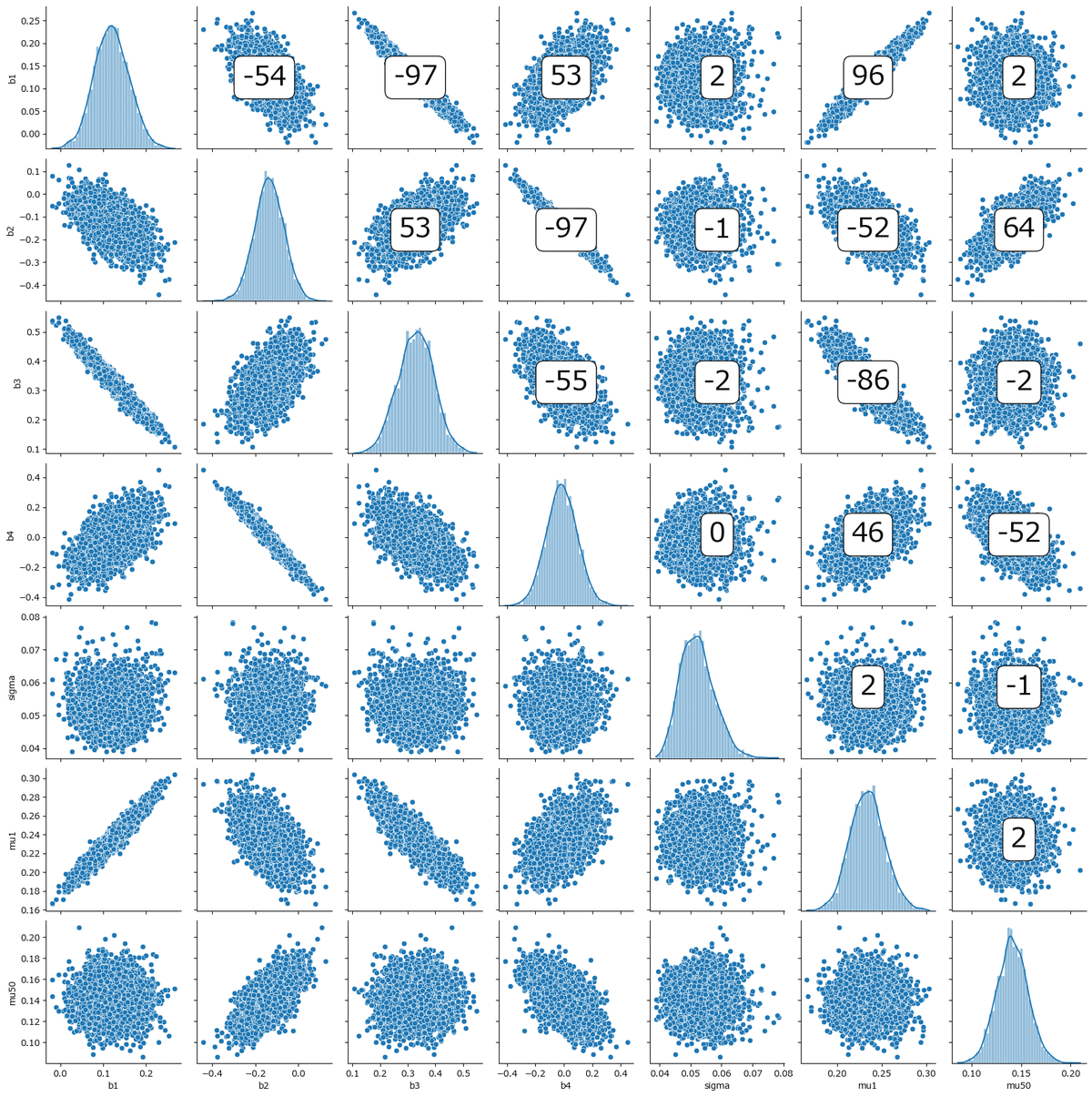

MCMCサンプルの散布図行列を描画します。

### MCMCサンプルの散布図行列の描画

## 描画用データの作成

# MCMCサンプリングデータから取り出し

b1_samples = idata.posterior.b1.stack(sample=('chain', 'draw')).data

b2_samples = idata.posterior.b2.stack(sample=('chain', 'draw')).data

b3_samples = idata.posterior.b3.stack(sample=('chain', 'draw')).data

b4_samples = idata.posterior.b4.stack(sample=('chain', 'draw')).data

sigma_samples = idata.posterior.sigma.stack(sample=('chain', 'draw')).data

mu1_samples = idata.posterior.mu.stack(sample=('chain', 'draw'))[0]

mu50_samples = idata.posterior.mu.stack(sample=('chain', 'draw'))[-1]

# 描画対象パラメータをデータフレーム化

plot_df = pd.DataFrame({

'b1': b1_samples, 'b2': b2_samples, 'b3' : b3_samples, 'b4': b4_samples,

'sigma': sigma_samples, 'mu1': mu1_samples, 'mu50': mu50_samples})

## 描画処理

# 相関行列プロットの描画

g = sns.pairplot(plot_df, diag_kws={'kde': True, 'ec': 'white'})

# スピアマンの順位相関係数の表示のためのaxフラット化

ax = g.axes.ravel()

## スピアマンの順位相関係数を上三角のaxesに表示

# 列名をリスト化

cols = plot_df.columns

# 列名の組み合わせ行i, 列j ごとにテキスト表示を繰り返す

for i, col1 in enumerate(cols):

for j, col2 in enumerate(cols):

# 上三角の位置は 行i < 列j のとき

if i < j:

# axesの番号を取得

pos = i * len(cols) + j

# スピアマンの順位相関係数を算出

corr, pval = stats.spearmanr(plot_df[col1], plot_df[col2])

# テキスト表示:中央表示に関連する引数: x,y,va,ha,transform

ax[pos].text(x=0.5, y=0.5, s=round(corr * 100), fontsize=30,

va='center', ha='center', transform=ax[pos].transAxes,

bbox=dict(boxstyle='round', facecolor='white'))【実行結果】

7.1 節は以上です。

シリーズの記事

次の記事

前の記事

目次

ブログの紹介

note で7つのシリーズ記事を書いています。

ぜひ覗いていってくださいね!

1.のんびり統計

統計検定2級の問題集を手がかりにして、確率・統計をざっくり掘り下げるブログです。

雑談感覚で大丈夫です。ぜひ覗いていってくださいね。

統計検定2級公式問題集CBT対応版に対応しています。

Python、EXCELのサンプルコードの配布もあります。

2.実験!たのしいベイズモデリング1&2をPyMC Ver.5で

書籍「たのしいベイズモデリング」・「たのしいベイズモデリング2」の心理学研究に用いられたベイズモデルを PyMC Ver.5で描いて分析します。

この書籍をはじめ、多くのベイズモデルは R言語+Stanで書かれています。

PyMCの可能性を探り出し、手軽にベイズモデリングを実践できるように努めます。

身近なテーマ、イメージしやすいテーマですので、ぜひぜひPyMCで動かして、一緒に楽しみましょう!

3.実験!岩波データサイエンス1のベイズモデリングをPyMC Ver.5で

書籍「実験!岩波データサイエンスvol.1」の4人のベイジアンによるベイズモデルを PyMC Ver.5で描いて分析します。

この書籍はベイズプログラミングのイロハをざっくりと学ぶことができる良書です。

楽しくPyMCモデルを動かして、ベイズと仲良しになれた気がします。

みなさんもぜひぜひPyMCで動かして、一緒に遊んで学びましょう!

4.楽しい写経 ベイズ・Python等

ベイズ、Python、その他の「書籍の写経活動」の成果をブログにします。

主にPythonへの翻訳に取り組んでいます。

写経に取り組むお仲間さんのサンプルコードになれば幸いです🍀

5.RとStanではじめる心理学のための時系列分析入門 を PythonとPyMC Ver.5 で

書籍「RとStanではじめる心理学のための時系列分析入門」の時系列分析をPythonとPyMC Ver.5 で実践します。

この書籍には時系列分析のテーマが盛りだくさん!

時系列分析の懐の深さを実感いたしました。

大好きなPythonで楽しく時系列分析を学びます。

6.データサイエンスっぽいことを綴る

統計、データ分析、AI、機械学習、Pythonのコラムを不定期に綴っています。

統計・データサイエンス書籍にまつわる記事が多いです。

「統計」「Python」「数学とPython」「R」のシリーズが生まれています。

7.Python機械学習プログラミング実践記

書籍「Python機械学習プログラミング PyTorch & scikit-learn編」を学んだときのさまざまな思いを記事にしました。

この書籍は、scikit-learnとPyTorchの教科書です。

よかったらぜひ、お試しくださいませ。

最後までお読みいただきまして、ありがとうございました。

この記事が気に入ったらサポートをしてみませんか?