#AI画像生成

【表情だけ動く】LivePortraitを使ってみた話【AI生成】

はじめに静止画から表情変化の動画への変換が高速に処理できるという事で、ローカルでも十分利用できるのではないかと思い試してみました。

LivePortraitとは「ステッチング」と「リターゲティング制御」を組み合わせたポートレートアニメーション技術だそうです。調べていないので筆者には何の事かわかりません。

LivePortraitのレポジトリはこちら。

実際に利用(ComfyUIカスタムノード

【ラフ画AI生成】Kritaでステーキを描く【練習】

はじめにKrita-ai-diffusionというKritaプラグインを利用すると、KritaでStable DiffusionによるAI画像生成を利用する事ができます。この記事はステーキ画像を練習として生成した過程の記録です。

Krita-ai-diffusion など筆者が利用するAIツールの導入方法はまとめてこちらで説明しています。

初期プロンプトとラフ画あまりステーキに詳しくなく一般

【RTX 3060】SD3 Medium を試す【ローカル】

はじめにStable Diffusion 3 Medium のローカル利用が可能になったので試してみました。利用した環境は下記になります。

OS:Windows 12 23H2

CPU:Ryzen5 3600

システムメモリ:32G

GPU:RTX 3060 12G

モデル:sd3_medium_incl_clips_t5xxlp16.safetensors

アプリ:ComfyUI

【画像生成】プロンプトは Google Gemini に聞こう【Stable Diffusion】

いつの間にか、Gemini に画像や動画なども同時に表示されるようになってますね。

髪型の名称が欲しい時は、

ポーズの場合は、

非常に便利になりました。

ある学者が言ってましたが、これからのプロンプトエンジニアリングは AI が行うべきものという話でした。AI からより良い情報や回答を得るために、人がエンジニアリングとして分析した理屈でなく(そのシステムの) AI がアシストする。確かに理

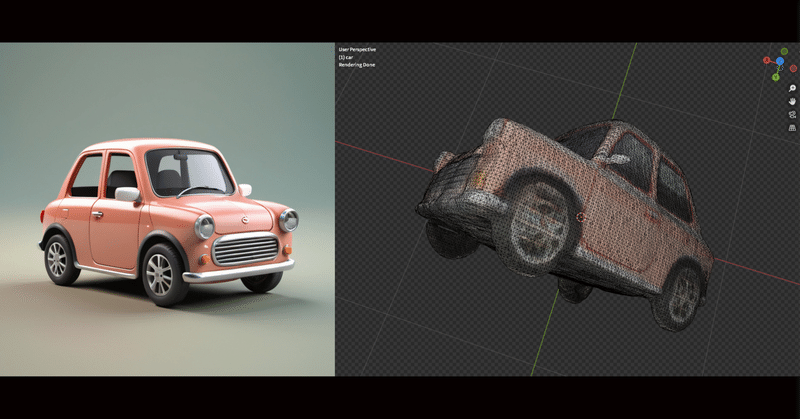

InstantMesh(画像1枚から3Dモデル・ローカル生成) 面白い

下記にて紹介しましたが、

予想以上に使えそうなので、InstantMesh の Windows でのインストール方法と簡単な使い方を追加しました。

AIで好きな画像を生成し、

この一枚の画像をデスクトップに保存したバッチファイルにドラッグ&ドロップすると、

デスクトップ上のフォルダに、3Dモデルが自動で作成されます。RTX 3060 (12G) で2分程度です。

すごい時代になったもので

SDXL+SD1.5仕上げ

SD1.5の方がリアルだという記事を書きましたが、

分かり易い例です。

SDXLではSD1.5では難しい、Midjourneyレベルのアーティスティックな生成も可能です。しかし、拡大すると写真にはみえません。そこで、SD1.5系のモデルで img2img します。陰影などのアートさは失われてしまいますが、写真により近くなっています。

アートとして「綺麗かどうか」を問うと賛否両論あると思います

【番外】Stable Diffusion は、なぜ古いバージョンである1.5が最強なのか?【ブログ】

バージョン2.0/2.1に続き、SDXLがリリースされてから既にかなりの時間が経ち、最近では Stable Diffusion 3 が発表されましたが、バージョン1.5の人気が衰える気配がありません。

この記事では、その理由について考察してみたいと思います。

多くの人は次の理由を挙げると思います。

ユーザーが多い

1.5専用の学習モデルが多い

高速で使用メモリも少ない

1.5専用のプロ