記事一覧

大規模言語モデルのフルスクラッチ作成の予習〜データセット取得、クリーニングまで〜

東京大学松尾研究室から、LLMスクラッチ作成のための雛形となるリポジトリが公開されています。

これを使ってデータセットの取得、クリーニングまでを試してみました。

実行環境はMacOS(M2 MBP)です。

GPUが入ってる学習可能なマシンが今ないので、とりあえず手持ちのMacで予習しておきます。

データ収集加工手順のREADMEを元に作業してみました。

リポジトリ取得git clone ht

巨大なプログラミング言語データセットThe Stackを少しだけ読み込んで表示するPythonコード

データセットthe-stackは、358のプログラミング言語をカバーする、6TBを超える寛容にライセンスされたソースコード・ファイルが含まれています。

全体をダウンロードすると、時間もかかりハードディスク容量も消費が激しいので、ストリーミングで少し読み込んで、中を見て動作を確認する程度のコードを書きました。

実行結果

% python3 the_stack_load.pyResolving

Gemmaを実行するためのGoogle Colaboratoryノートブック

gemma-7b-itを動かすノートブックです。

基本npakaさんの下記エントリー参照に、プロンプト以外は記述内容ほぼそのままですが[Open in Colab]ボタンを押せばすぐ開けますよ。

というメリットから掲載しておきます。

Google Colab の

ランタイムタイプの変更 -> T4 GPU

を選択。

Google Colabの無料版でも動作しました。

モデルカードのページを

日本語大規模言語モデルの学習でよく使われているデータセットmC4を確認してみる

主要な日本語大規模言語モデルの学習でよく使われているデータセットmc4。

これをダウンロードして確認してみました。

mC4とはデータセットを読み込むソースコード読み込みのコア部分は次の1行だけ。

dataset = load_dataset('mc4', 'ja', cache_dir="/Volumes/DataSets/DataSets", split='train')

ダウンロード時間

Hugging FaceのWikipedia英語データセットの比較

Hugging Faceにある次の2つのWikipediaデータセットで英語のWikipediaデータを読み込み比較します。

結論としては、graelo/wikipediaのほうがデータが新しくてデータ数が多いので良さそうです。

データセットを読み込むコードコア部分は次の2行

# データセットの保存先を外付けハードディスクにしているのでchache_dirを指定# wikipediaデータセッ

Wikipedia日本語データセットの読み込み

日本語LLMの学習にWikipediaの日本語データセットがよく使われているので、使い方を調べてみました。

データセットgraelo/wikipediaを使用Hugging Faceにあるwikipediaデータセットは、なぜか日本語データセットがうまく読めませんでした。

graelo/wikipediaデータセットでは、日本語データセットが読めたので、こちらで確認しました。

データセットを読

フルスクラッチ事前学習の日本語大規模言語モデルで使われているデータセット

主だったところで

LLM-jp-13B

weblab-10b

PLaMo-13B

Stockmark-13b

Japanese StabeleLM Alpha

の5種類で使われているデータセットについて、まとめました。

とりあえず、mc4とwikipediaはだいたい使われてるようですね。

疑問点wikipediaの日本語データつかってるという記述が、ちょいちょい見られがHuggin

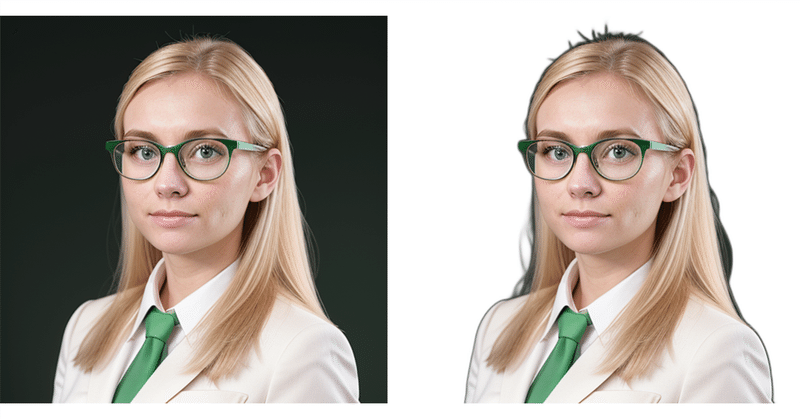

【ComfyUI】人物の背景消し3種類を比較するワークフロー

ComfyUIで人物の背景を消すノード3種類を比較するワークフローを作成しました。

アニメ系、実写系の2つのモデルで画像生成します。

ワークフローCustom Node

BRIA RMBG

Image Remove Background(rembg)

Remove Image Background(abg)

の3種類の背景消しが入っています。

BRIA RMBGを使ってみたところ、BR

【ComfyUI】人物の背景を消す

結果から書くと「実写系の人物はまぁまぁキレイに消せるけどイラスト系は微妙」です。

イラスト系は後述のコマンドラインから背景削除がベターかと思われます。

ワークフロー通常のt2iの画像生成のあとにImage Remove Background(rembg)のカスタムノードが入っています。

rembgのComfyUIへのインストール

Manager -> Install Custom Nodes

【ComfyUI】動画の髪色を変える

全体の構造としては

髪部分のマスクを作成(BatchCLIPSegにプロンプトで"hair"を指定)

色を変えた髪を生成(プロンプトで"(pink hair:1.3)"を指定。KSamplerのdenoise値でi2iのミックス具合を指定)

合成

という流れです。

使用モデル

ComfyUIの起動用のjupyter notebookにモデルダウンロードを追加します。

画像生成モデルは実写

【ComfyUI】動画からDensePose動画を作成

動画からMagic Animateで使用できるモーション動画が作成できます。

変換元の動画はコチラ。

ワークフロー元の動画が1080P(1920x1080)解像度で、その動画の中心を1080x1080でまず切り出して、それを512x512にリサイズ。

その画像に対してDensePose EstimatorがDensePose画像に変換をかけてます。

参考https://www.pexels.c

【ComfyUI】イラストをラインアートに変換して塗り直す【SD1.5】

SD1.5用のLineArtモデルのダウンロードSD1.5用のControlNetモデルが配布されています。

この中から、今回はcontrol_v11p_sd15s2_lineart_anime.pthを使用します。

ComfyUIの起動スクリプトにモデルダウンロードを追加

ComfyUIの起動用のjupyter notebookにモデルダウンロードを追加します

!wget -c http

【ComfyUI】絵をラインアートに変換してAnimagineXLで塗り直す【SDXL】

SDXLベースのモデルであるAnimagine XLではLineArtなどのControl NetモデルもSDXL用のモノを使う必要があります。

SDXL用のLineArtモデルのダウンロードSDXL用のLineArtモデルが配布されています。

この中からt2i-adapter_diffusers_xl_lineart.safetensorsをダウンロードして使用します。

ComfyUIの起

【ComfyUI】人物のポーズと線画を動画に描画

動画保存のシンプルサンプル兼ねて作成してみました。

ワークフローLoad Videoで動画を読み込んで、ポース、ラインアート化。

ImageBlendで1枚の画像に合成し直して、Video Combineで保存。

参考https://www.pexels.com/ja-jp/video/3709513/

↑ LoadVideo, Video Combine Node

【ComfyUI】シンプルなimg2imgと手作業でマスクを設定してのinpaint

img2imgのワークフロープロンプトに(blond hair:1.1), 1girlで生成。

黒髪女性の画像がブロンド女性に変更される。

画像全体に対してi2iをかけてるので人物が変更されている。

手作業でマスクを設定してのi2i黒髪女性の画像の目の部分を修正して、目を閉じた写真に変更してみます。

マスクの設定

LoadImageの画像を右クリック。Open in MaskEditorでマ