AIでどこまでメカデザインできるか試してみた。かなりヤバかった。

ひたすら命令をチューニングして、カッコいいロボのコンセプトアートを作る実験。

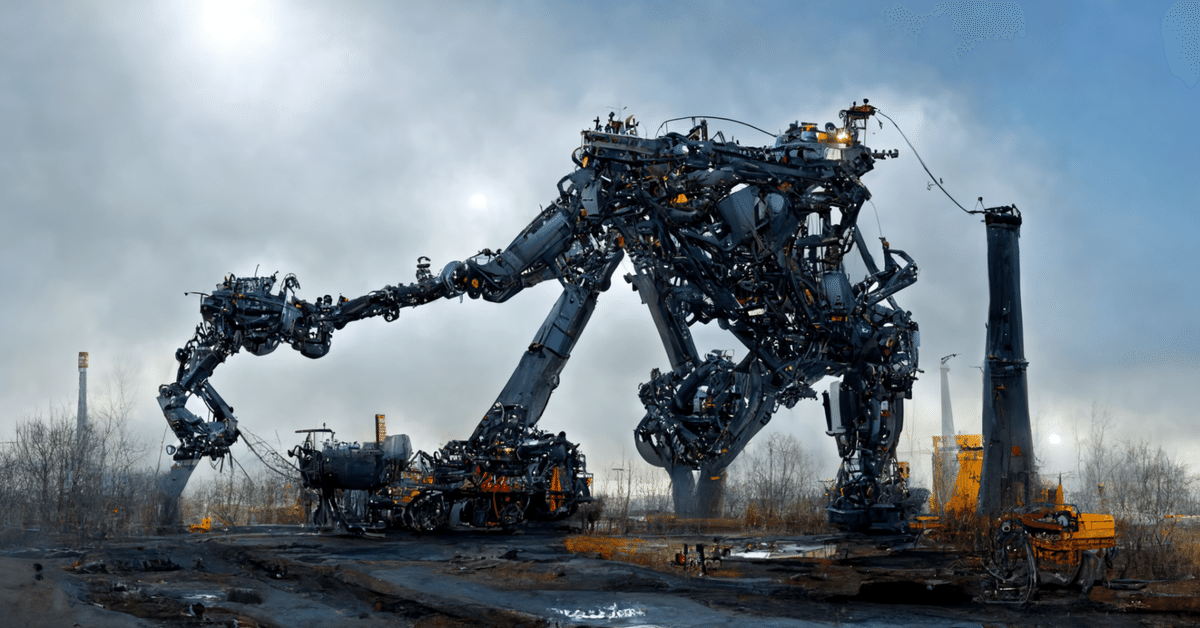

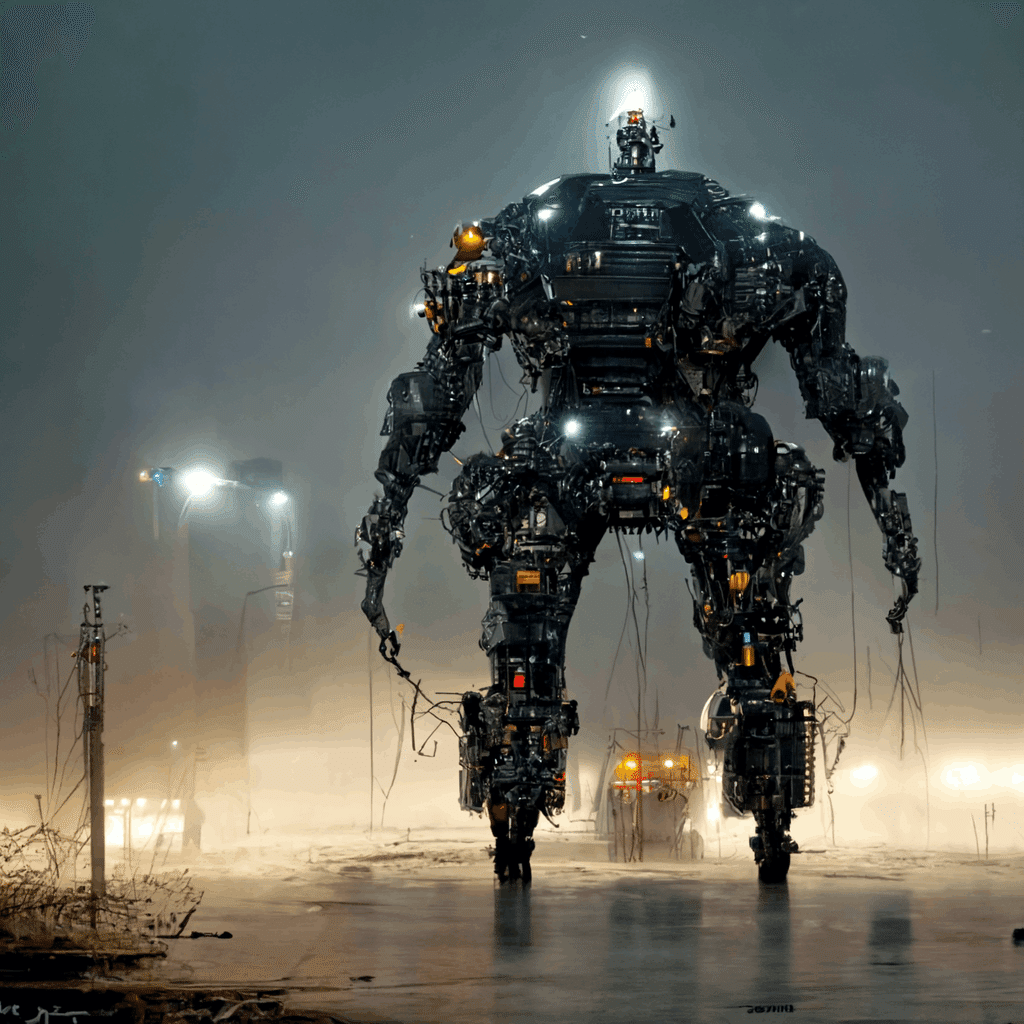

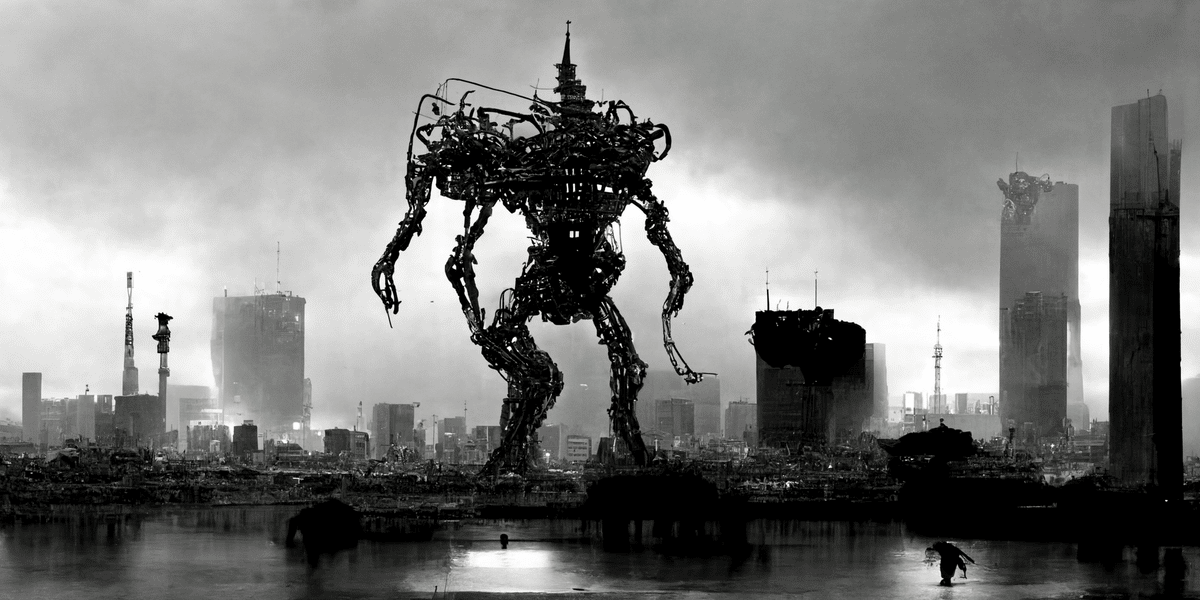

以下、AIに平文で命令して作ったロボットのスタディ。(光やパーツ分割線は僕の趣味丸出しなので、これ系のロボットしか作れないわけではないです)。

Open-AIのDALL-E2、Disco Diffusion、MidJourneyなどなどから、自前のStyleGanやVQGan系を試したりClip系を試したり…

色々やって、よいパラメーターや命令の仕方がわかってきました。やはり、自分で実装やコードを見て、アルゴリズムの内部挙動を理解しながら勉強すると、精度が出しやすくてよいですね。

内部の実装や、使っている(と想定される)ライブラリ、評価関数で同じ命令でも違うものが出てきます。この辺のノウハウはトッププロの間では「呪文」として隠蔽されていきそうですね。

ここから先は、「AIで作ったものを、さらに別のAIで後処理したり」といった、マルチコネクションをすることで、クオリティや幅を無限に広げていくことができそうです。

建築とか、ロボと関係ないワードを組み合わせていくと、パクリっぽさの少ない見たことない形状が出やすそうです。

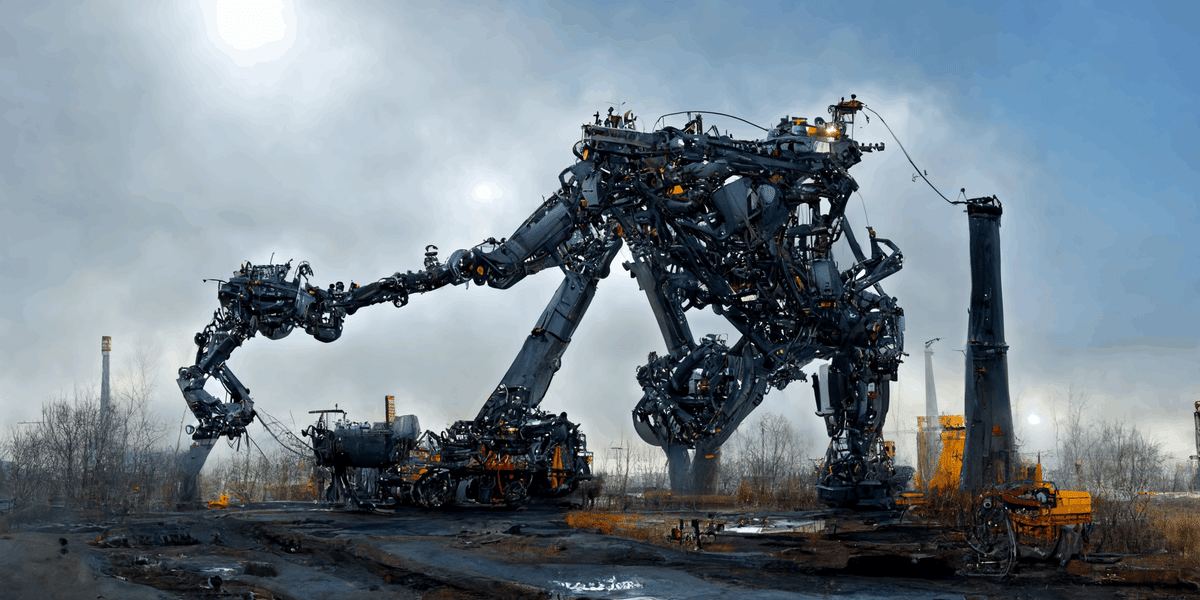

カバー画像用スタディ

noteのカバー用に横長を生成

AIの弱点とか今後の課題メモ

それぞれは単独で生成されてるので、「同じキャラの別アングル」とかを生成するのは苦手な感じです。(色々と命令文を工夫をすれば不可能じゃないけど、超ノウハウがいる)。

直近の未来としては、「雰囲気を掴むためのざっくりコンセプトアート」は人間の手を離れる可能性がありそうですね。一方で、イシューや題材をフォーカスしたフルコントロールの作品は、まだ人間にしか作れない。

この辺の「AIに代替されるスキル」と「AIがあっても胸像できるスキル」の見極めは、あらゆるクリエイティヴ職にとって今後10年の課題になりそうです。

この記事が参加している募集

いただいたサポートは、コロナでオフィスいけてないので、コロナあけにnoteチームにピザおごったり、サービス設計の参考書籍代にします。