2023年9月の記事一覧

Mistral-7Bを日本語で試す

フランスのスタートアップが公開したMistral-7Bが、Llama2 13B超えだと言うので日本語で試してみました。

試す前の注意事項としては、transformersがpipにない超最新版じゃないと動かない。

$ pip install git+https://github.com/huggingface/transformers.git

そんで試す。

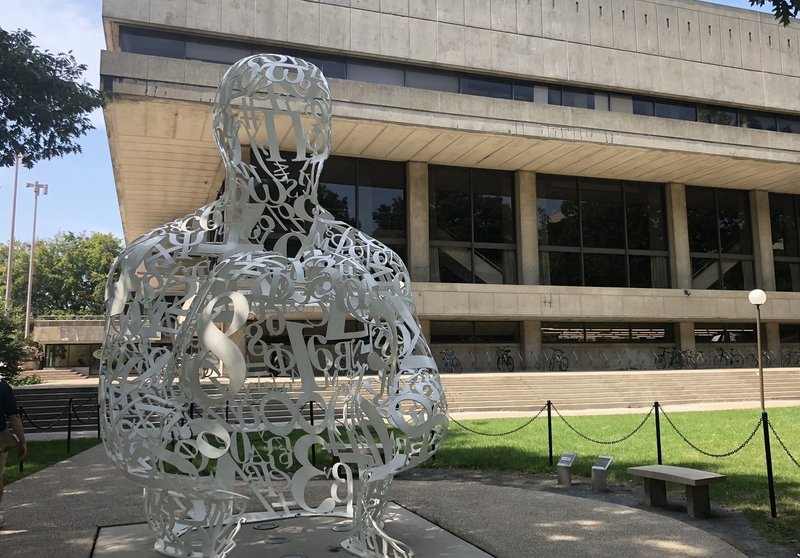

ちなみに今アメリカにいるのだが、n

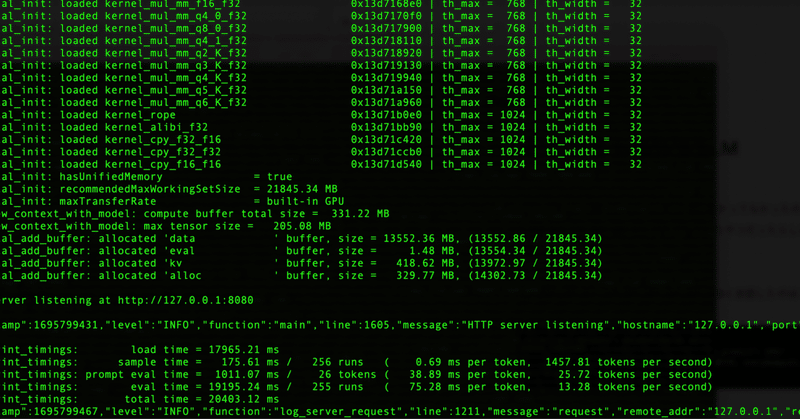

無料でGPT4越え!?ついに来たXwin-LM

今日のウィークリーAIニュースではnpaka大先生と一週間のニュースを振り返った。今週もいろいろあったが、なんといってもダークフォース、GPT-4越えと言われるXwin-LMである。中国製。

大先生もまだ試してないというので番組内で一緒に試してみた。

もちろんドスパラ製Memeplexマシン(A6000x2)を使用。

>>> from transformers import AutoToken

VIVANTロスとかしてる場合じゃない。この映画を見るべき

VIVANT、終わったねえ。

しかし別班とテントが、個人的にはちょっとイメージが違った。

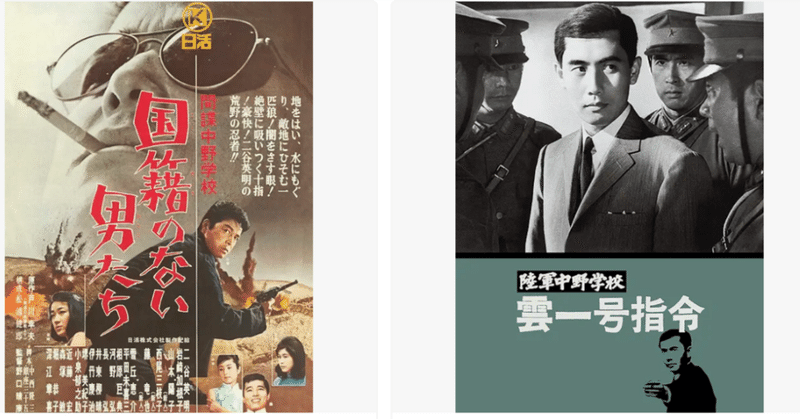

やっぱりこのネタといえば陸軍中野学校でしょう。

そもそも別班なるものの存在が囁かれる根拠は、戦前の陸軍に諜報を主任務とした中野学校が設立されていたという歴史的経緯から。

中野学校の学生の任務は「日本の捨て石となること」

中野学校の卒業生は広くアジア各国に派遣され、現地の住民に完全に溶け込み、基本的には日本

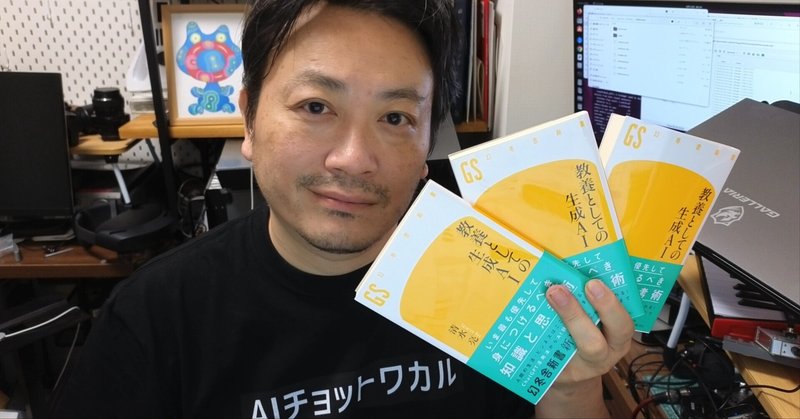

教養としての生成AI、重版決定!

おかげさまで「教養としての生成AI」重版かかりました。

新書だと発売日に重版ということも珍しくないのですが、この本の場合、紙よりも電子の方が売れ行きが良く、なかなか重版がかからないというところに個人的にヤキモキしました。

一般的に電子版は紙に比べて1/10くらいしか売れないそうですが、本書の場合は内容が内容のためか電子の売れ行きが良かったようです。

というわけで最新の情報にあわせて少しだけ加筆

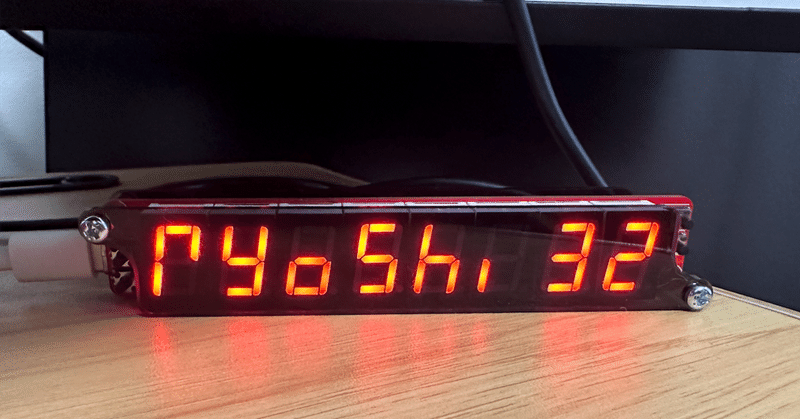

何に使うかわからないがなんだか楽しい7セグLEDディスプレイNanapoを買った

ビットトレードワンが開発したUSB-C接続の7セグLEDディスプレイ、Nanapoを買った。Shigezoneで4900円くらい。

USB-CでMacと繋げると、あとはscreenコマンドでシリアルに繋ぐだけ。

繋ぐときはこのページが参考になった

Pythonからも簡単に使える

>>> s = serial.Serial("/dev/tty.usbmodem101",115200)>>> s