2.3億ドルを調達した『ワールド・ラボ』のAI「空間知能」とは

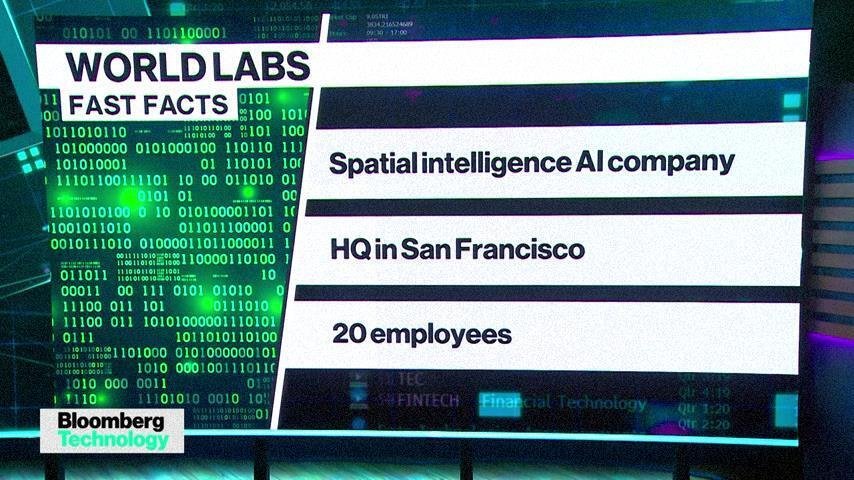

AIスタートアップの「ワールド・ラボ(World Labs Technologies社)」が2億3000万ドルの資金調達を行いました。

このスタートアップは、「AI のゴッドマザー」とも称されるフェイフェイ・リー氏(李飛飛:Fei-Fei Li)が2024年1月に設立した仮想と現実の両方の3D環境内で機能する高度なAIシステム「空間知能」の開発を進める企業で、AIが3D空間で世界を知覚して行動生成し、現実空間あるいは仮想空間とAIが3D空間で相互作用できるラージ・ワールド・モデル(LWM)の実現を目指しています。

出資者には、有力VCや実業家が顔を揃える他、AI界隈のそうそうたるメンバーも間接的に出資を行っている模様で、既にその企業価値は既に10億ドルを超えて、最速ユニコーンの1社となっている模様です。

[出資者](非公式含む)

アンドリーセン・ホロウィッツ、NEA、ラディカル・ベンチャーズ、エヌビディア(NVentures)、マーク・ベニオフ(セールスフォースCEO)、リード・ホフマン(リンクトインの共同創業者)、アシュトン・カッチャー、ジェフ・ディーン、ジェフリー・ヒントン、アンドレイ・カーパシーなど。

そんな「ワールド・ラボ」がどのような企業なのか、何を生み出そうとしているのか、また、空間知能とは何なのか。興味心から調べてみました。

1つは、昨日に行われたフェイフェイ・リー氏に対するブルームバーグのインタビュー内容の紹介。そしてもう1つは、2024年3月のフェイフェイ・リー氏のTEDトークを紹介します。

尚、「空間知能」といえば、全くもって新しいものではなく、これまでも自動運転技術、構造設計や物理シミュレーションモデル、MR(VR/AR)、ゲーミングなどで近接するテクノロジーは継続的に開発され、活用されて来たかと思われますが、フェイフェイ・リー氏のチームが目指す「空間知能」についての筆者の一旦の解釈としては、「現実世界および仮想世界の3D空間をステージとして、よりマルチモーダルなAI、そしてよりアクショナブルなAIを実現するためのユニバーサルな開発プラットフォームのエコシステム」なのかなぁと解釈した次第です。

尚、TEDトークのオリジナル(Youtube)は、これまでの彼女のチームが行ってきた具体的な研究の成果例も紹介されており、彼らが目指すものの一端を垣間見れる内容となっていますので、ワールド・ラボが目指す空間知能の理解の助けになると思いますので、ご興味次第でご参考下さい。

(1)インタビュー[9/13]

キャロライン・ハイド(Bloomberg)

資金調達についてですが、これまで学術分野にいたあなたが、今回プライベートな世界で資金を集めるというのはどのような経験でしたか?以前にもプライベートな環境にいたことはあるものの、資金を集めること自体は簡単でしたか?特に、これだけの著名なリストが関わっている中で、どのような流れでしたか?

フェイフェイ・リー(World Labs, Co-Founder & CEO)

おはようございます。出演できてとても嬉しく思います。物事が簡単に進むことは少ないですが、特に難しいのが「空間知能」(Spatial Intelligence)を実現することです。私たちは、この非常に難しい課題に取り組むために、素晴らしいピクセルの才能を持ったメンバーを集めることができて、本当にワクワクしています。

レイチェル・メッツ(Bloomberg)

「空間知能」という言葉を使って説明されていますが、具体的にそれがどういう意味で、今何を構築しているのでしょうか?

フェイフェイ・リー(World Labs)

人間には「空間知能」が備わっています。これは実はとても古くからある能力です。私たちは何百万年もの進化の中で、この能力を身につけてきました。それは、美しい花を見たり、蝶に触れようとしたり、街を作ったりと、3Dの世界で物事を理解し、考え、創造し、さらにはその世界と相互作用する力です。これらすべてが空間知能の一部なのです。

レイチェル・メッツ(Bloomberg)

人間や動物に関しては、空間知能という概念はわかりますが、それをコンピューターで実現することについてはどのような期待があるのですか?

フェイフェイ・リー(World Labs)

そのことが私たちが取り組んでいる課題です。すでに素晴らしい進展を遂げてきました。過去10年のAIの進化は本当に目覚ましいもので、最近は言語に関する話題が多いですが、ピクセルや視覚、空間知能の分野でも進歩を遂げています。例えば、画像に何が写っているのかを理解したり、その画像からストーリーを語ったり、文章を入力して画像を生成することができるようになっています。ただ、本当に次の大きな課題は、これらすべてを3D空間に持ち込むことです。なぜなら、現実の世界は3Dだからです。人間の空間知能は、3Dを理解し、扱うというこの基本的な能力に基づいて成り立っているのです。

キャロライン・ハイド(Bloomberg)

では、それを現実の世界に当てはめてみましょう。3Dでの作業、具体的な応用例としてはどのようなものが考えられますか?ロボティクスや製造業ですか?それとも、私たちがAI機能を持つメガネをかけて、実世界と対話するような形でしょうか?

フェイフェイ・リー(World Labs)

これは非常に基礎的な技術であり、コンピューターにとっても基礎的な能力なので、さまざまな用途に大きな影響を与えます。まずはクリエイターたちにとっての影響です。クリエイターには、アーティストやVFXクリエイターだけでなく、デザイナーや開発者、そしてビルダーも含まれます。この技術は彼らにとって非常に大きな意味を持ちます。しかし、長い目で見れば、ロボティクスや製造業、AR、VRといった分野にも影響が広がります。アップルが「Vision Pro」を「空間コンピューティング(Spatial Computing)」と呼ぶのには理由があるのです。私の考えでは、空間コンピューティングには空間知能が不可欠であり、他の多くの用途でも同様に必要とされると考えています。

キャロライン・ハイド(Bloomberg)

空間コンピューティングに、なぜ民間セクターのアクションとして、ベンチャーキャピタルの資金が必要なのでしょうか?アカデミアでは成し得ないことなのでしょうか?

フェイフェイ・リー(World Labs)

このことは全体的なエコシステムなのです。AIの分野でもこれを目にしてきましたし、長年にわたって同じ流れを見てきました。これは、私たちの社会や国が築き上げてきたどんな技術にも通じることです。このエコシステムには、好奇心に駆られた基礎研究が必要で、私は長年その分野に携わってきました。しかし同時に、産業界でのフォーカスした取り組みも欠かせません。大手テクノロジー企業が関係する問題に取り組んでいますが、このエコシステムの素晴らしい点は、スタートアップも含まれていることです。高い理想を持ち、難題を解決したいと信じる人々を引き寄せる力があるのです。そして私たちは一つにまとまり、この非常に難しい課題に全力を注ぎ、それをスケールさせ、保護し、最終的にユーザーや顧客の手に届けるために取り組んでいます。

レイチェル・メッツ(Bloomberg)

リー博士、あなたが最もよく知られているプロジェクトのひとつに、画像認識分野の発展に大きく貢献した「ImageNet」がありますよね。これは何百万もの画像を集めた大規模データベースです。この経験がWorld Labsを立ち上げる際にどのように関わっているのか、そして両者の関連性について教えてください。

フェイフェイ・リー(World Labs)

この2つは少なくとも2つの点で関連していると思います。まず1つ目は、ImageNetがコンピュータービジョン、つまりピクセル領域における初期の研究の一つであることです。もちろん、その当時、10年以上前のImageNetやそこから派生したアルゴリズムができたことは、まだ2Dの世界でのことでした。写真の中の物体を認識し、最終的には画像のストーリーを語るというレベルです。しかし、これはコンピュータービジョンの初期の研究からの知的継続であり、今、私たちは非常に難しい次の段階である「空間知能」に取り組んでいます。知的な観点から言うと、私のライフワークはその延長線上にあると感じています。少し視点を広げると、ImageNetが誕生してからすでに15年以上が経っており、それは私が大きな「北極星」の課題に賭けた知的な挑戦でした。その課題はAIの進路を大きく変えるものでした。そして今、空間知能が私やチームにとって次の「北極星」であり、これがAIの進路を再び大きく変えると信じています。

レイチェル・メッツ(Bloomberg)

今回の資金調達に関して、AI分野で著名な方々が投資していることがわかります。ジェフ・ディーン氏、ジェフリー・ヒントン氏、アンドレイ・カーパシー氏など、彼らとは以前一緒に仕事をしたことがありますね。Googleで共に過ごされているかと思いますが、彼らには、どのようにこのプロジェクトを提案したのですか?

フェイフェイ・リー(World Labs)

それがこの分野の素晴らしいところです。まず、彼らは何年も共に仕事をしてきた友人や同僚、あるいは元学生たちです。彼らも私と同じ信念を共有していると思います。この問題がいかに大きな課題であるかを理解し、私の共同創設者であるベン・ミルデンホール、クリストフ・ラスター、ジャスティン・ジョンソン、そして創設メンバー全員の話を聞いたときに、我々のチームを信じてくれたと思います。この難題に取り組むためには、解決能力を持って、本当にそれを信じる人々が必要です。だからこそ、彼らは私たちを支持してくれたのだと思います。

キャロライン・ハイド(Bloomberg)

有名なベンチャーキャピタルからも資金を得ていますね。例えばアンドリーセン・ホロウィッツなど。資金の調達に関して、もっと広く、学術界にも資金を回すべきだというあなたの呼びかけには興味があります。以前、バイデン大統領に直接働きかけて、公的部門と民間部門の両方で研究開発には、もっと資金を投入すべきだと提案されましたよね。特に大学がGPUや計算リソースにアクセスできるようにするために。今もその必要性を感じていますか?それとも、公的部門の支援に見切りをつけて民間部門に注力しているのでしょうか?

フェイフェイ・リー(World Labs)

私が今、民間と公共の両分野を横断して活動する中で、ますますその重要性を感じています。コンピューターリソースへのアクセスや民間での支援を見ると、民間セクターにいる私たちがここにいるのも、公共セクターがあってこそだと強く感じます。例えば、ImageNetやCNN、バックプロパゲーション、トランスフォーマーモデルなど、多くのAIの画期的な研究は、最初は公共セクターから生まれたものです。このエコシステムは非常に重要であり、そのどれかが欠けたり、バランスを欠いたりすることは、エコシステムにとって有害だと思います。

私自身、今、私たちがリソースにどれだけアクセスできるかを目の当たりにしてきました。だからこそ、さらに強く感じるのは、国として公共セクターや学界、そしてこうした「ムーンショット」の考え方に投資し、学生や教員、研究者たちの基礎科学研究を支援する必要があるということです。

(2)TED トーク:「空間知能」について

「With Spatial Intelligence, AI Will Understand the Real World」(空間知能によってAIは現実世界を理解する)という題名で、2024年3月にフェイフェイ・リー氏が登壇して行われたTEDトークの内容です。

同氏のチームの「空間知能」についての研究成果や技術の進化過程などが紹介されており、彼女らが目指している方向を比較的具体例で示している良い情報ソースかと思います。ご興味次第でご参照ください。

-----------------------------------

それでは、何かをお見せしましょう。

正確に言うと、実は何もお見せしません。これは約5億4千万年前の世界です。果てしない暗闇が広がっていました。この暗さは光がないからではなく、「見る」ものが存在しなかったからです。太陽の光は海面下1000メートルまで届き、海底では熱水噴出孔からの光が放たれ、生命が溢れていました。しかし、そこには一つとして目がありませんでした。網膜も、角膜も、レンズも存在せず、光はあっても、生命はあっても、それらは誰にも見られていませんでした。かつて、「見る」という概念そのものが存在しなかった時代があったのです。そして、それが初めて起こった時が訪れました。

私たちがようやく理解し始めた理由により、三葉虫という光を感知できる最初の生物が出現しました。彼らは、私たちが当然のように受け入れている現実を最初に知覚した存在であり、自分以外にも何かが存在するということ、つまり意味や他者がいる世界を発見した最初の生物でした。視覚の能力がカンブリア爆発を引き起こしたと考えられており、この時期に多種多様な動物が化石として残るようになりました。最初は光をただ受け入れるという受動的な体験だったものが、やがてより能動的なものへと進化していきました。神経系が発達し、視覚が洞察に変わり、見ることが理解へ、理解が行動へとつながったのです。このすべてが、知性の芽生えを促しました。

今日、私たちは自然が与えてくれた視覚の知性だけでは満足できません。好奇心に突き動かされ、私たち自身と同じかそれ以上に賢く「見る」ことができる機械を作りたいと願っています。9年前、この場でコンピューター・ビジョンという人工知能の一分野に関する初期の進展を報告しました。その時、3つの強力な要素が初めて結びついたのです。ニューラルネットワークというアルゴリズム、グラフィック処理装置(GPU)という高速で専門的なハードウェア、そして私たちの研究室が何年もかけて収集した1,500万枚の画像データ「ImageNet」がその3つです。これらが一体となり、現代のAI時代が幕を開けたのです。

私たちはここまで大きな進歩を遂げてきました。当時、画像にラベルを付けるだけでも大きなブレークスルーでしたが、それからアルゴリズムの速度と精度は急速に向上しました。私の研究室が主導した年次で行うImageNetチャレンジで、その進展を測定して記録しました。このグラフには、年ごとの改善と重要なモデルの成果が示されています。さらに一歩進み、私たちは物体をセグメント化したり、物体間の動的な関係を予測したりできるアルゴリズムも開発しました。これは私の学生や共同研究者たちとの成果です。そして、まだ続きがあります。

前回お見せしたのは、コンピューター・ビジョンで初めて人間の自然言語で写真を説明できるアルゴリズムでした。これは、私の優秀な元学生、アンドレイ・カルパシーとの共同研究の成果です。その時、私は少し無理を承知でこう言いました。「アンドレイ、逆のこともできるんじゃない?」すると彼は笑って「それは無理です」と答えました。しかし、この投稿が示す通り、最近では不可能が可能になりました。これが実現したのは、拡散モデル(Diffusion Model)というアルゴリズムのおかげです。これらは、今の生成AIアルゴリズムを支え、人間が入力した文章を基に、まったく新しい写真や映像を作り出せるようにしているのです。

多くの方がOpenAIのDALL-Eによる最近の驚くべき成果をご覧になったと思います。しかし、膨大な数のGPUを使わなくても、私の学生と共同研究者たちは、DALL-Eが登場する数ヶ月前に「Walt」という生成動画モデルを開発しました。ここで、そのいくつかの成果をご覧いただいています。まだ改良の余地はあります。例えば、この猫の目を見てください。波の中に入っても全く濡れないなんて、大失敗です。しかし、過去が未来の序章であるならば、私たちはこれらのミスから学び、私たちが思い描く未来を創り上げていくでしょう。

この未来では、AIができる限りのことを私たちのために、あるいは私たちを助けるために行うことを望んでいます。長年、私は「写真を撮ることは、見ることや理解することとは違う」と言い続けてきましたが、今日はそこにもう一つ付け加えたいと思います。それは、ただ「見る」だけでは不十分だということです。見ることは、行動し、学ぶためにあるのです。私たちがこの世界で3次元空間と時間を通じて行動することで、学び、そしてよりよく「見て」行動する方法を身につけていきます。自然は、空間知能によって支えられた、この「見ること」と「行動すること」の好循環を生み出してきたのです。

あなたの空間知能が常に何をしているのかを説明するために、この写真を見てください。もし「何かしなくちゃ」と感じたなら、手を挙げてください。この一瞬の間に、あなたの脳はこのグラスの形状、3D空間での配置、それがテーブルや猫、その他すべてとの関係を見て、次に何が起こるかを予測しました。この「行動したい」という衝動は、空間知能を持つすべての存在に内在しています。知覚と行動が結びついているのです。AIをさらに進化させたいのであれば、見ることや話すことができるAIだけでなく、行動できるAIが必要なのです。

確かに、私たちは非常に興奮する進展を遂げています。空間知能の最近のマイルストーンにより、コンピューターが「見る」「学ぶ」「行動する」、そしてそれらをより良くできるように学ぶ力が向上しています。これは簡単なことではありません。自然が空間知能を進化させるのに数百万年を要しました。目が光を取り込み、網膜に2D画像を投影し、脳がそれを3D情報に変換するという複雑なプロセスに依存しているからです。最近、Googleの研究者たちが、複数の写真を3D空間に変換するアルゴリズムを開発しました。ここでお見せしている例のように、私の学生と共同研究者たちはさらに一歩進み、1枚の画像をもとに3D形状を生成するアルゴリズムを作り上げました。ここにさらにいくつかの例があります。

以前、人間の文章を映像に変換できるプログラムについて話しましたね。ミシガン大学の研究者たちは、その文章を3Dの部屋のレイアウトに変換する方法を考案しました。こちらに示されているような例です。また、スタンフォード大学の同僚や学生たちは、1枚の画像から無限に現実的な空間を生成し、視聴者が探索できるアルゴリズムを開発しました。これらは、未来の可能性を垣間見せる最初の芽生えです。人類が私たちの世界全体をデジタル形式に変換し、自然が私たちの心の中で暗黙に作り出した豊かさや微妙なニュアンスをモデル化できる未来です。空間知能技術は、私たちの集団的な意識のためにこれを実現できるかもしれません。

空間知能の進展が加速する中で、この好循環の中に新しい時代が目の前で展開されています。この「見ること」と「行動すること」の相互作用が、ロボット学習を促進しており、3D世界を理解し、相互作用するために必要なあらゆる具現化された知能システムにとって重要な要素です。10年前、私の研究室が開発したImageNetは、数百万枚の高品質な写真を使ってコンピューターが「見る」ことを学ぶ助けとなりました。今日は、同じことを「行動」についても行っています。コンピューターやロボットが3D空間でどのように行動すべきかを学ぶために、静的な画像を集める代わりに、私たちは3D空間モデルを使ったシミュレーション環境を開発しました。これにより、コンピューターは無限のバリエーションを持つシナリオで行動を学ぶことができます。ここにお見せしているのは、私の研究室が主導する「BEHAVIORプロジェクト」でロボットに教えているほんの一部の例です。

ロボットの言語知能においても、大規模言語モデルを活用した入力による素晴らしい進展を遂げています。私の学生たちと共同研究者たちは、口頭での指示に基づいてさまざまなタスクをこなすロボットアームを初めて実証したチームの一つです。例えば、引き出しを開けたり、充電中のスマートフォンを抜いたり、パンにレタスやトマトを使ってサンドイッチを作り、さらには利用者のためにナプキンを置くことまでできるのです。個人的には、もう少し具材を追加したいところですが、これは素晴らしいスタートです。

太古の海で、環境を「見る」能力が他の生命との相互作用を引き起こし、カンブリア爆発が始まりました。今日、その光はデジタルの知能にも届いています。空間知能は、機械が互いにだけでなく、人間や3Dの世界(現実であれ仮想であれ)とも相互作用できるようにしています。この未来が現実となるにつれて、多くの人々の生活に深い影響を与えることでしょう。

医療を例にとってみましょう。過去10年間、私たちの研究室は、AIを活用して患者の治療結果に影響を与える課題や、医療スタッフの燃え尽き症候群を軽減するための最初の取り組みを行ってきました。スタンフォード医学部や提携病院の共同研究者たちと協力し、手を適切に洗わずに患者の部屋に入る医療従事者を検知したり、手術器具を管理したり、患者が転倒などの身体的リスクにさらされている場合にケアチームに警告を送るスマートセンサーを試験運用しています。これらの技術は、一種の「アンビエントインテリジェンス」と捉えています。まるで追加の目のように、現場に違いをもたらす存在です。しかし、私は患者や医療従事者、そして介護者のために、さらにインタラクティブな支援を提供したいと考えています。彼らには、もう一組の「手」が本当に必要なのです。

想像してみてください。自律型ロボットが医療物資を運び、介護者が患者に集中できる未来や、拡張現実が外科医をサポートし、安全で迅速、そして低侵襲手術の可能な世界を。また、重度の麻痺を持つ患者が、まさにその通り、脳波を使ってロボットを制御し、日常的なタスクをこなす姿も想像してみてください。私たちが当たり前に思っていることを、彼らが脳の力で実現できるのです。

ここでお見せしているのは、私たちの研究室で行っているパイロットスタディの一端です。最近のこの映像では、ロボットアームが、EEGキャップを使って非侵襲的に収集された脳の電気信号だけで、すき焼きを調理しています。この未来の一端をご覧いただいています。

約5億年前、視覚が誕生したことで、暗闇に包まれた世界は一変し、動物界における知能の進化という最も深遠な過程が始まりました。この10年でAIが遂げた驚異的な進歩も同様に目を見張るものですが、その本当の可能性が発揮されるのは、自然が私たちに与えたように、空間知能をコンピューターやロボットに搭載したときだと私は信じています。私たちのデジタルパートナーに、この美しい3D空間で学び、推論し、そして相互作用する方法を教えるのは、非常にエキサイティングな時代です。それだけでなく、私たちが探検できる新たな世界を創造していくことも可能になります。

この未来を実現するのは決して簡単ではありません。私たち一人ひとりが慎重なステップを踏み、人間を常に中心に据えた技術開発が求められます。しかし、もしこれを正しく進めることができれば、空間知能を備えたコンピューターやロボットは、単なる便利なツールにとどまらず、私たちの生産性と人間性を高め、個々の尊厳を尊重しながら、私たち全体の繁栄を引き上げる信頼できるパートナーとなるでしょう。

私が未来について最も興奮するのは、AIがさらに知覚力を高め、洞察力を持ち、空間認識を備えた存在として、私たちと共に歩む未来です。そんなAIが、私たちと協力し合い、世界をより深く理解し、探索し、新たな可能性を開いていく姿を想像すると、非常にワクワクします。

<オリジナル・コンテンツ>

オリジナル・コンテンツは、以下リンクからご覧になれます。

尚、本投稿の内容は、参考訳です。また、意訳や省略、情報を補足したコンテンツを含んでいます。

(1)インタビュー[9/13]

Bloomberg Television

(Original Published date : 2024/09/13 EST)

(2)TED トーク:「空間知能」について

TED

(Original Published date : 2024/05/16 EST)

<御礼>

最後までお読み頂きまして誠に有難うございます。

役に立ちましたら、スキ、フォロー頂けると大変喜び、モチベーションにもつながりますので、是非よろしくお願いいたします。

だうじょん

<免責事項>

本執筆内容は、執筆者個人の備忘録を情報提供のみを目的として公開するものであり、いかなる金融商品や個別株への投資勧誘や投資手法を推奨するものではありません。また、本執筆によって提供される情報は、個々の読者の方々にとって適切であるとは限らず、またその真実性、完全性、正確性、いかなる特定の目的への適時性について保証されるものではありません。 投資を行う際は、株式への投資は大きなリスクを伴うものであることをご認識の上、読者の皆様ご自身の判断と責任で投資なされるようお願い申し上げます。

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?