Sonyのモーションキャプチャー「mocopi」をつかってみた(後編)〜徹底検証!mocopiで出来ること

こんにちは、デザイニウムのCGクリエイターの秋山です。

Sonyのモーションキャプチャーmocopiを使用しておおよそ1ヶ月と少し経ちました。この間に、様々なモデルにmocopiを適用して動かしてみました。

はじめに

どんなキャラでも、頭と手と足があるキャラクターであれば簡単にセットアップし動かす事が可能なので、苦労せずにすぐに試せるのがmocopiの面白い点の1つですね。

こうして動かしていると、段々と出来ることと苦手なことも分かってきました。この記事では、mocopiを動かしてみて感じた特徴や得手不得手をご紹介しつつ、さらにこんなことに応用ができるのではないかというアイデアも挙げていきます。

前半ではmocopiをUnityと連携して使用する手順をご紹介しました。もしmocopiを入手したけれども試せていない / 動かせていないという方がいましたら、まずは前編記事からご覧ください。

検証項目

mocopiを試してみると、注目すべき点は大きく以下の3つに分けられます。

1.環境

mocopiは慣性式のセンサー、かつ無線でスマートフォンと通信を行うことで各部位のモーションを取得します。そのため従来の光学式モーションキャプチャ(OptiTrackのような身体にマーカーを取り付けて撮影する手法)とは異なり、屋外でもモーションキャプチャーが可能です。

それでは大体どのくらいまで離れてモーションキャプチャが出来るのか、それは実用的な距離かどうかを見てみました。

2.速度

次に速度についてです。最もモーションキャプチャーの性能を問われる部分は、どんなスピードでも正確にモーションを取れるかどうかと思います。

例えば、スポーツの分野でフォーム解析にモーションキャプチャーを使うこともありますし、もしmocopiでも同様のことが出来るのであれば、3DCGのキャラクターを動かすだけではなく様々な分野への応用も考えられます。

そういった視点も踏まえ、どんなスピードの動作にも適応しうるのかという点を確認しました。

3.移動

そして移動について。モーションを取得する際には単にその場でのモーションを取得するだけではなく、横から歩いてきてなにかポーズを取ったり、動きながらポーズを決めていくというモーションもあります。この移動が正確に取れると、できるモーションの幅も広がります。

また単純に横の移動の範囲の広さというだけではなく、例えばジャンプや階段を上下するなどの垂直方向にも対応できれば、その分またモーションの幅も広がるので、その点も見ていきたいと思います。

検証結果

1.環境

mocopiを使用する環境は屋外よりも屋内のほうが精度も高くなる印象でした。とはいえ、屋外でも大体スマートフォンから直線距離でおよそ4mくらいまで取得ができます。

ただし、屋外環境の場合は周囲の状況によっても少し差異があります。例えば調整池に設置された公園のような、周囲に壁があるような環境だと4mよりも距離が伸び、周りに遮蔽物のない開けた公園の広場の場合は4mでセンサーの取得が不安定になるラインでした。

前者の環境は周りにスマートフォンなどで通信を行っている人が殆どおらず、逆に後者の環境は複数名いる状況だったため、周囲の電波の有り無しによっても変化している可能性もあります。ただ少なくとも、周囲の環境から影響を受けることがあるので、予めmocopiを使う前にどこまで離れてもセンシングが出来るかどうかを確認しておくと良いでしょう。

2.速度

まず、高速な動作のモーションキャプチャについてですが、その動作が一回きりのアクション、例えば物を投げるとか蹴るとかといったアクションの場合、何回か試せば一回はある程度高い精度で取得できるかなというところです。しかし、スピードが速いとどうしてもどこかの部位がカクついたり、位置がズレるような挙動を見せる事が多いです。

さらに、これが連続の動作、例えばパンチを連続で行うなどの場合、どこかの部位のセンシングがうまく行かなくなり、カクつきや位置のズレが段々と酷くなって最終的に人の形ではないようなポーズになってしまったため、これは難しいかなという結論です。

では遅い動作なら大丈夫かというと、そこにも弱点はあります。低速すぎるとセンシングに必要なスピードが足りないのか、例えば手をまっすぐ上に上げた時に、ゆっくり上げた場合はひじが曲がったままになってしまうことがよくあります。これを勢いよくスピードを付けてまっすぐ上げると正しい腕の動きになります。

そのため、"低速すぎず高速すぎず"という速度感で動きが常時ある状態が、mocopiにとっては一番の得意な領域と言えるかと思います。ある程度慣れてくると、mocopiにとって取得しやすいメリハリのある動きも分かってくるので、自分がmocopiの仕様に寄せて動けるようになります。ですので、自分で動きを作れるようなダンスや演技の動きなどは、mocopiの仕様に合わせながら動いてみると、意図したモーションにできるかと思います。

3.移動

移動可能な範囲については、環境の項目で記載したスマートフォンから直線距離4mという数字がそのまま移動可能な範囲と言えます。この4mという広さは一人でなにかする分には十分な広さ、複数人でなにかするには少し狭いという印象です。メジャーで測って動き回ってみると実際に体感できるかと思います。この4mの中であれば、歩き回ることが出来、かつその動きもきちんとモーションに反映されるので、水平方向の移動については十分なクオリティが得られると思います。

弱点なのは垂直方向の動きで、例えばジャンプを一回した程度であれば問題ないのですが、階段を登ってみると、一段上に上ったのにも関わらず垂直位置が変わらない(水平移動はしている)という挙動を見せます。それは何段上ったとしても同じで、例えば右足を上げて、段に足をかけるところまではモーションとして取得できますが、それから身体を一段上に持ち上げると、元いた位置に戻ってしまうようなモーションになるので、垂直はほぼ取れないと考えたほうが良いです。

その他備考

座る・寝そべる

赤外線カメラでの姿勢推定、例えばKinectなんかのデバイスでは取得が難しい“座る”、“寝そべる”といったアクションも、mocopiであればきちんと取得ができます。

とはいえ、頭と腰のセンサーは身体の背面に取り付ける関係上、仰向けに寝そべると床に押し付けることになります。単純に身体にめり込んで痛いというのと、これによってセンサーに体重を乗せる面で不安でもあり、かつセンシングが切れることもたまにあるので、やり方は工夫が必要です。

手の指

手の指にはセンサーが付いていないので、当然と言えば当然ですが指先までのトラッキングは出来ません。この点が、例えばダンスや演劇などで、どんなにきれいなモーションを取ったとしても指先の動きが固いとしなやかさのない動きに見えてしまうということがあるかもしれません。もしこの用途で使用を検討するならば、手のモーションだけ別個でキャプチャする機材を用意するか、Blenderなどでモーションを手付で付けるか、擬似的にモーションに合わせて指の動きを連動させるようなスクリプトを組むかといった選択肢と組み合わせて使うことになるかなと思います。

キャリブレーション

大体4~5分程度連続使用していると、段々とモーション上の身体の正面がずれてくる傾向があります。

ポーズリセットあるいは再キャリブレーションを行えば解消するのですが、例えばダンスを踊っていて途中でリセットが出来ないような環境下ではそれができないので、連続使用は3~4分がベストかなと思います。

考察

一言で言えば「日常レベルの動作では問題ないが、専門性のある動きまでは難しい」という言葉でまとめられるかと思います。

例えば、スポーツ分野での活用はまだ難しいです。センサーが身体の素早い動きに追いつかないことが理由です。かといって、筋トレやヨガといったその場で高速に動かないものであれば大丈夫かというと、今度は動きが遅すぎるので、おそらく動きを取得するための動作量が足りないことから、やはり正しいモーションが取れません。

ダンスはプロモーションにも使われている事もあって、7~8割くらいは問題なくとれるかなという体感です。ただ、出来るダンスと出来ないダンスはあります。やはりこちらもセンサーが追いつかないほどの速い速度のダンスは取れませんし、mocopiのセンシングにとって苦手な姿勢というのもあります。事前に分かればそのポーズを別のポーズに置き換える事はできるかと思いますし、詳しい方がいればそのポーズのときだけプログラム上で補正を掛けることもできます。収録形式であれば、あとからポーズをBlenderなどのCGソフトを使って修正するという事もできるので、精度を上げる余地とカスタマイズ性は十分にあるかなと思います。演技についても上記とほぼ同様のことが言えます。

逆に、できることを考えていくと、YouTubeで配信をしたり、VRChatにログインして他ユーザーと交流をしたりといった用途で現状使われていることが多く、この分野では強いかと思います。「細かい部分では違う動きだったとしても、大まかな動きとしては何をしているかが伝われば良い」というレベルのモーションがあればいいというところには十分すぎるくらいの能力を発揮してくれると思います。

ここまでのことを踏まえるとmocopiという製品自体が「出来ないことを出来るようにする」というよりも、「その値段と手軽さで多くの人に出来る環境を広げる」ことに舵を振った機材であると考えられます。

ただ、mocopiの良いところはモーキャプが簡単・手軽なこと以上に、Unityを使って他の技術と組み合わせることができるカスタマイズ性が高いことだと思います。ですから、mocopiで新たな領域を切り開くというよりも、今までに組み合わせたことのないジャンルと結びつけて、新たな表現、例えば配信手法だったり、VR上でのコミュニケーション、あるいはゲームなどを考えていけるかなと思います。

実例

それでは実際にどんな組み合わせが考えられるかを、実際の作例と交えながら見ていきたいと思います。せっかくなので、あまり組み合わせた例がないものを作ってみました。

AR×mocopi

まずは弊社のMattが作成したARコンテンツです。

VTuberのキャラクターに自身のモーションを反映させて、ARで現実空間に表示します。

trying out #mocopi as a way to control an avatar in #AR, maybe could use it for #Vtuber walk-abouts 🤔#AugmentedReality #designium pic.twitter.com/hkpkMd1gKb

— mechpil0t (@mechpil0t) March 2, 2023

用途として2種類考えてみました。

1つ目は、VTuberの外ロケ用撮影ツールとしての活用です。外ロケをしようと思ったら、「自身の身体は映さない」「映しても身体だけ映して、顔は後で編集で合成」「何もない風景を撮影しておいて、そこに全身のモデルを合成した映像を後で作る」といった形にどうしてもなってしまうケースが散見されました。私はVTuber関係に疎いので、それでも凄い工夫してるなと思うのですが、こういったツールを組み合わせることで、より現実感が増した映像を作っていけるツールとして機能し得るのではないかと思います。

また2つ目は、このツールをVTuberのファン側も使えることで、一緒に散歩できるような体験を得られるコンテンツとしても使えると思います。

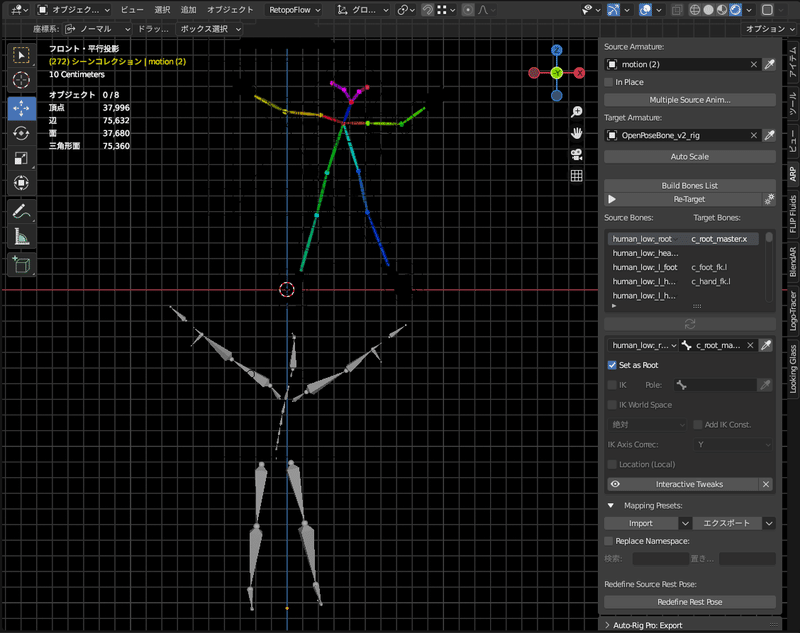

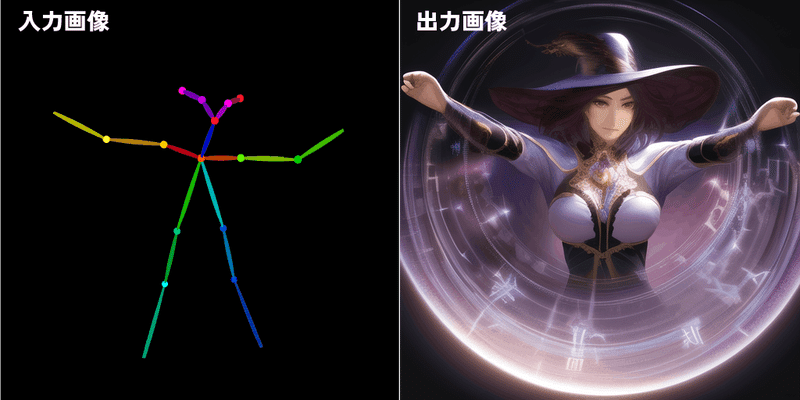

AIイラスト(Stable Diffusion)×mocopi

AIがイラストを描けるようになり、日に日にその精度を増しているわけですが、最近ControlNetという手法を使ってイラストのポーズ指定ができるようになったのをご存知でしょうか。

簡単に言えば、ポーズ専用の画像を用意することで、イラストに描かれる人物がそのポーズに従った状態になってくれるという仕組みです。今まではポーズもテキスト(プロンプト)で指示する必要があったため、欲しいポーズに中々ならないということがあったのですが、この技術によってイラストの精度がより上がりました。このポーズ指定を自分で描いたり、写真を用意したりという方法もありますが、mocopiで自らポーズを取ることで自分の描きたいイラストに出来るのではないかというアイデアです。

画像の上にあるカラフルな棒人間がAIに指示を送るためのもので、その下にある灰色の骨格がmocopiで取得したモーションです。

これを使ってAIに指示して、ファンタジー風の人物を出力するように指示したら以下のようになりました。足元は隠れてしまいましたが、上半身はほぼ同じポーズを取ってくれています。さらにここからプロンプトやパラメーターを調整していけば、さらにハイクオリティな画像に近づけるはずです。

この手法の良いところは、自分で取ったポーズのアングルを後から編集できること。それからモーションデータは複数フレームに渡って記録されているので、アニメーションも作ることが出来る点にあるかと思います。移り変わりが激しい分野なので数カ月後には違った展開を見せているかもしれませんが、モーションキャプチャーが手軽にできるとこういう用途にも応用が効いてきます。

バーチャルカメラ × mocopi

ここまでだいぶトリッキーなアイデアになってしまったので、最後にシンプルなアイデアの作例をご紹介したいと思います。

最後はバーチャルカメラという風に題しましたが、つまりは自分の動かすアバターにUnity上のカメラを持たせて映像を撮影するという形で、カメラのコントローラーとして自分のモーションを使うアイデアです。

mocopiでCG空間をハンディカメラ撮影したテスト。

— 秋山 智哉 / AKIYAMA Tomoya (@AtomAkym) March 7, 2023

手ブレがスマホで撮影したみたいなチープさを生み出してくれて面白い効果になるね。

CG映像はカメラワークがなめらかになりがちだから、あえてこうやって粗さを足すのも1つの手法かも。#Unity #mocopi #designium pic.twitter.com/TP5UBUNwNP

まるでスマホで撮ったかのような手ブレが映像に加わります。CG空間だとカメラがブレるということは、わざとそのようにカメラの動きを設定しない限りは起こりえません。このようにブレがCG映像の中に加えると、斬新かつ、馴染みのあるような映像に出来るのではないでしょうか。

また右手にマウスを持って、コントロールホイールとクリックに機能を割り当てることによって、より複雑な撮影を実現することが出来ます。マウスホイールをズームイン・アウト、左クリックを録画開始 / 停止、左クリックをフォーカスとするだけでも面白い映像が作れるようになると思います。

最後に

ここまでmocopiについて様々な言及をしてきましたが、モーションキャプチャがここまで安価になって、かつこの性能が出来るのは凄い!ということは改めて言及しておきたいと思います。

もちろんmocopiにもまだ不得意な分野はあります。しかしその不得意な部分をクリアしているモーションキャプチャ機材を探すとなると、何千万とするモーションキャプチャ機材を使わなくてはならないわけですから、これが5万円で出来るというのは何度見ても不思議に思う限りです。

しかし、これでmocopiが終わりというわけではありません。これからさらにmocopi Mobile SDKというスマートフォン用のSDKが発表されます。またアップデート等を通して、さらに性能の向上が期待されます。この先、多くの人の心を掴むコンテンツが発表されて、一切開発どころかモーションキャプチャーは知らないんだけど、そのコンテンツを遊ぶためだけにmocopiを買ったという人が現れる未来もあるかもしれません。そんなモーションキャプチャーが手近に、手軽になる未来の一歩に、このmocopiがあるんじゃないかと思わせてくれるような機材だなと思いました。みなさんもぜひぜひ、mocopiを使って、いろんな体験を作ってみてください。それではまたお会いしましょう。秋山でした~。

編集後記

こんにちは!広報のマリコ(@marikocco)です。mocopiの検証編いかがだったでしょうか?記事内で秋山が可愛いキャラクター達を動かしていましたが、以前社内で本格的なキャプチャーをした際もカワイイ動きや子供のポーズなど簡単なしぐさでも難しい❗という声があがっていました。Vtuberの方をはじめ、mocopiをつかった身体の動かし方も参考にして頂けたのではないでしょうか?😊こんなに手軽にキャラクターを自由に動かせるのは楽しそうですよね😺✨今後スマホにも展開されるということで、アップデートが楽しみですね🎶ぜひみなさんも機会があれば挑戦してみてください😉

The Designium

Official website

Twitter (フォローお待ちしてます✨)

Facebook

Youtube

この記事が気に入ったらサポートをしてみませんか?