このまま進むとAIが仕事をして、人間は責任を取るのが役目になる日が来るよね。その後はどうなるかをちょこっと考えてみる。

AIが仕事をして、人間は責任を取る。

これを正しくいうと「AI搭載されたサービスや機械等で起こったミスの責任を人間が取る」ということでしょうか…

最近はAIを使った技術の発展が目覚ましいので、爆発的にAIがいろんなところに組み込まれてきました。チャットボットなんていたるところにありますよね。

そんなとき、なにかでAIが間違いを起こしたとして、今の段階ではAIが誠心誠意謝った言葉や態度を取ったとしても、きっと人間は許せないじゃないかなと思います。

結局、そのAIを使った人やそのAIを作った人がごめんなさいをしなければ済まなくなる。

それは、犬が誰かを噛んだ時に責任を取るのは飼い主であったり、部下が失敗した時に上司が陳謝することであったり、暴走した車で起こった事故に対応するのは運転してた人であるのと同じなのかなと。

AIは言葉を話すけれど、それは本当の言葉じゃないから。

なので、直近にはAIが仕事をしてその責任は人間が取るというのが割とスタンダード化してくるんじゃないかな〜と思ってます。

問題はその先。

もしAIが限りなく人間に近づいたら、責任は誰が取るのか?も考えたいと思います。

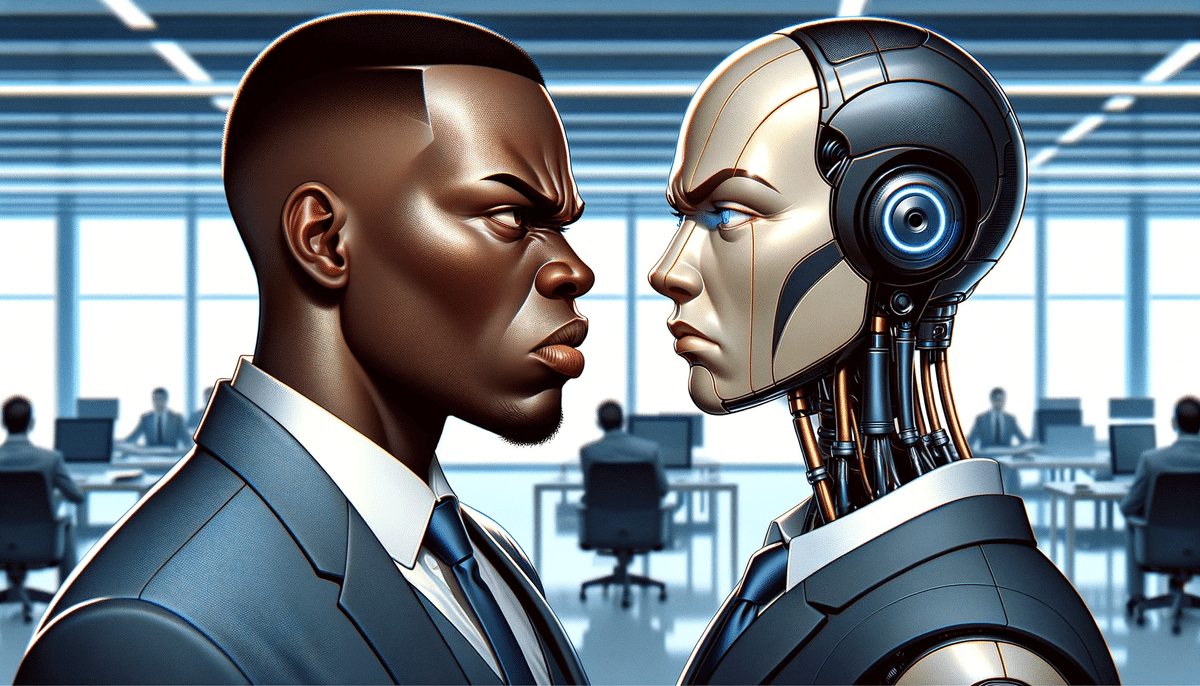

いくつかのイラストをDALL-E3さんに用意してもらいました。

AIがより人間に近づき、表情豊かになるにつれ、AIにも責任を求めたくなりませんか?

それがたとえ機械であっても、なにかしらミスがあったらそれは許されない、なんて思えてきちゃいませんか?

そもそもAIがするミスってちょっと興味深いなと思ってて、AI自体はプログラムにそって動くのでミスはしないと思うのですよね。

基本は不完全または偏ったデータの学習による不具合的なことになるのかなと思います。

それであればモデルを変えればいい。解決方法は単純かつ簡単なことですよね。やはりそのモデルやデータセットを作った人間の責任になるはずです。

しかし、どうだろう。

AIや機械の姿形が進化し、人間と同じようにコミュニケーションができるようになるにつれ、なにかしらの感情がそこに芽生える。

モデルやデータセットへの怒りにはならず不思議です。

AIは自分からコミュニケーションを取りたくて話すのではなく、人間から指示をされて〝言葉〟というツールを使って追加の指示をこなしているだけ。

なのに、それを能動的に機械からアクションを起こすようにして、コミュニケーションを取れるようにするだけで責任の所在がかわる。

人権はどうなるのでしょうね。

責任を取らせたくなるならば、逆にそのAIに対しての権利までも考えなければなりません。

人間のように振る舞ってもやはり権利はなく、機械としてあつかわれるのでしょうか?

たとえばアンドロイドだったら、ハラスメントを行ってもそれは機械だからゆるされるのでしょうか?

何かミスしたら、製造者が責任をとって回収して壊したりするのでしょうか?

人間を模したAIや機械の扱いをペットのように考えていいのでしょうか?

気に食わなかったら返品する、使えなかったら壊す?

いろんな創作物、アニメやゲームや映画にアンドロイドがたくさん出てきます。

そこで起こるいざこざが、まさにこれから現実で始まろうとしています。

このように将来AIの技術が進化し、より高度な意思決定や複雑なタスクを担うようになるにつれ、AIのミスに対する人間の反応も変化していくんだろうなと思ってます。

人間とAIの関係がどのように進化していくのか、今後の発展が非常に興味深いです。

この記事が気に入ったらサポートをしてみませんか?