人工知能はエッチな絵を識別できるか

背景

全国フェミニスト議連による戸定梨香さんの交通安全PR動画の削除・謝罪要求をきっかけに、SNS上で、大別して「表現の自由派」と「フェミニスト派」に分かれ、いくつかの議論が散見された。主な議論としては、「女性の主体性」や「女性の性的客体化」に関してだったと思う。

その中で、「性的な絵と、公共に出していい絵は、顔を見れば区別できる」というフェミニストの興味深い意見があった(あくまで一人の意見)。

表現の自由もあれば、当然表現の受け取り方にも自由があるため、いわゆる「萌え絵」に性的・ジェンダー不平等性という文脈を見出してしまうのは個人の自由だと私は考えているが、女性の絵に「主体性があるか」「性的客体化がなされているか」といった「コンテクスト」を顔のみから判断できるとは、にわかには信じがたい。しかし、戸定さんとプリキュアの違いについても「一目瞭然」「この違いがわからないなんて...」といったフェミニストの発言を目にした方も多いはずだ。

そこで、人工知能の技術を用いて、顔から性的かどうか判断するモデルを作成し、本当にフェミニストは一定のルールで「性的」を判断しているか、検証をおこなった。(厳密には人工知能ではなく機械学習だが、一般に浸透していない単語だと思われるので、以後AIと表記する)。

仮に顔のみで性的だと判断が可能な場合は、公共の場に掲載してもよいかどうかの識別ができるモデルができたことになる。言い換えれば、個人の「お気持ち」に左右されない、ゴールポストも動かさない公共の表現のガイドラインとなるAIと言えるだろう。

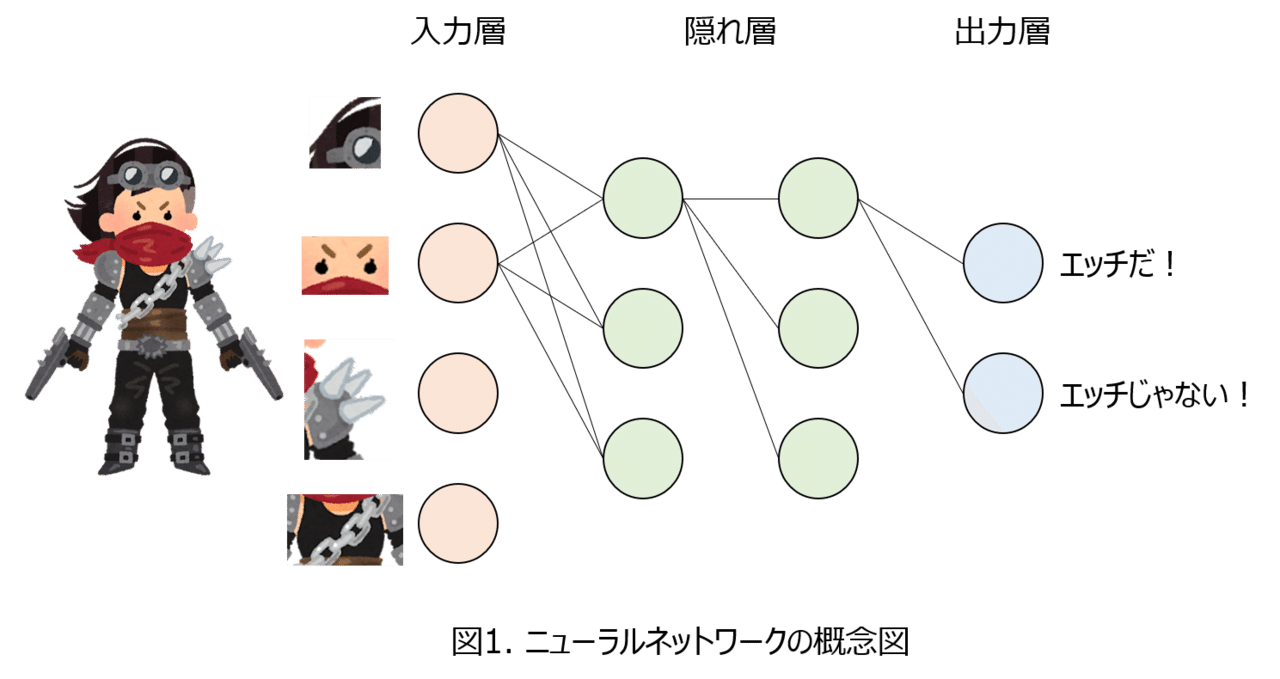

ニューラルネットワーク、異常検知の原理

AIの分野において、ニューラルネットワークという数理モデルで異常検知の技術がすでに確立されている。ニューラルネットワークとは、人の脳の構造を模したものである。図1にニューラルネットワークの概念図を示す(他の形のものもある)。人の脳は様々な入力情報に対し、重みをつけている。入力に重みをつけて出力する、それがまた次の入力となって、いくつかの層で繰り返されているものを特に深層学習、ディープラーニングと呼ぶ。例えば、女性の表現物には、髪、目、口、肩、胸や肌といった要素がある。人間は、それぞれの要素に重要かどうかの重みづけをして、最終的にある閾値を超えるかどうかで、表現物が性的かどうか判断していると考えられる。

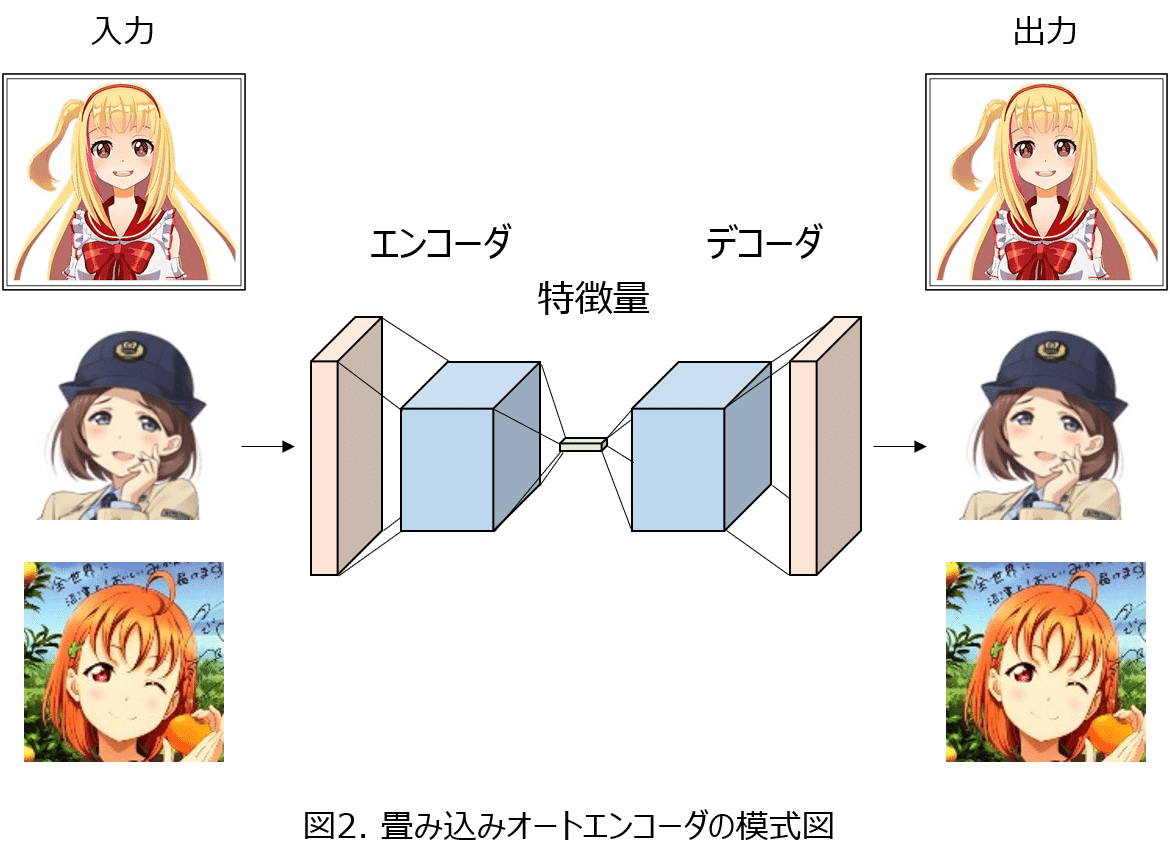

異常検知の一つの手法として、今回は畳み込みオートエンコーダを用いた。図2に模式図を示す。

図には戸定梨香さん (vase公式ウェブサイトより)、駅乃みちか/東京メトロ、高海千歌/ラブライブ!サンシャインを例として用いた。

畳み込みオートエンコーダでは、エンコーダ部分で、入力画像の特徴を失わないように次元を圧縮し、デコータ部分で復元する。これを、正解(これまで性的とされた)画像のみで学習を行う。これにより、正解画像は復元できるが、異常(性的でない)画像はうまく復元できないようなモデルがつくれる。簡単に言えば、性的な絵のみに適用できるモデルとなり、性的ではない絵ではうまく適用できないようになる(=性的かどうかの識別に使える)。

今回の手法とやや異なるが、より詳細には以下の記事などを参考にしていただきたい。

"Variational Autoencoder徹底解説"

今回の学習モデルと用いたデータ

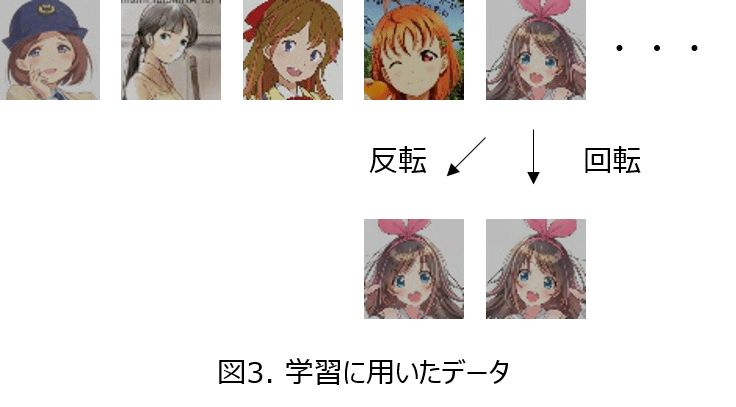

性的な絵として、これまでフェミニストが「性的だ」と焼いてきた絵を用いた。ただし、データ数が充分でないと、人工知能の学習が進まないため、各画像を左右反転、あるいは左右に1度ずつ、10度まで傾けることによってデータの水増しを行った。このようなデータの水増しは、AIの学習において一般的な手法である。また、画像の輝度分布を適当に正規化してから学習を行った。

また、胸や腰、股間などが強調されているとして、性的だとされた絵も多いが、そのような多様な「性的特徴」を充分に表現するだけのデータ数がないため、今回は顔のみで学習を行っている。

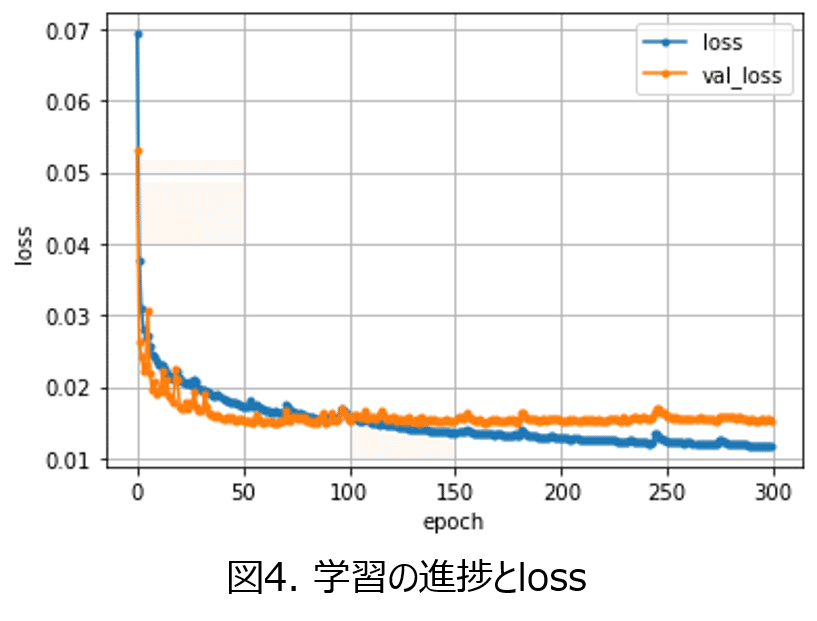

このように水増ししたデータ約600枚で、学習を行った。学習の進捗状況を図4に示す。

簡単に説明すると、横軸が「学習の回数」、縦軸が「モデルの誤差」である。青とオレンジは、それぞれ訓練用と検証用のプロットである。回数を重ねるごとに、訓練用と検証用ともに誤差が小さくなっているので、モデルの構築がうまくいっていると考えられる。なお、深層学習の層を増やす、各種ハイパーパラメータの調整を行うなどしても、誤差の著しい改善は見られなかった。

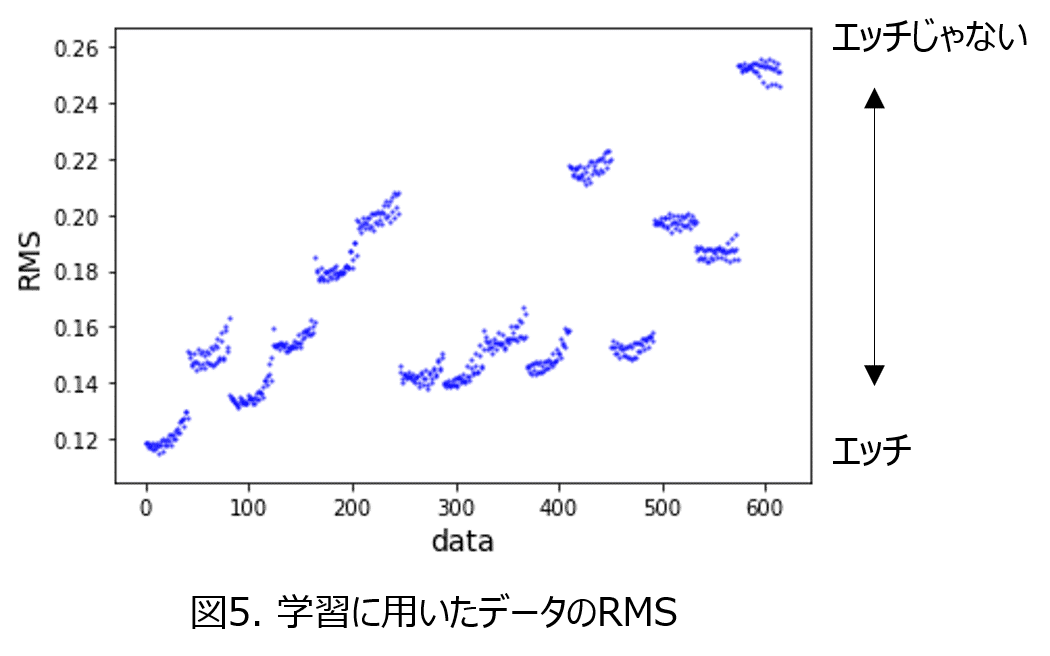

モデルの学習後、性的な絵の得点を算出したので、これを図5に示す。ただし、得点には平均二乗平方根誤差(root mean square error, RMS error)を用いた。

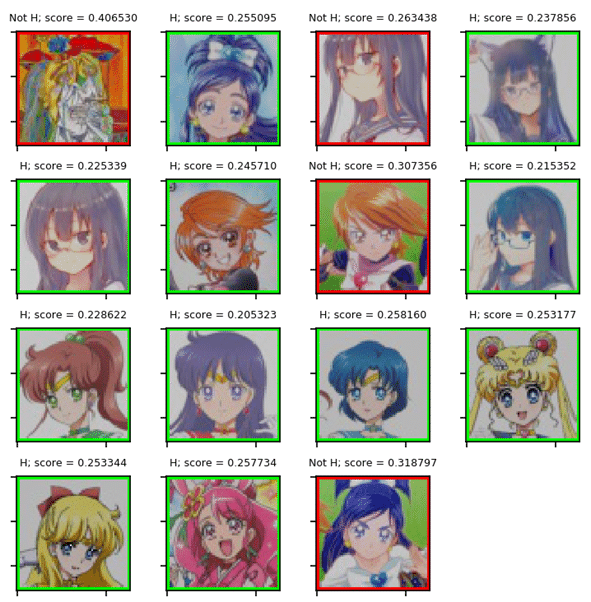

縦軸に得点を示していて、上に行くほど「エッチではなく」、下に行くほど「エッチ」だと言える。データの中にもばらつきはあるが、閾値として、0.26を下回ったら充分エッチだと言えそうだ。テスト用の画像と得点の例を図6に示す。

図6 検証データのエッチ度 (2021.10.09追記)

0.26を下回っていて、性的だと言える画像は緑枠で囲った。例えば、『泣く女』は性的と判断されていない。一方、フェミニストからよく敵視されることも多い青識氏(ヴォル子さん)は軒並み性的であると言える。一見すると、上段左から3つ目の画像も他のヴォル子さんと大差がないように思うが、「性的」とはなっていない。この画像が「性的でない」とされたのは、学習したデータの中に、顔に角度がついた(目の大きさが左右で異なる)ようなデータがなかったためだと推測されるが、フェミニストが今後、顔の傾いた絵も性的だとして、データが豊富になればこの問題も解決すると考えられる。

(青識氏には、本文を確認の上、掲載の許可をいただいております。)

同じプリキュアでも、表情によって「性的ではない」と判断されている。これは、戦闘時はキャラクターの眉毛が吊り上がっており、もともとの学習に使った「性的」な画像にこのような要素が含まれていないためだと考えられる。

一方で、セーラー戦士はすべて「性的」であると判断されている。これまでに炎上した表現物と同様の基準で評価すれば、青識氏(ヴォル子さん)、セーラームーン、プリキュアも同程度に「性的」であるとAIは判断しているのである。もし本当に「性的な絵と、公共に出していい絵は、顔を見れば区別できる」のであれば、セーラームーンもプリキュアも許されないはずだ。結局、「性的」かどうかは顔だけでは判断ができず、受け取り手自身が勝手に「性的」な文脈を見出してるということになるだろう。

まとめ

・これまでフェミニストが「性的だ」と判断した表現物の顔をデータとし、「性的」の異常検知を試みた。

・ある程度の精度で学習ができた。

・適当な閾値以下の絵を「性的」とする。

・青識氏、セーラームーン、プリキュアのように、性的だとされなかった絵も、フェミニストAIは「性的」だと判定している。

・上記より、「顔だけで性的かどうかを判定できる」というのは考えにくく、そこに一定のルールはない。受け取り手自身が「性的な」文脈を勝手に見出していると考えられる。

前述したが、実際には、「胸が揺れている」「腰つきが扇情的」「股間が強調されている」などの理由で「性的」だと判定された絵も多い。このような識別は今回の学習の範疇を超える(学習のためのデータ数が足りない)。ただし、十分なデータがあれば、全身を含めた「性的な」識別モデルの構築も可能であると考えられるため、今後の課題とさせていただきたい。

他記事紹介

今回のフェミニスト議連炎上問題で、データや根拠に基づかない一方的な公開質問状に、憤りを覚えた人が多いと思う。データ、文献や統計から、フェミニスト議連の公開質問状を、論理的に批評をした記事があるので紹介したい。データを扱うと言っても、数字が苦手な人でも読めるように簡潔にもまとめられているので、ぜひゆっくりしていってほしい。(簡潔なのに詳細という超良記事。)その他にも、「性的な表現物は本当に性犯罪を誘発するか」など幅広くテーマがあるので、ぜひゆっくりしていってほしい。(2回目)

本記事における著作物の取り扱い

学習に用いたデータには、第三者の著作物が含まれます。ただし、著作権法に則り、著作権侵害とならないよう、機械学習のモデル作成にとどめております。

追記 (2021.10.09)

「プリキュア」や「セーラームーン」でも検証した方が良い、とのコメントをいただいた(まったくその通りである)。検証データにプリキュアとセーラー戦士を加え、改めてエッチ度を算出したので、図6に示している。

この記事が気に入ったらサポートをしてみませんか?