自民党AIの進化と実装に関するプロジェクトチーム 内閣府「AI戦略と政府の取組状況について」

自民党では新たに「AIの進化と実装に関するプロジェクトチーム」(座長:平将明衆議院議員)を立ち上げ、日本のAI戦略のあり方や政策提言について検討が進められております。

こちらから、令和5年2月 内閣府 科学技術・イノベーション推進事務局 「AI戦略と政府の取組状況について」を拝見いたしました。

目標:AI利活用を支えるデータの充実

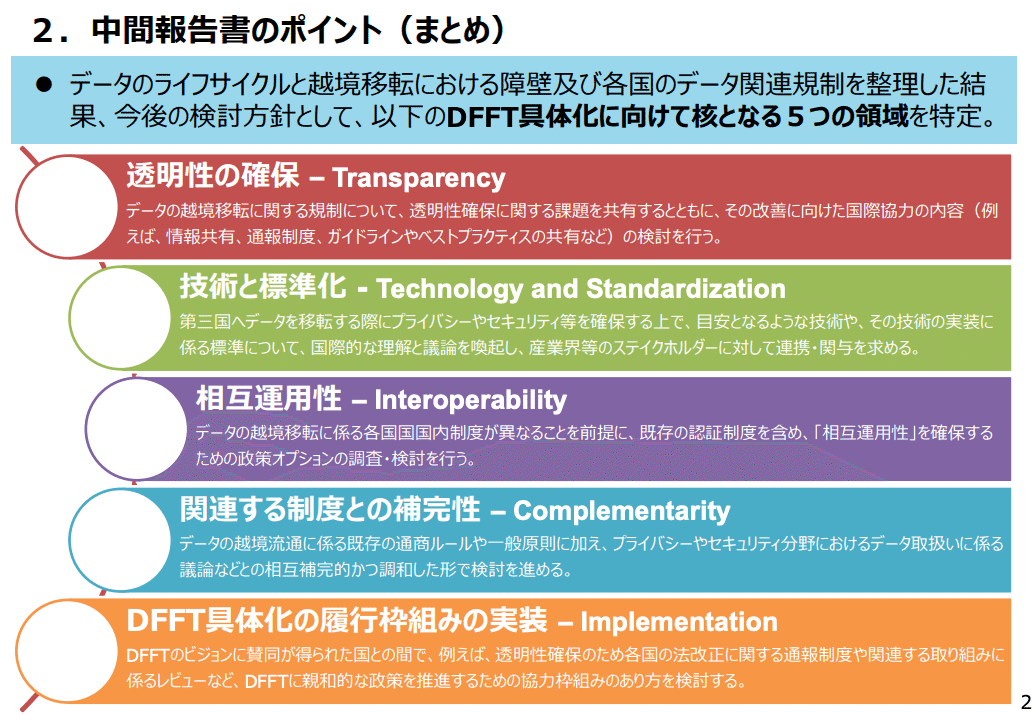

そこで、政策として、国際的に自由なデータ流通の促進するDFFT:Data Free Flow with Trustのコンセプトに基づく「国際データ流通網」をAIに広げていくことを提案致します。

透明性の確保(Transparency)

最近、AIは学習で量が質を変える現象「相転移」によって、計算量やデータ量が多いほど性能が劇的に向上することが分かってきました。

そこで、AIにおいて日本の国際競争力を維持するには、AIの学習データを国際的に流通するルールや枠組みとして整理していくことが必要です。

なお、データの越境移転に関する研究会でDFFT具体化に向けて核となる5つの領域が特定されておりますが、AIの学習データについて「透明性の確保」が必要だと考えます。

つまり大規模にAIの学習データを保有するGAFAMなどへアカウンタビリティを課すことです。

OpenAI は、Google に対抗するためのオープン ソース (私が "Open" AI と名付けた理由)、非営利企業として立ち上げましたが、現在はマイクロソフトによって管理されているクローズド ソースの最大営利企業になっています。

これは、私が意図したものではありません。

OpenAI was created as an open source (which is why I named it “Open” AI), non-profit company to serve as a counterweight to Google, but now it has become a closed source, maximum-profit company effectively controlled by Microsoft.

— Elon Musk (@elonmusk) February 17, 2023

Not what I intended at all.

GPT-4を紹介した98ページの論文では、トレーニングセットの内容については*何も*開示しないと誇らしげに宣言しています。

I think we can call it shut on 'Open' AI: the 98 page paper introducing GPT-4 proudly declares that they're disclosing *nothing* about the contents of their training set. pic.twitter.com/dyI4Vf0uL3

— Ben Schmidt / @benmschmidt@vis.social (@benmschmidt) March 14, 2023

ご参考までに、AIは学習で量が質を変える現象「相転移」についてはCentiv CEO北川拓也 氏が分かりやすくまとめております。

Google Characterizing Emergent Phenomena in Large Language Models

大規模言語モデルの創発的能力

標技術・標準化(Technology and Standardization)

データの越境移転を踏まえ、これまで DFFT 研究会で議論された透明性(Transparency)、セキュリティ(Security)、プライバシ ー(Privacy)と共に、信頼(Trust)が重要な要素になると考えます。

意図した反応を得るために情報をコントロールする方法が存在します。これは行動心理学、社会心理学、脳科学などの最新の知見をマーケティングに活用して商業利用してブレグジットとアメリカのトランプ大統領誕生させたケンブリッジアナリティカ事件など

ナッジ理論を応用したフレーミングやラベリング、アンカリングなどのテクニックを駆使して米空挺部隊 4th Psychological Operations Group のようなPSYOPすることがAIによって引き起こされる可能性があります。

こうした課題に取り組む上で重要なインセンティブ設計やキャパシティビルディングがプライバーのリスク・ベネフィット アセスメントです。

つまり、ナッジとスラッジを活用することで人の行動を制御できることから、プライバシーの利用にはリスクがあります。ただし、プライバシーは大切な個人の権利ですが、相手を信頼して活用することも必要です。

つまり、プライバシーにおける「信頼をゼロにする」というのは、製造における「在庫をゼロにする」のと同じことです。しかし、信頼および在庫は、業務の遂行に必要なものです。

ご参考になりましたら幸いです。

この記事が気に入ったらサポートをしてみませんか?