2024年3月の記事一覧

今更聞けないLLM解説まとめ⑤Fine Tuning

どうも、それなニキです。

今回も勉強を続けていきましょう。

いつものごとく、自分の思考まとめで読みにくいですがご了承ください。

また、最初からそうですが、基本的には松尾研のLLM Summer School 2023の内容を全面的に参照しています。

1.LLMにおけるFine-Tuningの位置づけまずはLLMを訓練していく上での流れを俯瞰してみましょう。

これまで扱ってきた「事前学習」は

今更聞けないLLM解説まとめ③事前学習

始めにどうも、それなニキです。

今回から本格的にLLMの仕組みを掘り下げていきます。

相も変わらず私の思考メモなので読みづらいですが悪しからず。

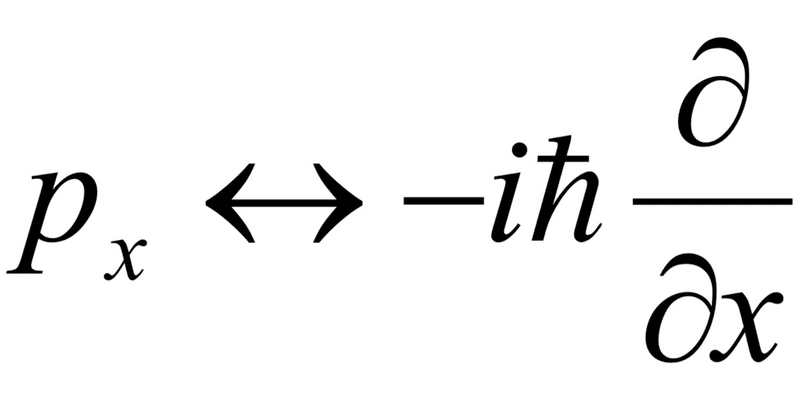

1.ニューラル言語モデルまずは、LLMを解説するうえで基礎となる言語モデル(LM)の構造から扱っていきます。

第一回でちらっと触れたと思いますが、言語モデルというもの自体はそれほど新しいものではなく、過去に様々なタイプが開発されてきています(n-