楽器演奏者にしかわからない、映像と音のずれを解消する

映像と音声を別々の機械で収録して、それをリアルタイムで合成させる場合、絵と音がずれないように対策をとる必要がある。音声より映像の方が扱うデータ量が多いので、どちらかというと映像の方が遅れがちだ。

映像はカメラ自体やスイッチャー等の機器を通すことで遅延が生じるので、どこかで音と絵のタイミングを合わせなればならなず、この映像と音声のタイミングを合わせることを「リップシンクを取る」などという。うちのピアノスタジオの場合は、指の動きと音に違和感がないように同期を取る必要がある。

楽器演奏の映像を見て、絵と音にずれがあると、演奏者は強烈な違和感を感じるが、これはなかなか、当人及び楽器演奏者じゃないとわからない。

もう20年以上前の話になるが、私も撮ってもらう側だったことがあり、あるミュージックビデオの編集が完成したというので映像スタジオに呼ばれて行ったところ、ギターを演奏している手の動きと音がズレていてとても違和感を感じたが、結局、修正してもらえずそのまま製品になってしまった。

あの時私は強く主張できる立場になかったし、監督さんは何がずれているのかを理解できなかった。

リップを取る作業は、感覚をたよりに「もう少し前に」「ちょっと後ろに」などと微調整していると、だんだん何が合っているかわからなくなってしまう。だから、システマチックな再現性のある方法で合わせる必要がある。

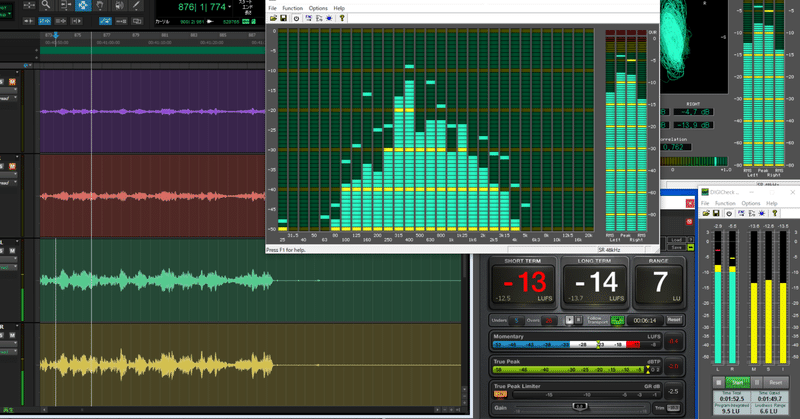

私は映像収録をするときに、音声ミキサー代わりにDAWを使用している。後々映像編集するのであればそこで修正もできるが、ライブ配信となると、そうはいかないので、スイッチャーアウトから出力されるプログラムアウト(完成映像)の時点で、絵と音のずれがないように調整している。

DAWはバッファサイズの設定やプラグイン処理などで遅延量に変化が生じる。なので、以前は使用するプラグインを固定して、一度シンク(同期)が取れたら、それをできるだけ崩さないように気を付ける運用をしていた。

しかしそれが足枷となって、音ズレを恐れるあまり、マスターチャンネルに新しいプラグインを刺すことをためらったり、既に刺してあるプラグインの設定に負荷が大幅にアップするような変更をかけることを躊躇してしまうのが嫌だった。

もっと自由にやりたい。その時々に「いい」と思った音の処理を、音ズレを恐れずに実行したい。

そんな中、2021年。自分なりにいい方法を確立した。

演奏者に演奏してもらっているうちに、音優先で自由にプラグイン処理をして、それで遅延量に変化が生じて(絵音がズレて)も、演奏中に作業を途切れされることなくそれを解消できる方法を確立できた。これは自分的にはとても進歩。

その方法を詳しくはここで書けないけど、スタジオではご提供します。

この記事が気に入ったらサポートをしてみませんか?