起業した博士学生がメタバースの研究開発で学んだこと

はじめに

こんにちは!GREE VR Studio Laboratory の研究インターン山崎勇祐です。東京工業大学の修士在籍中に触覚デバイス「Hapbeat」で起業して、現在博士5年目になります。このたび博士課程の最終段階に入るため、3年間インターンでお世話になった REALITY株式会社 GREE VR Studio Laboratory (以後、ラボ)を卒業することになりましたので、インターン中の思い出話を綴りたいと思います。これからREALITYやラボにジョインする方への参考になれば幸いです。

自己紹介

筆者の山崎勇祐は、東京工業大学 長谷川晶一研究室に所属している博士課程の学生です。東工大では私が発明した、モーターと糸を用いた振動生成機構の提案や、その機構を組み込んだデバイスを利用したアプリケーションについて研究しています。私の個人的な活動のモチベーションは触覚技術の利用を促進し、今あるコンテンツの体験をより楽しく、没入的にすることです。

そのための活動の1つとして、音楽をいつでもライブ会場やクラブハウスで感じるような迫力と臨場感で体感できるように、研究成果を用いてネックレス型触覚デバイス Hapbeat を開発し、商品化しています。

その製造販売のため、Hapbeat合同会社という会社を起業し、現在もこちらのページで販売したり、お試し用にこちらのページでレンタル(一部無料)も行っていますので、興味がある方はぜひお試しください!

東工大での研究については、主に Hapbeat について以下のような論文を投稿しています。

EuroHaptics 2016: Haptics: Perception, Devices, Control, and Applications

Tension-Based Wearable Vibroacoustic Device for Music Appreciation

(ポスター発表、ベストデモ賞を受賞)SIGGRAPH '17: ACM SIGGRAPH 2017 Emerging Technologies

Hapbeat: single DOF wide range wearable haptic displayIEEE Transactions on Haptics (2022)

Implementation of Tension-based Compact Necklace-type Haptic Device Achieving Widespread Transmission of Low-frequency Vibrations

(フルペーパー)

その他には国際学生バーチャルリアリティコンテスト IVRC 2015 で「もしも背中に羽が生えたなら」という作品を企画し、背中の羽で空を飛ぶような体験を表現することを試みて、決勝大会で展示しました(残念ながら受賞ならず…)

インターンでいちばん嬉しかったこと:

人気 VTuber に REALITY 公式番組内で研究成果(触覚)を体験してもらえた!

~VTech Challenge 2019 最終発表会~

時は2020年初頭、ACM SIGGRAPH Asia 2019 でオーストラリアの観客の拍手や歓声量を7000キロ離れた日本の出演者に触覚で届ける、という大掛かりなデモンストレーションを終え、次に何をしようかと考えていた頃でした。

インターン開始からこの時点までは、主に学術系の国際会議で発表やデモを行ってきており、それはそれでとても重要な活動であるのは間違いないのですが、元々所属していた長谷川晶一研究室で既に国際会議での発表を何度か経験していたこともあり、せっかくならもっと違った形で研究成果を発表したい、という気持ちがありました。

せっかく自社でスタジオを所有し、VTuber のプロデュースや番組制作まで手がける REALITY社所属のラボにいるので、VTuber さんにこれまでの触覚の研究成果を体験してもらって、その様子を放送できればなぁ…という旨を白井ディレクターに相談したところ、(私の視点では)トントン拍子にことが進み、人気 VTuber の「九条林檎」さん、「眠居ふわり」さんに試していただき、なんと REALITY の公式番組でその一部始終を放送していただけることに…ラボ凄い。

もちろん、これが簡単な話ではないのは重々承知です。普段から白井ディレクターが社内で色々な部署に所属する人と交友を広げ、丁寧な仕事をなされているからこそ実現出来たのだと思います。あまり人付き合いに積極的でない私にとっては胸に刺さります...ヒトヅキアイダイジ、オボエタ。

いざ VCI (Virtual Cast Interactive)開発!

今回公式配信で発表することになったのは、どんなアバターでも行うようなインタラクションかつ、触覚があることで大きな効果を発揮するであろう「バーチャル肩叩き」「バーチャル肩もみ」「バーチャルハグ」、空手家宇宙人 VTuber ふわりさん、をイメージした「バーチャル必殺技」、IEEE World Haptics Conference 2019、ACM SIGGRAPH 2019 で発表した触覚ナビゲーション技術「HapticMinesweeper」を応用した「バーチャル第六感」です。SIGGRAPH Asia 2019 Real-Time Live でバーチャルキャストを活用していたこともあり、バーチャルキャスト内で利用できるアイテム VCI を開発することで、これまでの研究成果を表現することになりました。

元々私が開発している Hapbeat は一般的な音楽に合わせて使えるよう、音声信号で駆動するようにしているので、アバターどうしが触れた時に触覚を提示する、といった実装は簡単でした(オブジェクトどうしのコリジョンを検知 ➡ 振動用の音声を再生)。

ただし今回は公式配信でお披露目するため、装着者に良い体験をさせるだけで良いわけではなく、触覚デバイスを装着しない視聴者が「傍から見て何が起きているかが分かる」かつ、「映像的に映える」ものでなければいけません。そこでとても役に立ったのがエフェクト制作ツール「Effekseer」です。

Effekseer は VCI で公式にサポートされていて、綺麗で派手なエフェクトを作成することができます。1から作るのは中々大変ですが、ユーザーの方から投稿された豊富なサンプルがあるので、それをアレンジすることで比較的簡単に自分好みのエフェクトを作成できます。Unity や UnrealEngine などマルチプラットフォームに対応していますので、映像に凝りたいかたはぜひ触ってみてください。

こうして見た目でも分かるよう開発した VCI について、次の動画でまとめたのでよければご覧ください。

番組収録

さて、ついに VTuber のお二人を REALITY スタジオにお招きし、番組収録です。生配信ではありませんが、当日スタジオに入ってから本番までの間は、開発した VCI や機材が問題なく動いてくれ…、と祈りながら最終確認を繰り返していました。この緊張感は大学の研究デモ発表とは一味違います。国際会議での研究デモであれば、関係者は自分含めて数人程度ですし、当日デモが動かない発表者もよく居るので、最悪動かなくてもその場で直せるように準備していけば大丈夫、くらいな心持ちで行くのですが、今回は自社のREALITYスタジオの制作による番組とはいえ、VTuber出演者のお二人やスタジオのスタッフさんを始め多くの方が関わっており、使える時間も有限です。万全なソフトウェアを準備していたとしても、万が一失敗してしまった場合、色々な方に多大な迷惑をかけてしまうことは勿論、技術の逆プロモーションになってしまっては大失敗です。今回は幸いにして大きなトラブルは起こらずに話題になる映像を作ることができたのでなかったので、その点では心底ほっとしました。初代iPhoneを新製品発表会でプレゼンしたような緊張感…と例えると近いかもしれませんね。

収録中、私は直接番組に出演はしませんでしたが、出演者の方々に Hapbeat を含めた機材の装着補助や、VCIアイテムの装着や操作方法などを説明する機会を得ました。Hapbeat が邪魔にならないかな、振動が不快でないかな、操作説明は分かりにくくないかな、今回開発したものを気に入ってもらえるかな、といった種々の不安を感じながらでしたが、ありがたいことに、お二人とも、とても協力的かつご理解が早く、円滑に収録を続けることが出来ました。この場をお借りして、あらためて感謝申し上げます。

こうして無事収録されたものがどのように仕上がったかは、ぜひ以下の動画をご覧ください。

まとめと感想

今回はもともと、触覚技術をより多くの人に効果的に広めるために、触覚デバイスによる感覚を実際に体験してもらうのではなく、触覚デバイスを装着した出演者の反応が変わることで、触覚デバイスの効果を実感してもらう、という目論見から始まりました。

その結果、REALITY社の番組制作スタッフの方々、白井ディレクター、そして VTuber の「九条林檎」さん、「眠居ふわり」さんのご協力のもと、これ以上ない形で触覚の研究成果をたくさんの一般の方々に披露することができました。また一開発者として、私が開発したモノを使って、VTuber のお二人に驚いたり楽しんでもらえたことが、何よりも嬉しかったです。

現在も触覚研究は盛んにおこなわれており、毎年たくさんの論文が発表される一方で、実際に体験できるものはほとんどありません(コロナ禍で国際会議がオンラインになると尚更)。今回のプロジェクトのように、リアル・バーチャルを問わず、配信者や番組の出演者に触覚技術を体験してもらい、その様子を通してその有用性を理解してもらう、というのは触覚技術普及の1つの道になると思います。

動画中の「九条林檎」さん、「眠居ふわり」さんの様子を見て、動画を観た人たちが「彼女たちはどんな感覚を感じているのだろう?」「やってみたいな…」と興味を持っていただけたのであれば、このプロジェクトは一旦の成功と言えると思います。近い将来、スマートフォンでもリッチな触覚がやってくる時代に、この研究開発は生かされるはずです。

3年間の主なプロジェクトの紹介

IEEE World Haptics Conference 2019

ACM SIGGRAPH 2019

https://youtu.be/AgmFWBu5ZnM

トップカンファレンスである IEEE および ACM にて「Haptic Minesweeper」 (首両側面への触覚提示による、見えないターゲットへの位置情報提示)を、現地(東京、ロサンゼルス)でデモ展示 & ポスター発表しました。

また、左右の振動の大きさがどれくらい違うと弁別できるのか、Haptic Minesweeper を使って見えないターゲットにどれくらいの時間で到達できるのか、について実験し、その結果を VR学会大会 2019 で発表しました。

この技術はHMDを装着した状態でも方向感覚を知覚できますし、WebVRなどでも利用できる技術のベースになっています。

論文:首の触知覚を用いたナビゲーションシステムの提案

SIGGRAPH Asia 2019 Real-Time Live

https://youtu.be/yTrDRKazksM

オーストラリアで行われた SIGGRAPH Asia 2019 Real-Time Live! にて、オーストラリアの観客の拍手や歓声量を7000キロ離れた日本の出演者と共有するデモンストレーションを行いました。

VTech Challenge 2019

https://youtu.be/bj_Tr-zinNU

人気 VTuber の「九条林檎」さん、「眠居ふわり」さんに、開発したアバター触覚インタラクションをREALITY 公式番組内で使用していただき、放送しました。また VTech Challenge 2019 の来場者に「アバター触覚インタラクション」&「触覚タワーディフェンス」のデモ展示を行いました。

VibeShare 紹介動画制作

https://youtu.be/HFegJyePXJE

これまでの成果を「VibeShare」として集約、対外的に発信できるようホームページや紹介動画を整備し、「従来の映像ストリーミングだけでは伝わりづらかった『配信者と視聴者のあいだにある非言語エモーション』を共有する、XRライブエンターテインメントのためのインタラクティブ技術」というコンセプトを明確にしました。

九条林檎の挑戦状Ⅱ開発協力

https://youtu.be/e0vpJYxOyEY

大人気企画「九条林檎の挑戦状」をさらに面白く遊べるようにするため、番組内で使用している「バーチャル鬼ごっこバトルシステム」の改修を担当しました。

GREE Tech Conference 2020 登壇

https://youtu.be/KhOgvaF8-oo

当時ラボに在籍していた、スイス在住の Ludmila Bredikhina さんにインタラクティブゲーム「触覚タワーディフェンス」プレイヤーとして参加してもらい発表を行いました。当日は日本の視聴者の「チャージ」や「かわいい」といったコメントが、ゲーム内の残弾の回復や必殺技ゲージの充填に変換され、プレイヤーと視聴者が一体となってゲームを楽しみました。

UPGRADE with TOKYO 第11回 芸術科学会 2021 にて発表

https://youtu.be/za7RUfakpUw?t=2907

アートと社会包摂の観点から、VibeShare の有用性・利用可能性について発表しました。東京都でのオンラインピッチは緊張しました。また同じような触覚の分野で活躍するスタートアップ企業と交流できたのもよい経験でした。

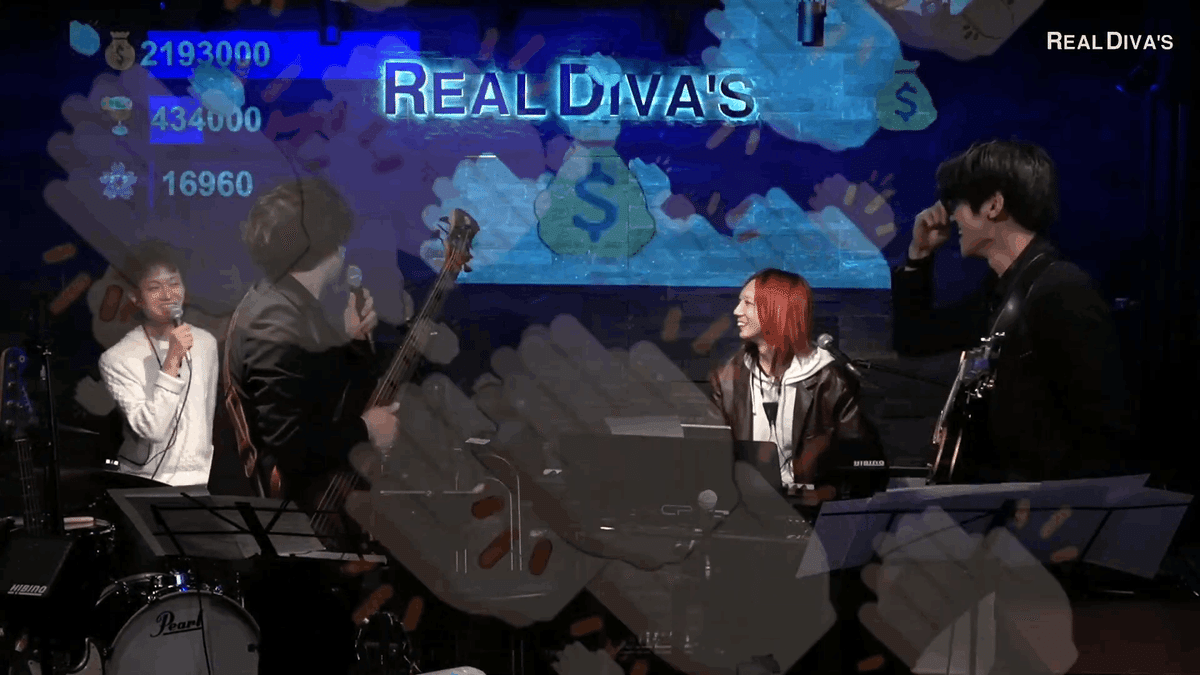

オンラインライブでの VibeShare の活用(Real Diva's 春 フェス スペシャルライブ)

https://youtu.be/RFvXFXpcypw?t=651

オンラインライブの観客の拍手や歓声、存在感をリアルの出演者にリアルタイムに共有する実証実験を実施しました。このプロジェクトについて、より詳しく知りたい方はこちらのブログをご覧ください!

またこの実証実験から得られたデータを元に、システムの有用性について論じた論文を、VR学会大会 2021 で発表しました。

論文:VibeShare::Performer — Emoji・触覚・音効によるオンライン音楽ライブの双方向化

KIDS' WORKSHOP 2021 みんなで(バーチャル)世界旅行

https://youtu.be/UcuHIW3HGP4

コロナ禍で旅行に行けない子供達を、GoogleMapsApi を駆使したバーチャル旅行システム「Maptop」 を開発して、バーチャル世界旅行に招待しました!このプロジェクトについて、より詳しく知りたい方はぜひこちらのブログをご覧ください!

また子供達の旅行中の行動ログや撮影写真から、参加者の理解や興味関心を評価することを試みた論文を、インタラクション2022 にて発表しました。

論文:VibeShare::Maptop―写真撮影・同時参加型バーチャル旅行システムの開発と評価

まとめ

これ以外にもラボが主催するイベント「VRSionUp」で登壇したり配信のお手伝いをしたり、ラボメンの研究をサポートしたり、東京工業大学の国際連携講義のお手伝いをしたりと、まだまだ書ききれないくらい色々な経験をさせていただきました!

この3年間を振り返ってみると、(研究者以外という意味での)一般の人々に研究成果を発表出来たり、実際に使ってもらってフィードバックやデータが得られたり、将来のREALITYに貢献できたりと、学術の垣根を越えて実践できたことがとても有意義であったと感じます。

総括

GREE VR Studio Laboratory と大学の研究室の違い

ラボでの企業内研究のスピード感は大学での研究とは明確に異なります。

大学の研究では自分が納得いくまで先行研究を調査したり、研究の意義などを検討することができますが、企業内研究では、プロジェクトの期間が決まっているため、緊張感をもって、極力最短経路で論文執筆や問題解決を遂行することが求められます。研究では明確な正解というものが無い場合が多いため、この「最短経路」を見つけることが中々大変でした。

ラボでの研究を経験することで、学生の間、時間効率に囚われずに研究できる状況の重要性も改めて実感することができました。大学の研究を振り返ってみると、思考のループに陥ったり試行錯誤を繰り返すことで、一見遠回りに見えても、物事の理解が深まったり、当初思い描いていなかった発見ができたりして研究が深まることが多々ある、ということに改めて気づかされました。

さらにプロジェクトに関わる人々が、番組プロデューサー、動画クリエーター、エンジニア、企業役員、VTuber、デザイナー、ミュージシャン、公務員、etc. と非常にバラエティ豊かでした。

一般的な大学の研究室では、同じ研究室や研究分野が近い学生や教員との交流がほとんどとなり、研究者どうしのコミュニケーションに終始してしまいがちです(勿論例外もあるかと思いますが)。こうしたディスカッションも研究者として成長するのに重要なのは間違いありませんが、一方で普段研究とは余り関わり合いのない人の姿が薄れていってしまうというデメリットもあります。特に工学分野のような応用分野では、研究成果を実際に利用する人々が技術や知見をどのように受け止めるか、という肌感覚は非常に重要なことです。その点、多方面に関わりを持つラボならではの活動や学びが得られたと感じています。

現在進行形で研究をしている大学・大学院生の皆さん、研究は色々と紆余曲折してしまい、なかなか成果が出ない時期もあるかと思いますが、それらの過程は今しか体験できない、かけがえのない財産になるはずなので、挫けず頑張ってください!もし研究に行き詰ったら、GREE VR Studio Laboratory のような場所でインターンをしてみるのも新たな視点が得られるのでお勧めです。

なお、並列して博士取得の要件の1つである学術雑誌(IEEE Transactions on Haptics) に論文を通すまで2年くらいかかってしまってかなり苦しい時期がありました...が、学びも非常に大きかったです!

GREE VR Studio Laboratory でのインターンに興味がある人へ

このインターンは元々、私が所属している東工大のグローバルリーダー教育院(AGL)のプログラム「オフキャンパス教育」にて、3か月以上のプロジェクトに携わることが必要なことがきっかけで、せっかくインターンをするのであれば、私が大学で行っている触覚研究を実用化する手法を学べる場が良いと思い、以前から白井ディレクターにお誘いをいただいていた GREE VR Studio Laboratory にお世話になることに決めました。

オフキャンパス教育の目的である「自身の専門知識や能力、道場で磨きをかけた素養やリーダーシップを実社会で試し、どこまでが通用し何が足りないかを再認識」について、この度のインターンにおいて、特に研究遂行時間の短縮や、プロジェクト関係各者とのコミュニケーションの円滑化、について研鑽が必要なことを実感でき、自分を見つめ直す良い経験となりました。

白井ディレクターはもともと大学教員を努められており(現在もデジタルハリウッド大学大学院で客員教授を担当されています)、現在の大学生のカルチャーや学術研究活動に大変理解がある方ですので、大学研究と平行しながらインターンで研鑽を積むことも十分可能です。

また、待遇面もしっかりしています。金銭的な待遇は本質ではない、といえばそうなのですが、博士学生にとって金銭的な事情を無視することはできません。その点 GREE は上場企業であり、インターン生(アルバイト)も社員と同様の扱いを受けられ、学会参加費や交通費の負担は勿論、必要な機材は用意してもらえる上(VR もさくさくできるハイスペック PC を支給してもらえます!)昇給や有給休暇や社員交流イベントがたくさんがあったりと、不満は全く感じませんでした。

総じて、自身の研究分野がラボの方向性と合致していればラボでのインターンはお勧めできます。ラボの研究一覧ページをご覧いただき、自身の研究の関係が深そうだと感じたらぜひ GREE Jobs からお問い合わせください。