海外論文紹介DAY3「LLMの新しい作り方:T-FREEが切り開く新時代」

こんにちは!KUSABIというVCでインターンをしているダイス藤原です。

この企画は最新の海外AI論文をひたすら読み込んで、その中から「これは…!」と思うものをフレンズの皆さんにお届けしようという企画です。

ポイントを絞って、出来るだけ平易にざっくりと紹介していきますので、興味を持った方は文末のリンクから一次情報に当たってみてください。スタートアップ立ち上げのヒントになれば嬉しいです。

それではいってみましょう!

今日のAI論文:

今日はLLMの世界に大きな衝撃を与える可能性のある新しい技術「T-FREE」について話す。

近年、ChatGPTのような大規模言語モデル(LLM)が私たちの生活に大きな影響を与えている。しかしこれらのモデルには「トークナイザー」と呼ばれる重要な部品があり、これが様々な問題を引き起こしていた。

トークナイザーとはテキストを小さな単位(トークン)に分割する仕組みだ。例えば「こんにちは」という言葉を「こん」「にち」「は」のように分割するイメージ。この仕組みにはいろいろな問題があった:

計算コストが高い

語彙の非効率的な利用

モデルサイズの肥大化

特定の言語や分野に偏りがち

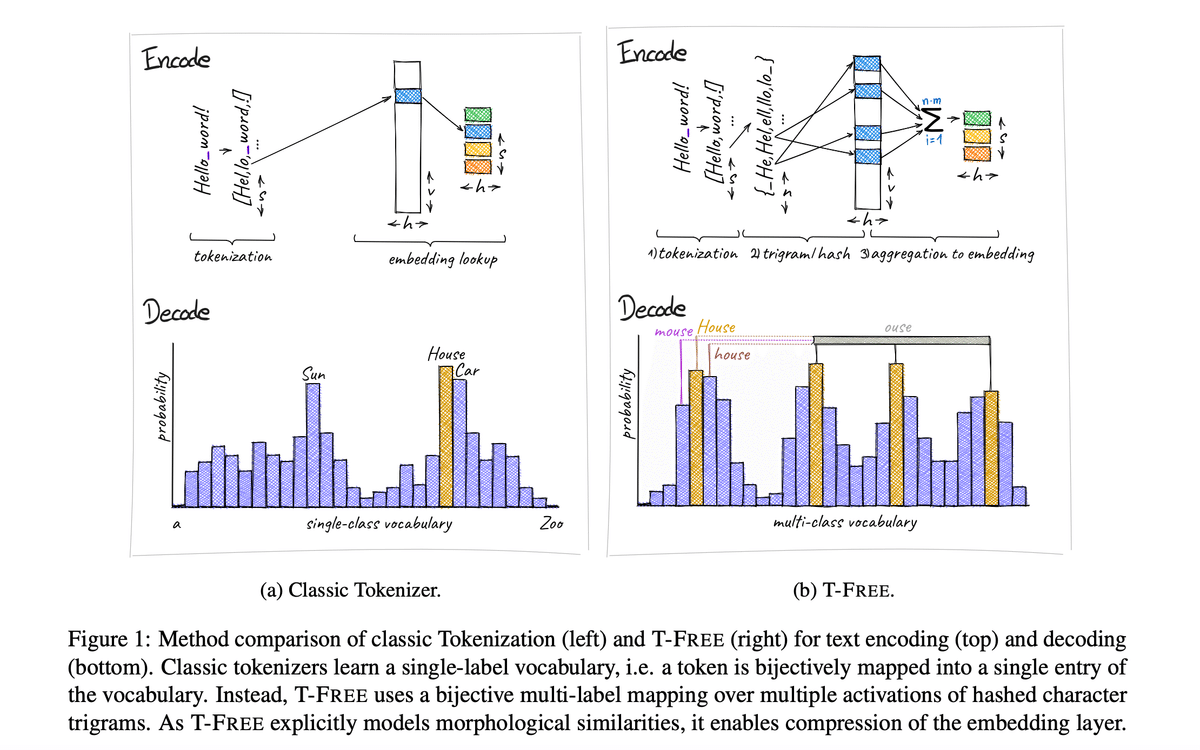

T-FREEはこのトークナイザーを完全に取り除くという大胆な発想から生まれた。ではT-FREEの何がそんなにすごいのか?

シンプルさと効率性

T-FREEは単語を直接「キャラクタートリプレット」(3文字の組み合わせ)の疎なパターンとして表現する。これにより、複雑なトークナイザーが不要になり、計算コストが大幅に削減される。

モデルサイズの劇的な削減

従来のモデルと比べて、埋め込み層と出力層のパラメータを85%以上削減できる。これはより小さなデバイスでの利用やトレーニングコストの削減につながる。

多言語対応の向上

T-FREEは特定の言語に依存しないため様々な言語に対して高い性能を発揮する。特に新しい言語への適応が非常に速いことが特徴だ。

性能の維持

これらの改善にもかかわらずT-FREEは従来のモデルと同等以上の性能を示している。

この技術がもたらす影響を考えてみよう:

より小さく効率的な言語モデル:スマートフォンやIoTデバイスでも高性能な自然言語処理が可能に

多言語サービスの簡単な展開:新しい言語への対応が容易になり、グローバル展開のハードルが下がる

低リソース言語のサポート:これまで対応が難しかった少数言語でも高品質な言語モデルが作れる

元論文はこちら:

最後まで読んでくれてありがとうございます!

来週もどうぞよろしくお願いします!

この記事が気に入ったらサポートをしてみませんか?