プライバシーリスクの考え方

今回の個人情報保護法の改正に伴って、個人情報保護委員会から、事ある度に次の様なメッセージが発信されています。

✅ 法に規定する事業者の義務は、

必要最小限度のもの

✅ 実態等に即したより高い水準の

自主的な取組に期待

個人的には、

「ガイドラインに従っていても、

それで十分とは言えませんよ」

だから、

「必要かつ適切なプライバシー保護策は、

各自で講じて下さいね」

という風に受け取っています。

適正な取扱いの確保に関し必要な業務として、

個人情報保護評価(PIA)を含むプライバシー・バイ・デザイン(PbD)の実施を推奨しています。

改正法の公布と時を同じくして、経産省からプライバシーリスクを管理するための具体論と考え方を示した『DX時代における企業のプライバシーガバナンスガイドブックver1.0』が公表されました。

こちらでも、PIAを含むPbDの実施が推奨されています。

💡 どうやら、義務ではないにしても、プライバシーリスクを洗い出し、適切に対処する取り組みが求められているようです。

ということで,、

本日は、プライバシーリスクの考え方について整理してみました。

1.関係者と取り扱うパーソナルデータの特定とライフサイクルの整理

新規事業を行う際に、プライバシーに関するリスクの洗い出しを行う

そのためには、まず、対象事業がどのようなパーソナルデータのライフサイクルとなるのかを整理する必要がある。

特に整理すべきポイントは以下の通り

✅ 対象事業の関係者(消費者、パートナー、委託先等)を特定する

✅ 対象事業で取り扱うパーソナルデータを特定する

✅ パーソナルデータは、直接取得するデータだけではなく、第三者からの購入やプロファイリングによって推測されるデータも含むこと

どの部分を外部事業者に委託するか、データの取得を2社以上で行う、共同利用なのか等、データのライフサイクルに合わせて、関係する取引事業者との関係性についても、早い段階での整理が必要。

カメラやセンサーなどの IoT 機器により取得されたパーソナルデータや、プロファイリング等で推測されたデータの利活用などについては、プライバシー問題が起こりやすいため、パーソナルデータの取扱いやその目的を丁寧に説明する必要がある。

2.プライバシーリスクの特定

パーソナルデータのライフサイクルの中で、どのようなところにプライバシー問題が発生するかについて洗い出し、そのプライバシー問題への対応方法を検討する。

ここでのポイントは以下の通り

✅ プライバシー問題はリスクベースアプローチで考えること

✅ 事業の特性に応じて、プライバシー問題の体系的な整理を行うこと

✅ 組織の目的、能力、プライバシー問題に適したプライバシーリスク特定のためのツールや技術を用いること

プライバシー問題に係るリスクの特定を行い、リスクに応じて柔軟に対応策を取る考え方であり、特定されたリスク、関連するシステム及びプロセスについてプライバシー影響評価を実施すること、プライバシーリスクマネジメントを実践することなどが含まれる。

(1) プライバシー問題を作り出す諸活動の類型

下図は、パーソナルデータのライフサイクルの各段階の中で、どのようなプライバシー問題が発生しうる可能性があるかを示したもの。

【 データ収集 】

● 監視:継続的なモニタリングにより、個人に対して不安や居心地が悪い感情を与えてないか

● 尋問:個人に圧力をかけて情報を詮索してないか、深く探るような質問で個人が強制を感じ、不安になってないか

【 データ処理 】

● 集約:ある個人の情報の断片を集め、それにより、個人が想像しなかった新しい事実が明らかになることにより、個人の期待を裏切ってないか

● 同定:あらゆるデータを個人に結び付けることで、個人にとって害のある情報も結び付けられてしまい、個人に不安、不満を与えてないか

● 非セキュリティ:パーソナルデータを不適切に保護し、個人に対して不利益を被るようなことが起こってないか

● 目的外利用:個人の同意なしに当初の目的とは違うデータ利用を実施し、 個人を裏切るような行為になってないか

● 排除:個人のデータの開示・訂正の権利を与えない等、重要な意思決定に対して個人のコントロールが効かないようになっていないか

【 データ拡散 】

● 守秘義務関係破壊:特定の関係における信頼関係により取得した個人のデータを、他社に開示するなどで個人へ裏切りの感情を与えてないか

● 開示:個人のデータを第三者へ開示されることで、二次利用先で更なるプライバシー問題が生じていないか

● 暴露:生活の諸側面の他者への暴露により、深刻な恥辱を経験し、個人の社会参加能力を妨害することになっていないか

● アクセス可能性の増大:パーソナルデータへの他者のアクセス可能性を増大させ「開示」のリスクを高めていないか

● 脅迫:パーソナルデータの暴露、他者への開示などを条件に、脅迫者と非脅迫者に強力な権力関係を作り出し、支配され、コントロールされる事態になっていないか

● 盗用:他者のアイデンティティやパーソナリティを誰かの目的のために用い、個人が自分自身を社会に対してどのように掲示するのかについてコントロールを失わせ、自由と自己開発へ介入することになっていないか

● 歪曲:個人が他者に知覚され判断される仕方を操作し、虚偽であり、誤解させることで、恥辱やスティグマ、評判上の危害に帰結することはないか

- 自分自身についての情報をコントロールする能力と、社会にとって自分がどのようにみられるかを限定的にしないすることになっていないか

- 自己アイデンティティと公共的生活に従事する能力に不可欠な評判や性格を捻じ曲げることになっていないか

- 社会的関係の恣意的かつ不相応な歪曲が行われる恐れはないか

【 個人への直接的な介入 】

● 侵入:必要以上の個人へのアプローチ(メールや電話等)により、個人の日常の習慣が妨げられ、居心地が悪く不安な感情を引き起こされてないか

● 意思決定への介入:個人の生活において重要な意思決定に対して AI を用いている場合等において、決定方法が不透明で、個人に萎縮効果が働いてないか

(2) データ利活用時のリスク対策

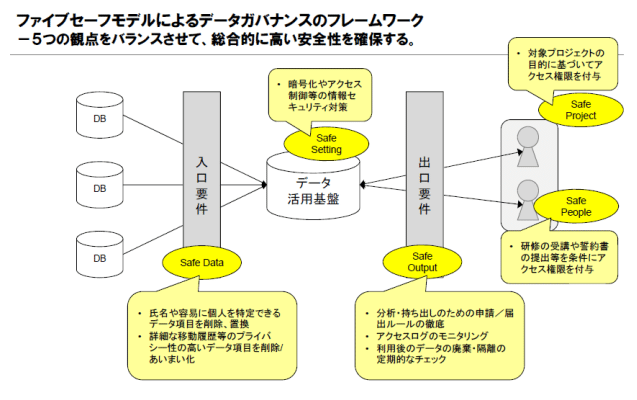

プライバシー問題に適したプライバシーリスク特定のためのツールとして参照できるフレームワークとして「ファイブセーフモデル」がある。

データの有用性を確保しつつデータを安全に取り扱う方法で、データ利活用時の安全対策ルールとして広く実績もあり、プライバシー問題及びその対策方法を考える上で参考になる。

【 安全なプロジェクト 】

データ利用の目的・取扱いが法的、社会的規範の検知から適切か?

● プロジェクトの目的に基づいてアクセス権を付与

【 安全な利用者 】

個人データを適切な方法で使用されることについて信頼できるか?

● 申請や誓約書の提出を条件にアクセス権を付与

【 安全なデータ 】

データ自体に機密開示のリスクはないか?

● 氏名や容易に個人を特定できるデータ項目を削除、置換

● 詳細な移動履歴等のプライバシー性の高いデータ項目を削除、曖昧化

【 安全な設置環境 】

承認されていない利用者を制限しているか?

● 暗号化やアクセス制御等のセキュリティ対策

【 安全な分析結果 】

分析結果に機密開示のリスクはないか?

● 分析や持ち出しのための申請/届出ルールの徹底

● アクセスログのモニタリング

● 利用後のデータ廃棄や隔離の定期的なチェック

本日の引用文献

経済産業省

DX時代における企業のプライバシーガバナンスガイドブックver1.0

(PDF形式:2,551KB)

本日のアウトプットはいかがでしたか?

少しでも参考になりましたら

❤️(スキ)で応援いただけると大変励みになります。

では、また!

この記事が気に入ったらサポートをしてみませんか?