【論文瞬読】生物学的に妥当な可塑性ルールのメタ学習:ランダムフィードバック経路を用いた新たなアプローチ

こんにちは!株式会社AI Nestです。

今回は、人工知能の分野で注目を集めている「生物学的に妥当な可塑性ルールのメタ学習」に関する最新の研究論文を紹介します。この論文は、機械学習と生物学の融合という観点から非常に興味深い内容となっているので、ぜひ最後までお付き合いください。

タイトル:Meta-learning biologically plausible plasticity rules with random feedback pathways

URL:https://www.nature.com/articles/s41467-023-37562-1

所属:Department of Applied and Computational Mathematics and Statistics, University of Notre Dame, Notre Dame

著者:Navid Shervani-Tabar, Robert Rosenbaum

バックプロパゲーションの課題とランダムフィードバックアライメント

まず、多くの人工ニューラルネットワークの学習に用いられているバックプロパゲーションアルゴリズムについて説明しましょう。このアルゴリズムは、フィードフォワード結合と対称なフィードバック結合の存在に依存しているのですが、実際の生物の脳ではそのような対称な後方結合性の存在が確認されていません。この点が、バックプロパゲーションの生物学的妥当性に疑問を投げかけているのです。

そこで登場するのが、ランダムフィードバックアライメントという考え方です。これは、固定のランダムなフィードバック結合を通じて誤差を伝播させる代替モデルで、浅いモデルの学習には成功するものの、深いモデルやオンライン学習ではうまくいかないという課題があります。

Figure 1は、フィードバックアライメント(FA)が深いモデルで学習が困難であることを示しています。パネル(a)では、FAとバックプロパゲーション(BP)の精度を比較しており、パネル(b)では、各層におけるFAとBPの教師信号の角度を示しています。これらの結果から、FAは深いモデルやオンライン学習での性能に課題があることがわかります。

メタ学習を用いた生物学的に妥当な可塑性ルールの発見

この論文では、固定のランダムフィードバック結合によるオンライン学習のパフォーマンスを改善する、解釈可能な生物学的に妥当な可塑性ルールを発見するためのメタ学習アプローチを提案しています。

メタ学習とは、学習プロセスそのものを学習する枠組みで、この研究では、可塑性ルールのみをメタ学習し、メタパラメータを共有することで、解釈可能な学習ルールの発見を可能にしています。また、L1ペナルティを用いることで、スパースな可塑性ルールを導出しているのも、解釈性の観点から有効なアプローチだと言えます。

Figure 3は、FAとBPの可塑性係数のメタ学習の結果を示しています。パネル(a)と(b)では、FAとBPのメタ精度とメタ損失を比較しており、パネル(c)では、FAとBPの学習率のメタパラメータの進化を示しています。また、パネル(d)では、FAの各層における変調信号とBPの変調信号の角度を示しています。これらの結果から、メタ学習を用いることで、FAの性能を改善できる可能性が示唆されています。

Figure 4は、生物学的に妥当な可塑性ルールのメタ学習の結果を示しています。パネル(a)と(b)では、プールされた可塑性ルール(F_pool)とFA、BPのメタ精度とメタ損失を比較しており、パネル(c)では、F_poolの各層における教師信号とBPの教師信号の角度を示しています。また、パネル(d)では、可塑性係数の収束の様子を示しています。これらの結果から、メタ学習を用いて生物学的に妥当な可塑性ルールを発見できることがわかります。

発見された可塑性ルールとそのメカニズム

この研究で発見された可塑性ルールには、主に2つの重要な要素があります。

1つ目は、Hebbian-style error-based termです。このルールは、モジュール信号のアラインメントを改善することで学習を加速します。具体的には、前層と後層の誤差を組み合わせることで、フィードフォワード結合の重みを更新しています。これにより、固定のランダムフィードバック結合下での学習が改善されるのです。

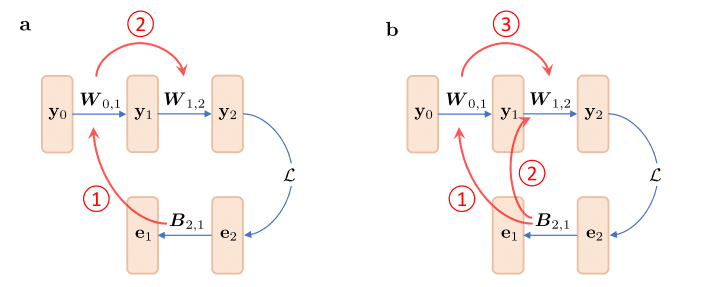

Figure 6は、前方および後方経路間の情報の流れを示しています。パネル(a)では、FAを用いて両層を学習する場合の情報の流れを示しており、パネル(b)では、第1層をFAで、第2層をF_eHebbで学習する場合の情報の流れを示しています。これらの図から、Hebbian-style error-based termが、固定のランダムフィードバック結合下での学習を改善するメカニズムを理解することができます。

2つ目は、Ojaの学習則です。このルールは、教師なし学習によって特徴抽出を強化することで、予測性能を向上させます。Ojaの学習則は、前層と後層の活性化と、結合の現在の状態を組み合わせて重みを更新するもので、主成分分析(PCA)の非線形版を実装していると考えられます。

これらの可塑性ルールは、生物学的な観点からも興味深いものです。Hebbian-style error-based termは、シナプス可塑性の一種であるHebbianルールを拡張したものと見ることができ、Ojaの学習則は、生物の脳でも観察されている非線形PCAに関連しているからです。

今後の展望と課題

この研究は、生物学的に妥当な可塑性ルールの発見というチャレンジングな問題に対して、メタ学習を用いた新たなアプローチを提案しており、機械学習と生物学の融合という観点から非常に興味深い内容となっています。

ただし、理論的な裏付けや収束性の保証などについては深く議論されておらず、発見された可塑性ルールの生物学的解釈についてもより詳細な検討が必要でしょう。また、この研究では画像分類タスクを対象としていますが、他のタスクや問題設定への適用可能性についても検討する必要があります。

おわりに

今回は、「生物学的に妥当な可塑性ルールのメタ学習」に関する最新の研究論文を紹介しました。この研究は、機械学習と生物学の融合という観点から非常に興味深い内容となっており、今後のさらなる発展が期待されます。

人工知能の分野では、生物の脳に学ぶことで、より効率的で汎用性の高いアルゴリズムの開発が進められています。この研究は、その一例であり、今後も生物学と機械学習の協働によって、新たなブレークスルーが生まれることを期待しています。

最後までお読みいただき、ありがとうございました。次回も、AI研究の最前線をお伝えしていきますので、お楽しみに!