【論文瞬読】ニューラルネットワークの表現の類似性を捉える新指標CKA

こんにちは、みなさん。株式会社AI Nestです。今日は、ニューラルネットワークの解釈性に関する興味深い研究を紹介したいと思います。

タイトル:Similarity of Neural Network Representations Revisited

URL:https://arxiv.org/abs/1905.00414

著者:Simon Kornblith, Mohammad Norouzi, Honglak Lee, Geoffrey Hinton

研究の背景

ニューラルネットワークは、画像認識や自然言語処理など、さまざまな分野で目覚ましい成果を上げています。しかし、その判断プロセスが不透明であるという「ブラックボックス」問題は、AIの実社会応用における大きな障壁の一つです。特に、医療診断や自動運転など、高い安全性が求められる分野では、ニューラルネットワークの振る舞いを理解し、説明できることが重要になります。

ネットワークが学習した表現の類似性を測定することは、この問題に取り組む上で重要なステップだと考えられています。表現の類似性を定量化することで、異なるネットワーク間の関係性を明らかにしたり、学習の進行に伴う表現の変化を追跡したりすることができるからです。

既存手法の限界

Canonical Correlation Analysis (CCA)などの線形変換に不変な統計量は、ニューラルネットワークの表現の類似性を測定するためによく用いられてきました。CCAは、2つのデータセット間の線形な関係を最大化するように、データを変換する手法です。

しかし、今回紹介する論文では、これらの手法にはデータ点の数より高い次元の表現の意味のある類似性を測定できないという限界があることが明らかにされました。つまり、ネットワークの中間層のように、ニューロンの数がデータ点の数よりも多い場合、CCAでは表現の類似性を適切に捉えられないということです。

新指標CKAの提案

そこで著者らは、新たな類似度指標としてCentered Kernel Alignment (CKA)を提案しています。CKAは、カーネル法と呼ばれる機械学習の手法を応用した指標です。カーネル法では、データを高次元空間に写像することで、非線形な関係性を捉えることができます。

CKAは、2つのデータ行列のカーネル行列の類似度を測定します。具体的には、データ行列X, Yに対して、以下の式で計算されます。

$$

\text{CKA}(K, L) = \frac{\text{HSIC}(K, L)}{\sqrt{\text{HSIC}(K, K)\text{HSIC}(L, L)}}

$$

ここで、$K$と$L$はそれぞれ$X$と$Y$のカーネル行列、$\text{HSIC}$はHilbert-Schmidt Independence Criterionと呼ばれる統計量です。

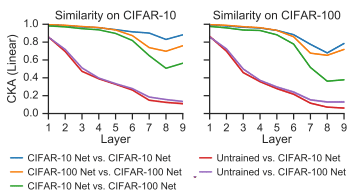

著者らは、CKAがCCAと密接に関連していることを示しつつ、CCAとは異なり、異なる初期化から学習されたネットワーク間の対応関係を確実に特定できることを実験的に示しました。これは、CKAがネットワークの学習ダイナミクスを理解する上で有用であることを示唆しています。

研究の意義と今後の展望

本研究は、ニューラルネットワークの表現の類似性を測定する際の新たな視点を提供しており、ネットワークの解釈性向上に向けた重要な一歩だと言えます。CKAを用いることで、異なるアーキテクチャや学習条件のネットワーク間の関係性を明らかにしたり、学習の進行に伴う表現の変化を詳細に分析したりすることが可能になるでしょう。

一方で、本論文にはいくつかの限界や今後の課題も存在します。まず、CKAの理論的な性質については、さらなる解析が必要だと考えられます。また、より複雑なアーキテクチャ(例えば、ResNetやTransformerなど)への適用可能性も検証する必要があるでしょう。さらに、表現の類似性以外の解釈性の側面(例えば、注意の可視化や特徴の帰属など)との関連性も探求する価値があります。

ニューラルネットワークの解釈性は、AIの信頼性や安全性を確保する上で欠かせません。本研究は、その重要な一歩を示してくれたと言えるでしょう。今後のさらなる発展に期待したいと思います。