導入コストを踏まえて、今すぐ始められるバーチャルプロダクション【SIGGRAPHAsia2021 講演ダイジェスト】

2021年12月14日〜17日にかけて、毎年アジアの各都市を巡って開催されるコンピューターグラフィックスとインタラクティブ技術の祭典「SIGGRAPH Asia 2021」が開催されました。

期間中の講演では、『今すぐ始めるバーチャルプロダクション 柔軟性と導入コストを両立させながらはじめるには』と題したセッションにて、ユニティー・テクノロジーズ・ジャパン テクニカルディレクターの林和哉が登壇。

バーチャルプロダクションの代表的な手法から、予算に応じた導入方法などを解説。本記事ではその講演をレポートし、これからバーチャルプロダクションに取り組んでみたいと考える方に、その概要と可能性をお伝えします。

林 和哉

ユニティ・テクノロジーズ・ジャパン株式会社

テクニカルディレクター アニメ/フィルム

映像制作の入口から出口までのオールポジションを守備範囲にプロデューサー/ディレクサーとして活動。最新技術が好物で、高じてユニティ・テクノロジーズ・ジャパンにテクニカルディレクターとして所属。現在はユニティの映像分野での活用の伝導に励んでいる。東映では、近年、機界戦隊ゼンカイジャーのライブ合成システム構築、それを活用した『TTFC産直シアター 仮面ライダーセイバー』3作を監督。

撮影現場を制約や移動から解放し、その体験をガラリと変える

そもそもバーチャルプロダクションとは、「現実の映像にCG背景などの別映像を合成する技術の一つ」です。特徴は、被写体とCGをリアルタイムに連動させながら、同時に撮影できることにあります。

被写体の背後にはCGを表示するデバイス(※LED液晶など)を置くか、被写体をグリーンバックなどを用いてキーイング(※切り抜き合成)することで、撮影現場で「合成させながら」収録できることが、従来からの大きな変化といえます。このリアルタイム合成にUnityをはじめとするゲームエンジンが貢献しているのです。

バーチャルプロダクションの転機は、2019年1月に公開された映画『スター・ウォーズ』のスピンオフ作品『マンダロリアン』です。マンダロリアンでは多くの撮影箇所でバーチャルプロダクションが使われました。完成作品だけではなく、その撮影方法にも多くの注目が集まったのです。

バーチャルプロダクションの普及は、映像表現を広げるだけではなく、撮影体験もガラリと変えるものだと、林はその導入メリットを3点挙げました。

「まずは、ロケーションをアセットにできます。一度制作すれば、何度でも再利用が可能な資産となるのです。

次に、時間からの解放です。日の出や日の入りなど、一日のなかで希少な時間を何度も繰り返すことも、“マジックアワー”を固定化することもできます。天候の心配がなく、“晴れ待ち”もいらないので効率的です。

そして、移動からの解放です。スタジオ内で完結するため、何十人からなるロケ隊を移動させる必要がありません。移動に懸念があるwithコロナの時代に合った撮影方法ではないでしょうか。

バーチャルプロダクションは、映像制作にどのような革新を生み出しているか。また、映像制作の未来はどのように変化していくのかを語ったnoteも公開しているので、こちらもご覧いただきたいです」

代表的な3つのバーチャルプロダクション撮影方法

実際にバーチャルプロダクションで撮影するときには、現在は大きく「3つのやり方」があるといいます。

「1つ目は、グリーンバックで実写を撮影し、編集時にキーイングしてCG空間と合成します。

2つ目は、実写にグリーンバックとCGを連動させながら、その場で合成撮影します。トラッキングセンサー(※)を搭載したカメラと連動することで、CG空間がリアルタイムに移り変わります。

3つ目が現在のトレンド、実写の背景に壁のように設置したLEDパネルにCGを投影し、それを撮影する手法です。トラッキングデータに連動してCGをリアルタイムに動かしてLEDへ投影します。メリットは、肉眼で完成の画が見えることです。グリーンバックだと演じ手は完成後の映像が編集されるまでわかりません。完成映像の世界観がわかることは、演出サイドも演じ手も大きくテンションを高めます。ただデメリットもあり、投影するアセットを撮影当日までに揃えないといけません」

(※現実で撮影しているカメラと同じ角度や動きをコンピューターに伝え、映像を連動させるためのもの)

制作コストを踏まえて、“良い映像”を撮影していく

「映像制作」は、大きく2つの道に分かれます。一つは、依頼主の要望を踏まえ、期日までに映像を完成させるクライアントワーク。もう一つは、意思決定者もしくは近しい関係性のメンバーで制作し、効率性よりも試行錯誤をメインとするクリエイティブワークです。

今回の講演ではクライアントワーク・クリエイティブワークという概念を念頭に、制作コストを踏まえ、合成の方法や機材、撮影機材、リアルタイムエンジンの適切な選び方を紹介しました。

合成の方法・機材

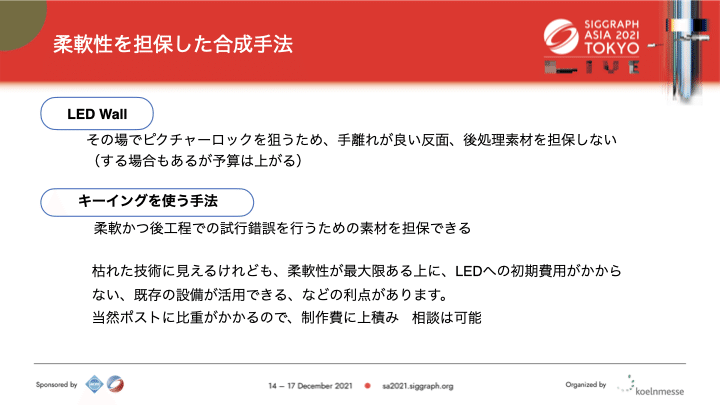

前述のように、合成方法はLEDウォールととグリーンバックなどでのキーイングがあります。LED Wallはその場でピクチャーロック(※1)ができるため、撮影後の手離れが良いです。一方で、後工程での試行錯誤を行うための素材が担保ができません。

「LEDウォールは各社からクオリティの高い製品が生まれていますが、予算確保が難しい場合があります。LEDは電球のため、映像に黒い格子が多いとモアレが起きる可能性が高まります。それをなくすために画素数を上げようとすると、価格も比例して上がってきます。また、メンテナンスコストがあることも忘れてはならない検討事項です。

キーイングは後工程での試行錯誤により、撮影後も柔軟に対応できます。この手法は過去からも多く利用されている技術なので、使用経験があれば安定した撮影が実現できるでしょう。また、必要なものがグリーンバックのみなので、LEDウォールに比べて機材費は安価に抑えられますが、合成するための制作費がかかります。

キーイング専用機としては『Ultimatte』が有名です。現在はバージョン12(※2)まで出ており、よく切り抜きできるのでおすすめです。専用機がない場合は、撮影時に光を均等に当てられるとスイッチャーで抜くこともできます。また、リアルタイムエンジン内でも抜けますが、ハイスペックなPCで実行したり、排熱をしっかりケアしないといけません」

(※1 監督やプロデューサーが映像を確認した後、さらに映像に変更を行わないこと)

(※2 講演では「バージョン13」と述べていますが、正しくは「バージョン12」です)

機材・カメラ選び

合成方法が決まれば、次は機材です。まずは、機材のなかでも台数が必要になるカメラの選定について。

「留意するのは、センサーサイズや出力信号のサイズフォーマット、映像信号の品質、センサーとのセッティング性です。

センサーサイズでは、今から新しく導入するならHDのカメラは考えづらいでしょう。少なくとも4K以上を選択することになると思います。それなら、8Kにしておけば大丈夫だろうと考えると、出力信号のサイズフォーマットで引っかかることがあります。

出力信号のサイズフォーマットでは、4KのカメラでもSDI(※1)から出せる信号がHDまでだったり。ある特定の設定でした信号が出せない場合など、意外な制約があるので気をつけましょう。

現状、業界内ではスタンダードであるSONYやPanasonicのカメラがおすすめです。理由はSDIの出力信号が比較的信頼でき、映像信号の品質をクリーンに保てることにあります。実は、8Kなどのカメラを買っても、キーイングがまともにできない場合がありえます。

同じ被写体で同じ設定なのに、キーイングの結果に差ができる場合もあるのです。

最後に留意すべきは、(後述する)カメラトラッキングセンサーとのセッティング性です。バーチャルカメラ(※2)と連携するために、カメラ周りにトラッキングセンサーをしっかり固定しないといけません。カメラ本体が小さいと、トラッキングセンサーがうまく取り付けられない可能性があります」

(※1 シリアルデジタルインターフェース。ビデオ信号伝送規格の一つで、同軸ケーブルとBNCコネクタで機器同士を接続し、非圧縮のデジタル映像とデジタル音声を伝送できる。主に業務用の映像機器などで使われる)

(※2 ソフトウェアで作られたCG空間内に生成される仮想的なカメラ )

機材・カメラトラッキングセンサー選び

カメラの次は、トラッキングセンサーの選定です。

「カメラトラッキングセンサーには3つの型があります。

1つ目が、周辺設置型です。スタジオ周辺にカメラを置いて、カメラの先に球体をくっつけて撮影するやり方です。フィジカルなカメラがどう動いているか、どの角度を向いているのか、ポジション含めて総合的に情報を取得します。

有名なところでVICON、OptiTrack、Vive Trackerなどがあり、モーションキャプチャーで使うものと同じです。モーションキャプチャーもできるので一石二鳥ですが、高額な商品になっています。

2つ目が、マーカーポイント型です。上向きのセンサーカメラで天井にあるマーカーを撮影。移動量で位置と姿勢が変わったときの角度の違いを割り出して、システムに伝えます。

StarTracker、RedSpyなどがあり、誤差が少ないため重宝されます。また、周辺設置型に比べると安価です。

3つ目が、慣性型です。小型のセンサーをカメラにひっつけてジャイロでどれくらい移動したか、ARマーカーを見つけて移動量を計算します。絶対値ではなく相対値で割り出すため、ゼロ距離からどれくらい動いたかをコンピューターに伝えます。

有名なところでいうとRealSenseがあり、工夫次第ではミラクルショットを撮影することができます」

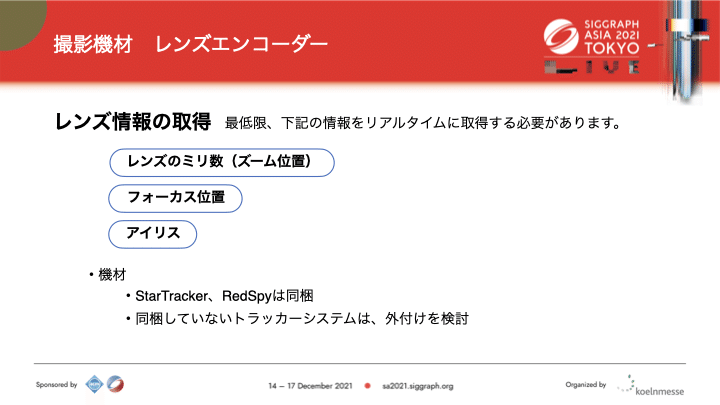

機材・レンズエンコーダー選び

そして、レンズのミリ数、フォーカス位置、アイリス(絞り)、フォーカス度合いをコンピューターに伝えるレンズエンコーダーも必要です。

「レンズエンコーダーは、マーカートラッキングセンサーではStarTrackerとRedSpyに同梱されています。同梱されていないVIVE Trackerなどを使用する場合は、外付けのレンズエンコーダーを検討してください」

リアルタイムエンジン選び

最後に選択すべきものは、リアルタイムエンジンです。

「リアルタイムエンジンは、UnityとUnreal engineがあります。Unreal engineでは、三次元グラフィックスで実写のような表現を見せられるフォトリアル、Unityでは、イラストや絵画のように描画を行うノンフォトリアルの時に、よく活用されます」

全員が納得する撮影と映像を:東映特撮作品での導入事例

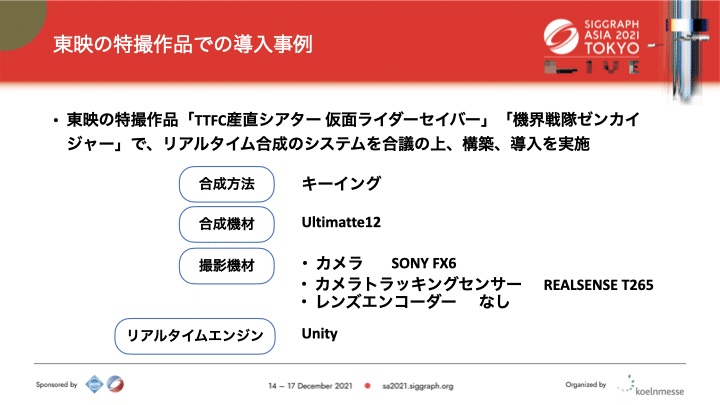

合成方法、合成機材、撮影機材、リアルタイムエンジンを踏まえた上で、東映の特撮作品『TTFC産直シアター仮面ライバーセイバー』『機界戦隊ゼンカイジャー』でのバーチャルプロダクション導入事例が紹介されました。

多くの人が携わるプロジェクトのため、全員が納得する上で、合成方法や機材の決定が重要でした。下記の記事でも、プロジェクトの意義や可能性について語られていますが、今回の講演ではより具体的に機材なども明かされました。

「合成方法はキーイングを採用し、ブルーバックやグリーンバックで撮影しました。LED ウォールではアセットを完成するのに時間がかかり、準備が間に合わなかったからです。また、LEDウォールでは仮のアセットで撮影したあと、本番用のアセットで合成し直す作業が発生します。制作時間などの柔軟性を担保するなら、キーイングが適すると考えたのです。

合成機材はUltimatte12(※)を使用しました。撮影時間が限られているなか、パソコンをひらいて調整をするのは好まれませんし、パソコンが故障する可能性もあります。なので、シンプルなハードウェアを採用しました。

カメラはSONY FX6に決定。4K撮影でき、出力フォーマットも満たしていたからです。また、本体のサイズ感もコンパクトでマウンティングポイントも多く、コストを踏まえたなかで導入しやすい価格帯でした。カメラはバックアップ機が必要なため、数台購入するための予算を押さえておくべきでしょう。

カメラトラッキングセンサーはIntel RealSense Tracking Camera T265を導入しました。慣性型でしたが、東映ツークン研究所でも何度か実証がされており、データやノウハウが貯まっていたため採用しました。

レンズエンコーダーは使用しませんでした。システム構築の手間や時間を省きたかったのと、移動ショットがメインになることが想定されたため単焦点運用として、見送りました。

リアルタイムエンジンは、拡張性と安定性という点でUnityを採用しました。1年間のプロジェクトでしたが、現時点で大きな事故などはありません。十二分に価値を発揮していると思います」

(※ 講演では「バージョン13」と述べていますが、正しくは「バージョン12」です)

現在、「TTFC産直シアター仮面ライバーサイバー」はYouTubeでの視聴が可能になっています。話数を重ねるごとにバーチャルプロダクションが進化する過程が見て取れます。

「バーチャルプロダクションは映像制作の“魔法の杖”ではない」ことを意識

バーチャルプロダクションの登場で、映像制作の業界では新しいワークフローが生まれました。今ではノウハウやナレッジが貯まり、新たな表現が生まれています。しかし、林はバーチャルプロダクションで撮影する際に「いつも心に留めていることがある」と語ります。

「バーチャルプロダクションは表現の一手段であり、映像制作を早く、安く、おいしくする、“魔法の杖”ではないと考えています。時間や場所の解放など利便性が上がりますが、リアルなロケーションと比べると、まだまだデジタルで表現しきれないものがあります。

むしろリアルなロケーションを再現しようとすると、逆に時間やコストがかかることも多いです。何でもバーチャルプロダクションを活用しようとは考えないほうがいいでしょう」

林は「バーチャルプロダクションは現実を拡張するものだ」と言い、その活用範囲を見極めることが肝心だと伝えました。

「バーチャルプロダクションは現実を置換できる絶対的なカードではなく、表現を豊かにするための選択です。現実を忠実に再現するのではなく、抽象的な表現、ノンフォト的な豊かさ、つまり現実を拡張するような表現に威力を発揮すると思います。私は、

提示されているものの解釈やそれに対する感動の具合は、見た人の経験で決まります。「そのもの」との対話です。映像含むあらゆるコンテンツ、芸術は、対話性が重要だと思っています。

見る人たちの想像力を掻き立て、感動を与えるためには、『つくりたいものは?』『それに必要なものは?』『どういう手段をとるか?』『そのプロジェクトで何が大事だろう?』と問い続けることが大切なのです」

※本講演のアーカイブは2021年12月28日21時以降よりUnity JapanのYouTubeチャンネルにて公開します。