「思考を整理する方法」を模索して辿り着いた先

こんにちは。DeployGateの藤﨑です。

仕事をしていると、とにかく考えて答えを出さないといけないことが数多くあります。すぐ思いついてアウトプットできることならいいのですが、大事なものは大体、どこから考え始めればいいのか分からないことだったり、なんとなく浮かんでいるんだけどうまく言語化できないものだったりします。

そんなときに、どうやってその状況を抜け出して、話を深めていくか。今日は、最近自分がやってみて、とても効果を感じられた手法について紹介します。

これまでの手法

自分が考え事をする上で、まずやるのはテキストで書き出すということでした。何らか課題について考えるときは、ひたすら箇条書きで考えを書き出していくということをします。だいたいNotionにページを作って箇条書きでひたすら書き出しています。

それ以外だと、やはり紙とペンです。長年適当なコピー用紙→ノート→コンパクトなメモ…と移り住んできました。しかし、どれも時間が経つと検索性が厳しくなってくるので、ここ何年かはデジタル化して reMarkable 2 を使っています。文字起こしは日本語対応していないので検索性という意味ではあんまり改善してないのですが、とにかく書くことだけに集中できる道具として重宝しています。

そして、昨年末頃からChatGPTとの壁打ちも時々試すようになりました。分からないことや判断に困る部分を相談すると、自分にない視点が得られるなど思考に幅を持てるようになる感じがあります。ビジネス書に書いてそうなことは大体出てくるので、そこからキーワードを拾って新たに学びを得たり、一般論を異なる観点から答えてもらったりして、知らなかった知識や視点の開拓に便利に使うことができます。

ChatGPTのGPT-4は大体意図に沿った答えを出してくれるものの、あまり議論としての深さは出ないので、概ね視点の補強に使っています。「プロンプトエンジニアリング」でなんとかなるのかもしれないですが、いまのところは深掘りしてないです。

そんな感じで色々試行錯誤をするなかで、最近になって新しい手法に辿り着きました。

新しい手法: カメラに向かって喋る

最近効果を感じているという新しい手法、それは「カメラに向かって喋る」です。

やることはシンプルで、カメラとマイクを自分に向けてセッティングして、録画して、撮られている意識を持って話しはじめます。結論からいうと、これはとてもよくて、思考がすごく捗るようになった実感が得られています。

まず文字にするよりも、話す方が連想の幅が広がりやすく、思考が詰まりづらいです。文字として書き出す時よりも、脳のリソースを純粋なアウトプットのために使うことができており、さらに、声色、表情、ジェスチャーなど、漁る引き出しが増える結果、話しながらあれこれと思いつくことが多いです。「今思ったんだけど」という台詞がよく出てくる感触があります。

ソフトウェア開発でも、ラバーダック・デバッグやテディベア効果として知られている「コードを書きながら詰まった部分について目の前のアヒルのおもちゃやテディベアに説明すると、話しているだけで問題が自己解決してしまう」という現象があります。説明のために別の視点が必要となって、そこで違和感に気付く、などが理由に挙げられており、それに近い感触です。

また、手書きやタイピングよりも喋った方が圧倒的にアウトプットの速度が速いです。そもそもスループットが高い上、日本語特有の漢字変換とその校正のために脳のコンテキストスイッチが起きることも避けられ、純粋に内容を考えるのに集中できるため、浮かんだことをアウトプットして続きの話に進むまでの時間も短く、短期記憶も維持しやすく、同じ時間でより多くのことを考えることができます。無駄な言葉も多々出ていますが、それもまた連想の幅を広げるのに役立ちます。

私自身の性質に合っていると感じるところも良いポイントです。何か話をするときに、相手に分かりやすく話そうと試みることが思考を広げることを手伝っており、また、外からの見え方を気にする性分から、見られている・聞かれていると感じることが集中力を後押ししてくれている感じがあります。たまたま旅先でこの試みを始めたこともあり、SONY ZV-E1にFE 20mm F1.8 GとECM-B10(もしくはラベリアマイク)という、割としっかりめの撮影機材を使っています。ちゃんと機材をセットして「撮られてる」感が出た方が自分の認知を誤魔化しやすいので効果は出やすい気がします。(要検証)

さらに眠気に強いというメリットもあり、画面に向かってテキストを打っていると1分で寝落ちしてしまいそうな状況でも、カメラを出して話はじめると眠くならないので、せっかく時間を確保したのに何もできないみたいな状況も避けることができました。(そもそもこの手法、作業しようにも眠くて集中できない、せっかくだからカメラで遊ぶか…という現実逃避から辿り着きました)

喋った内容を文字に起こす

この手法は、一通り喋っただけだいぶ思考が整理されて効果を得ることができます。しかし、さすがにすべての内容を覚えてはいないので、もう一度動画を見直そうとなったとき、ただ長々喋った動画を見直すのは大変です。ここは機械の力を使って文字に起こします。

速度と精度のバランスを見つついくつか試す中で、OpenAIのWhisperを高速化したfaster-whisperのフロントエンドのwhisper-ctranslate2に行き着きました。README通りにインストールして以下のように実行するだけで、M1 MaxのMacBook Pro (14-inch, 2021)ではざっくり実時間の半分以下で、ほぼほぼ読める文字起こしが完了します。

$ whisper-ctranslate2 --model large-v2 --language ja C3613.MP4ひとまず、ここで生成されたテキストファイルを開いて読むだけでも内容の把握には役立ちます。それに加えて、同時に生成されているSRTファイルを動画と同じフォルダに置いて、 VLC などの字幕対応しているメディアプレーヤーで動画再生することで、自動的に字幕として認識され画面上に表示されるようになります。これであれば、動画を3倍速ぐらいで再生しても十分追いかけることができます。

動画として見ることで、もう一度咀嚼することがやりやすいほか、「この時は別のことも考えていたな」ということを思い出したり、新たな思考に繋がることを支援してくれます。

現在のところ

まだこの手法を試し始めて1週間経ってないのですが、カメラに向かって話すことで、一人でもだいぶ思考が進むようになっています。なんだかんだ、気付くと30分ぐらい何も見ずに話し続けています。約36分の話を文字起こししたテキストだと8,300文字を超えていて、30分やそこらでこの量のテキストを書くことは単純にできないなと思います。

もちろん、結論に繋がらなければいくら文字の量だけあっても意味がありません。ただ、1回のセッションで結論に至らなかったとしても、この量の思考と言語化を集中してやって、後から検索して振り返ることができるログが残っている状態が役に立ちます。後々リフレッシュした頭で振り返って思考を継続することもできるし、また結論を説明するときに背景を人に説明するための材料としても使い勝手がとてもよいです。

一方で、ガンガン喋り続ける分、普段と違うレベルで頭が疲れているという感触もありました。適宜休憩をとりながらやるのがよさそうです。

今後の展望

ということで今回は、最近試し始めた新しい思考の手段について書いてみました。いい感じなので引き続き続けていきたいと思っています。その中で以下のことも試してみたいと思っています。

Hallucination(幻覚)対策

Whisperはいい感じに「えーと」や「あの」などのフィラーを取り除いた読みやすい書き起こしを作ってくれる一方で、言ってないことを勝手に追加したり、あるいは同じ発言をずっと繰り返し続けたりする、 hallucination と呼ばれる現象が発生することがあります。この現象は、元の音源のノイズを減らすよう加工することで減るようなので、現状は発生した音源に関してはdenoiseで対処する、それでもだめならモデルを変えてみる(large-v2→large-v1にする)などで対処しています。が、これをなんかいい感じにしたいです。情報を募集しています。

お手軽自動要約

30分で8,000文字超えの文字起こしになると、できあがったテキストもすごい量になるので一々中身を読んでられないです。話の途中で文脈も色々変わってるので、何の話をしているのか箇条書きでまとめてほしい…が、いかんせん文量が多すぎてChatGPTにもサクッとは受け入れてもらえないので、これをなんかいい感じにしたいです。情報を募集しています。

最後完全に人頼りみたいな感じになってしまいましたが、色々手探りで試しています。いい方法あったら是非教えてください。

それでは今月はこの辺りで!

おまけ

Whisperの幻覚、結構面白い現象が起きるのでスクショで紹介します。

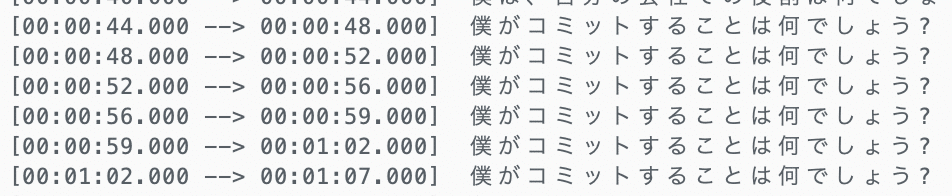

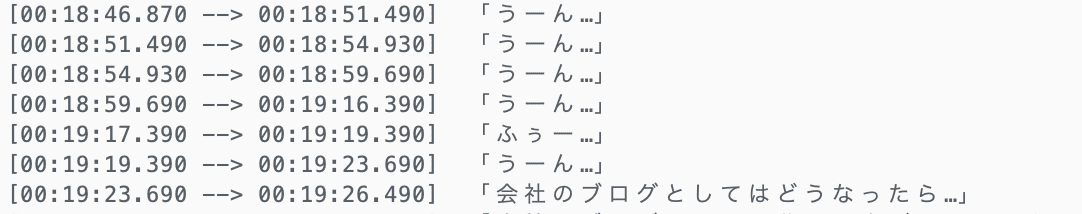

言っていないことを言い出す

Whsiperは、本人が一言も言ってないことを、なぜか言ってそうなところで出してくることがあります。

一方で、「それ言ってないけど、たしかに入ってた方がいいな」って時もあります。難しいですね。

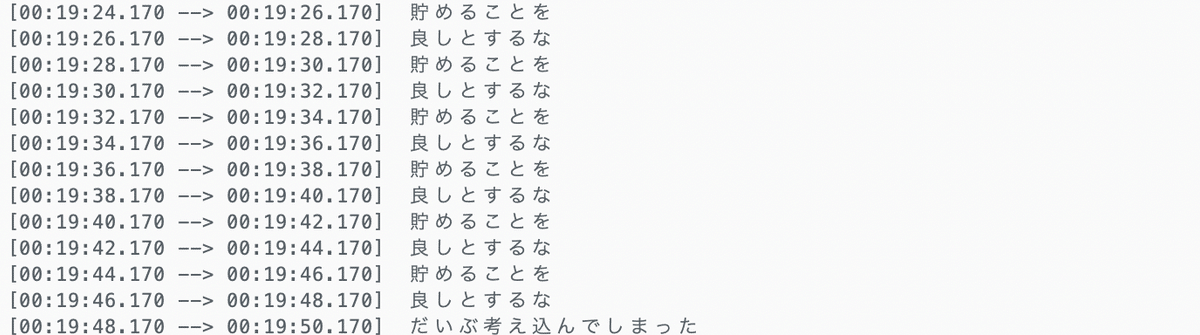

同じことを言い続ける

なんかWhisperのトランスフォーマーの中の人がツボってしまうことでも言ってしまったのか、突如まったく話を聞かず、しばらくの間とにかく同じことしか言わなくなる現象が起きます。

どれも既知の事象なので、特に目新しいものではないのですが、自分が喋っている内容で起きると「なんでそこ押しとんねん」と突っ込める面白さがあったので、みなさまも体験してみてはいかがでしょうか。(?)

2023/10/29追記: 同じことを言い続ける現象を抑える

幻覚は発話のない区間で発生する傾向が見られますが、この対策として --vad_filter True オプションを付けると、発話検出フィルタ(https://github.com/snakers4/silero-vad)を使って無音地帯をスキップしてくれるようになり、幻覚はだいぶ抑えられるというかほぼ無くすことができるようになりました。

$ whisper-ctranslate2 --model large-v2 --language ja --vad_filter True C3613.MP4また、途中喋っていない部分が多い動画の場合、その部分がスキップされるので処理時間が短くなるという効果もあります。おすすめ。