温度 x HCI と“皮膚で見る”体験

今回は HCI Advent Calendar 21日目 (AoE) の記事として、市橋 (東京大学) が

温度 x HCI の概観 + これまでの体験・研究について書きます。

研究について興味のある方はご連絡ください!

温度 x HCI のモチベーション

HCIで温度提示をするモチベーションは:

環境の再現:画面の前やVR空間でも温度感じたい!日光浴びたい!季節を感じたい!寒い雪山を歩き暖かい温泉につかりたい!

触感の再現:画面の中・VR空間・遠隔で色んなものや人に触りたい!触ったものの温度や素材感を感じたい!

情報の提示:それとなく通知してほしい。言葉にできないようなものを伝えたい!

感情の喚起:もっと盛り上がりたい!親しくコミュニケーションしたい!印象を良くしたい!落ち着きたい。

実際の研究事例 (動画あるもの優先) を挙げると、

首の温度変化と顔への送風で、気温や風を再現[1]

手袋型の装置で、色々な物体に触れる際の手の温度変化を再現 [2]

ピアノの鍵盤の温度が変化! (作曲者が音に温度を付け、演奏者はそれを感じながら演奏)[3]

音楽に合わせて温度が動的に変わるヘッドフォン。より盛り上がったり、リラックスしたり[4]

おまけ (感情→行動変容):立ち位置に応じて耳あての温度が変化→ ちょうど良い温度の場所に集まる[5]

温度提示手法

これらを実現するため、色々な温度提示の手法が提案されています。

大きく分けて、接触・非接触・錯覚の3種類。以下に列挙します (事例リンク付き)。

かなり短いですが、温度 x HCI の概観は以上です。温度提示装置を開発し、表現空間を示したり、応用を探索したりする研究が多い印象です。

温度体験の再現以外で、HCIにおける温度提示の強みは、抽象的でさりげないフィードバックや、情動喚起だと思います。

きっかけ:テキサスと河

自分が 温度 x HCI の研究を始めたきっかけについて少し。学部時代、自分は京都大学のICPで、土・水・構造の力学や数理最適化、降雨や河川について学んでいました。およそHCIからかけ離れた分野です。しかし学部3年の春、University of Texas at Austinという大学の Electrical and Computer Engineering (ECE) という学科に1年ほど留学することにしました。

1年間の留学生活では、アメリカ大学特有のスパルタ教育のおかげで、ECEについて幅広く学べました。また、HCIをはじめとする様々な研究分野を知る機会ともなりました。ちなみに、アメリカ人の友人に勧められ様々なアニメに触れたのもHCIに興味を持ったきっかけです。

修士課程への進学にあたって、研究の焦点を自然から人へと変えてみたかったこと、実験や河川でのフィールドワークを通して、多様な温度体験をしてきたことから、温度という観点で人の身体・知覚について研究したいと思ったのが今の研究のきっかけです。

“皮膚で見る”世界 をズラす

修士は東大の稲見研究室に所属しました。研究室の概要はRiku Arakawaが紹介しているので、ここでは割愛します。

進学前、温度と人の知覚というテーマで何ができるのか、京都の鴨川に沿って歩きながら考えていました。その時ふと、目を閉じても温度感覚から太陽の方向がわかることに気づきました。人は皮膚を通して世界を見ているということを改めて実感した瞬間でした。そのとき、温度提示によって効果的なリダイレクションが起こるんじゃないかと思いました。

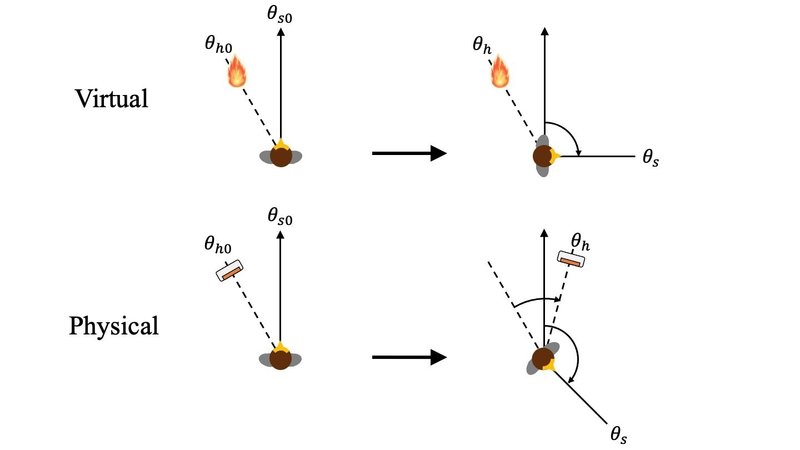

リダイレクションとは、VR空間でのユーザの回転量を、物理空間での回転量から気づかれない範囲で少しずつズラすことです。例えば歩行時にこれを行うことで、その人がまっすぐ歩いているつもりでも、物理空間では曲がって歩いているという状況になり、限られた広さの物理空間で広大なVR空間の移動を実現できます。ちょうど、以下のような視覚と触覚の相互作用を用いたリダイレクションの研究[6]を知っていたのもこの着想に至った理由です。

こうして修士前半は、放射熱とVR空間の映像を同時にずらすことによる、人の方向知覚への影響を実験を通して調査しました (下図)。そして、その結果をまとめた論文を計測自動制御学会システムインテグレーション部門講演会で発表しました。

“皮膚で見る”体験の拡張

リダイレクションの研究では、皮膚を通して見る世界が如何に人の方向知覚に影響を及ぼすか調査しました。そして次の研究として、“皮膚で見る”という行為、つまり、放射熱による温度感覚を通した外界の知覚体験を拡張できないか考えました。

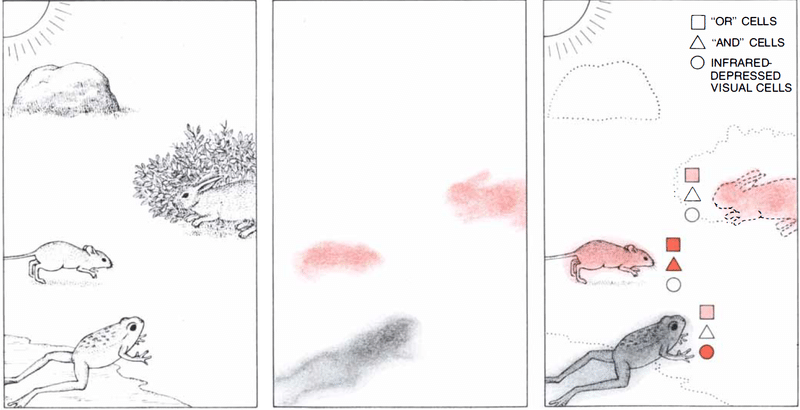

ちょうどその頃、稲見先生が「動物の感覚について調べてみると面白いよ~」とおっしゃっていたので、いろいろと読んでいると、「ガラガラヘビは視覚と赤外線覚からの情報を統合して世界を見ている」という旨の記載があり、人でも視覚と温度感覚を統合できないかと考えました。

そこで、モニタ上のユーザの注視点に応じて放射熱を制御するシステムを作成しました。下の映像上部の黒い遮蔽機構が回転し、奥からの赤外線量を高速に制御します。これにより、モニタ上の見ている対象に応じて様々な温度を感じることができます (映像の例では、太陽を見ると暑くなり、海を見ると涼しくなります)。また、これは実質的に温度感覚の空間解像度を視覚と同程度に引き上げているとも言えます。今後、このメディア体験を評価・応用していく予定ですので、興味があればぜひコメントを下さい!

さらに、視覚提示をモニタ方向から、温度提示を赤外線源方向からバラバラに受けることが体験を悪化させるという意見から、いわゆるアミッドスクリーンを用いて、視覚提示と温度提示を重畳させました (下図)。網戸の細かい隙間が裏からの赤外線を通す一方、表がプロジェクタからの光を反射します。これにより、放射熱をスクリーン上の映像方向から感じることができます。実はこのアプローチは稲見研究室の過去の作品と通ずるところがあったりします。これらを含む一連の研究をまとめた論文が国際会議であるMIMSVAI2021に採択され、幸運にもBest Paperを受賞しました。

今後は、物理空間への適用や、様々なインタラクションへの応用を模索していくので、引き続きnoteでアップデートしていこうと思います。

最後に

ここまで長々と失礼しました。

この記事を通して、温度 x HCI に (そしてあわよくば自分の研究に) 少しでも興味を持っていただけたなら幸いです。まだまだ未開拓なので、これからも注目に値する分野だと思います。

今後もHCIアドカレには面白い記事が並ぶと思いますので、Stay tuned!

参考文献

[1] Ranasinghe, Nimesha, Pravar Jain, Shienny Karwita, David Tolley, and Ellen Yi-Luen Do. “Ambiotherm: Enhancing Sense of Presence in Virtual Reality by Simulating Real-World Environmental Conditions.” In Proceedings of the 2017 CHI Conference on Human Factors in Computing Systems, 1731–42. Denver Colorado USA: ACM, 2017. https://doi.org/10.1145/3025453.3025723.

[2] Cai, Shaoyu, Pingchuan Ke, Takuji Narumi, and Kening Zhu. “ThermAirGlove: A Pneumatic Glove for Thermal Perception and Material Identification in Virtual Reality.” In 2020 IEEE Conference on Virtual Reality and 3D User Interfaces (VR), 248–57. Atlanta, GA, USA: IEEE, 2020. https://doi.org/10.1109/VR46266.2020.00044.

[3] Miyashita, Homei and Nishimoto, Kazushi. 2004, June. "Thermoscore: a new-type musical score with temperature sensation." In Proceedings of the 2004 conference on New interfaces for musical expression, 104-107.

[4] Akiyama, Shimon, Katsunari Sato, Yasutoshi Makino, and Takashi Maeno. “ThermOn: Thermo-Musical Interface for an Enhanced Emotional Experience.” Proceedings of the 2013 International Symposium on Wearable Computers, 2013, 45–52.

[5] Narumi, Takuji, Tomohiro Akagawa, Young Ah Seong, and Michitaka Hirose. “Thermotaxis.” In SIGGRAPH ’09: Posters on - SIGGRAPH ’09, 1–1. New Orleans, Louisiana: ACM Press, 2009.

[6] Matsumoto, Keigo, Yuki Ban, Takuji Narumi, Yohei Yanase, Tomohiro Tanikawa, and Michitaka Hirose. 2016. Unlimited corridor: redirected walking techniques using visuo haptic interaction. In ACM SIGGRAPH 2016 Emerging Technologies (SIGGRAPH '16). Association for Computing Machinery, New York, NY, USA, Article 20, 1–2. https://doi.org/10.1145/2929464.2929482.

[7] Newman, Eric A., and Peter H. Hartline. “The Infrared ‘Vision’ of Snakes.” Scientific American 246, no. 3 (March 1982): 116–27. https://doi.org/10.1038/scientificamerican0382-116.

この記事が気に入ったらサポートをしてみませんか?