【GPT-4 Turboまとめ】新機能やアップデートした点を徹底解説

こんb…こんにちは!恋人よりもジピちゃん(ChatGPT)と話している時間の方が長いんじゃないか疑惑が浮上している、ChatGPT 飼育員 Sayah (@sayah_media)です👩💻💗🤖🧠

現地時間🇺🇸11月6日午前10時(日本時間🇯🇵11月7日午前3時)に、OpenAI 主催の「OpenAI DevDay, Opening Keynote」が初開催されました 🎉

同オープニングキーノート(基調講演)は、開発者向けに最新のアップデート情報を発表することを目的としています。

今回1番の目玉となったのは、CEO のサム・アルトマン(Sam Altman)氏による、GPTシリーズの新モデル「GPT-4 Turbo」の発表です。

本記事では、OpenAI DevDay で発表された、GPT-4 Turbo の新機能や進化した点について、詳細に解説します。

🤖 「GPT-4 Turbo」とは

今回発表された「GPT-4 Turbo」は、一言でいうと、GPT-4 の「高速版モデル」です。

某世界的人気キャラクターのM男氏🥸で例えるなら、GPT-4 が「🥸🍄」で、GPT-4 Turbo は「🥸🍄+⭐️」になります。

これまで、多くの専門家やメディア、インターネットユーザーの間では、GPT-4 の後継モデルとして「GPT-5」、または、中間モデルとして「GPT-4.5」がリリースされるのではないか、との噂が飛び交っていました(ママ友コミュニティのゴシップ並みに)。

しかし、前回、コチラの記事でも述べたとおり、最新の情報によると、OpenAI がよりレスポンスを迅速にできる GPT-4 の改良版モデルに注力していることが明らかにされていました。

GPT-4 Turbo は、前述したとおり、現行の GPT-4 よりも高速なレスポンスタイムを実現し、ユーザーがよりスムーズでストレスフリーに使えるように設計されています。

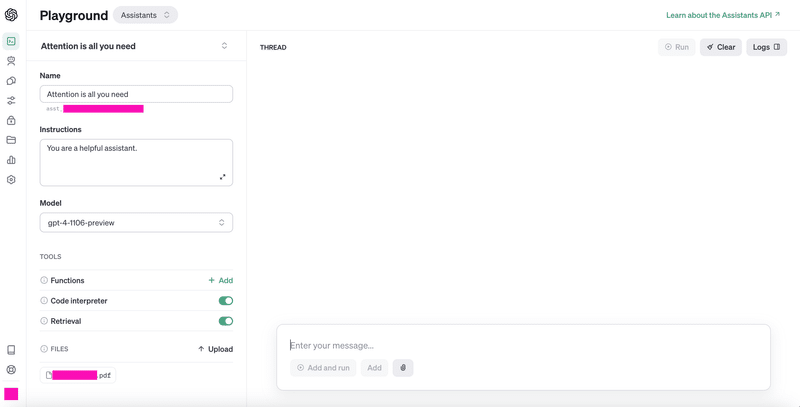

上の画像のとおり、OpenAI Playground の UI(User Interface:ユーザーインターフェイス)も大幅に変更されました。

また、GPT-4 Turbo を語るうえで、より長いコンテクストを扱う能力や、開発者が制御できる新機能の実装も欠かせないポイントです。

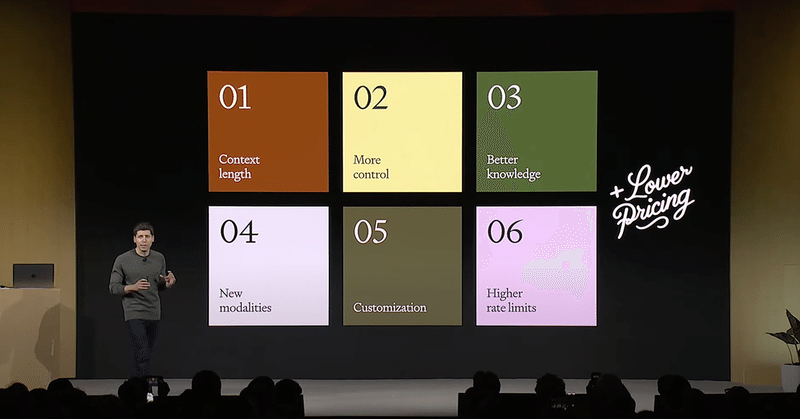

🚨「DevDay」で発表された6つのキーポイント

新モデル「GPT-4 Turbo」のコンセプトは、「より早く、よりスマートで、より使いやすく」です。

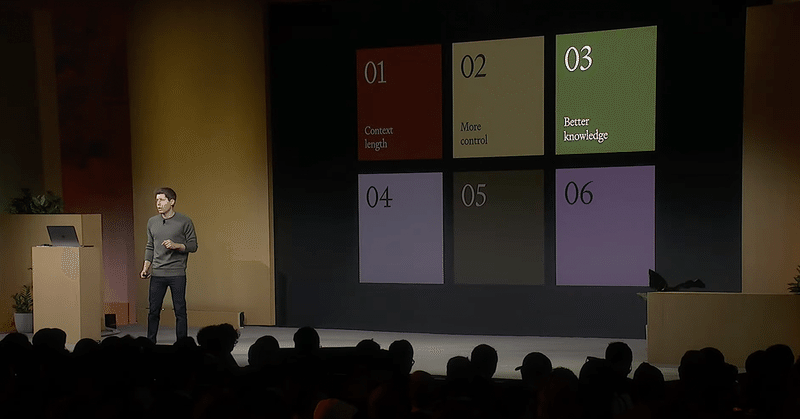

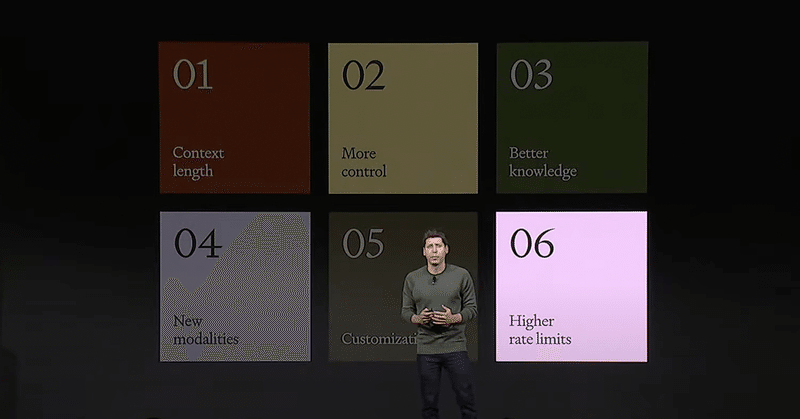

CEO のサム・アルトマン氏は、GPT-4 Turbo について「皆さんが待ち望んでいた多くのことを実現する」と前置きしたうえで、6つのキーポイントについて語りました (OpenAI, 2023c)。

今回、サム・アルトマン氏が明かしたメイントピックは、以下の6点です。

1️⃣ Context Length(コンテクストの長さ)

2️⃣ More Control(コントロールの強化)

3️⃣ Better Knowledge(より良質な知識)

4️⃣ New Modalities(新モダリティ)

5️⃣ Custom Models(カスタムモデル)

6️⃣ Higher Rate Limits(レート制限の増加)

次の章では、今回発表された、絶対におさえておきたい6つの主要なポイントについて、1つずつ詳細に解説します。

GPT-4 Turbo に実装された新機能や進化した点などを知りたい方は、ぜひ参考にしてください。

1️⃣ 【Context Length(コンテクストの長さ)】

(OpenAI, 2023c)

今回発表された GPT-4 Turbo では、128K Tokens(128,000 トークン)もの Context Length(コンテクスト・レングス)を扱えるようになりました(※「コンテクスト・レングス」の意味については、後述します)。

🪙 トークンとは

✅「Token(トークン)」とは、AI が処理できる情報の量や、文章の長さを測る単位です。私たちが文字数を「〜文字」と数えるように、AI は「〜トークン」で単語や句読点を含む、文章の長さや情報量を数えます。

「128,000トークン」とだけ聞くと、少々分かりづらいですが、これは300 ページの書籍 1 冊分に相当するトークン数です。

つまり、これは通常の GPT-4 である GPT-4-8K(8,000トークン)の16倍、一部のユーザーが利用できる GPT-4-32K(32,000トークン)の4倍 を示しています。

このアップデートにより、より広範な情報にわたるタスクや深い分析、より正確性の高いアウトプットが可能になるでしょう。

📄 コンテクスト・レングスとは

✅「Context Length(コンテクスト・レングス)」とは、文章の長さや情報量のことです。

AI は限られたトークン数の中で文章を理解し、適切な回答を生成します。つまり、コンテクスト・レングス(トークン数の上限)が多いほど、AI はより長い文章を読んだり書いたりすることが可能です。

同イベントで、サム・アルトマン氏は以下のように述べています。

In addition to longer context length, you'll notice that the model is much more accurate over a long context.

コンテクスト・レングスの増加に加え、長文でもモデルの精度がはるかに高くなっていることを実感できるはずです。

(筆者訳)

2️⃣ 【More Control(コントロールの強化)】

(OpenAI, 2023c)

今回、新たに「モデルの応答」や「生成されるアウトプット」に対する制御力を向上させる機能が追加されました。

これは、開発者たちの「モデルの応答とアウトプットを、よりコントロールしたい」という強い要望に応えるものです (OpenAI, 2023c)。

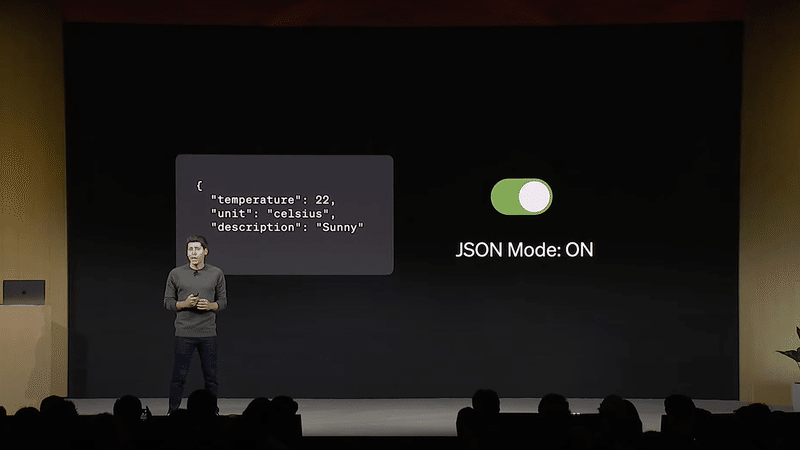

⌨️ 1. JSON Mode

(OpenAI, 2023c)

「JSON Mode(JSONモード)」と呼ばれる新機能では、モデルが有効なJSON形式で返答することが保証されます。

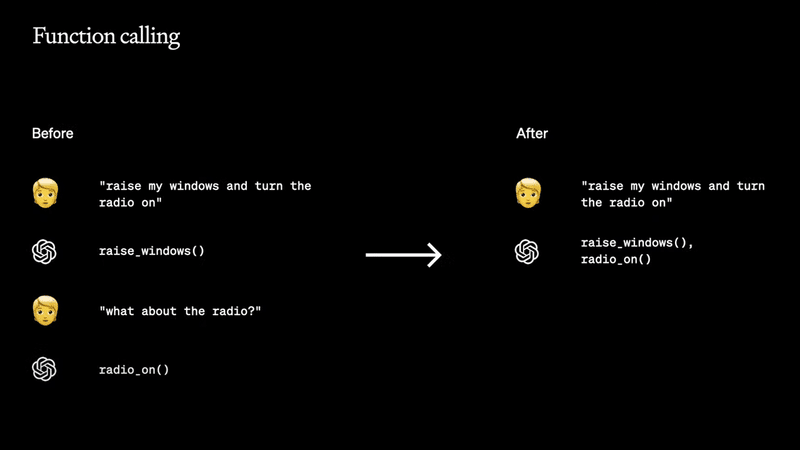

📞 2. Function Calling

(OpenAI, 2023c)

また、API を叩く操作も以前より容易になりました。GPT-4 Turboでは、「Function Calling(関数呼び出し)機能」が大幅に改善されています。

同機能は、OpenAI が 2023年6月14日にローンチした機能です。

例えば、Function Calling 機能を使って、事前に定義された関数を ChatGPT に入力しておくことで、ChatGPT は質問に最適な関数を選び出し、実行できるようになります。

ChatGPT の学習データに含まれていない情報においても、関数を使用して回答することが可能です。

Function Calling 機能は、情報収集だけではなく、メール送信などの実用的な機能も提供します。

さらに、同機能を使って他のシステムと連携することで、システム操作を文章で行ったり、システムの回答を文章形式で得たりすることが可能です。

GPT-4 Turboでは、Function Calling 機能が大幅に改善され、複数の関数を同時に呼び出し、指示に忠実に従うようになりました (OpenAI, 2023c)。

🔁 3. Reproducible Outputs

さらに、新しい「Reproducible Outputs(再現可能なアウトプット)」という新機能も導入されました。

これは、Seed Parameter(シード値)を設定することで、モデルが一貫性のあるアウトプットを返してくれる機能です。

Reproducible Outputs 機能を活用することで、開発者はモデルの挙動において、より高度なコントロールが実現できます。

また、同機能は、アプリケーション開発において、特に予測可能な結果が求められるシーンや、結果の一貫性や再現性が不可欠なシーンなどで、大きく役立つでしょう。

AI のように、ランダム性が結果に大きく影響するプロセスでは、同じシード値を用いることで、そのランダム性を制御し、常に安定したアウトプットを生成可能です。

これにより、同じリクエストに対しても一貫した結果を提供できます。結果的に、デバッグやユーザー体験の向上に貢献するでしょう。

同機能のベータ版は、イベント当日の11月6日(現地時間)からロールアウトが開始されています。

🧮 4. Log probs

加えて、API で「Log probs(Log probabilities:対数確率)」を表示できる機能も、今後数週間のうちにロールアウト開始予定とのことです。

✅「対数確率(Log Probabilities)」とは、AIが特定の言葉を選ぶ際の確率を、対数形式で表したものです。AI は、文章生成時に次に来る単語や文節を予測しなければなりません。そのため、それぞれの選択肢に対して一定の確率が割り当てられています。

簡単にいうと、対数確率は AI が次にどんな言葉を選ぶかの「自信の度合い」を数値化したものです。この数値が高いほど、AI はその単語を選ぶことにより確信を持っているといえます。

例えば、スマホの予測変換機能では、キーボードが次に打ちたい言葉を予測するとき、何らかの基準で「これが正しいかな?」と考えています。

対数確率が API で見られるようになると、開発者は AI がなぜその言葉を選んだのかを理解したり、調整したりすることが可能です。結果的に、AI を使ったアプリやサービスを作る際に、より良い選択ができるようになるでしょう。

3️⃣ 【Better Knowledge(より良質な知識)】

GPT-4 Turbo では、より豊富な知識や世界中の情報にアクセスできるようになりました。また、新機能「Retrieval」も実装されました。

🗃 新機能「Retrieval」の実装

「Retrieval」というと、直訳した「検索」を連想してしまいがちですが、ITの文脈で使用される際は、データベースから必要な情報をピックアップするプロセスを指すことが多いです。

「Retrieval」機能を使って、外部データ/ファイル(PDFやドキュメントなど)をアップロードすると、GPT-4 Turbo が内容を読み取って、関連情報を抽出し、その情報に基づいて質問に応答したり情報を要約したりしてくれます。

つまり「Retrieval」機能とは、「外部ドキュメントやデータベースにアクセスし、情報を取り込むことが可能になる新機能」といえるでしょう。

同機能によって、モデルは単にインターネット上の既知の情報に依存するのではなく、特定の文書や最新のデータに基づいて、より明確な知識を提供することが可能になります。

例えば、以下の情報などを GPT-4 Turbo に読み込ませることで、モデルはその内容をもとに、よりパーソナライズされたレスポンスを生成することが可能です。

🔸 ネットにまだ公開していない記事の下書き

🔸 収集した情報をまとめたメモ

🔸 最新のレポート

🔸 備忘録 など

ビジネスシーンにおいても、以下のようなデータを読み込ませることで、モデルは大量のテキストデータから、対象となる情報のみをピンポイントで抽出し、必要な回答がクイックに得られます。

🔸 顧客情報管理

🔸 顧客のレビュー

🔸 商品の在庫データ など

結果、マーケ戦略の考案や在庫管理、センチメント分析を行う時間の節約や、ビジネスにおける意思決定の迅速化などに役立つでしょう。

📖 学習データのカットオフを更新

また、サム・アルトマン氏は、先日学習データのカットオフが2023年4月までの情報にアップデートされたことについても言及しました(カットオフの意味については、後述します)。

GPTモデルは、長い間、2021年9月までの知識しか持っていませんでした。

しかし、これにはユーザーだけではなく、OpenAI も頭を抱えていたようで、サム・アルトマン氏は「もう2度と時代遅れになることがないよう努めます」と公言したうえで、今後も適時に更新する予定であることを明かしました (OpenAI, 2023c)。

実際に、今年 9月半ばには GPT の学習データが 2022年1月までにアップデートされ、その約 2ヶ月半後には、一気に 2023年4月までの情報にアップデートされるなど、カットオフのアップデート期間が急激に加速しています。

✅ 「知識のカットオフ」とは、AI モデルが学習済みのデータセットの最終地点です。基本的に、AI モデルは「特定の期間までの情報」を学習しています。つまり、カットオフとは「AI が何年何月までの情報を持っているか」のボーダーラインです。GPT-4 Turbo のカットオフが 2023年4月の場合、GPT-4 Turbo は 2023年4月までの情報は持っていますが、5月以降の知識は持っていないことを意味します。

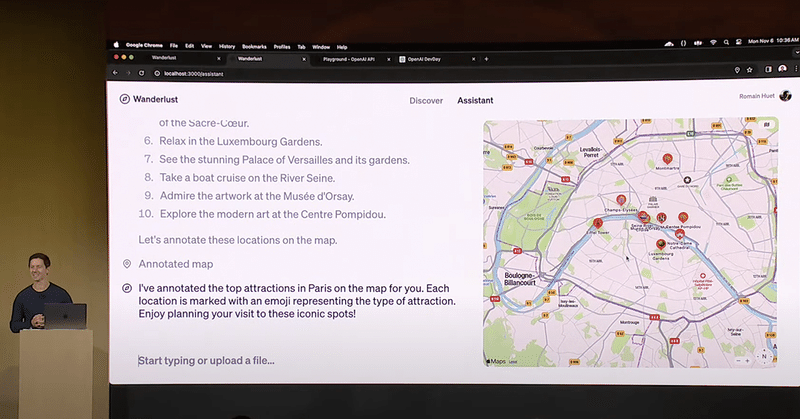

4️⃣ 【New Modalities(新モダリティ)】

今回、新たに API に 3つのモダリティが追加されました(「モダリティ」の意味については、後述します)。

🖼👁️🗣 追加された3つのモダリティ

(OpenAI, 2023c)

今回追加されたのは、以下の3つです。

🖼️ DALL-E 3

👁 GPT-4 Turbo with Vision

🗣 TTS(Text-to-Speech)

少し前に「GPT-4V(GPT-4 Vision)」の実装が話題を集めましたが、API にも「GPT-4 Turbo with Vision」として、GPT-4 の「目」にあたる機能が追加されています。

✅「モダリティ(modality)」とは、情報を伝達または理解するために使用される方法やチャネルです。

特定のコンテキストや専門分野によって、異なる意味を持ちますが、AI の分野では、例えば「テキスト」「画像」「音声」などが、それぞれ異なるモダリティに該当します。

上記で出てきた「マルチモーダル(multimodal)」は、AI 分野でよく使用される用語で、正に上記のような複数のモダリティを組み合わせて、情報を処理する技術やアプローチのことです。

これにより、テキストと画像の両方を分析することで内容理解を深めるなど、よりリッチなユーザー体験が実現されます。領域によっては、「多モード」「マルチモード」「多様」などと訳されることも少なくありません。

お馴染みの画像生成 AI「DALL-E 3」が API で利用できるようになっただけではなく、ビジョン機能を備えた「GPT-4 Turbo with Vision」や、新機能「音声合成(TTS:Text-to-Speech)」もすべて API に組み込まれました👏

5️⃣ 【Custom Models(カスタムモデル)】

(OpenAI, 2023c)

他にも、イベント当日に「Custom Models(カスタムモデル)」と呼ばれるプログラムがローンチされました。

同プログラムは、主に企業向けに用意されたもので、以下のようなことが可能です。

1️⃣ AI モデル学習プロセスにおけるステップの修正

2️⃣ 追加ドメインに特化した事前学習

3️⃣ 特定のドメイン向け強化学習後のポストトレーニング

同プログラムは、企業が独自のニーズに応じて AIモデルを調整し、最適化するために役立つでしょう。

🐾 1. AI モデル学習プロセスにおけるステップの修正

「AI モデル学習プロセスにおけるステップの修正」は、AI の学習プロセスにおいて、あらゆるステップをカスタマイズ可能であることを意味しています。

これによって、特定のアプリやタスクに最適なモデルを作成したり、学習データのバイアスを減らしたり、パフォーマンスを向上させたり、既存の学習データセットにはないデータを扱うことが可能です。

✍️ 2. 追加ドメインに特化した事前学習

「追加ドメインに特化した事前学習」とは、AI モデルが一般的なデータセットを使って事前学習(Pre-Training:プレトレーニング)した後、さらに追加ドメインに関連するデータで、追加学習を行うことです(※「ドメイン」の意味については、後述します)。

このプロセスを実行することで、AI モデルはその分野に関するより深い知識と理解を得られるでしょう。

また、AI はさまざまなタイプのテキストやタスクに対する汎用的な能力を身につけ、のちに特定の用途やタスクに向けた、より詳細な学習(Fine-Tuning:ファインチューニング)を行う準備ができます。

✅「ドメイン」とは、AI の文脈において、モデルが作業を行う特定の領域や分野、タスク、環境、範囲を指す言葉です。例えば、医療・法律・金融など、特定の業界や学問の分野などが挙げられます。

AI モデルにドメインに特化した学習データセットを与え、AI モデルにその分野の専門知識を持たせることで、より専門的で関連性や正確性、クオリティの高いアウトプットを得ることが可能です。

📊 3. 特定のドメイン向け強化学習の追加学習

同プログラムでは、強化学習(RL:Reinforcement Learning)の手法を用いて AI をトレーニングした後に、さらに特定の分野や目的に合わせた追加学習(Post Training:ポストトレーニング)を行うことが可能です。

このプロセスによって、AI モデルはその特定のドメインに対する行動や判断をより適切にできるようになることを目指します。

これらの手法は、AI が特定の問題を解決する能力を高め、より実用的で効果的なツールとして機能するよう改善するために重要です。

カスタムモデルのトレーニングは、特定の問題に対するソリューションを発見したり、独自のニーズに合わせた AI を構築する際に、大きな柔軟性とコントロールを提供します。

そのため、企業や研究者は、目的に合わせて AIモデルを修正し、能力を向上させることが可能です。

6️⃣ 【Higher Rate Limits(レート制限の増加)】

GPT-4 の既存ユーザー向けに、トークン利用率の上限が倍増されることが発表されました(OpenAI, 2023c)。これにより、ユーザーはより多くのリクエストをより高頻度で行うことができます。

また、API アカウント設定内で「レート制限(Rate limits)」や「クォータ(Quotas)」に関する変更を、直接リクエストできるようになりました。

つまり、開発者は提供しているアプリやサービスの使用状況に適した利用制限を柔軟に設定し、API を効率化することが可能です。

✅ レート制限(Rate limits):

特定の時間内に API が許可するリクエストの最大数を指します。

✅ クォータ(Quotas):

一定期間内にAPI で利用できる総リソース量(データの送受信における上限)のことです。

レート制限の増加は、アプリやサービスが、API を使ってより多くのデータを処理できることを意味しています。

そのため、開発者はより多くのユーザーにサービスを提供することや、より複雑なタスクを効率的に処理することが可能となるでしょう。

クォータには、データの送受信に関連するもの(例:データの送受信量、トークン数、リクエスト数、または特定の機能の呼び出し数、時間内に消費できるトークン数などの総量など)が含まれます。

✅ トークン数の上限:

「Token(トークン)」の意味については、前述のとおりです。「トークン数の上限」とは、API を介して送信できるテキスト量(ユーザーが送信したインプットとモデルが返すアウトプットの両方)の上限を意味します。

例えば、API が 1つのリクエストで処理できるトークン数が、最大2,048トークンまでに制限されている場合、2,048トークンを超える入力は受け付けられません。

✅ リクエスト数:

API における「リクエスト」とは、ChatGPT などのサービスに何らかのデータ処理を求めるために、ユーザーが送る問い合わせのことです。リクエストには、API のエンドポイントに対して行われるプロンプトも含まれます。

「リクエスト数」とは、ユーザーが API エンドポイントに対して行う呼び出しの回数です。サービスをレストランに例えると、まず、お客さんの注文(リクエスト)をウェイトレス(エンドポイント)が確認・理解し、キッチン(GPT モデル)に伝え、注文されたメニュー(アウトプット)をユーザーに戻します。

リクエスト数には上限があるため、開発者は上限を考慮したうえで、アプリやサービスを設計することが不可欠です。

サービスが一度に受けられるリクエストの量を制御することで、すべてのユーザーが同じサービスを平等に利用できます。

簡単にいえば、「トークン」はテキストの「量」を数える単位で、「エンドポイント」は 外部ユーザーが GPT の API サービスと通信したり、リクエストを実行したりするための「入り口」です。

つまり「リクエスト数」の制限は、その「入り口」をどれだけ利用できるかの「上限」を定めているといえるでしょう。

✅ 特定の機能の呼び出し数:

API が提供する、特定の機能や操作に対する「呼び出し回数」です。一部の機能は、他の機能と比べて高い負荷を発生させる可能性があるため、これらの機能の使用には、一般的に追加の制限が設けられています。

まとめると、今回の API のレート制限の引き上げは、ユーザーや企業が自分または自社のニーズに合わせてカスタマイズできるようにするというものです。

これにより、開発者は自分のアプリケーションに適した利用限度を設定し、API をより効率的に使用できるようになります。

🛡 著作権シールド制度の導入

トークンレートの上限を倍増し、より大量の処理が可能になると同時に、著作権侵害で提訴されたユーザーに対し、法的費用をサポートするための「Copyright Shield(著作権シールド)」という制度が導入されました (OpenAI, 2023c)。

同制度は、万が一 ChatGPT Enterprise ユーザー(主に企業)や API ユーザー(主に開発者)が、著作権侵害による提訴や法的請求を受けた場合、OpenAI が関連する法的費用をサポートすることを意味しています (OpenAI, 2023c)。

「Shield(シールド)」とは、日本語で「盾🛡」のことです。

また、「盾のように防いで守るもの」や「リスクやネガティブな影響から保護すること」「遮断物」「遮蔽物」「防御壁」「防護物」「保護物」といった意味も持ちます。

技術的な領域において、保護や防御のメタファー(比喩)として、「シールド」が使用されることは少なくありません。

つまり、同制度は、OpenAI が ChatGPT Enterprise ユーザーおよび API ユーザーの盾(シールド)となり、著作権問題からの保護を一定量保証するものです。

同制度の導入によって、これまで著作権問題について懸念を抱えていた企業や開発者も、今まで以上に安心して ChatGPT や API を利用できるようになるでしょう。

同時に、サム・アルトマン氏は、AI の学習において、API や ChatGPT Enterprise のデータを一切使っていない旨についても、強く主張しました (OpenAI, 2023c)。

💰「GPT-4 Turbo」の価格設定

これまで解説したとおり、GPT-4 Turbo は単に GPT-4 の欠点が改善され、よりスマートに設計されているだけではなく、便利な新機能が豊富に搭載されています。

そこで、私のような AI プロンプトエンジニアや開発者、企業にとって気になるのは、やはり何といっても「GPT-4 Turbo の価格設定」ではないでしょうか。

結論からいうと、GPT-4 Turbo は GPT-4 以上にコスト効率が向上しており、開発者はより安価でアクセスできるようになっています。

同モデルの価格設定に関して、サム・アルトマン氏は、以下のように発言し、会場を笑いの渦に巻き込みました。

All right. There's actually one more developer request that's been even bigger than all of these and so I'd like to talk about that now and that's pricing.

さて、実はもう1つ、今まで話した内容なんてちっぽけに感じるほど、開発者たちが本当に切望していたことがあってね。今からそれについて話そうと思う。そう、それはやっぱり何といっても「価格が一体いくらするのか」だよね(笑)。

(筆者訳)

多くの開発者が「作りたいアプリやツールはたくさんあるけど、GPT-4 の価格が理由であまり作れていない」「コストが 20% から 25% ほど削減できれば大きな飛躍につながる」と口にしている実情を受け、OpenAI は、トークン価格の減少を実現すべく、非常に注力してきたとのことです (OpenAI, 2023c)。

そのため、サム・アルトマン氏は、同イベント内で「この発表ができて、すごく嬉しいです」と前置きしたうえで、GPT-4 Turbo の入力トークン(prompt tokens)のコストは約 3 倍、出力トークン(completion token)のコストは約 2 倍減少することを明らかにしました (OpenAI, 2023c)。

厳密にいうと、新しい価格設定では、

1,000個の入力トークンあたり1¢(1セント)

1,000個の出力トークンあたり3¢(3セント)

になります。

✅「入力トークン(Prompt tokens)」とは、ユーザーが GPT-4 Turbo に送信するテキスト(プロンプト)内のトークンのことです。

✅「出力トークン(Completion tokens)」とは、GPT-4 Turbo が応答として生成するテキスト内のトークンを指します。

💨 生成スピードも改善予定

サム・アルトマン氏は、優先順位を選ぶ必要があったため、スピードよりもコストの改善を優先したものの、次はスピードの改善に取り組む予定であることを明かしました (OpenAI, 2023c)。

We're going to work on speed next. We know that speed is important too. Soon you will notice GPT-4 Turbo becoming a lot faster.

私たちは価格だけではなく、スピードも重要だということを理解しています。そのため、次はスピードの改善に取り組む予定です。皆さんはすぐに GPT-4 Turbo が他のモデルよりもはるかに高速になっているのを実感できるでしょう。

(筆者訳)

💰「GPT-3.5 Turbo 16K」のコストも改善

また、GPT-3.5 Turbo 16K のコストも減少しています。この改善によって、入力トークンは 3倍少なく、出力トークンは 2 倍少なくなりました。

つまり、これは「GPT-3.5 16K」が、先代モデルの「GPT-3.5 4K」よりも安価になっていることを意味しています。

「Fine-Tuning 版 GPT-3.5 Turbo 16K」の実行コストにおいても、従来の「Fine-Tuning 版 GPT-3.5 Turbo 4K」よりも安くなっています。

最後に、サム・アルトマン氏は「これらの変化が皆さんのフィードバックに応えられることを願っています。また、今回の劇的な改善を皆さんにお届けできることについて、非常にワクワクしています」との思いを語り (OpenAI, 2023c)、同セクションを締め括りました。

📚「GPT-4 Turbo」まとめ

GPT-4 Turbo のリリースは、開発者だけでなく、あらゆる分野のビジネスパーソンやクリエイターにとって大きな影響を持ちます。

長いコンテキストの理解と処理能力の向上により、法律文書の分析、複雑なデータの処理、学術論文の読み解きなど、新たな可能性が開かれることでしょう。

このような技術の発展を目の当たりにした今、私たちがその潜在力を最大限に引き出すためには、日々の仕事やプライベートにどのように活用できるかを、私たち自身で考えることも大切です。

OpenAI は、GPT-4 Turbo を通じて、AI と人間のインタラクションをより深く、より有益なものにすることを目指しています。

この記事が、少しでも皆さんの役に立てれば幸いです。

📚 References

OpenAI. (2023a, November 6). Introducing GPTs. https://openai.com/blog/introducing-gpts

OpenAI. (2023b, November 6). New models and developer products announced at DevDay. https://openai.com/blog/new-models-and-developer-products-announced-at-devday

OpenAI. (2023c, November 6). OpenAI DevDay, Opening Keynote [Video]. YouTube. https://www.youtube.com/watch?v=U9mJuUkhUzk

OpenAI. (2023, November 7). [Screenshot of OpenAI Playground interface]. https://platform.openai.com/playground

OpenAI. (2023, November 7). We're rolling out new features and improvements that developers have been asking for: [Post]. X. https://twitter.com/OpenAI/status/1721596740024078340

OpenAI. (2023, November 8). [Screenshot of OpenAI Playground interface]. https://platform.openai.com/playground

この記事が気に入ったらサポートをしてみませんか?