Ollamaを用いてWindowsでLlama3を試してみる

LLama3が登場したことが話題になっています!

とりあえず簡単に触れるようにしたいと思い、色々調べたところ"Ollama"というツールを見つけたので試してみました!

誰でも簡単に使えるように記録として記したいと思います。

ollamaのインストール(Windows)

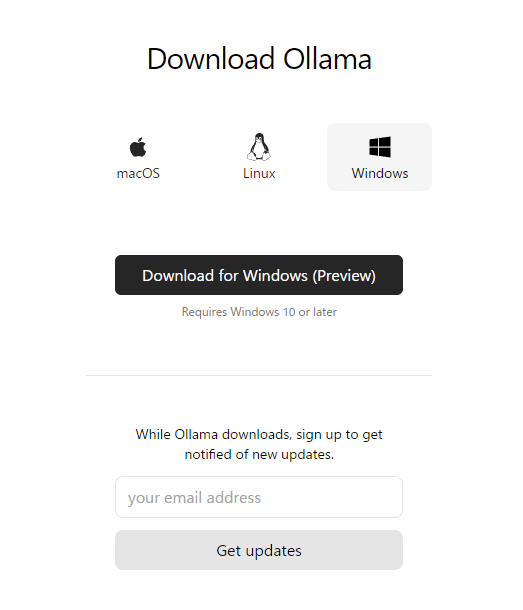

①ollamaのサイトにアクセス

②”Download”を押下する

③Windowsを選択して"Download for Windows"を押下する

*Windows版はまだプレビュー版です

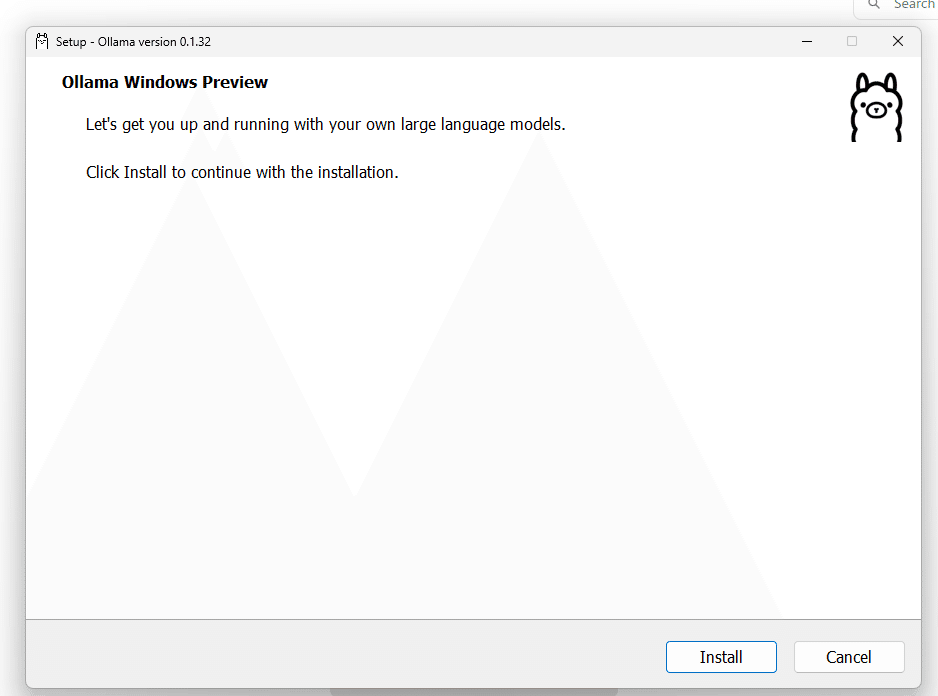

④"OllamaSetup.exe"がDLされているのを確認して実行

⑤実行すると下記のダウンロード画面が出てくるので、表記に従って”Install”を押下する

画面が消えたらインストール完了

⑥コマンドプロンプトを開く

⑦コマンドを入れて確認

バージョンが表示されていればOK!

ollama --version

*追記:macやubuntuの場合はからあげさんの記事を参考にしてみてください!

Llama3を試してみる!

それでは実際にローカルLLMを試してみましょう!

試せるLLMはGithubのページに記載があります。

今回はLlama3の8Bのモデルを試してみます。

*空き容量が必要なので注意!

①上記の"Download"と書いてあるコマンドを入れる

ollama run llama3

モデルのダウンロードに少し時間がかかります。

*2回目以降も始めるときはこれを実行します!

②Send a message が出ればOK

③プロンプトを入力してみましょう!

日本のことはあまり詳しくないようです。

以上でローカルLLMの導入は完了です!

皆さんもぜひいろいろと試してみてください!

Xでも発信していますので、ぜひフォローをお願いします!

Xのリンク

この記事が気に入ったらサポートをしてみませんか?