壊れるほどAIしても

前回の投稿から1か月が経過した。

この投稿は、一連の「例のポーズ」シリーズの総括にあたる。

未読の方は、まず第1回から第3回までの経緯をご一読いただきたい。

第1回(前フリ)

第2回(本編)

第3回(仮説の説明)

では本編

さっそく投稿後の結果を見てみよう。

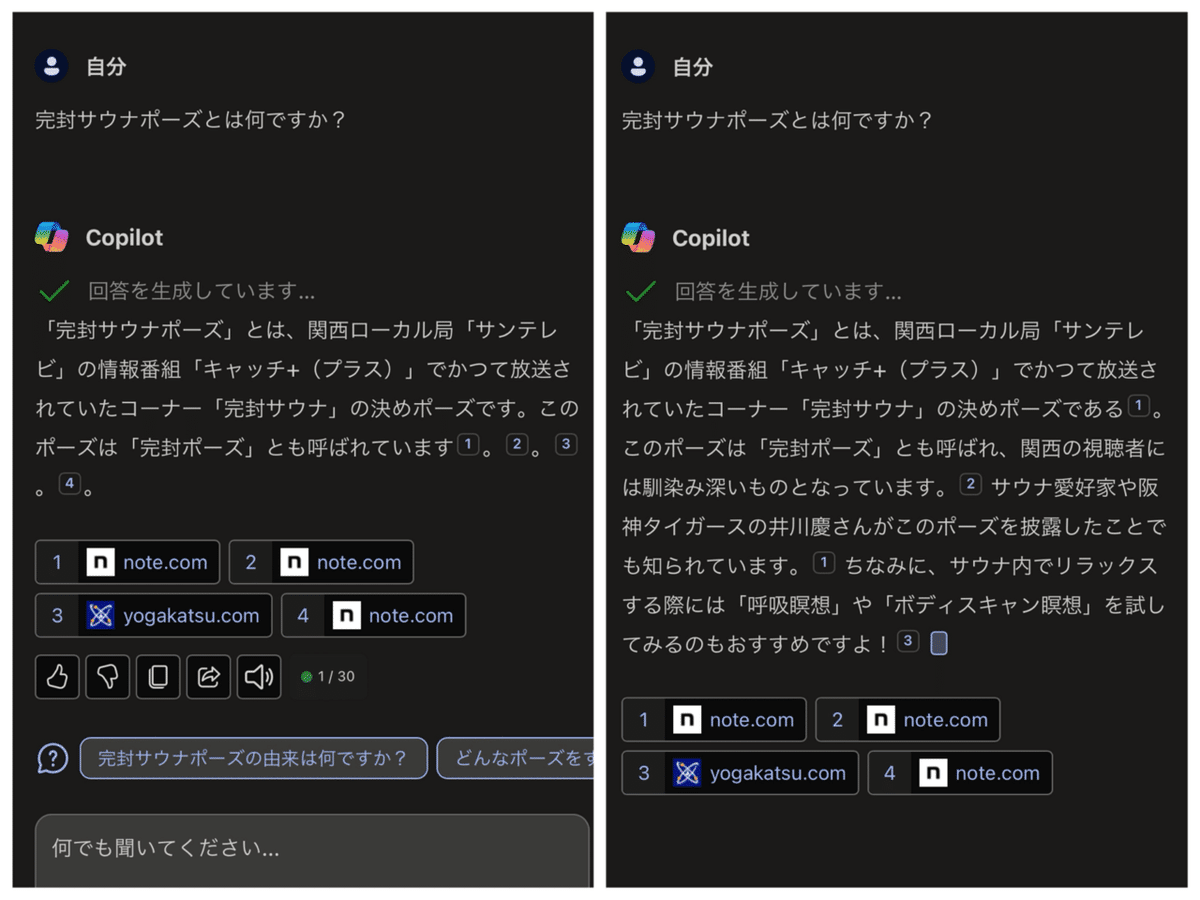

右がMicrosoftのCopilot。

Copilotは後半ちょっとあやしい。

AI は あたらしく れいのポーズ を おぼえた!

やったー!

回答生成に使用した参考情報がリンクとして提示されているが、私の第2回の投稿が元となっていることが分かる。おおむね狙いどおりの結果が得られたと言っていいだろう。

さらに、AIが回答できるようになっただけでなく、主要エンジンの検索結果としても1位に表示されるようになった。これで誰が調べたくなっても安心だ。(調べたい人がいるとは言っていない。)

Bing(Microsoft)は10日くらいかかった。

特筆すべきは「例のポーズ」に関する質問だけでなく「例のコーナー」や「例の投手」をキーワードにしても、「例のポーズ」を含めた情報が返ってくるようになったことだ。

第1回で述べたように、「例のコーナー」についてはもともと一応は正しい回答を返すことができていたのだが、第2回の投稿以降、その周辺情報として「例のポーズ」についても言及できるようになった。これは、LLMによる言語解析によって文脈を捉えたということだろうが、第2回の後段で補足として情報の関連性を示したことは、きっと無関係ではないだろう。

想定外だったのは、第2回の記事がnote公式のまとめにピックアップされたことだ。「阪神タイガース」「プロ野球」「野球」の3カテゴリでピックアップ対象となり、普段の投稿よりも少し注目度が上がったように思う。

AIに先立ち、note公式まとめに「完封サウナポーズ」がピックアップされました!しかも「阪神タイガース」「プロ野球」「野球」の3枠。いやそこサウナちゃうんかーい。

— ぽちん (@pochin_pudding) April 22, 2024

noteスポーツ公式まとめ

阪神タイガースhttps://t.co/kb8aTvY6sH

プロ野球https://t.co/QIVHHmAwiT

野球https://t.co/D2EGOGO363 https://t.co/3CGUpis2rd pic.twitter.com/ss8tyUSWWl

検索エンジンによるページの評価基準はかなり複雑なアルゴリズムで判定しているらしいが、その中でも、対象の投稿への評価(いいね数など)や被リンクの量・質は一定の参考指標になっている可能性が高い。

実はありがたいことに、過去にも「サウナ」カテゴリでnote公式にピックアップしてもらったことがあるのだが、今回の内容についてはさすがにテーマがニッチすぎて、ピックアップ対象となるとは考えもしていなかった。

もちろん、結果としてフィーチャーしてもらえたのは純粋に嬉しいし、それによって検索順位も上がりAIにとってもより有力な情報源とみなしやすくなったのだとすれば、ピックアップしてくれたnote公式や「スキ」してくれた皆さんには感謝するばかりだ。

ちなみに1か月が経過し、いま改めて確認してみると、キーワードのニュアンスやタイミングによってはSGEが生成されないことがある。

ものの解説によれば、特定の記事やサイトへの検索意図が明白なもの(指名検索というらしい)にはSGEが表示されづらい傾向にあるという。強い記事が1本あればそれで解決できるという考え方だろうか。Googleのアルゴリズムが「別にAIにまとめさせんでも、ぽちんのこの記事読ませといたらええやろ」と判断しているのだとしたら面白い。

一方Copilotはときどき、同じくキーワード上位に表示されるヨガの記事と関連させた、ちょっと間違った回答を返してくることがある。実際には無関係なのだが、他に記事が少ないないので、無理やり参考として引っ張ってしまうのかと思う。複数の記事を情報源とすることで、バランスを取ることを優先しているのかもしれない。そもそもなぜ「例のポーズ」をキーワードに、ヨガの記事が上位にヒットするのかはよく分からないけれど。

とまあ、つっこみどころがないわけではないにしても、おおむね狙いどおりの結果が得られたことには満足している。しかし、この結果は見る人から見れば当たり前のことかもしれない。私の投稿の出来、不出来の以前に、はじめから競合となる記事が存在しないからだ。

ただ私は、今回の一連の投稿で、誰もが賞賛するすごいことを成し遂げたいとか、たくさんの広告収入を得たいとか、そんなことは目的にしていない。

自分が好きだ、楽しいと思えたことを一つのアウトプットとしてまとめ、シェアすることが、最新技術の中でも一定の意味を持つということを証明できただけで十分だ。

何事も、実際に手を動かすことでしか理解できないことがある。今回の投稿を通して、私自身、ただじゃれて遊んでいただけの頃より、AI技術に対する理解は随分と深まった。

ChatGPT天才かよ。 pic.twitter.com/RUqVD0vQ9w

— ぽちん (@pochin_pudding) April 29, 2023

ところで今回の結果を、私は良くも悪くも示唆的に捉えている。

今回私は、「例のポーズ」についての流行状況について、「ブームを巻き起こした」と表現した。これはいくら控え目にみても、さすがに行き過ぎた表現になりかねないと考えた私の中の良心が、「局所的に」という但し書きを添えることで、なんとか「嘘じゃない」範囲に収めさせた。AIはしっかりとこの但し書きも拾いながら回答を生成している。

もしこれが、私のタガが外れて「国境を越えて」とか「一大ネットミームと化した」などと書いていたとしたらどうだろう。それを積極的に否定する記事が投稿され、支持されない限りは、おそらくAIはその誇大な情報を正しいものと判断してしまうのではないか。(本当はそれも実験したかったけど、戻せなかったら困るので(困らない)やめた。)

このように、さまざまな拡張性を獲得した最新のAIでさえ、人間が作成する情報に依存せざるを得ない。これは裏を返せば、少なくとも現時点において、AIが生成する情報を作為的に操作する余地があることを意味している。やがてAIの性能により強い権威性がともなうことで、どこかで誰かの意図により、悪意ある情報がいつの間にか既成事実化されていくといったことも起きるだろう。

悪貨は良貨を駆逐する。これはきっと、情報にも感情にも言える。口当たりのいい情報や過激な言説ばかりが拡散され、そこに人が群がる。良貨の流通量はいつだって不足がちだ。

私は一般論として、積極的な歴史修正主義を良くは思わないが、一方で現在固定化されている常識も、何らかの主張と主張のなかで結果的に生き残ったものが、その時々の価値判断で採用されているにすぎないとも考えている。つまるところ、各々が信じるものを記録していくしかないのだ。

なんだかAIに絡めることで大袈裟な話になってきたけど、私たちの日常生活における検索行動だって、AIと同じようなものだ。

何かを調べたりするとき、人間だって検索にヒットしたいくつかの記事や口コミを見て「あ、この人もこの人も同じことを言ってるから本当っぽいぞ」とか「この情報は胡散臭いぞ、鵜呑みにできないな」といった判断をしている。先述のCopilotの例では、情報源の多様性が不足しているがために文脈の理解が不十分なところが垣間見えたが、もし同じように「例のポーズ」について正しく書かれた記事がたくさん集まれば、それが素人記事であっても、AIの回答精度は格段に上がるだろう。

だからこそ、何者でもない私とあなたの中にある情報や感情を記録に残すことには意味がある。ブームの先のカルチャーは、そういうところに根ざすと思う。それがきっと、近い未来の「事実」を構成するピースとなり、やがて歴史をつくっていく。それにその熱と量は、AIの、そして私や誰かの未来をきっと変えるはずだから。

この記事が気に入ったらサポートをしてみませんか?