そうだ!AI画像生成をちゃんと勉強しよう💡10章:ControINet

※勉強するのはStable Diffusion、SeaArt系になります。

前回までで、Text to ImageとImage to Image の内容は一段落した気がします。

今日私が勉強するのは、ControINetについてです!

そろそろ実践増やしながらの投稿になるので、不定期になる予感…

でも、できれば毎日投稿して30日バッジほしいな~って思ってます😙

それでは本日も等身大の私でいきますよろしくお願いします(。•̀ᴗ-)✧

ControINet (コントロールネット)とは

画像生成をもっと細かくコントロールできるようにするツールです。これを使うと、画像生成の際に特定のガイドラインや指示を与えて、生成される画像の見た目を調整することができます。

通常、Stable Diffusionは与えられたテキストの指示に従って画像を生成しますが、コントロールネットを使うと、単にテキストだけでなく、他の画像やスケッチを基にして画像を生成することができたり、元の画像から構図の情報だけを抜き出して新しく画像を作ったりすることができます。

これにより、もっと具体的なイメージに近い画像を作り出すことができるのです。

ControINetの種類(一部)

コントロールネットには、いくつかの種類があり、それぞれ異なる方法で画像生成をコントロールすることができます。

ガイドブックで紹介されていた中から、気になったもの4種類を勉強したいと思います✨

1. Canny (キャニー)

元の画像の輪郭やエッジ(境界線)を抽出して、その情報を元に画像を生成する。

2. Depth (深度)

画像の中でどの部分が手前にあり、どの部分が奥にあるか(深さ)を検出し、その情報を元に画像を生成します。

3. Openpose (オープンポーズ)

人の体のポーズを検出して、そのポーズに基づいた画像を生成する。

特にキャラクターデザインやイラスト制作に役立つ。

4. Scribble (スクリブル)

非常に簡単な落書き(スクリブル)や手書きの線画を元にして、その形状を参考に画像を生成します。

ControINetのパラメータ

まずはコントロールネットの不明なパラメータの理解からです!

また分からない単語ばっかりで気が遠くなりそうです😇

Enable:コントロールネットを有効化するためのボタン。使うときは必ずチェック✅を入れる

Low VRAM:VRAMの容量が少ないパソコンはチェック✅を入れると、生成速度が遅くなるがコントロールネットが使えるかもしれない

Pixel Perfect:プリプロセッサ解像度の最適化。

Allow Preview:チェック✅を入れておくと、マスク画像をプレビューできる。(爆発マークのボタンを押す)

Effective Region Mask:コントロールネットを適用する領域。白が有効、黒が無効。

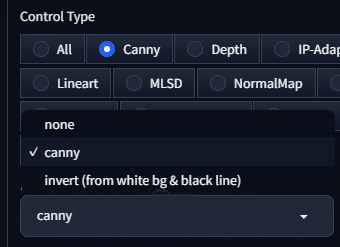

Control Type:コントロールネットの種類。使うものを選ぶ。

Preprocessor:基本的にコンロトールタイプと同じものを選ぶ。

Model:通常のチェックポイントとは違う。

Control Weight:コントロールネットの適用させる強さを決める。プロンプトの強調と似たような役割。CannyやDepthでは強めにする。

Starting Control Step:どの程度のステップからコントロールネットの適用を開始するか。

Ending Control Step:どのあたりでコントロールネットの適用をやめるか。

※Starting Control StepはEnding Control Stepより小さくしないとダメ。

Control Mode:Stable Diffusion側かControl Net側のどちらを優先するか。(半々、Stable Diffusion側、Control Net側の3種類)

Resize Mode:マスク画像を生成画像の解像度が違う場合に、どのようにリサイズするか。img2imgにあったものと同じ。

専門的なことは分からないので、アバウトですがパラメータの確認ができました!

この方の記事がとってもとっても役に立ったのでシェアさせていただきます✨

ControINet実践

習うより慣れろということで実践で覚えていきます!

まずは元画像を用意 ♪

プロンプト:bishoujo,black hair,lipgloss,v-shaped eyebrows,narrowed eyes,eyeshadow,maid,fantasy,indoor,full_shot,top quality,super fine illustration,8K(美少女,黒髪,リップグロス,V眉,細目,アイシャドウ,メイド,ファンタジー,インドア,フルショット,高画質,超精細イラスト,8K)

モデル:awpainting

Clip skip:2

VAE:orangemix

サンプラー:DPM++ 2M Karras

サンプリングステップ:30

CFGスケール:7

画像サイズ:512×768

そしてこの画像をコントロールネットに入れて、「Enable」にチェックを入れて有効化しました。

1. Canny (キャニー)

Control Typeを選択してあると、Preprocessorは使えるものしかポップアップしなくなるんですね!ありがたい✨

パラメータはデフォルトのままにしました。

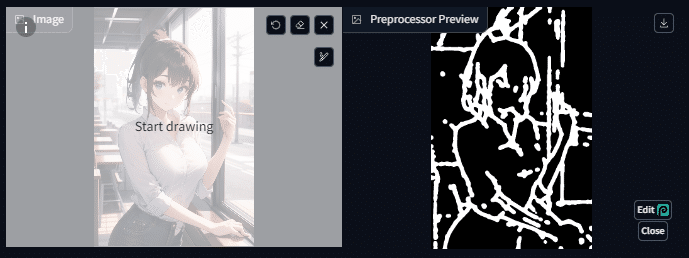

あと、解説サイトとかでよく見るあの白黒の線画みたいなの出したいので「Allow Preview」をオンにしてみました。

プレビューしてみたいと思います🤩

できた!うれしいー!w

このあと「Generate」を何度押しても色違いはできず…

どうやらモデルをダウンロードしないといけないみたいです😇

(そしてやり方が分からず数時間…(›´ω`‹ ))

モデルも導入できました!再開です!! 終わったらプリン買います!

無事モデルも選択できたので「Generate」ポチっ。

Stable Diffusion立ち上げなおしたので画像サイズがリセットされてました。

元の画像サイズに合わせて再び生成。

\ できたー🙌 /

嬉しい✨

喜びに浸ったところで

あと何枚か出したいので、バッチサイズを4にしていっぺんに4枚生成してみます。

おー!!

なんだかそれっぽくなってきましたね😍(どれっぽく)

余談ですが、調べごとの途中で「xformers」という、生成速度をあげてくれる設定をオンにしたので、初めてバッチを増やして生成してみました!

プロンプト調整してみる

いまは水彩画みたいに出力されているので、ネガティブプロンプトに「水彩画」と入れて生成してみます。

ちなみに他は空です。

なるほど…これはこれで好みだけど、描きたい画風がある人はプロンプトを工夫しないといけないみたいですね。

次はどこかのサイトから頂戴してきたおすすめネガティブプロンプトを入力してみます。

人様のものなので載せられなくてすみません🙏

こちらのサイトにあるので、気になる方は見てみてください。

プロンプトに「red eyes」を入れたらちゃんと赤い目になりました✨

キャニーはこのくらいにして次にいきたいと思います。

これも色々試しがいがありそうで、時間がいくらあっても足りなそうです。

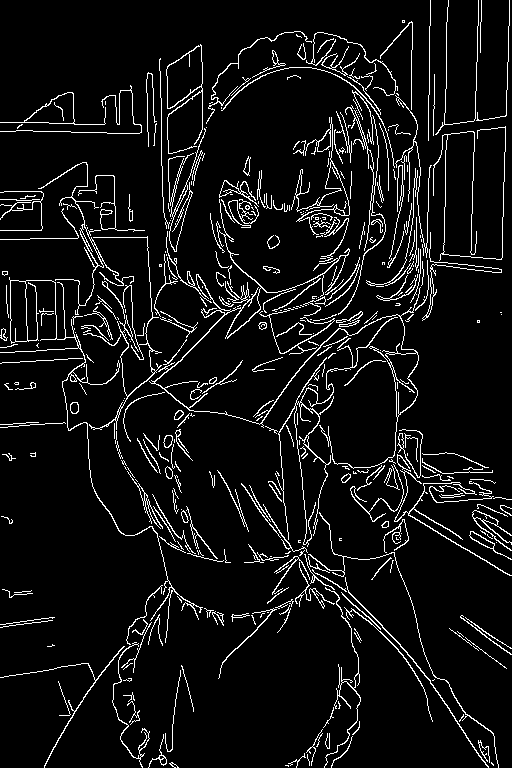

2. Depth (深度)

こちらもまずは元画像を用意します。

プロンプト:bishoujo,long hair,long bangs,centre parting bangs,lean forward,stylish_pose,cowboy_shot(美少女,ロングヘア,長め前髪,センターパート前髪,前傾姿勢,スタイリッシュなポーズ,カウボーイ風ショット)

モデルなどはキャニーのときと同じです。

コントロールタイプを変更したら、プリプロセッサーとモデルが自動で変わってくれました!なんて親切なの。

はい、それではまずはプレビューしてみたいと思います。

キャニーより少し時間がかかるみたいですね。

できましたー♪ これもそれっぽいですね😍

では、とりあえずこのまま何もいじらず「Generate」してみます。

おー✨

プロンプトとネガティブプロンプトがそのままでもいけますね!

ちょっとチャレンジで、プロンプトに「smile」を足して笑顔にしてみます。

できたー!感動✨

もう使っている人なら当たり前かもしれないけど、初めての私はめちゃくちゃ感動してますw

このポーズ的に水着も着せたいですね😋

上着とショートパンツを履いたシルエットだから、完璧な水着姿にはなりませんね。

プロンプトを空にして4枚生成してみます。

元のポーズのせいかセクシーな画像が出てきました。

ポーズによって汎用性が変わりそうです。

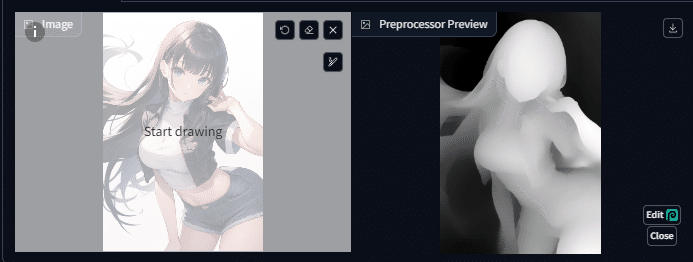

3. Openpose (オープンポーズ)

次はオープンポーズです。

例によって元画像を用意します。

プロンプト:bishoujo,long hair,long bangs,blue hair,lean forward,stylish_pose,smile,cowboy_shot(美少女,ロングヘア,前髪長め,青髪,前傾姿勢,おしゃれなポーズ,笑顔,カウボーイショット)

このパラメータもキャニーのときと同じです。

コントロールタイプをオープンポーズにして、プレビューしてみたいと思います。

これも結構時間がかかりますね。

棒人間出ました😆

ではドキドキの「Generate」です。

おぉ😍いいですね!

プロンプトに髪の毛の指定が結構入っているので、取り除いてバッチサイズ4で生成してみたいと思います。

基本のポーズ以外は、

指定すれば思い通りに、指定しなければランダムになってとっても楽しいですね🎶

もっと試したいところですが次に行きます。

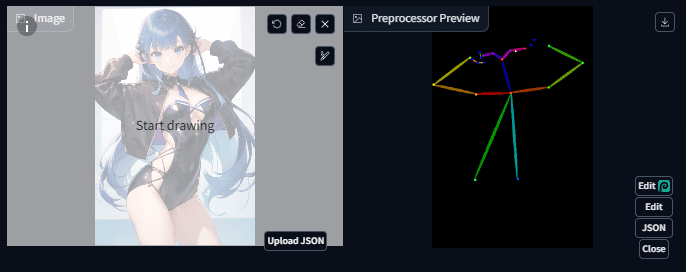

4. Scribble (スクリブル)

最後のスクリブルです。

元画像から用意していきましょう。

プロンプト:bishoujo,ponytail,leaning_on_object,stylish_pose,upper_body(美少女,ポニーテール,寄りかかる,スタイリッシュなポーズ,上半身)

これも他のパラメータはキャニーのときと同じです。

一瞬でプレビューがでましたw

アバウトな線画になりましたが大丈夫なのでしょうか。

それでは「Generate」します。

こんな感じになりました😆

これは線画だけでだいぶ画がわかるので、試しにプロンプトを空にしてみたいと思います。ネガティブプロンプトはそのままです。

服装に不自然さが出ましたが、やっぱりプロンプト無しでも同じような画像になりました。

最後に4枚生成してみます ♪

思ったより色々なバリエーションが出てきました✨

あのアバウトな線画はこのバリエーションを生むためなのかもしれませんね🤩

コントロールネット4種類が学び終わりました。

完全にガチャじゃない所が実用性高そうで、これは使いこなしたいですね!

今回はいつものガイドブックだけじゃなく、他の方の記事やサイトも参考にさせていただきました。

記事の途中にリンクがあったりするのでよかったら参考にしてください。

そしていつものガイドブック👇

📢お知らせの通り今回からおまけを有料部分として出させていただきます!

今日のサムネ生成過程(ChatGPT,DALL-E 3)

私「「そうだ!AI画像生成をちゃんと勉強しよう💡10章:ControINet」というタイトルのnote記事を書きました。 このタイトルに合うような画像を作ってください。 要望は、夏服を着たロングヘアーの美少女、日本の少女漫画のような繊細なタッチで、水彩画のようなカラーリングで16:9で描いてください。」

ChatGPTくん「こちらが「そうだ!AI画像生成をちゃんと勉強しよう💡10章:ControINet」のタイトルに合うイラストです。ご確認ください。」

私「可愛いイラストをありがとう!」

以上 ♪

ここから先は

¥ 100

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?