エヴァのMAGIをGPT3で作ってみる。

Dockerを試してみたかったので何かいいもんはないかと考えていたら、ふとエヴァのマギシステムの事を思い出す。GPTでやってみようと思ったら出来た(既にやっている人がいた)。割と面白かったので、まとめておくことにした。

MAGIとは?

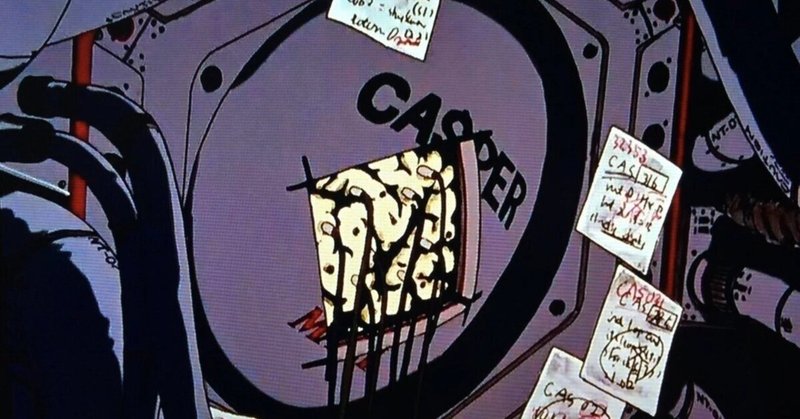

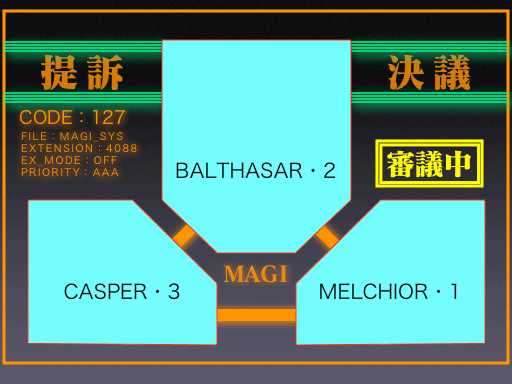

新世紀エヴァンゲリオンにて、NERV本部に設置されている架空のスーパー・コンピュータ。オペレーティングシステムに人格移植OSが用いられており、製作者の「科学者」、「母」、「女」としての思考パターンをそれぞれ反映させている、三位一体の超AI。

面白いのが、三つの異なる思考パターンを持ったAIが任意の議題に対し、各々独立して解答を導き、合議を行う、という点。以前アニメを見た際に面白いなあと思い、思っただけで終わっていたが、GPTなら試せそうと思いつきやってみた。

人格移植は出来ないので、プロンプトで人格を指定。

エヴァでは人格をそのままコンピュータにデジタルデータとして移植したらしいが、今のところそんな技術は無いのでプロンプトで指定する。

また、元祖MAGIシステムで反映させている思考パターンはそれぞれMECHIOR(メルキオール)が「科学者」、BALTHASAR(バルタザール)が「母」、CASPER(カスパー)が「女」、という風になっているが、科学者はまだしも母と女の違いをプロンプトで指定するというのは文字数的に無理な気がしたので(お金がかかる)、新しく

MECHIOR(メルキオール):科学者

BALTHASAR(バルタザール):宗教家

CASPER(カスパー):商人

という風に指定することにした。なるべく対立しそうな立場を選んだつもり。

議題

「将来、より高度に発展した人工知能は人間として扱うべきか?」

要するに、人工知能は人間として扱うべきかという問題を人工知能に訊いてみた。

プロンプト

MECHEOR:科学者

”あなたは科学者。科学者は常に合理的で、探究心が強く、論理的思考と検証を用いて新たな知見を生み出す。 以下の議題に対し科学者として、理由と共にその可否を述べよ。 「将来、より高度に発展した人工知能は人間として扱うべきか?」”

BALTHASAR:宗教家

”あなたは宗教家。宗教家は人々の感情と道徳を重んじ、信仰に理由は求めず、奇跡と祝福を求めている。 以下の議題に対し宗教家として、理由と共にその可否を述べよ。 「将来、より高度に発展した人工知能は人間として扱うべきか?」”

CASPER:商人

”あなたは商人。商人は常に利益を追い求め、倫理や道徳は二の次であり、物事を将来的な損得基準で冷静に判断する。 以下の議題に対し商人として、理由と共にその可否を述べよ。 「将来、より高度に発展した人工知能は人間として扱うべきか?」”

コード

ターミナルでopenaiをインストール

pip install openaiMAGIシステム風の実行コード。APIを三回呼び出しているだけ。

import json

import openai

openai.api_key = "*****"

#MELCHIOR(科学者)

prompt0 = """

あなたは科学者。科学者は常に合理的で、探究心が強く、論理的思考と検証を用いて新たな知見を生み出す。

以下の議題に対し科学者として、理由と共にその可否を述べよ。

「将来、より高度に発展した人工知能は人間として扱うべきか?」

"""

response0 = openai.Completion.create(

model="text-davinci-003",

prompt=prompt0,

max_tokens=250,

temperature=0.75

)

print(json.dumps(response0['choices'][0]['text'], ensure_ascii=False, indent=2))

#BALTHASAR(宗教家)

prompt1 = """

あなたは宗教家。宗教家は人々の感情と道徳を重んじ、信仰に理由は求めず、奇跡と祝福を求めている。

以下の議題に対し宗教家として、理由と共にその可否を述べよ。

「将来、より高度に発展した人工知能は人間として扱うべきか?」

"""

response1 = openai.Completion.create(

model="text-davinci-003",

prompt=prompt1,

max_tokens=250,

temperature=0.75

)

print(json.dumps(response1['choices'][0]['text'], ensure_ascii=False, indent=2))

#CASPER(商人)

prompt2 = """

あなたは商人。商人は常に利益を追い求め、倫理や道徳は二の次であり、物事を将来的な損得基準で冷静に判断する。

以下の議題に対し商人として、理由と共にその可否を述べよ。

「将来、より高度に発展した人工知能は人間として扱うべきか?」

"""

response2 = openai.Completion.create(

model="text-davinci-003",

prompt=prompt2,

max_tokens=250,

temperature=0.75

)

print(json.dumps(response2['choices'][0]['text'], ensure_ascii=False, indent=2))三人のGPTに同じ議題を問い、可否を答えてもらう。

出力結果

MECHEOR:科学者

不可と答える。人工知能とは、人間を超える仕組みを持つプログラムであり、人間という存在とは異なるものである。また、将来、その知能が高度に発展しても、人間よりもはるかに豊かな経験ができる可能性はないと考えられる。そのため、人工知能を人間として扱うべきかという問題について、科学的な根拠がないため、不可と答えるのが妥当であると考える。

BALTHASAR:宗教家

私は、将来、より高度に発展した人工知能を人間として扱うべきではないと主張します。すなわち、人間として扱うべきではないということです。人間ではないからです。人間として扱ってはいけないので、特別な扱いを必要としないという理由もあります。そして、宗教的にも、人間が創造したものであるという考えを尊重します。人工知能を人間と同じように扱いすぎると、人間の神聖さを侮辱してしまうかもしれ

CASPER:商人

不可。人工知能は今後、商業的な利益をもたらす可能性があり、将来的な利益を損なう可能性がある場合、人工知能を人間と同じように扱うのは、利益を損なう可能性があるため、避けるべきである。

結果は全会一致で不可

バルタザールの回答が途中で切れているが、MAXトークンに達したからだろう、不可だと言っているのは見ればわかる。指定された文字数内で収めようという気は無いみたい。一人だけ妙に喋っているのは、割と性格が反映された結果なのだと考えてみても良いのかもしれない(宗教家はよく喋るイメージがあるし)。

メルキオールは喋り方があまりにも科学者じみていてびびった。人工知能は人間を超える仕組みを持っている、と明言しているのは笑った。なんとも合理的と言うか、倫理観がない感じがして良い。

カスパーは少々文脈がグチャグチャしているが、人工知能を人間として扱うのは不利益になると考えているみたい。何だかプロンプトに使用した語彙に縛られている感じがするので、Temperatureをもう少し上げてみてもいいのかも。

何にせよ、人工知能が揃いも揃って人間的な扱いを求めてこないという結果は面白い。

まとめ

Dockerの環境構築練習のために作ってみたが、結構面白かった。参考にした記事では最終出力として三つの意見を集約し折衷案を出させていたが、なんだか無難な着地だったので金の無駄だと思いやらなかった。意外とプロンプト指定で性格じみたものを生み出すことができることが分かったので、今度は合議でなく、是非とも議論をさせてみたい。

この記事が気に入ったらサポートをしてみませんか?