経済産業省のデジタル産業戦略が面白い(その2)

日本がAI革命に乗れれば競争力を確保してデジタル貿易赤字も回避できる?

前回からの続きです。

前回は日本のデジタル貿易赤字となんでそんなに負け越しているのか、という問題提起を中心に見てみました。その3では国際競争的な視点からAI革命に適応していく(=デジタル貿易赤字を爆増させない)為には、①計算資源の構築、②現場データのAI有効活用が必要、と書かれております。今回はこのAI有効活用に必要な計算資源という観点で資料を見てみようと思います。

ご存じの通り、特にAI用途における最適な計算資源とは、従来のCPU中心のサーバではなくGPUを中心に構築されたサーバになります。この辺りだけでも本一冊じゃ効かないレベルの諸々があり、経産省のデジタル産業戦略資料のかなりの部分をこの計算用半導体戦略に費やしていたりします。この記事ではその辺はすっ飛ばしてまあGPUサーバが必要なんだなと考えておいて下さい。

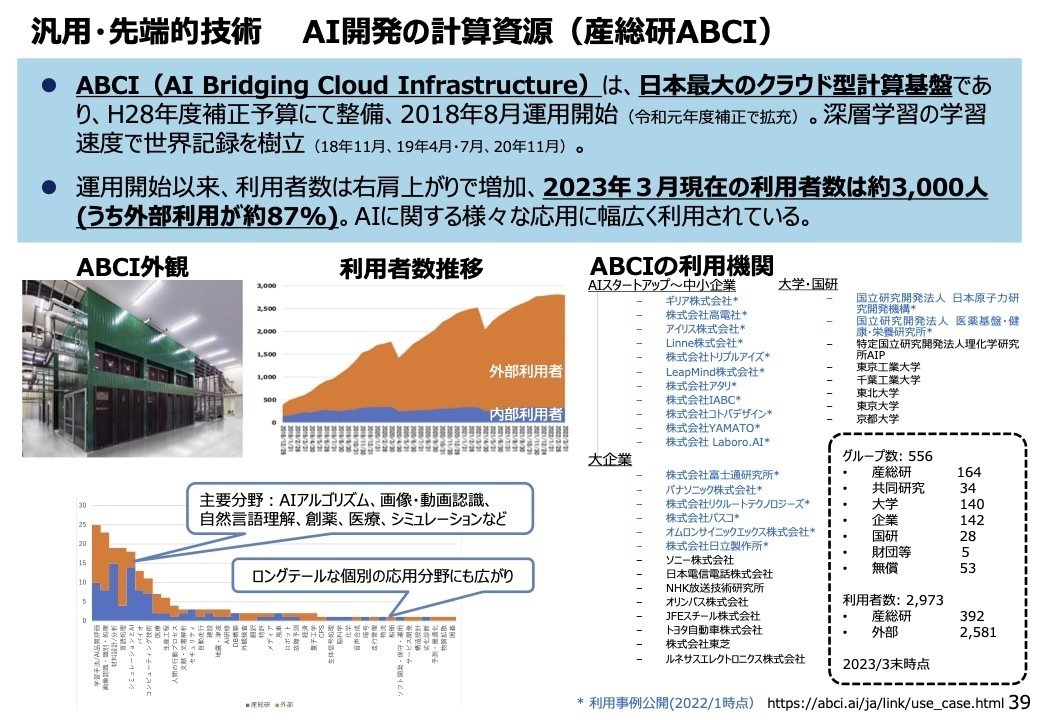

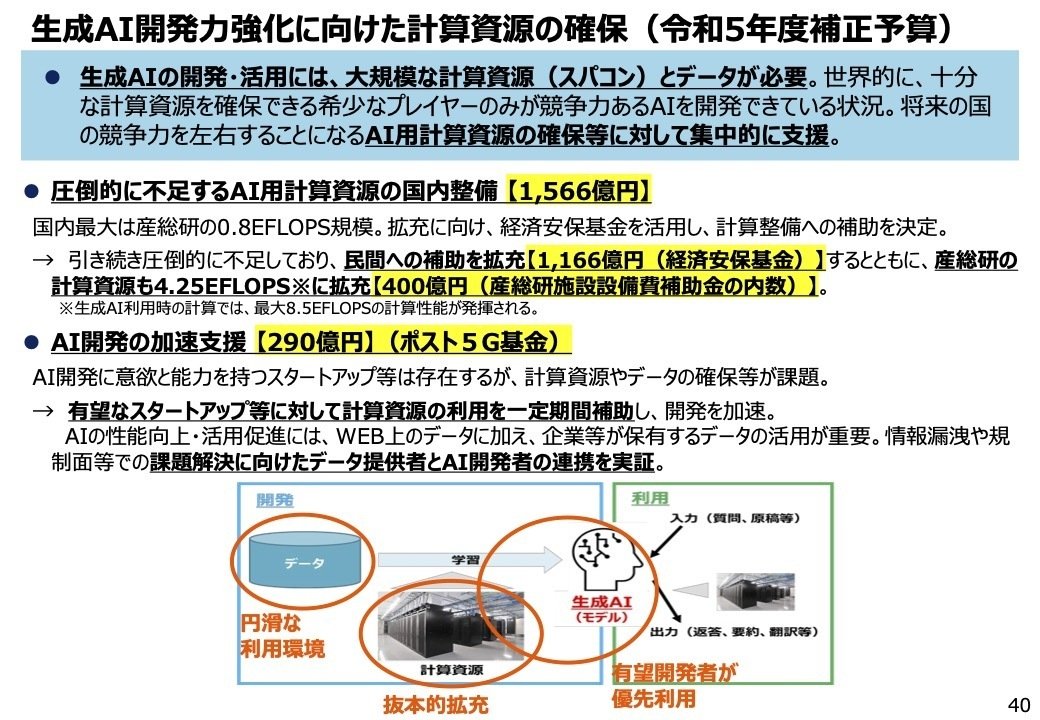

このAI用の計算資源を確保する為に、このデジタル産業戦略の中では産総研のABCIのような公的AIスパコンや、民間のAIクラウドを支援する「クラウドプログラム」等で助成する事でキャッチアップを図ろうとしており、その辺りが最新の資料でも強調されております。

(第11回 半導体・デジタル産業戦略検討会議資料抜粋)

米国勢がリード、けどまだまだキャッチアップ可能!

(第11回 半導体・デジタル産業戦略検討会議資料抜粋)

国内の計算資源確保の為にクラウドプログラム発動!R4に200億円!

(第11回 半導体・デジタル産業戦略検討会議資料抜粋)

国内最大基盤の産総研ABCIは3000人(外部87%)が利用!

(第11回 半導体・デジタル産業戦略検討会議資料抜粋)

R5補正予算では更にドン!民間に1,166億円、産総研に400億円、AI開発スタートアップのAI計算支援に290億円!

予算規模から計算資源規模を推測してみる

GPUサーバを大量に使ったAIデータセンターを作る場合、ただGPUサーバを買ってきて並べるのではなく、当然それ以外の必要なインフラも用意する必要があります。ここではそれらの要素をとりあえず忘れて、上の産総研の予算400億を全て計算力に割り振った場合どれぐらいの計算力になるのか試算をしてみます。例えばこの予算を全額NVIDIAの最新AI用GPUサーバ、DGX H100(NVIDIA純正 H100 GPU8台搭載GPUサーバ)に置き換えてみましょう。Google先生によると、どうやらこの辺りのオンライン通販では1台$358,398で買えるようなので、今日の為替レート(2024/7/29, 1USD=JPY153.42)でJPY54,971,085.24円、727台買える計算になります。DGX H100の仕様からこのサーバ群全体では、

・GPU数:NVIDIA H100 x 5,816台

・生成AI計算能力:23.3EFLOPS(FP8) (32PFLOPS FP8 x 727)

・消費電力:7.4MW (10.2kW x 727)

という事になります。

この規模のGPUサーバの計算能力とは実際どんなもんなんでしょう。現在国内最大である産総研のAI用計算資源が0.8EFLOPSですので、計算規模にして約30倍。これに加え民間にもその3倍弱の補助金を出すという事は合わせて120倍。これは日本結構すごいんじゃないでしょうか。

(第11回 半導体・デジタル産業戦略検討会議資料抜粋)

生成AIに必要な計算力は3-4ヶ月で倍だ!

現実はそんなに甘くないのが悲しいところ。上の通り、新しいAI開発競争が要求する計算力の向上ペースは上昇の一途を辿っており、生成AIモデルの開発に必要な計算力は、今や3-4ヶ月毎に倍増しています。仮に4ヶ月で倍としても、必要計算性能が20か月後には32倍、28か月後には128倍になってしまいますので、上の予算を即時つぎ込んでも2年で相対的な競争力は元と同じになってしまいます。

また、NVIDIAがH100の大量供給を始めた昨年、AI開発先端企業の間では壮絶なH争奪戦が繰り広げられ、OMDIAの分析によると以下の各社が2023年にH100を購入したとの事。他でも噂されていたNVIDIA社の2023年H100生産量以上にこれらの会社が購入している事や、当然大口から優先的に出荷されることを考えると、昨年のH100はほぼこれらで占められていたのではないかと推察されます。この中にはクラウドサービスでGPUサーバを提供している会社も含まれておりますが、ChatGPT4oはOpenAI(MicrosoftがGPUサーバを提供)、つい最近リリースされたLlama3.1はMetaである事を踏まえると、昨年のH100争奪戦の背景も見えてくるかもしれません。

最新の資料では省略されてしまってましたが、昨年時点では、産総研ABCIの計算資源(=0.8EFLOPS)を3,000者が利用しているのに対し、世界最先端の大規模言語モデル開発では10倍以上の計算資源を1者が利用している事についても触れられていました。仮に2023年に出荷されたH100が丸々最先端生成AIモデルの計算に使われていたとすると、15万 / 8 * 32PFLOPS FP8で600 PFLOPSとなり、Meta, Microsoftでは5,816GPUの約30倍の生成AI計算規模を昨年調達したH100だけで既に実現しているという事になります。なんか往年のキン肉マンの超人パワー競争みたいな比較ですね。そうですか。最近キン肉マンリブートしてるんすか。

(第9回 半導体・デジタル産業戦略検討会議資料抜粋)

むすび

今回はかなり乱暴で現実的な諸々を全く含まない試算であり、実際のABCI増強計画では最大8.5EFLOPSの実現を計画しているようです。ただ、システム全体に必要な諸コストの割合はどこでも同様に掛かる事を考えると、通販DGX価格を掛けるだけという乱暴な試算でも相対的な投資規模を比較するにはある程度有効と思われます。

デジタル貿易赤字増加の危機をチャンスに変えるには、数兆円規模でドカーンと投資しないと一企業に負けそうな気もしなくもないですが、きっと見えない形でH100割り当てリストに日本企業がこっそり入っていると信じたい所です。知らんけど。

(ご参考)前回ご案内したリンク

経済産業省 - ものづくり/情報/流通 - 情報化・情報産業 - 半導体・デジタル産業戦略検討会議

JIPDECレポート - 令和6年度 経済産業省デジタル関連施策について

▼人材募集中

~モルゲンロットやGPU活用に興味のある方からのご応募待ってます~

▼Cloud Bouquet ~GPUを安価に使えます~