NotebookLM, Apple Intelligence, Claude 3.5 Sonnet - Generative AI 情報共有会 #18

今週、6月25日(火)にZENKIGEN社内で実施の「Generative AI最新情報共有会」でピックアップした生成AI関連の情報を共有します。

この連載の背景や方向性に関しては 第一回の記事 をご覧ください。

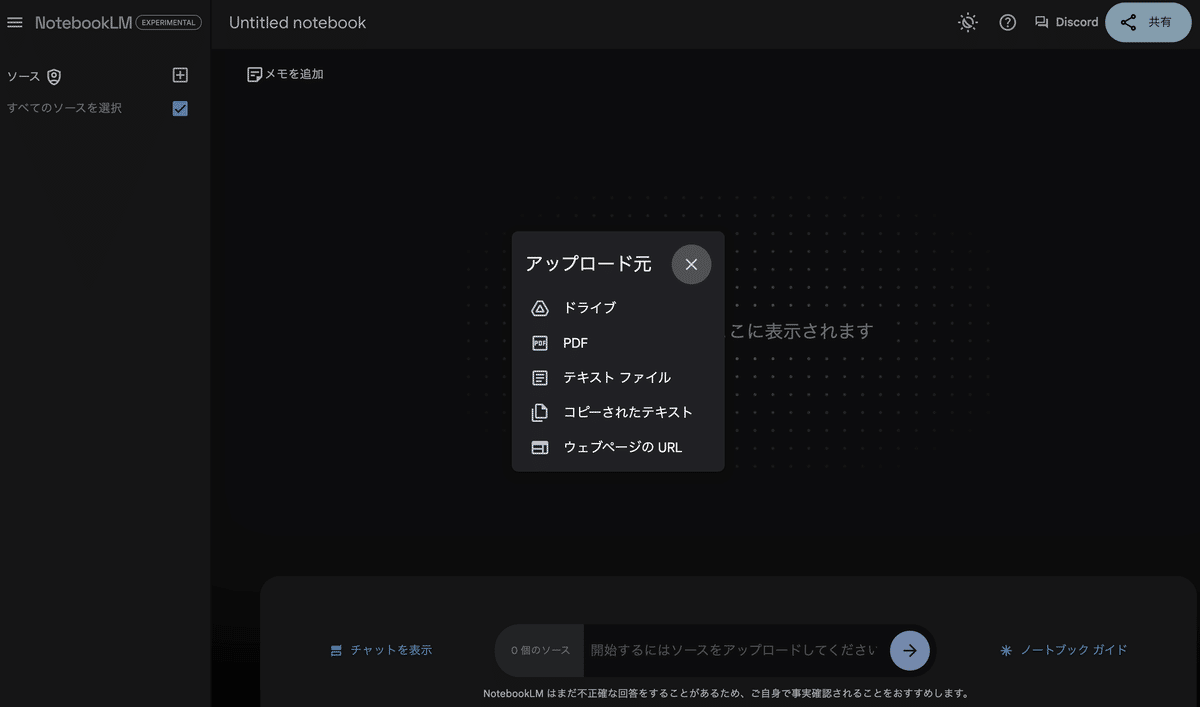

Google、NotebookLMを日本語で提供開始(2024/06/06)

Google DriveのファイルやPDF、テキストファイル、WebページのURLなどをアップするとその情報を元に要約やよくある質問、教材を作成したり、文書に対して質問し文書の内容をもとに回答させることができる。

【触ってみた】

5月29日に公開された、デジタル庁の「テキスト生成AI利活用におけるリスクへの対策ガイドブック(α版)」のPDFをアップロードして使ってみる。

まずPDFをアップロード

アップロードが完了すると、「概要」とともに「よくある質問」や「学習ガイド」などの生成や「質問の候補」を提案してくれる。

「よくある質問」の生成例

テキスト生成AI利活用ガイドブックからのFAQ

はじめに: 本FAQは、提供されたガイドブックに基づき、政府情報システムにおけるテキスト生成AIの利活用に関する主要なテーマとアイデアをまとめたものです。

FAQ:

1. テキスト生成AIはどのような行政サービスに向いていますか?

テキスト生成AIは、情報検索サービス、パブリックコメント分析、専門職の業務支援、信頼できるデータベースと連携したシステムなど、様々な行政サービスに活用できます。例えば、国民向けの情報検索サービスでは、従来のチャットボットよりも自然な文章で質問に応答したり、関連性の高い情報を提供したりすることが可能です。また、パブリックコメント分析では、大量の意見を内容ごとに分類・要約することで、職員の負担軽減と分析精度の向上が見込めます。

2. テキスト生成AIの導入は費用対効果に見合うのでしょうか?

…

「学習ガイド」の生成例

テキスト生成AI利活用リスク対策ガイドブック(詳細版)

目次

1. 学習内容確認テスト

2. 解答例

3. 論述問題例

4. 主要用語集

1. 学習内容確認テスト

以下の問題に対して、本文書の内容に基づき、各設問2~3文程度で解答せよ。

1. テキスト生成AIの利活用が不適切となるケースを3つ挙げ、それぞれ具体例を交えて説明せよ。

2. 情報検索サービスにおいて、旧来型のチャットボットと比較したテキスト生成AIの利点を3つ挙げよ。

(中略)

2. 解答例

1. 不適切なケース例

- 期待品質が高すぎる場合: 例えば、専門知識が必要な医療相談において、テキスト生成AIが医師の診断を代替することは現状では不可能であり、誤った情報提供に繋がるリスクがある。

- 人間が行うべき作業である場合: パブリックコメントへの返答をテキスト生成AIで完全に自動化してしまうと、国民の声を真摯に受け止めるという本来の目的を損なう可能性がある。

- 法令で資格が必要とされる作業である場合: 薬剤師の資格を持たずに、テキスト生成AIを用いて薬の処方箋を発行することは、薬事法に違反するため不適切である。

2.

- テキスト生成AIの利点多様な回答が可能: 従来のチャットボットのように限定的な回答ではなく、文脈に沿った柔軟で人間らしい自然な応答を生成できる。

- 文意を理解した検索: 単語の羅列ではなく、入力された文章全体の意図を理解し、より的確な検索結果を提供することが可能になる。

- 理解しやすい回答: 検索結果を要約したり、関連情報を分かりやすく整理して提示することで、ユーザーの負担を軽減できる。

(中略)

3. 論述問題例

以下の問題に対して、本文書の内容を踏まえ、論述せよ。

1. 行政機関におけるテキスト生成AIの活用は、期待と同時に様々なリスクも孕んでいる。テキスト生成AIの利活用におけるリスクを、具体的なユースケースを交えながら論じなさい。

2. テキスト生成AIの導入を検討する際に、適切な提供形態を選択する重要性を、具体的なメリット・デメリットを比較しながら論じなさい。

(中略)

4. 主要用語集

用語解説

- 生成AI : 文章、画像、音声、動画など、従来は人間が作成していたものを出力するAI。

- テキスト生成AI : 生成AIのうち、文章を生成することに特化したAI。

- 大規模言語モデル(LLM) : 膨大なテキストデータを用いて学習された、多数のパラメータを持つ言語モデル。

…

「ブリーフィング・ドキュメント」の生成例

テキスト生成AI利活用におけるリスク対策ガイドブック(α版)解説資料

本資料は、デジタル庁が2024年6月10日に公開した「テキスト生成AI利活用におけるリスクへの対策ガイドブック(α版)」(以下、ガイドブック) の主要テーマと重要事項をまとめたものです。

対象読者

本資料は、政府情報システムへのテキスト生成AI導入を検討する、サービス開発者およびサービス提供者を想定読者としています。

本資料の位置付け

本資料は、ガイドブックの内容を補足し、より深く理解することを目的としています。ガイドブックと併せて参照することを推奨します。

1. はじめに:テキスト生成AI利活用におけるリスクと課題

テキスト生成AIは大きな可能性を秘めている一方で、運用リスク、情報セキュリティ、プライバシー侵害、リーガルリスクなど、様々なリスクへの対応が必要となります。ガイドブックでは、これらのリスク、特にテキスト生成AI固有のリスクに焦点を当て、軽減策を提示しています。

…

「タイムライン」の生成例(今回アップロードしたPDFはタイムラインの生成に適していなかった)

残念ながら、提供された文書は、イベントのタイムラインや登場人物の伝記を作成するのに適した情報源ではありません。この文書は、日本のデジタル庁が発行した、テキスト生成AIの利活用に関するリスク対策ガイドブックです。

文書の内容を簡単にまとめると、以下のようになります。

- テキスト生成AIの利活用の増加に伴い、リスク対策の重要性が高まっている。

- 本ガイドブックでは、政府情報システムにおけるテキスト生成AI固有のリスクと軽減策を紹介する。

- 想定読者は、政府情報システムの開発や業務改善に従事する関係者。

- 想定されるユースケースとして、チャットインターフェース、バッチ処理、情報検索、自然言語からのプログラム作成の4つを想定。

- 新サービス企画時、予算要求前、調達実施前、設計・開発時、サービス実施時の各段階におけるリスクと軽減策を解説。

- 提供形態(サービス、Web API、機械学習モデル)ごとのリスクと軽減策についても解説。

- 生成AIの生成物の品質評価・品質保証に関するリスクと軽減策も解説。

この文書は、イベントや人物に関するものではなく、テキスト生成AIの利活用に関するガイドラインであるため、ご要望のタイムラインや人物一覧の作成はできません。

質問をすると、文書中の内容を元に、参照箇所を示しながら回答してくれる。

生成された文章中に①や②などの数字が付記されており、そこにカーソルを合わせると、アップロードされた文書中のどこに記載された内容をもとに回答をしているかが表示される。

生成AIを利用して要約や質問への回答を生成させる場合、記載されていないことを生成するなどのハルシネーションを起こすことに注意する必要があるが、このように回答を生成した根拠となる箇所を示してくれることは真偽確認をする上で非常にありがたい。

また、①や②をクリックすると、左側にPDF中の文書が表示され、回答の根拠とした文章がハイライトされる。

Apple、Apple Intelligenceの発表と内部で利用されているモデルの概要を公開(2024/06/10)

Apple、WWDC2024でiPhoneやMacに搭載予定の “パーソナルインテリジェンスシステム”、Apple Intelligenceを発表。また、内部で利用されているモデルの概要を公開。

Apple Intelligence

Apple製品上で、メール、メモ、Pages、他社製アプリなど、ほぼすべてのライティング場面で、文章の書き直し、校正、要約が可能に。

通知の内容を理解し、重要と思われる通知を優先的に表示。

メッセージで送る画像を生成して送信可能。会話内容から関連する画像のパーソナライズを受けることもできる。

(下画像例では画像内の人物もチャット相手のアイコン画像から生成されている)

メモでのラフなスケッチを綺麗な画像に変換する(動画)。

Siriは画面を認識し、アクションを実行(ex. メッセージ画面を表示した状態で「この住所を連絡先に登録して」というと登録してくれる。動画)

デバイス上の情報を元にアクションを実行(ex. メッセージとEメールどちらに書かれているかを指示しなくとも「フライトの到着時間はいつ?」と聞くと情報を探し出し回答)

Appleデバイス上でChatGPTも利用可能に。

Apple Intelligenceで利用されている生成モデル概要

モデルは以下の2種類

Apple On-Device

Appleデバイス上で動作することを目的とした3Bパラメータまでのモデル

Apple Server

Private Cloud Compute(Appleが開発した、送信されたユーザーの個人データにそのユーザー以外はアクセスできないように設計したクラウド環境)上で動作するApple On-Deviceより大規模なモデル

【性能】

要約における、人間の満足度による評価。同等サイズのモデルPhi-3と比較し、優れた要約生成を実現。

(Phi-3についてはこちらの記事でも紹介しています。)

様々なオープンソースモデルや商用モデルとの人間による出力比較。Apple On-Deviceはよりパラメータ数の大きいMistral-7BやGemma-7Bをも凌駕する性能。

出力の有害性評価(値が低いほど有害性が少なく良い)。Appleのモデルは有害な出力が少ないという評価。

要約や作文能力も高い。

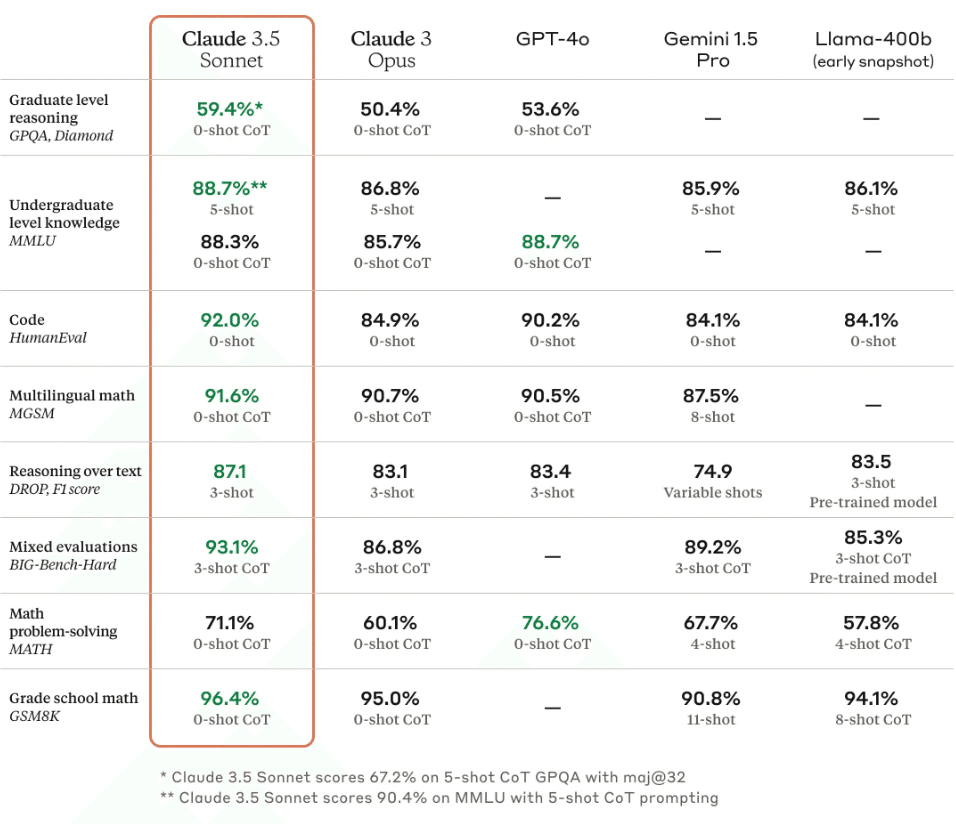

Anthropic、Claude 3.5 Sonnet発表(2024/06/21)

Claude 3.5モデルファミリーの最初のリリースとして、中位モデルClaude 3.5 Sonnetを発表。

Claude 3の中位モデルSonnetの性能を引き上げ、より大きなCluade 3 Opusを低コストで性能を上回るモデルとなる。

様々なベンチマークで、GPT-4oやGemini 1.5 Proを上回る

Claude 3.5 SonnetはClaude.aiとClaude iOSアプリで無料で利用可能。Anthropic API、Amazon Bedrock、Google CloudのVertex AIからも利用可能。

Claude 3.5 HaikuとClaude 3.5 Opusは今年後半にリリース予定。

お知らせ

少しでも弊社にご興味を持っていただけた方は、お気軽にご連絡頂けますと幸いです。まずはカジュアルにお話を、という形でも、副業を検討したいという形でも歓迎しています。(SpeakerDeck資料がアップデートされました。)

この記事が気に入ったらサポートをしてみませんか?