HCI×CALL (HCI分野におけるコンピュータ支援言語学習)

はじめに

本記事はHuman-Computer Interaction (HCI) Advent Calender 2022 19日目の記事です。今回の担当、東京大学博士課程の河村和紀と申します。普段は機械学習による技能判定/技能獲得支援「AI-Guided Learning」の研究をしています。今回の記事では、自身の研究に関わるトピックの一つでもある、コンピュータ支援言語学習について、HCI文脈でどのような研究がなされているのか簡単に記したいと思います。

CALLとは?

コンピュータ支援言語学習(computer-assisted language learning、略してCALL)とは、コンピュータを使用した言語学習のことを指します。CALLは、言語学習者が自分で学習するためのツールとして使用されることが多く、自己学習や自主学習を促進する効果が期待されています。オンラインの言語学習プログラムやアプリ、インタラクティブな言語学習ゲームなど様々な形態のものがあります。

CALLは、言語学、教育学、心理学、コンピュータサイエンスなどさまざまな研究領域で研究されています。

言語学では、CALLを用いて、言語学習者がどのように言語を学習するか、どのような要因が言語学習に影響を与えるか、どのような学習戦略が有効であるかなどを研究しています。

教育学では、CALLがどのように教育プロセスを改善するか、学習者のモチベーションや反応をどのように評価するか、教師がCALLをどのように活用することができるかなどを研究しています。

心理学では、CALLがどのように学習者の記憶や注意力、意志に影響するか、学習者がCALLを使用する際のストレスや自己効力感などの心理的要因を研究しています。

コンピュータサイエンスでは、CALLに使用されるコンピュータシステムやプログラム、データベース、機械学習技術などを研究しています。例えば、音声認識システムを使用したCALLでは、ユーザの発音を評価し、その発音を向上させるためのフィードバックが可能です。また、音声合成システムを使用したCALLでは、正しい発音を示す音声を生成することもできます。

HCI分野でのCALL

HCI (human-computer interaction) 分野での CALL 研究は、コンピュータを使った言語学習におけるユーザとコンピュータとのやり取りに焦点を当て、言語学習をより効果的かつユーザフレンドリーにするための研究が多いです。

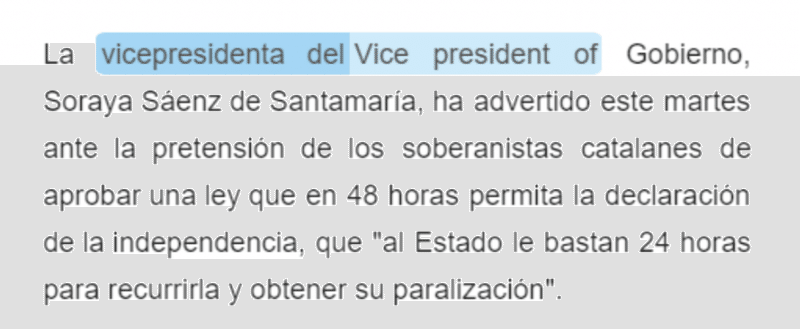

例えば、ユーザのモチベーションを保つために、ユーザが個人的に関心があるWebコンテンツや動画を用いて言語学習ができるようにする研究があります。一例を挙げると、As We May Study [Lungu+, CHI '18] は、外国語を学習している学習者が個人的に興味を持つ資料をインターネットで読み、過去の読書をもとにしたインタラクティブな学習を行うことで、単語を習得することを可能にするように設計されています。このシステムは、デスクトップやモバイルデバイスでの読解サポート、個人的に興味を持つ資料を探すための文書検索、個人的に興味を持つ資料を読んで得た単語を使ったインタラクティブでパーソナライズされた演習を統合しています。著者らは、学習者が個人的に興味を持つ資料を読むことで学習効率が向上し、モチベーションも向上することを示す実験結果を示しています。

その単語やフレーズを選択して、その意味を確認できます。

このような研究の他の例としては、 ALOE [Trusty+, CHI '11]、Foreign manga reader [Kovacs+, UIST '13 Demo]、ViVo [Zhu+, CHI '17] などがあります。

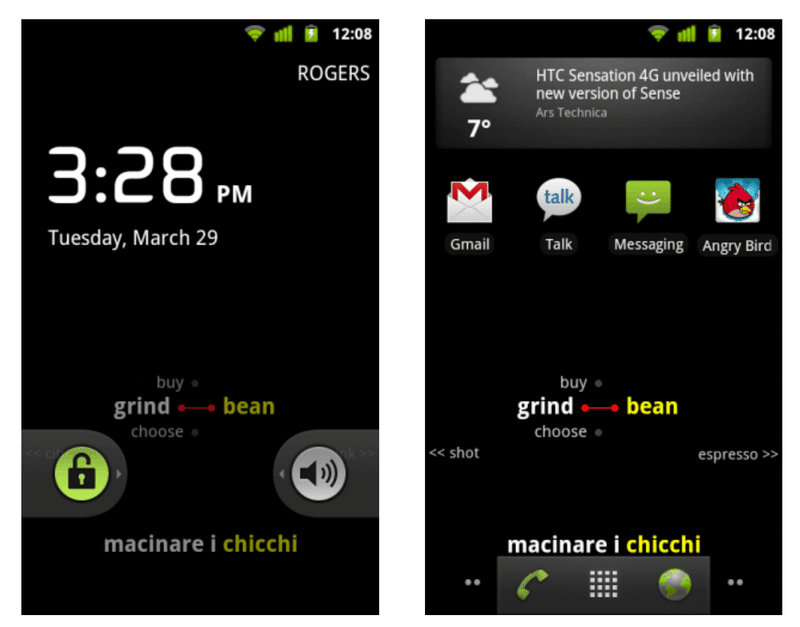

他にも、第二言語を日常生活の中で自然に取得することを可能にする研究があります。例えば、Vocabulary Wallpaper [Dearman+, CHI '12] は、モバイルデバイスを使って、第二言語を自然に取得する手法について研究している論文です。この論文では、スマートフォンの画面の背景に壁紙のように常に単語を表示するアプリケーションを提案しています。また、学習者に与える単語の種類が文脈に関係するか否か(ユーザの居場所に即したものかそうでないか)が、学習者の単語取得率にどのように影響するかも調べ、文脈に関係する単語を与えられた場合に、そうでない場合と比べて、学習者の単語取得率がより高くなることが分かっています。

単語は動的に変わり、実行中のアプリケーションに遮られない限り常に表示されます。

このような研究は、他にも MicroMandarin [Edge+, CHI '11]、WordSense [Vazquez+, CHI EA '17]、 Wait-Learning [Cai+, CHI '20]、VocabEncounter [Arakawa+, CHI '22] などがあります。

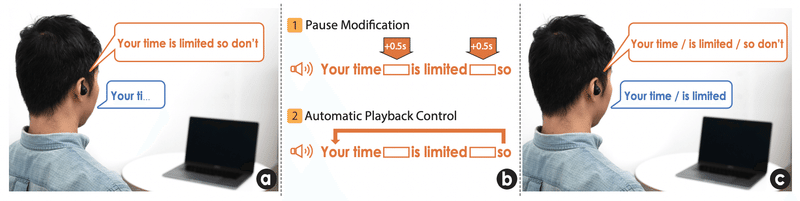

さらに、既存の言語学習手法をより効果的に学習できるように支援する研究もあります。WithYou [Zhang+, CHI '20] は、言語学習者が外国語のテンプレートスピーチを聞いてそれに同期しようとするシャドーイングのトレーニング方法を改善するための音声認識システムです。WithYouは、言語学習者がシャドーイングに失敗すると、自動的にテンプレートスピーチの再生や難易度を調整することで、シャドーイングをスムーズにすることができます。

シャドーイング中に学習者がより正確に同期できるようにします。

このような研究の他の例としては、Cyrafour [Encinas+, CHI EA '15]、CAST [Reza+, CHI '21] などがあります。

これまでに説明してきた3タイプの研究以外にも、Apraxia World [Hair+, CHI EA '20]、Delivery Ghost [Cho+, CHI EA '21] のように言語学習ゲームが言語学習に与える影響を調査するものから、TransPhoner [Savva+, CHI '14]、Sketchforme [Huang+, UIST '19] のように新たな言語学習を生み出すツールや、AwkChecker [Park+, UIST '08] や PTeacher [Bu+, CHI '21] のように学習効果の高い学習者の間違いをフィードバックする方法を提案するものまで様々な研究があります。

DDSupport

最後に宣伝ですが、つい先日ICMLA2022にて、DDSupportという言語学習支援システムを提案したので、簡単に紹介させてください。

CALLの中でも、発音の学習を支援するシステムは 、CAPT (computer-aided pronunciation training) と呼ばれ、広く研究がおこなわれています。機械学習技術を応用したCAPTの代表的な手法は、対象の言語のネイティブスピーカーなどのお手本となる発話者と学習者の発話を比較し差異を計算し、ユーザにフィードバックするというものです。

ここで、このようなシステムの課題として、比較対象のお手本となる発話者/発話を学習できるセンテンスが限られるというものが挙げられます。要は、お手本と学習者の発話を比較する必要があるので、比較対象がそのお手本1人に限られるということと、お手本と比較するために予めこれから学習するセンテンスをお手本が発話しているデータを集めておく必要があるということです。

そこで、学習者が自由なセンテンスを発話学習可能にしたのがDDSupportです。また、特定の1人の発話者と比較することなく、ユーザの発話が対象言語をどの程度うまく話せているのかということや発話がうまくいっていない場所を可視化します。

もしより詳しく知りたい場合は、論文や関連記事を参考にしてください。また、コメントや感想もお待ちしています。論文では、感覚的に発話を修正できる機能についても紹介しています。

Kazuki Kawamura, Jun Rekimoto. "DDSupport: Language Learning Support System that Displays Differences and Distances from Model Speech." ICMLA. 2022.

英語ネイティブとの発音の違いを深層学習で可視化 ソニーCSLが開発(ITmedia NEWS)

この記事が気に入ったらサポートをしてみませんか?