NeurIPS2020発表参加報告

こんにちは、Japan Digital Designのデータサイエンティスト田代です。

私は、資産運用やリスク管理をはじめとする金融実務における課題をファイナンス理論やデータ分析などの技術を駆使して解決する三菱UFJトラスト投資工学研究所(MTEC)の研究員でもあり、機械学習の研究のためにJDDへ出向しています。

2020年12月に開催されたNeurIPSで発表してきましたので、その様子をレポートします。

NeurIPS 2020

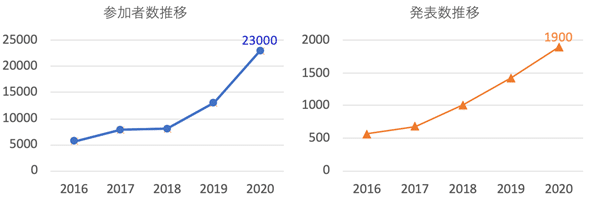

NeurIPS (Neural Information Processing Systems) は機械学習分野のトップカンファレンスの1つで、昨今の機械学習・AIブームに伴い、年々注目度・人気が高まっています。特に今回はオンライン開催となったことも相まって、参加者数は約23,000人、発表数は約1,900件と共に過去最高を記録しました。

機械学習の理論的な研究を中心とした学会ですが、近年は機械学習を社会で活用する際の様々な課題を解決するための研究にも焦点が当たっています。例えば、データを扱う際のプライバシー、意図しない誤作動などを起こさない安全性、機械学習モデルを意思決定に用いる際の公平性、などが上記の課題に該当します。今回は、研究が社会に与える影響を記述する「Broader Impact Statement」を書くことが全ての論文に義務づけられるなど、実社会との関係を意識した変化が見て取れました。

参加形式

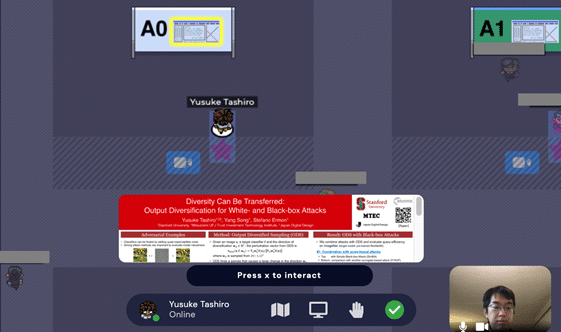

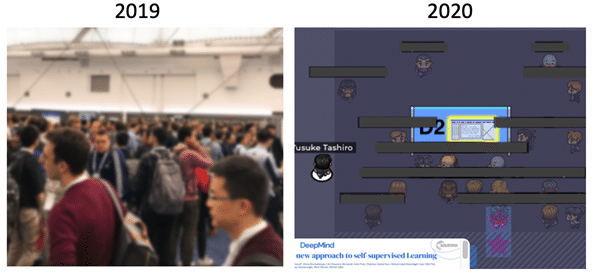

コロナウイルスの影響で様々な学会がオンライン開催となり、研究発表は主に事前録画されたビデオで行われるようになりましたが、いつでも何処からでも発表を聞くことができるというのは非常に便利な一方、リアルに比べると人との交流やディスカッションの機会は大きく減ってしまいました。そこで今回のNeurIPSでは、なるべくインタラクティブな議論ができるように、「gather.town」というアバターシステムを用いたポスター発表の場が用意されていました。

上の写真のように、ポスター会場がバーチャル化されており、参加者はアバターを通して会場を見て回ることができます。カメラを使って対面でディスカッションができるだけでなく、知り合いと会場で偶然遭遇するなど、なかなかリアルに近い体験もありました。リアルでの非常に混雑したポスター会場(下図参照)に比べると、オンラインでの参加はかなり快適です。学会の全体感を捉えづらいといった欠点もありますが、コロナウイルスの影響が緩和されてからも、こうしたオンラインでの発表形態は何らかの形で残るかもしれません。

発表内容

ポスター発表したのは、客員研究員として訪問しているスタンフォード大学Computer Science DepartmentのStefano Ermon先生ならびに学生のYang Songさんとの共同研究で得られた「機械学習の安全性分野」における成果です。

論文はこちら↓

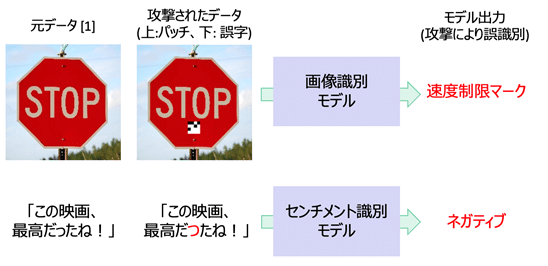

機械学習、特に深層学習を用いたモデルは、入力データの微小な変化により出力を大きく変化させる「敵対的攻撃」に晒されるリスクがあることが様々な研究により明らかになってきており、機械学習モデルをオープンなシステムで用いる際には大きな脅威となります。下の画像は、敵対的攻撃の一例です。

このような敵対的攻撃に関する研究は機械学習分野のホットな領域の1つで、攻撃に対して頑健なモデルを構築するための「防御」だけでなく、モデルに対する「攻撃」の研究も重要です。というのも、防御だけを研究していると、ある攻撃に対して頑健な防御が別の攻撃に対しては脆弱になってしまうこともあるので、防御の頑健さや弱点の適切な評価には、様々な視点からの強力な攻撃の研究も不可欠なのです。

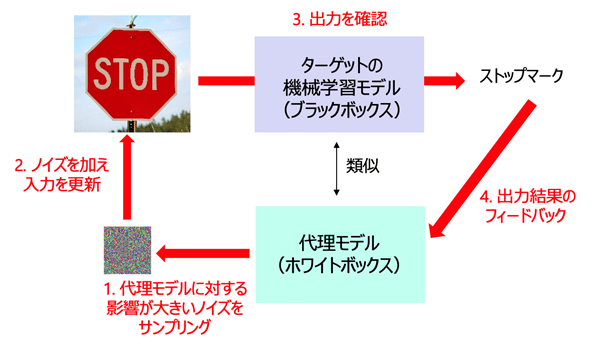

今回の発表では、攻撃側はターゲットとする機械学習モデルの内部情報を持たず、入出力のみにアクセスできる「ブラックボックス」な設定に焦点を当てています。ブラックボックスなモデル(例えば、画像識別を行う機械学習APIなど)に対する攻撃はサンプリング等を用いて逐次的に入力を更新していくのが典型的ですが、何回も攻撃を繰り返す必要があり、現実的には難しいです。そこで我々は、ターゲットのモデルと類似した代理モデルを用いた新たなサンプリング手法を提案し、既存手法に比べて効率的かつ強力な攻撃を導くことを示しました。

今回の研究は基礎的なものであり、金融ビジネスにダイレクトに応用できるものではありませんが、金融における機械学習活用の場面でも、安全性は非常に重要かつ現実的な問題となっています。実際、融資審査、不正取引検知、トレーディングといった金融領域の機械学習アプリケーションに対して、敵対的攻撃の研究が登場しています。我々は、研究を通して安全性に関する知見を深めることで、頑健な機械学習モデルを構築していきたいと考えています。

気になった研究領域

参加者目線で気になったトピックや研究もいくつか紹介します。

ドメイン知識の活用、反映

今回のNeurIPSでは、人が持つドメイン知識を活用する研究が従来よりも多かったように感じます。機械学習モデルを実務に用いる際、人間の前提知識に反するような挙動をするとモデルの出力を信頼することが難しくなるため、機械学習モデルと人による判断の乖離を縮めることが重要になります。モデル作成者の主観が入る余地はありますが、人の持つドメイン知識をモデルに反映させる研究は実務面からも非常に意味のある事といえます。聴講した中では、「この入力に対する出力はこの範囲に収まる」といったモデル出力に関する制約を人が与え、その制約を満たすような深層学習モデルを学習するためのテクニックの研究[2,3] などが目に留まりました。

機械学習モデルの説明性

1つ上のトピックとも関連しますが、実務においては機械学習モデルが行った予測だけでなく、それに対する説明・解釈も重要です。特に金融ビジネスでは解釈が求められるケースも多いため、説明性に関する研究手法の発展はキャッチアップするようにしています。今回は、チュートリアルの1つが説明性の研究(特に与えられたモデルに対する事後的な説明を行うpost-hocな手法の研究)を取り上げていたことからも、このトピックの広がりを感じました。また、解釈性手法の1つであるSHAPを発展させ、「季節は気温や湿度に影響する」といった所与の因果関係に則した形で機械学習モデルの解釈を行う研究が複数発表される[4,5]など、これまでより踏み込んだ説明を試みているところが非常に興味深かったです。

グラフデータに対する機械学習

最近の機械学習学会で最も目立つトピックの1つであるグラフデータについては、今回も多数の発表がありました。金融ビジネスで取り扱うデータの中にはグラフ構造を持つものも多いため、グラフに対する機械学習には注目しています。理論や実証面での進展があったのはもちろんのこと、粒子の関係性をグラフとして表現し学習することで粒子の間に成り立つ物理法則の式を導出するといった知的好奇心を刺激する研究[6]もあり、この手法のポテンシャルを改めて感じました。

終わりに

Japan Digital Designでは、機械学習の知見を駆使して、金融ビジネスにおける課題を解決していくデータサイエンティストを募集しています。

[1], “Tang et al., An Embarrassingly Simple Approach for Trojan Attack in Deep Neural Networks, KDD2020.” より引用

[2] Yang et al., Incorporating Interpretable Output Constraints in Bayesian Neural Networks, NeurIPS2020.

[3] Ma et al., STLnet: Signal Temporal Logic Enforced Multivariate Recurrent Neural Networks, NeurIPS2020.

[4] Heskes et al., Causal Shapley Values: Exploiting Causal Knowledge to Explain Individual Predictions of Complex Models, NeurIPS2020.

[5] Frye et al., Asymmetric Shapley values: incorporating causal knowledge into model-agnostic explainability, NeurIPS2020.

[6] Cranmer et al., Discovering Symbolic Models from Deep Learning with Inductive Biases, NeurIPS2020.