ついに3Dも!3Dシーンを生成するNeRFに関して

こんにちは!Hi君です。

今回は3Dに関してです。少し長くなりますがお付き合いください。

3Dシーンを生成するLumaAIやNeRFStudioでは、画像セットから再構築された3次元シーン情報について、カメラワークを指定して画像や動画を生成することが出来ます。

こちらのTwitterにもあるように、スムーズな3D映像が簡単に生成できるので、もしかしたらアニメの背景作成補助等にも使えるかもしれません。

縦構図レンダリングのテスト(その2)

— 大西さん (@2012apocalypsis) January 30, 2023

いや、どう見てもドローンの実写映像じゃん(汗)#軍艦島#地獄段#NeRF#LumaAI#LumaLabsAI pic.twitter.com/OKPuo1QXmo

では一つ一つのツールについて、調べてみましたのでご紹介します。

NeRFStudio

こちらの動画でもわかりやすく説明しています。

NeRFStudioではNeRFactor、Instant-ngp、D-NeRF等をサポートしています。TSDF(kinectfusionの生成物みたいなデータ)、mesh exportもサポート。レンダリングは比較的速そうです。

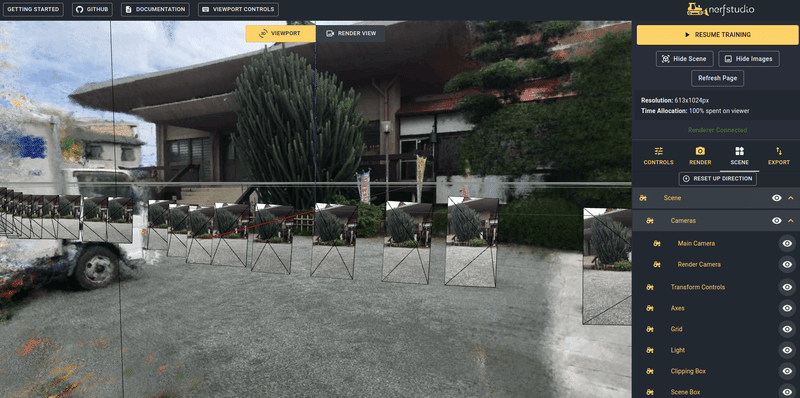

手元の環境でも動作してみました!ただし下の題材はnerf用に撮影したモノではないのと、gtx1070だと多少パワーが弱いので、画像を縮小させています(576 x 1024)。

画像上の"Resolution: 613x1024 px"がブラウザ上レンダリング内でのビュー解像度となります。

関連ページ:

https://cobanov.dev/nerf/:一番ワークフロー上のコマンドがまとまっていますが、メモ書きのようなものでかなり簡潔です 。

Nerfstudio-Playground:実際に試した例が5件載っています。

nerfacto with depth and semantic supervision #1475

How To Create 3D Scenes with NeRF Neural Networks Yourself](https://www.ni-sp.com/nerf-how-to-create-3d-scenes-with-neural-networks-yourself/)

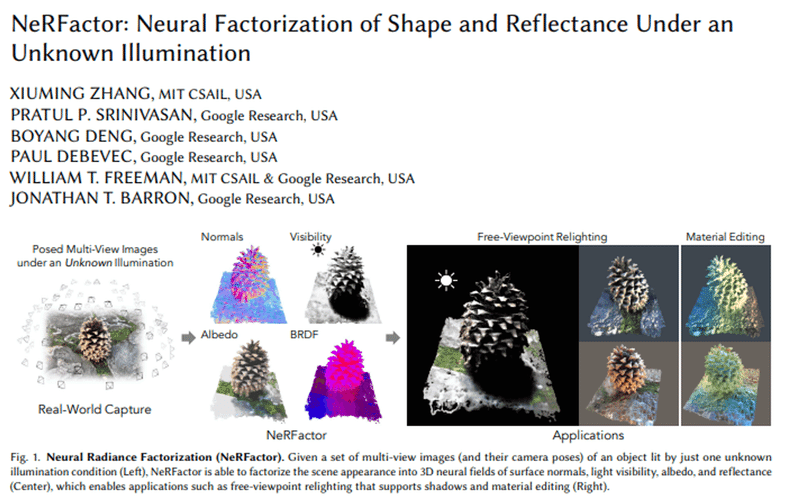

NeRFactor

NeRFactor: Neural Factorization of Shape and Reflectance Under an Unknown Illumination

Nerfstudioの標準的手法です。inverse rendering的な事ができます。例えばrelighting等も後段の処理でできることがわかりました。

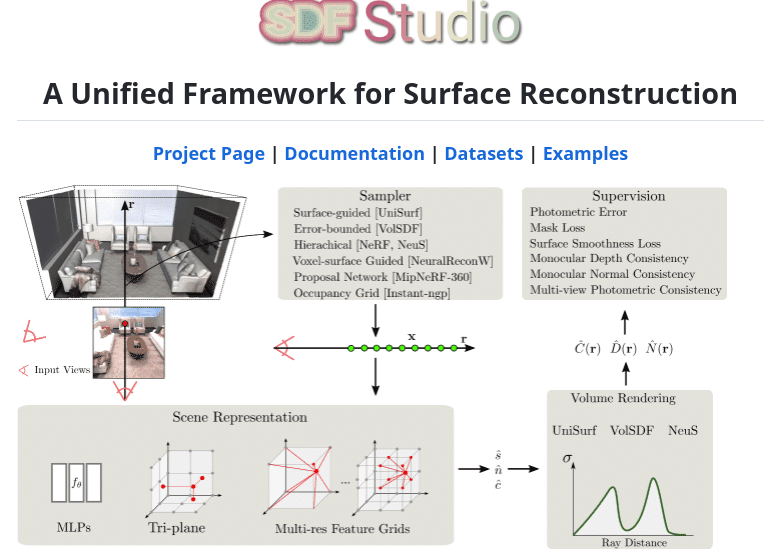

SDFStudio

最近ジワジワ流行っているので触ってみました。メッシュも吐き出せます。

autonomousvision/sdfstudio

Providing your own data. #2**

Mega-NeRF

比較的大きな画像に関しても分散的にいい感じにやってくれます。Block-NeRFに近いものをイメージするとわかりやすいかもしれません。

Dynamic View Synthesis from Dynamic Monocular Video

動的なシーンに対応したNeRF的なモノです。

デモ動画

K-Planes: Explicit Radiance Fields in Space, Time, and Appearance等、動的なシーンについてのNeRFもそれなりに出始めています。

PFNの3D & 4Dスキャナー

こちらは恐らくNeRF系の技術を使っていると思います。

【動画】PFN 4D Scan「しながわ水族館 海の宝石箱編」を公開しました。

— Preferred Networks (@PreferredNetJP) February 14, 2023

動きのある空間を撮影して空間丸ごとフルCGで再構成。揺らめく水の表現や、魚や珊瑚を好きな角度から自由に眺める映像も制作できます。https://t.co/YDZPV3ZfCk pic.twitter.com/AnFvpAgr6M

NeRFshop: Interactive Editing of Neural Radiance Fields

NeRFshopは生成物の一部をを歪ませたり移動させたりできるものです。

作業上のメモ

FFMpeg

ffmpeg でメタデータを加える | ニコラボ

Linux で 写真のExif タグを一気に編集する - Qiita

動画下準備

ffmpeg -i salad.MOV -an salad.mp4

動画から画像

ffmpeg -i salad.mp4 -q:v 2 -vcodec mjpeg image/image_%03d.jpg

https://qiita.com/livlea/items/a94df4667c0eb37d859f

都会の車窓からフォトグラメトリ 〜LiDAR無しスマホでもできる!3Dスキャン〜 - Qiita

GTSFM

https://github.com/borglab/gtsfm

FAST-LIO, Then Bayesian ICP, Then GTSFM

https://arxiv.org/abs/2210.00146

それでは次回もお楽しみに!

文:Hi君

協力:inaho株式会社

この記事が気に入ったらサポートをしてみませんか?