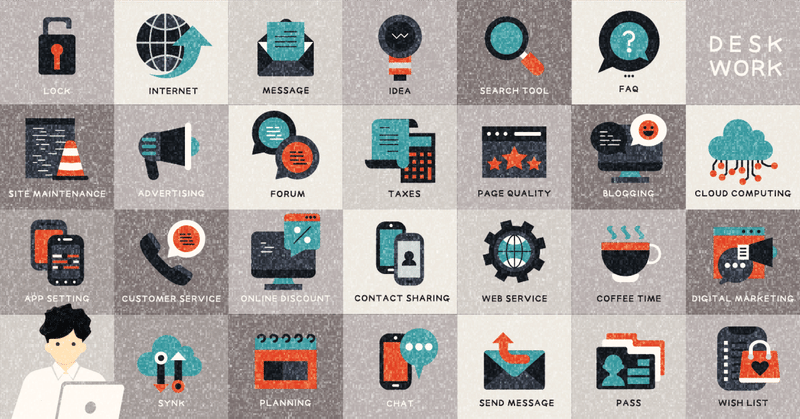

記事一覧

Langchain新機能: エビデンスの引用付きの解答が得られるQA機能(citation_fuzzy_match_chain)

またまた、Langchainの新機能「citation_fuzzy_match_chain」 が公開されていました。OpenAI APIの 「Function Calling機能」を利用して、回答に加えて裏付けとなるエビデンスを引用で示すことが出来るもののようです。 何はともあれ試食します😊ライブラリなどの準備 !pip install langchain >/dev/null!pip install openai >/dev/null# 環境変数の準備import os