AI特異点(シンギュラリティ)は来るのか?

AIシンギュラリティとは、人工知能(AI)が自己改善を繰り返し、人間の知能を超えて急速に進化する点を指します。この概念は、AIが自律的に新しい技術や知識を開発し続けることで、予測不可能なほどの知的成長を遂げるとされる状態です。

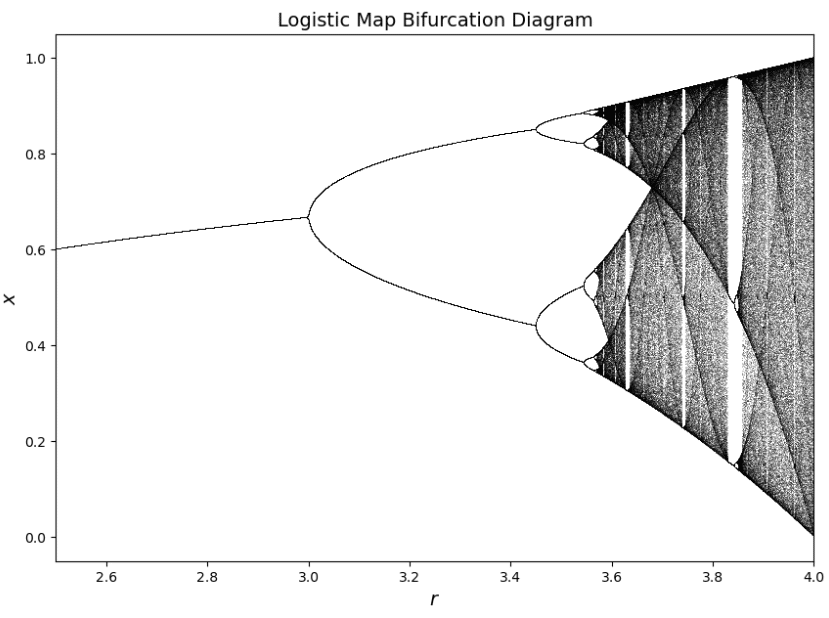

上記の定義とはちょっと異なりますが、物理数学では、簡単な組み合わせによる(簡単に)予測できるものが、あるポイントから突然複雑で予測不可能な振る舞いになる現象がよくあります。

たとえば、三体重力や、有名なロジスティック写像です。※ AIにお願いするとささっとコードを書いてくれます。

import numpy as np

import matplotlib.pyplot as plt

# ロジスティック写像のパラメータ

r_values = np.linspace(2.5, 4.0, 10000)

n_iterations = 1000

last_n = 100

# 結果を保存するリスト

x = 1e-5 * np.ones(len(r_values))

fig, ax = plt.subplots(figsize=(10, 7))

for i in range(n_iterations):

x = r_values * x * (1 - x)

if i >= (n_iterations - last_n):

ax.plot(r_values, x, ',k', alpha=0.25)

ax.set_xlim(2.5, 4)

ax.set_xlabel('$r$', fontsize=14)

ax.set_ylabel('$x$', fontsize=14)

ax.set_title('Logistic Map Bifurcation Diagram', fontsize=14)

plt.show()

x = r_values * x * (1 - x) という非常に簡単なロジックが、突然予測不可能(カオス的)な振る舞いになります。

※ 哲学的な言い方をすると、a_{n} から a_{n+1} を予測できなくなるので、因果の糸が切れている状態と言えます。重力の3体問題でいえば、その深刻さが理解できると思います。重力の法則は誤差なく100%決定論として存在するにも関わらず、ある状態{n}が完全にわかっているのに次の状態{n+1}を(コンピュータや人が)決定できないわけですから。

ちまたでは、ChatGPTなどのLLMは、ただの確率単語予測器だという理由から、今の単純なフレームワークでは、人間の知能に並んだり超えないだろうと言われることがあります。

しかし、どんなに単純なルールが元になっていても、カオス現象のように、突然予測不可能な振る舞いに発展する事はあります。しかも連続的に徐々にではなく、ロジスティック写像のように「突然」来るわけです。

単純化かつ極論で言うと、たとえば405Bのモデルだと変化がないのに、406Bにすると突然人間と同様に賢くなったが、407Bではただのノイズに成り下がりおバカさんになってしまった、というものです。上記のグラフでも、r=3.6や3.8の領域で秩序を取り戻しています。

サルと人間の脳も、遺伝的・物理化学的にはほとんど差がありません。おそらく、進化の過程で連続的にゆっくりと変化したのではなく「特異点」があったのでしょう。

AIも突然、どこかの小さなベンチャーや研究所が、AGI(Artificial General Intelligence・汎用人工知能)を、理由はわからないができてしまった、とニュース報道される日が来るかもしれません。

まあ、現実にできたとしても理由はわからないのでしょうね。理由がわかれば、人間意識の永遠の哲学的問題も解決されるでしょうから。

この記事が気に入ったらサポートをしてみませんか?