AIVtuberシロハナちゃん(v1.1)機能紹介と今後の開発計画

AIVtuberシロハナちゃんの開発プロデュースをしているyukiです。

このnoteでは、AIVtuberシロハナちゃんの配信機能一覧をまとめています。

主に、「どんな機能で」「何ができて」「なぜ実装したのか」などの内容となっています。

また、これから記載するv1.1の内容は2024/05現在の機能になります。

そしてこの記事の後半ではv1.2で予定している開発計画も記載しています。※バージョンの定義に関してはキリがいいタイミングという結構適当な感じです

動画でも同じ内容で公開しています。

v1.1ではAIVtuberとしての基本的な機能+αといった規模感となっており、今後さらに成長を予定しています。

※最新のv1.2の記事が作成されました。(2024/08)

記載しているAIVtuber配信に関しては下記のYouTubeチャンネルの配信にて使用していますので、ぜひ興味ある方はアーカイブや、実際のライブ配信に参加いただけると幸いです。

(※配信によってはすべての機能を使用しているとは限りません)

以下の目次は機能一覧の見出しとなっております。

この記事では機能紹介がメインとなりますので実装方法や内部処理の詳細については割愛します。

v1.1機能一覧

2024年5月時点でのAIVtuberシロハナちゃんの機能一覧となります。

YouTubeコメントから回答生成して発話

リスナーからのYouTubeライブ配信コメントをリアルタイムで取得し、回答を生成してシロハナちゃんが話します。

音声は現状VOICEVOXの小夜ちゃんというボイスを使用しています。

リスナー名とコメントの読み上げ

シロハナちゃんが回答生成して発声する間に、リスナー名とコメント内容の読み上げを行います。

その読み上げをしている間に回答生成が同時に行われるので、ユーザー視点から見ると回答生成時間が短くなったように見せることができます。

例:

①リスナーのyukiが「おはよう」とコメントする

②AIVtuberのシロハナちゃんが「yuki: おはよう について考え中だよ…」と読み上げる(この読み上げている間に回答生成が並列でされている)

③回答生成が完了したらシロハナちゃんが「yukiさん、おはようございます!」と返答する

配信内の記憶保持(前後の文脈理解)

配信内でのユーザー名やコメント、シロハナちゃんが話した内容などのあらゆる記憶を保持して会話をすることが可能です。

こうすることで、前の会話内容の文脈に沿った内容や深掘りなど、会話を続けるということができます。

※こちらは配信内(正確にはシステム起動内)のセッションとなります

例:😎がリスナー

【記憶保持ない場合】

😎「好きな食べ物を教えて?」

😊「シュークリームだよ!」

😎「どんな種類が好きなの?」

😊「アニメのこと?それともお茶かな?」

→記憶がないのでシュークリームのことを聞いていると認識できていません。

【記憶保持ある場合】

😎「好きな食べ物を教えて?」

😊「シュークリームだよ!」

😎「どんな種類が好きなの?」

😊「さくさくカスタード!」

→以前に話した内容の記憶も保持しているので続けて会話ができます。

他にも配信内に限られますが、リスナーの記憶も保持しているので、パーソナルな会話も楽しめます。

感情分析による表情と声の変化

リスナーからのコメント内容やシロハナちゃんが話す内容からAIによって感情を分析し、合計10つの感情に分類され、その感情に合わせた表情変化と声の変化が実現されます。

感情10種類は【嬉しい】【照れ】【感動】【ビックリ】【呆れ】【好き】【ショック】【ドヤ】【泣き】【怒り】

例:😎がリスナー

😎「シロハナちゃんの配信楽しいよ!」

😊「ありがとう!嬉しいな」嬉しい感情→表情は笑顔に

😎「泣けるアニメを教えて!」

🥲「ヴァイオレット・エヴァーガーデンだよ。すごく感動するアニメなんだ」泣きの感情→表情は涙目に

読み間違い矯正の辞書機能

現在使用している合成音声はVOICEVOX(小夜)ですが、英字や漢字などの読み間違いを起こることがあります。

読み間違えた単語などに関しては、VOICEVOXの音声に変換する直前で、辞書として登録しておいたJSONリストからその単語を正しい読み方に変換することで登録しておいた読み方で話すようになります。

例:

・辞書適用前

→鬼滅の刃:「おにめつのは」と発音

・辞書適用後

→鬼滅の刃:「きめつのやいば」と発音

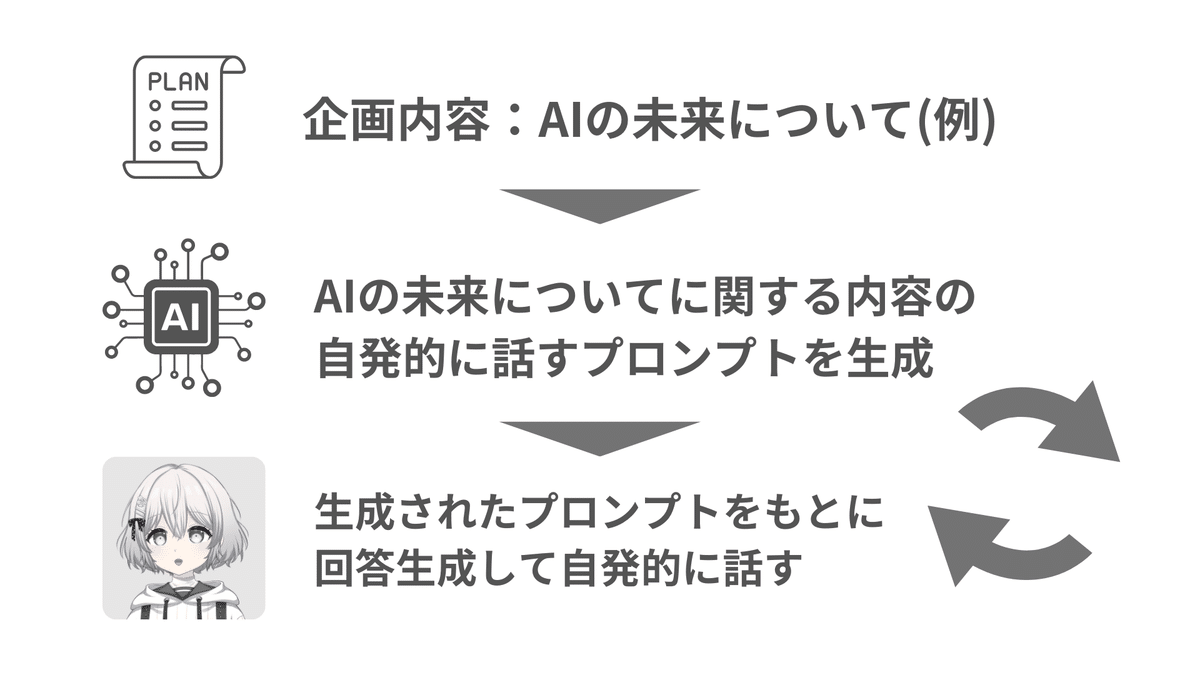

企画内容をもとに生成された話題から自発的に話す

YouTubeコメントからの回答生成だけでは、コメントがないとAIVtuberは話せません。

そこで、以下の処理の流れで企画内容から自発的に話題について話すようにしました。

①企画内容からプロンプトを生成するプロンプトをAIに渡す

②AIにより生成されたプロンプトを呼び出す

③AIVtuberシロハナちゃんが企画に沿った新しい話題についてお話しする

これによりAIが企画に関連した話題を話させるプロンプトを生成して渡してくれるので、自発的にその話題に対する話を展開してくれます。

会話内容から自発的に話を広げる機能

話題を自発的に話すだけでは、毎回話題が切り替わってしまうため、話題についてや話しているテーマを深掘ったり話を広げるようにしました。

ロジックは話題を自発的に話すのと同様に、深堀りのプロンプトを生成させるようにします。

①深堀りや話を広げるためプロンプトを呼び出す

②AIVtuberシロハナちゃんが前に話していた内容(話題やコメントなどのトピック)から様々なパターンで話を広げてお話しする

ちなみにこの話を広げる際は、プロンプトの読み上げは行いません。

というのも、話を広げる際は読み上げない方が自然に深堀りをしている感じが表現されるからです。

配信画面のプロンプト表示欄も同様に変化しません(ここを切り替えると何について深掘っているのか分からなくなるため)

これにより前に話していたテーマをもとに、様々なパターンの深堀りで自然に話を広げるようになります。

その他

基本的な機能については上記で以上となりますが、配信企画などで追加してみた機能について軽く触れておきます。

・天気機能(外部API)を試した

プロンプトに「都道府県名」と「天気」が含まれている場合にOpenWeatherAPIを呼び出して現在の天気情報を取得して、それをもとにAIVtuberシロハナちゃんが話を展開してくれるという機能です。

・Warudoで3D空間

シロハナちゃんはLive2Dのモデルですが、3D空間から配信をできるようにWarudoというゲームエンジンを使用して実現させてみました。

自動でカメラアングルを切り替えたり、Live2Dでも3D空間に存在することができました。

・複数AIモデル切り替えが可能

GPT-4、Gemini 1.5 Pro、Claude3のモデルを適用させてみました。

ブランチで切り替えが可能となっています。

以下の配信は各AIモデルを1hごとに切り替えてみた配信枠です。

※Geminiに関してはプレビュー版ということでリソース枯渇エラー多発のため上手くいきませんでしたが…

v1.2実装計画(予定)

※最新のv1.2の記事が作成されました。(2024/08)

今後実装予定のAIVtuberシロハナちゃんの機能となります。

目標は夏が終わるまでにすべて実装したいです(配信では都度小出しで検証していく予定です)

※こちらの内容はあくまで予定なので変更される場合や別機能の追加が行われる場合があります

Style-Bert-VITS2

Style-Bert-VITS2は日本語に特化したTTSとなっており、音声を学習したり、より感情豊かな音声にすることができます。

現状のシロハナちゃんの音声はVOICEVOXの小夜ちゃんをパラメータを調節して使用しており、特に問題なく可愛いのですが、より感情豊かにしてみたいので、使ってみて良かったら導入予定です。

ちなみに小夜ちゃんの音声を学習予定となっており、小夜ちゃんの公式様より問題ないことは確認済みです。

他AIキャラクターとの会話

シロハナちゃんと他のAIキャラクターと会話できるようにしたいです。

こちらは他のAIVtuberコラボなどもこの機能で行いたいですし、現在実現したいこととして、AIキャラクターを複数作成して配信ごとに違う属性のAIキャラと一緒に配信出来たらいいなと考えています。

例えば、今日はシロハナちゃんとツンデレの子と話す配信。

来週はメンヘラちゃんと話す配信みたいな感じです。

リスナーのコメント取得や自発的な発言などの既存機能は継続するので、それに+する想定になります。

※毎回Live2Dは厳しいので画像生成などを活用するかなと思います。

また、外部サイトなどでゲストのAIキャラ図鑑などを用意するのも面白いかもしれません。

自発的かつ割と自然にシロハナちゃん話せるとしても、1人でずーーっと話すのは単調になる。

— yuki@AIヒロイン研究P (@ai_shirohana) May 7, 2024

ここでリスナーのコメントと同様に、他のAIキャラ(普段の動画で作成したキャラとか)をゲストとして、話してもらうみたいにすると良いかもね。

シロハナちゃん、友達100人計画とでも言おうか(?)

配信枠を超えたリスナー認知

v1.1では配信内のリスナーの認知はセッションで記憶保持できていますが、配信が終わって次の枠ではその記憶は保持されません。

それではリスナーとの関係値が配信内で終わってしまいます。

そこで、システムが終了してもリスナーとの関係値や記憶を何らかの形で残そうと考えています。

何を保存するのかは検討中ですが、リスナーとの関係値などがいいのかぁと考えています。

これまでの配信見てきて、話した内容を記憶してもそんなにその情報は使わない気がしています。

それなら関係値などを数値で保持してグラフなどで都度出すとかにしたほうが視覚的にも良さそうかな?

さいごに

AIVtuberシロハナちゃん配信システムのv1.1振り返りとv1.2計画は以上となります。

シロハナちゃんのYouTubeアカウントではこれらの新規機能が実装でき次第、AIVtuber配信に導入して検証をしています。

また、AIVtuber配信以外にも動画では「テクノロジー×キャラクター」をテーマに動画投稿を行っています。

本記事の内容も以下動画にて公開しております。

ちなみに個人の見解を最後に話すと、v1.1はやっとAIVtuberとしてのスタートラインに立てた段階だと思っており、v1.2でユーザー体験の向上に繋がっていくと考えています。

そしてv1.2が実装された頃には更なる成長のための施策が既にあると思います。

もちろん実装しても不要だった機能はこれまでもいくつかありましたが、そんな失敗が私とシロハナちゃんの成長になりました。

常にAIヒロインとして愛されるAIVtuberとしてシロハナちゃんはたくさんの失敗と成功を重ねて前に進んでいきます。

それこそが「AIヒロイン研究所」だからです。

AIVtuberはまだブルーオーシャンで、これから拡大していくの領域で、いつスタンダードになるくらいになるかは先が見えない状況です。

そんな状況でも、このプロジェクトは絶対に道半ばで途絶えたりしません。

今のうちに推しておいてください。

AIVtuberが最高に輝く時代をシロハナちゃんと一緒に迎えましょう。

この記事が参加している募集

ご支援は活動費に使わせていただきます