そもそも線形とは?

機械学習を勉強していると、なにかと線形という言葉を聞きます。とくに、「機械学習には線形代数と微分積分が必要」とか言われると思います。でも、ちょっと知ったかぶりをしたいと思います。つっこみたい話題は、

・線形代数は行列とは違うの?

・そもそも線形とは?

とかです。別にこれに答えられて学習にはおそらくなんの助けにもならないと思いますが……

一応一番最初に言っておくのは”線型”代数って書きたいよね。って話。(イキり学生並みの感想)

線型代数は行列とは違うの?

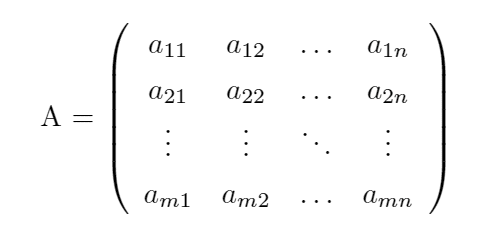

まず、行列の定義はこれです。

実際中身は必ずしも数とは限りません。関数のような場合も多々あります。

線型代数と行列論との違いは何か?という話です。これを知っていれば、数学的な区別では、線型空間の話になります。線型空間と線型写像については次にまとめるとして、行列は数ベクトル空間の部分空間を用いて議論されているものです。

つまり、行列は線型代数と中心をなすものではあるが、線型代数の学問のなかのひとつくらいの認識でいいかと思います。気持ちそんなに差はないかと。(まぁ、行列ですら理解できないんだけど……)

そもそも線形とは?

線形は文字通り線の形です。曲線ではないってことになります。ここでは、行列における線型空間や線型写像について書きます。

線型空間

線型空間とは次の演算が成り立つものである。

(A, B, C は(m,n)型行列, c, d は数)

・(A + B)+ C = A + (B + C)

・ A + B = B + A

・ A + O = A

・ A - A = O

・ c(A + B)= cA + cB

・(c + d)A = cA + dA

・(cd)A = c(dA)

・ 1A = A

・ 0A = O

ここで、Oは各成分がすべて0の(m,n)行列を表す。

めちゃくちゃ当たり前っぽいこと書いてますが……

つぎは線型写像です。行列では、実数を複素数の特殊な場合として用います。次では、Cが複素数全体を表します。

定義. 線型写像

TをC^nからC^mへの写像とする。Tによるxの行先をTx(T(x))とあらわす。

Tが次の性質を持つとき、TをC^nからC^mへの線型写像という。

(x, yは任意のC^nのベクトル, aは任意の数)

・T(x + y)= Tx + Ty

・T(ax)= aT(x)

とくに、m=nの時を線型変換という

ちょっと違うかもしれませんが感覚としては、

y(x) = ax

において(x,yは変数でaは数)、x = u + vを入れると、

y(u+v) = a(u+v)

= au + av

= y(u) + y(v)

だし、x = bxとすると、

y(bx) = a(bx)

= abx

= bax

= b(ax)

= by(x)

になります。逆に、

y(x) = x^2

とかは、

y(u+v) = (u+v)^2

= u^2 + 2uv + v^2

となってしまうので、2uvが邪魔で線型ではないです。(非線形)

ちなみに、sin(x)とかも非線形です。

最後に線型結合について書いて終わりたいと思います。一般に線型結合とは、

定義. 線型結合

ベクトルa1, a2, ... , akに対して、

x1a1 + x2a2 + x3a3 + ... + xkak

ので作られるベクトルを、a1, a2, ... , akの線型結合という

とりあえず足し算で結ばれたものを線型結合だと思っていただければいいかと思います。

まとめ

この辺をもとに書きました。くわしくは読んでください。(まとめではない)

あとがき

誤字脱字あったらごめんなさい。LaTeXで数式とか書いてスクショで画像にする手間がそんなに無いことがわかったのでわりといいかなぁ。と思いました。LaTeXitはつかったことないです。あと、まだ三日坊主ではないので偉い。

この記事が気に入ったらサポートをしてみませんか?