第14回Language&Robotics研究会聴講(2023年6月23日)

はじめに

今回は

ロボットに接触を含む作業をリアルタイムで実行させる話。

講演のスライドおよび動画は後日公開していただけるとのことなので

本noteは速報です

(矢野の個人的な備忘録で、事務局の公式議事録とかではありません)

動画が公開されました

バイラテラル制御に基づく模倣学習による動作速度と環境適応能力の両立

概要(HPより)

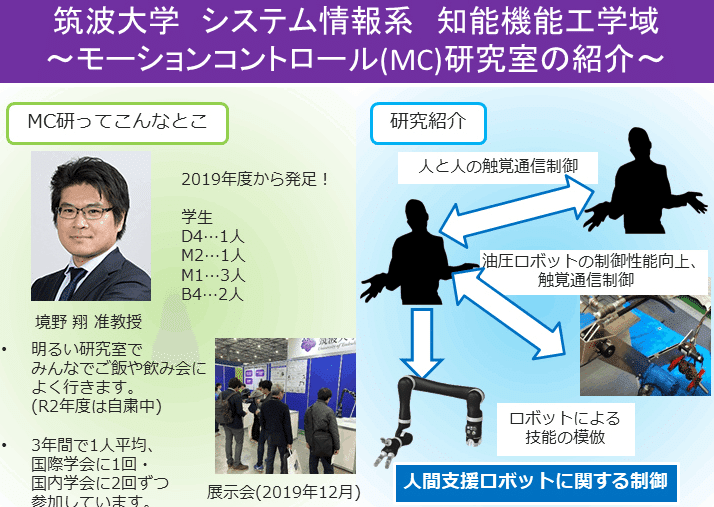

講演者:境野 翔 先生 (筑波大学)

発表タイトル:バイラテラル制御に基づく模倣学習による動作速度と環境適応能力の両立

概要:ロボットの環境適応能力を向上させるために機械学習を利用する研究は数多く報告されているが、人間並の動作速度と環境適応能力を両立させることは困難であった。本講演ではこれを解決しうる「バイラテラル制御に基づく模倣学習」について紹介する。遠隔操作制御であるバイラテラル制御を用いることで人間の力制御技能の指令値を直接計測可能になるため、これを模倣する動作生成AIを作れば、豆腐を含む多様な食品の把持操作、3次元曲面の拭き掃除、人間との協調物体運搬など、これまで困難とされてきたことが実現できる。今回のLangRobo研究会では、NTTの西田 京介先生、壹岐 太一先生から最近のご研究についてご紹介いただきます。 特に、複数エージェントによる表現学習と記号の創発に関する研究について、お話いただきます。

10:30 - 10:33オープニング

品川先生よりLangage&Robotics研究会の簡単な説明と

第15回 Langage&Robotics研究会(7月7日)の案内、

聴講における注意(聴講中はmute、誹謗中傷の書き込み禁止)と

質問の手順(slidoに寄せられた質問で、「いいね」の多い順番に司会者が質問)があり

すぐ本題に突入した。

10:33 - 11:15講演(42分)

1.自己紹介

慶応大学大西研究室出身

今年初めて人工知能学会全国大会に参加して、制御屋として思うところがいろいろとありました

2.導入

人間が難なくこなしているのに、ロボット化できていない肉体労働は多い

・キュウリの箱詰め

・倉庫内の陳列

画像や言語の分野では人工知能の活用で飛躍的な能力向上が実現しているが、ロボットの、接触を含む動作計画は困難なまま残されている

(ラスト5cm問題)

制御工学は、精密かつ時間領域で高速な制御が可能

人工知能は、比較的ゆっくりだが認識と空間把握に長けている

この中間領域の橋渡しに当たる「動作生成」をしたい

制御屋は、よくボード線図を使用するんですが、ちまたでよく見かける「20倍速」などのロボット動画は、制御屋から見たら「周波数が変わるとゲインが全く異なってくる」のでお話にならないレベルです

3.背景

形状が変わる物体のハンドリングに対応する深層学習型ロボット

すごいんだけど、人間と比較するとのろい上に引っかかったりしている

RT-1(Google)

すごいんだけど、よく見ると「4倍速」と書いてある

Sergey Levin

すごいんだけど、「倍速」再生などしている(上のVTRには倍速ロボットはありません)

4.基本的な考え方

のろい理由は「位置制御」にあります

人間は「位置制御」と「力制御」をうまく使って難なく作業をこなします

包丁をまな板に当てる作業を考えてみます

「位置制御」だと、正確に接触地点に包丁の刃を位置制御する必要があります

「力制御」だと、簡単に接触させることができ、まな板の「拘束」を利用して、包丁をまな板の上で滑らせることさえ容易にできます

では、ロボットを柔らかくすればいいじゃないかと考えるかもしれませんが、柔らかくするとふにゃふにゃで精密な制御が難しくなる問題が生じます

ロボットの制御に「力制御」がありますが、これは人間の「力制御」とは異なっていて、目標の力が出る「位置」を制御しています。このため、静的に力を出すことができません

(感想:1983年から1987年に大型プロジェクト「自動縫製システムの研究開発」で「力と位置のハイブリッド制御方式の7自由度人間腕型腕機構」を開発していた身としては「異議あり!」と言いたいところではあります)

力制御すると、「ペグ・イン・ホール(ペグを穴にはめる)」が簡単に行えます

(感想:「自動縫製システム」で、人間が嵌めようとすると「こじて」はまらないペグをロボットハンドが難なく嵌めるデモをした頃を懐かしく思いだした)

ポテチつまむロボットアーム

そこで、人間の力を借りることを考えました。

力フィードバックバイラテラル制御では、ポテチを割らずに掴むことができます。

力フィードバックバイラテラル制御において、「角度、各速度、トルク」をリーダマニピュレータ(人間が操作する)とフォロワマニピュレータでやりとりします

人間がリーダを操作している時に、フォロワの状態とリーダの状態のデータセットを学習します

デモ(定規に倣って線を引く)

定規の角度を変えて学習すると、学習していない角度の定規にも倣って線を引けるようになります

さらに、分度器や自由曲線定規にも倣って線を引くことができるようになります

これは、人工知能が「拘束に倣うことを学習した」と言えます

しかも、ビデオは「等倍速!」人間と同じ速度です

(感想:人間の倍速、3倍速の高速にも対応できるようになるとすごいな)

このデモが基本で、後は、この考え方の応用になります

・人と協調して物体を把持する(内力を一定に保つことを学習)

・斜面の字を黒板消しで消す(斜面に倣うことを学習)

・パンケーキをフライパンから運ぶ(摩擦と慣性力を考慮した動作学習)

・ボウルを拭く(曲面に倣うことを学習)

・豆腐やたまごを操作(力の塩梅を学習)

国際ロボット展で4日間動作し続けました

掴んだペンで字を書くこともできるので

人間が使える道具を使って作業を行うことが可能になります

5.模倣学習

人間と同じ速度で接触作業を遂行できる秘密は「模倣学習」にあります

通常、機械学習はロボットにティーチングする人間の技能を収集し、技能に対する行動を推定するのですが、人間の技能に対して、ロボットの行動には時間遅れが生じるため、機械学習後の行動とティーチング時の行動に「時間遅れによる不一致」が生じます。

提案する「模倣学習」は、人間が操作するのは「作業するロボット」ではなく、「リーダロボット」であるところがポイントです。

「リーダロボット」にも「フォロワロボット」同様の時間遅れが生じるため、技能収集と行動推定の時間遅れが一致するのです!

人間は、リーダロボットの時間遅れを「先読み能力」により補完して時間遅れを感じさせないスムーズなフォロワロボットの動作を実現するのです!

よくわからない「フィードフォワード制御」は、人間に任せましょう

データ収集から実行までの全工程においてシステムの「制御器」を変更しないことが重要です

「模倣学習」は、人間並みの速度で接触を含む作業を数十回の教示で実現します

模倣学習の実装

具体的な実装のブロック線図を示します

(通常の外乱オブザーバ付制御器のブロック線図)

時系列推論を行います

軌道生成ループは20ms、制御は1~2msで行います

外乱オブザーバが重要で、ゲインを20倍ぐらいに上げておきます

自己教師学習(パンケーキの粉をすくうタスクを例として)

粉を60gすくうタスクでは、粉をすくう目標位置と作業速度を与え、

タスクを実行して学習を進めます。

例えば目標速度4秒に対して実行速度3.5秒の結果が得られた時に、失敗として捨てるのではなく「3.5秒のデータが新たに加わった」とみなして、学習データに追加します

このような学習方法で、目標実行速度(4,8,12秒)、異なる位置、異なる重さで24パターンの予備学習を行いました

予備学習の結果、成功率は41.2%でした

次に、自動でトライアンドエラーを180回繰り返して学習します

本実験では成功率が81.5%に向上しただけでなく、指令時間と実行時間の誤差も改善されました

さらに180の成功例を教師データとして学習を継続することが可能です

階層型模倣学習(時間ベースの階層化)

機械学習の問題として「過去の履歴を覚えてくれない」「センサごとにセンシング周波数が全く異なる」ことがあります

この問題を解決するために、時間間隔を大きくとった「遅い動作用データベース」にもとづく機械学習を上位層、時間間隔を密にとった「早い動作用データベース」にもとづく機械学習を下位層として階層化します。

この階層化は、「重要な動作指令」を上位層、「上位層の指令に従う単純な動作指令」を下位層とする階層化とは異なります

制御工学の世界では「周波数が異なる複数のゲインピークを持つシステム」の指令と応答の関係を一つのデータセットで機械学習するのは不可能であることが30年前から知られています

階層化することにより、上位層では20ステップ先、下位層では1ステップ先の応答に対応するデータセットを同時に学習できます

さらに、「上位層はパラメータを少なくしてもいいのではないか?」と考え、上位層は「角度のみ」下位層は「角度、角速度、トルク」をパラメータとして学習させました。

これにより、上位層はさらに4ステップ先まで予測する学習が可能になりました

デモ:ペンを持って文字を書く

ペンを持ってA、B、Cの文字を紙に書くタスクにより、ほかの機械学習法と比較するベンチマークテストを行いました

比較対象はFast-Slow RNN、ClockWork RNN、MTRNNです

ベンチマークの結果、文字の質も、学習時間も模倣学習が優れていることがわかりました。特に学習時間は模倣学習の3分に対し、MTRNNは19時間を要しました。

さらに、模倣学習は「未学習文字」を書く事もできました

6.これから

模倣学習の上位層は、時間に余裕がある一方高次の概念にもとづく学習が必要になってくるので「人工知能」研究者の領域

模倣学習の下位層は、高速に単純な動作を実行する性能が求められるので、「制御屋」の領域

協力し合って、中間部分を埋める研究を進めていきたい

7.まとめ

・良いデータセットがあれば、高度な「人工知能」の助けを借りなくても、非常に少ない学習で、接触を含む高度な作業を実行できることを示した

・バイラテラル制御のメカに関して、モーションコントロール精度を改善することにより、タスクの精度を向上できる余地がある

・接触を含む作業の大規模データセットが収集できれば、もっと複雑な作業も行うことが可能になる

11:15 - 11:35Q&A(20分)

質問はSlidoで受付

録画/録音していないので、多分に主観的になっている可能性があることをご承知ください。誤りをコメントしていただくと修正します

Q1:力情報を明示的に提示または推測する手法はあるのでしょうか?

A1:位置情報と同じ立ち位置です。「力をもう少し強く」などのプロンプト表示に対応できるデータ表現ができるかどうかはわかりません

Q2:ロボットの機械学習の現状はどうなっているのでしょうか

A2:4足歩行の強化学習がすごいことになっています

Q3:精緻かつ複雑な動作であって突発非定常な反応的な動作は学習可能でしょうか?

A3:バイラテラル制御が高精度に行えれば可能になります

Q4:外乱オブザーバは、学習時と異なる外力を検出して、力制御を補償するようにしているのでしょうか? また、力指令も20ms一定値で指令すると、最終出力が矛盾しそうなのですが、この辺り安定させるやり方をお聞きしたいです。

A4:「やったらできた」が正直なところです。制御工学では制御対象の周波数の10~20倍のサンプリング周波数がよしとされています。外乱オブザーバも50Hzですが、うまくいきました

Q5:自然言語処理で上位レイヤの動作を教示するというのは、具体的にどのような方法でどのように教示し、どのような特徴量を学習することになるでしょうか?

A5:はずかしながら、LSMを4から8層並べただけです

Q6:学習済みの動作モデルを後から修正することは可能でしょうか?制御性能(応答、位置制御など)を高めるにはどのように学習させればよいでしょうか?

A6:追加学習で可能です

Q7:逆に今、課題となっている問題はどの様なものがあるのでしょうか?バイラテラル制御での課題?みたいなのを伺いたいです。

A7:制御の途中にニューラルネットワーク学習を挿入すると制御性能が悪化します。制御はPD制御と外乱オブザーバのみで構築することが重要です

力のセンシング、慣性モーメントの推定など、バイラテラル機構のメカ寄りの課題が大きいです

Q8:リーダーとフォロワーは、全く同じロボットである必要があるのでしょうか? 大きな機械だと、人間が動かして教示するのが難しい場合があるのではないかと思いました。

A8:バイラテラル制御は異なるサイズ、異なる構造でも可能なのでリーダもフォロワもそれぞれ最適な構造のものを用いて問題ありません

Q9:タスクの終了判定などはどうやっているのでしょうか?

A9:かなり適当に「終了位置の近傍に来たら終了」としているので、改善の余地があります

Q10:Leaderの動作をFollowerが模倣するように自己教師あり学習するこの模倣学習は、一般にteacherに対するstudentモデル学習と類する学習方法と考えてよろしいでしょうか?

A10:自然言語で位置制御する話と等価だと考えます

Q11:文字を書く動画では,3文字すべてを1つのネットワークで学習しているのでしょうか?開発した手法は,タスク軌道が長期になるほど,生成軌道の誤差が蓄積してしまう可能性はありますか?

A11:リーダがズレて誤差が蓄積しました

Q12:力制御を利用してより使いやすくするために、ロボットハードウェアに求める機能や性能はどのあたりになるのでしょうか?

A12:現在のロボットは、振動を抑えるためにゴツい構造になっています。模倣制御の導入により、ロボットが軽量で操作しやすくなる可能性を感じています

Q13:遠隔手術ロボットはこの制御機構を利用しておりますでしょうか?

A13:リーダに力フィードバック、フォロワに位置指令を送りますが、双方向にすべてのデータ(4チャンネル)を使用しているものはありません

11:35 - 11:36クロージング

時間になったので、匿名ではないメンバーの質問に対する回答は後日公開することでクロージングとなった。

次回は7月7日(金)10時30分から九州大学の内田諭先生の「記号創発ロボットは多義性を獲得できるか」です。と、アナウンスがあった

おわりに

環境とインタラクションするロボットの制御を、少ない学習で人間と同じ速度で実行することができたということに驚きました。

はやく、人間が単純労働から解放されるといいですね

(おまけ)

過去4回のL&R講演会

人工知能関連最新ツイート

本noteは私の備忘録ですが、自由に読んでください サポートは、興味を持ったnote投稿の購読に使用させていただきます