AI革命時代の新たな脅威~ディープフェイクを見抜く技術の現状と課題~

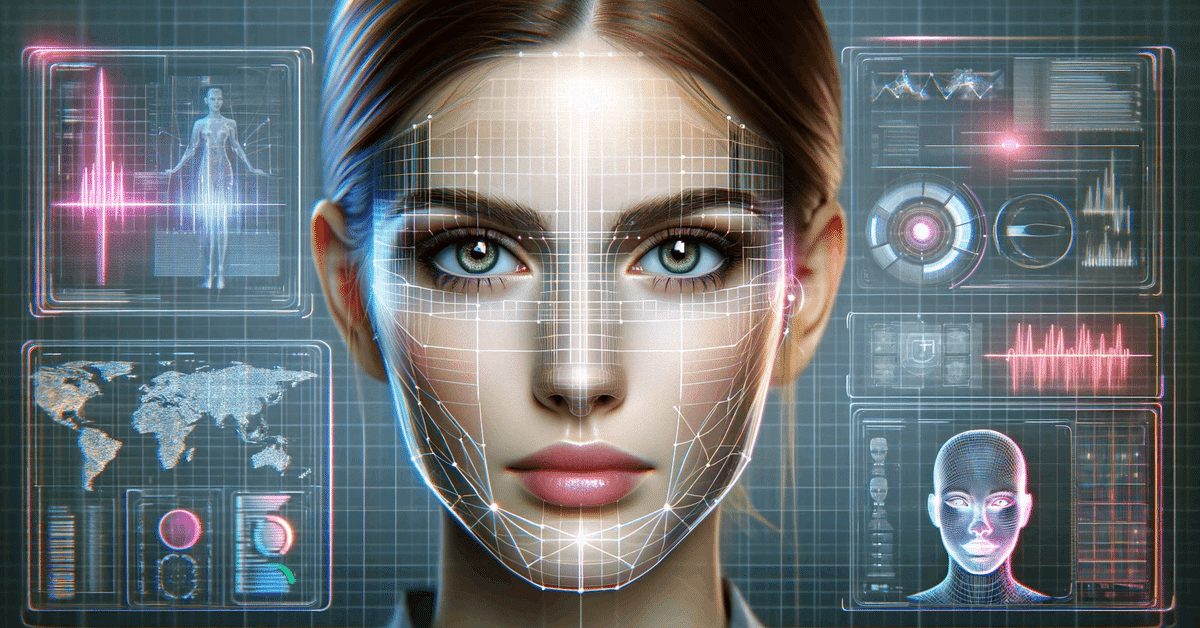

ディープフェイクとは、AI技術を悪用して作られた偽の画像や動画のことを指します。最近では、有名人の顔や声を無断で使った偽ポルノ動画の拡散や、政治的な偽情報の流布など、ディープフェイクによる深刻な問題が起きています。以前の記事ではディープフェイクを作る技術について紹介しましたが、本記事では、特にディープフェイクの検出技術に焦点を当てて解説します。

背景

近年、AIやディープラーニングの技術が飛躍的に進化したことで、ディープフェイクと呼ばれる高度な偽画像や偽動画の作成が可能になりました。このディープフェイクは、有名人や政治家、著名人の顔や声を無断で使って、あたかもその人物が発したかのような偽のメディアコンテンツを生成することができます。

最近の事例では2024年2月に、香港の金融関係者がディープフェイクを使った詐欺に遭い、2,500万ドル(約25億円)を騙し取られました事例がありました。CFOになりすまし、ビデオ会議で指示を出したとされています。

このような悪用が横行すれば、プライバシーの侵害や名誉毀損、偽情報の拡散など、重大な社会問題が引き起こされる恐れがあります。これらの事例から、ディープフェイクがもたらす脅威の深刻さが伺えます。

ディープフェイク検出の3つの視点

アイデンティティ(Identity)の検出:

ディープフェイクでは、別人の顔や声を無断で使ったりすることで、あたかもその人物自身がメディアの中で発言しているかのような「なりすまし」が行われます。具体的には、顔認識や声紋認証などの生体認証技術を応用して、映像や音声の本人確認を行います。

事実(Fact)の検出:

ディープフェイクによって作られたメディアコンテンツは、たとえ本物の人物が映っていたとしても、場面自体がでっち上げられた偽物であることがあります。文脈の一貫性のチェックや、映像中の物理的な矛盾箇所の検出といった手法が研究されています。

生成AI(Generative AI)の検出:

ディープフェイクは生成AIの一種ですから、メディアコンテンツが人工知能によって生成されたものかどうかを見分ける技術も重要視されています。この検出方法には、直接的な判定と、透かしやメタデータを付与して間接的に判定する方法があります。例えば、生成AIの出力には人間が作ったものとは異なる特徴的なノイズパターンが含まれることが分かっており、そういった痕跡を捉えて判別する手法が研究されています。今回はディープフェイクを直接的に検出する技術について解説しています。

ディープフェイクの4つの形態と対策技術

ディープフェイクには、テキスト、画像、音声、動画の4つの主な形態があり、それぞれに対してさまざまな検知技術が研究されています。ここでは最新の研究動向を簡単に紹介し、各形態の最新論文の詳細については別の記事で解説します。

テキスト:

自然言語処理(NLP)技術を活用し、文章の一貫性や矛盾、おかしな表現を検出することで、生成AIによる出力かどうかを判別できます。長文はより検知しやすい一方、短文は検知が難しくなります。

ChatGPTなどモデル詳細について公開されていない巨大言語モデル(LLM)による生成文も、一定程度の検知が可能です。

画像やウェブ上の情報と組み合わせてファクトチェックを行うことで、より確実な判断ができます。

(別記事で解説)

画像:

ディープフェイクによる加工の有無は、物理的な痕跡の解析などからある程度検知できます。どういった痕跡があるかは前回の記事をご覧ください。

キャプションなど他のモーダル情報やウェブ上の情報を組み合わせてファクトチェックすることも有効です。

(別記事で解説)

音声・動画:

音声と画像の両方の解析を組み合わせても、現時点での技術ではディープフェイクの完全な検知は困難です。

物理的な特徴の解析などから、一定の手がかりは得られますが、高度な偽物を見破るには至っていません。

このように、テキストや画像に比べ、音声や動画のディープフェイク検知は依然として大きな課題となっています。モーダル間の連携や、ウェブ上の情報を活用したファクトチェックなど、複合的なアプローチが不可欠です。

ディープフェイク検出技術の限界

前述のとおり、ディープフェイクの検出技術は、必ずしも万能ではありません。なぜなら、検出アルゴリズムはディープフェイクの特定の生成手法や編集手法に特化していることが多く、別の方法で作られたディープフェイクには対応できない可能性があるからです。つまり、1つの検出技術で全てのディープフェイクに対応するというのは難しいのです。

ディープフェイク検出技術の今後

一方で、ディープフェイクの生成技術は日進月歩で進化を続けています。生成AIの性能向上とともに、新たな手口が次々と登場しています。検出側が新しい手法を見抜けるようにアルゴリズムを改良しても、生成側がさらにそれを上回る技術を編み出せば、またしても検出が難しくなっていきます。

このように、ディープフェイクの生成と検出は、技術的な"いたちごっこ"になることが避けられません。つまり、検出技術が進歩すれば、それに合わせてディープフェイクの手口も巧妙化し、検出を困難にするという悪循環に陥る可能性があるのです。

そのため、検出技術の向上に加えて、教育やリテラシーの向上、法整備など、より包括的で総合的な対策が急務となっています。

■「TDAI Labについて」

当社は2016年11月創業、東京大学大学院教授鳥海不二夫研究室(工学系研究科システム創成学専攻)発のAIベンチャーです。AIによる社会的リスクを扱うリーディングカンパニーとして、フェイクニュース対策や生成AIの安全な利用法について発信しています。