生成AIによる事件まとめ|生成AIにおける危険も解説

生成AIによって生じた事件についてまとめました!

本編は生成AIによる事件の事例から危険性について解説しております!

それではご覧ください!

生成AIによる事例紹介

国内事例5選

日本のChatGPTアカウントがダークウェブ市場で売買

10万以上のChatGPTユーザーアカウントの認証情報がダークウェブで販売される事件が発生しました。この情報漏洩は、アジア太平洋地域で特に顕著で、全体の40.5%がこの地域で盗まれたと報告されています。そのうち、少なくとも661件が日本から漏洩であることが確認されました。生成AIで岸田首相の偽動画、SNSで拡散

生成AIを使用した偽動画がSNSで拡散され、岸田文雄首相が不適切な発言をしているかのように見せかけられました。この動画は日本テレビのニュース番組のロゴを不正に使用し、実際のニュース画面のように偽装されていました。生成AIで作られた児童の性的画像が国内サイトに流布

画像生成AIで作られたとみられる児童の性的画像が国内サイトに大量に出回っています。英国の対策団体の責任者らを招き、東京都渋谷区の国連大学でシンポジウムが行われるなど、対策が検討されています。画像AIは「著作権侵害」と複数のイラストレーターが法規制を訴える

イラストレーターらでつくる団体が、彼らの作品のスタイルを模倣して画像を生成するAI技術に対して著作権侵害を訴えました。特定のアーティストのスタイルで画像を生成するAIが、実際のアーティストの許可なくそのスタイルをコピーし、アーティストが作成したかのような作品を生成していると主張しています。AIの発明に対して特許を認めない判決「発明者は人に限られる」

AIの発明に特許を認められるかどうかが争われた裁判で、東京地方裁判所は「発明者は人に限られる」として特許を認めない判断を示しました。一方、今の法律はAIの発明を想定しておらず多くの問題が起きるとして、国会での議論を促しました。

海外事例5選

サムスン社員により情報漏洩が複数回発生

韓国サムスン電子社員が、機密性の高い社内情報をChatGPTに入力してしまい、少なくとも3件の情報漏洩が確認されました。ソースコード情報の流出が2件、会議内容の流出が1件発生したことにより、サムスンは生成AIシステムの使用を禁止しました。香港にてディープフェイクに騙され38億円送金

香港で多国籍企業の会計担当者が、AIで合成された最高財務責任者(CFO)を装った相手のテレビ会議に騙され、2億香港ドル(約38億円)を送金する事件が発生しました。香港警察によると、担当者が参加したテレビ会議の映像と音声はいずれもAIを利用して合成・複製された偽物(ディープフェイク)だったとのことです。ニューヨークタイムズがOpenAIとマイクロソフトを訴訟

ニューヨークタイムズは、OpenAIとマイクロソフトを著作権侵害で訴えました。訴えの中心は、同社が記事を無許可でAIモデルの訓練に使用し、その結果としてAIが元記事に極めて似た内容を生成し、タイムズの購読モデルと直接競合する製品を生み出したという点です。タイムズは、この訴訟で損害賠償とAIモデルの使用停止を求めています。「ゲーム・オブ・スローンズ」の作者たちがOpenAIに集団訴訟

「ゲーム・オブ・スローンズ」の著者であるGeorge R.R. Martinをはじめとする複数のベストセラー作家たちは、彼らの著作権を侵害してChatGPTを燃料としているとしてOpenAIに対して集団訴訟を提起しました。AIが創作物をトレーニングデータとして使用していることが問題視されています。生成AIによりCEOの声を模倣し24万3000ドルを詐欺

生成AIを悪用した、エネルギー会社CEOの声の模倣による音声詐欺が発生しました。この音声を使って、同社の英国子会社のCEOに連絡し、架空のハンガリーのサプライヤーに23万ユーロを緊急に送金するよう要求しました。この指示に従い送金された資金はその後、メキシコなど他の場所に移動されました。

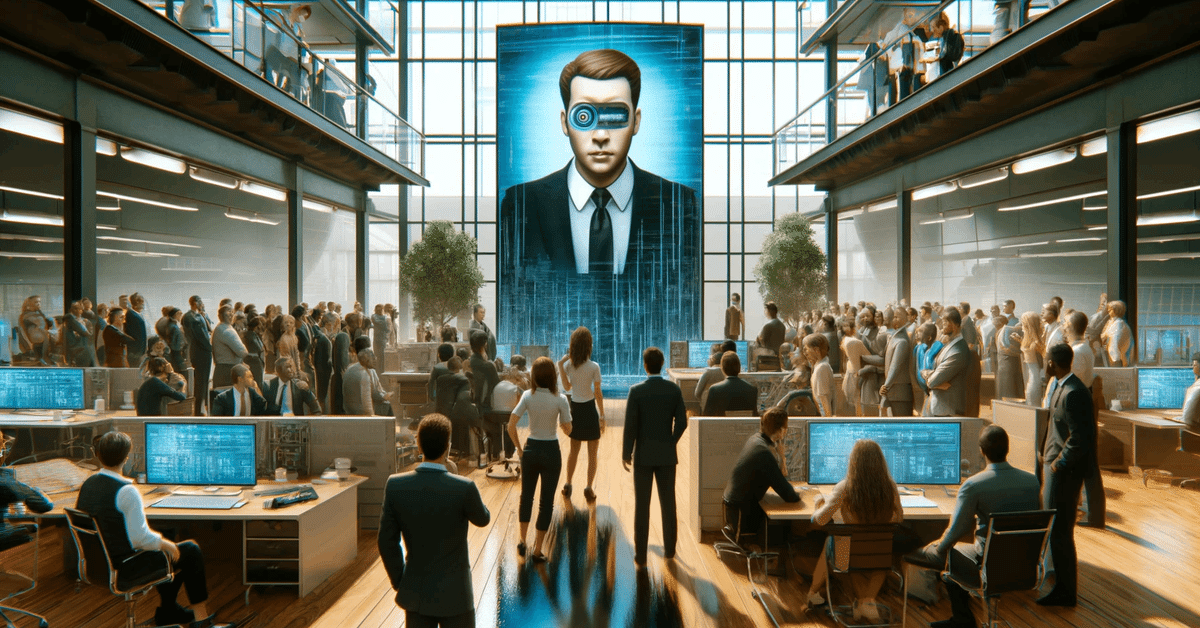

生成AIの危険性について

生成AIを利用した犯罪は、その技術の進化に伴い、新たなリスクと課題を社会に提示しています。特に「ディープフェイク」と呼ばれる技術では、人物の声や映像を驚くほどリアルに模倣できるため、詐欺や偽情報の拡散に利用される危険があります。

さらに、人々がメディアの真偽を疑うようになれば、社会全体の情報に対する信頼が低下し、社会的信頼を損なうことに繋がります。AIを利用した偽情報は選挙の干渉や公共の安全に対する脅威となる可能性があり、民主主義の基盤が揺らぐことになります。

また、個人のプライバシーの侵害も重大な問題です。AIが個人のデータを基にして個人を特定できる情報を生成することが可能になれば、その情報が不正に利用されるリスクが増大します。

これらの問題に対処するためには、法的な規制や技術的な対策が急務です。AIの発展とともに、これらの技術を悪用した犯罪に効果的に対応するための法律や倫理基準の整備が求められています。企業や組織も、AIを安全に利用するためのガイドラインやプロトコルを設け、教育と訓練を強化することが必要です。

この記事が気に入ったらサポートをしてみませんか?