BardでOCRを試してみたら凄い精度だった!

GoogleのAIチャットボットBardに画像入力機能が実装されました。これは画像をアップロードすることで、どんな画像かBardが理解してくれる機能です。

今まではテキストしか入力できませんでしたが、この機能が追加されたことで画像を使ってBardと対話したり、画像について説明してもらったりすることができるようになります。

ちなみに、GPT4にもこの機能があるようですが、2023/7/15時点ではまだリリースされておりません。

早速色々な方が試されたようで、Twitterでは実験報告がいくつもあがっていました。

まさかのGPT-4より先にBardにマルチモーダルの画像入力機能が解放されました!

— 今井翔太 / Shota Imai@えるエル (@ImAI_Eruel) July 13, 2023

実用レベルで,GPT-4論文で報告された画像認識の性能と遜色ないレベルです

スクショやスマホの写真に撮って入力すれば,文字も図も読み取り,問題に応えてくれます.

手書きのモックアップからwebサイトのコード起こしも可能 pic.twitter.com/C4lpQ8ZJgV

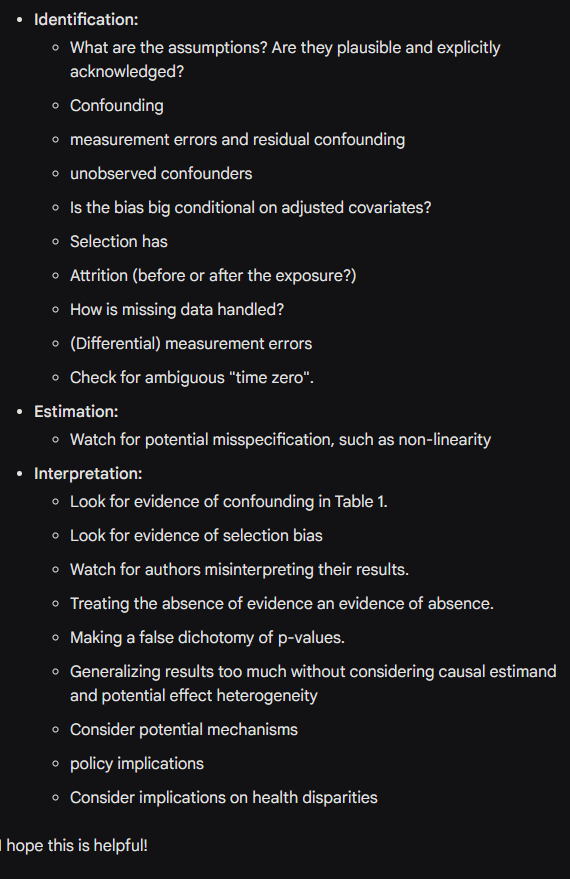

さて、この記事ではBardでOCR(画像から対象物を読み取る機能)を試してみた結果をご紹介したいと思います。

結論

まずは結果からです。

画像がガビガビにも関わらず、ほぼ間違えずに画像から英語のテキストを抽出することができました。

目立ったミスとしては、インデントの階層が少し間違っていたり、ピリオドがなかったりしたくらいです。

正直、ここまで正確に読み取ることができるとは思っていなかったので、驚くべき精度でした!

英語だとこのくらいの精度で抽出できるようですが、日本語対応されたときにどの程度の精度が出るのかは気になるところですね。

対象とした画像

KRSK先生がご自身のブログで「論文を批判的に読むときのチェックリスト」を公開してくださったため、そちらのチェックリストをスクショで保存し、Bardで読み取ってみました。

該当の記事はこちらになります。

Bardで読み取ってもらった内容を少しだけ修正し日本語訳したもの

質問

その研究は斬新ですか?

公衆衛生や健康格差への取り組みにとって重要か?

その研究の方法は、その答えを示しているか?

方法と質問の間に乖離がないか注意すること。これは驚くほどよくあることである。

サンプリング

誰が含まれ、誰が除外されるかを検討する(つまり、「誰が地図に載っていて、誰が地図から外れるか」)。

対象集団と健康格差への影響を考慮する。

選択バイアスを探す。

測定

研究課題・仮説と測定内容の一致を評価する。

測定値の妥当性と正確性をチェックする。

因果推定量

研究はATE(平均治療効果)、CATE(条件付平均治療効果)、LATE(局所平均治療効果)、またはそれ以外を推定しているか?

検討されている仮説的介入は何か?

累積治療vs偶発治療

時間固定 vs 時間変動

これらの選択は明示的か?議論はその選択を認めているか?

推定量と考察・解釈の間に不一致はないか?

特定

仮定は何ですか?それらはもっともらしく、明確に認められていますか?

交絡

測定誤差と残留交絡

観察されない交絡因子

バイアスは調整共変量に依存して大きいか?

選択バイアス

離脱(暴露の前か後か?)

欠損データはどのように処理されますか?

(差分)測定誤差

曖昧な "time zero "をチェックする。

推定

非線形性のような潜在的な誤指定に注意してください。

解釈

表1の交絡の証拠を探す。

選択バイアスの証拠を探す。

結果を誤って解釈している著者に注意すること。

証拠がないことを証拠がないことの証拠として扱う。

p値の誤った二分法を作る。

因果推定値や潜在的な効果の異質性を考慮せずに結果を一般化しすぎる。

潜在的なメカニズム/政策への影響を考慮する。

健康格差への影響を考慮する。

余談

KRSK先生のブログは因果推論を勉強するときに大変良く参照させていただいております。いつもありがとうございます(^^)

この記事が気に入ったらサポートをしてみませんか?