RVCボイチェン(VCClient)での音質に拘った歌配信の実現!

今日はVTuber配信者やこれから配信デビューしてみたい方向けに、RVCボイチェンでの歌配信についての環境構築方法を解説をしたいと思います!

はじめに伝えておきますが、結構ハードルの高い環境構築になりますのでご容赦ください…m(__)m

ただ、これが実現できれば好きな声になって、歌だけでなくボイスの音質に拘った配信ができるようになりますので、興味がある方は是非最後まで読んでみてください!

はじめに

RVC & VCClient とは

RVCとは、高性能なAIボイスチェンチャー&AIボイス作成ツールのことです。

詳しくはこちらで解説していますのでご参考下さい!

VCClientはRVC学習モデルを使用した、リアルタイムボイスチェンジャーツールになります。

環境構築について

普通に歌枠として配信するだけなのであれば、VCCientで変換した音声と音源をそのままOBS上でMix(要遅延設定)して配信すればできるのですが、せっかくの歌配信!どうせなら音質に拘りたいですよね?

高品質で地声を変換!

変換後の声にリバーブなどのエフェクトをかけてクオリティアップ!

音源をDAW上で再生して、音源にもエフェクトをかけて音質アップ!

この環境を構築にかなり苦労しました…💦

これらを実現する方法を解説していきたいと思います!

VoiceMeeterBANANAについて

仮想ミキサーであるVoiceMeeterBANANAは使いません!

といういか使えません!!泣

試したことがある方は分かるかと思いますが、VCClientとは相性が悪いようで、BANANAやPOTETOでの音声変換は上手く処理できない上に、VCClientが落ちます💦

では、どういう方法を使うのかというとオーディオインターフェースを2台使用します!

仮想でなく、ちゃんとした物理で殴るスタイルです!笑

必要機材&ツール

機材

ハイスペックPC(USB Type-C接続できると直良し)

XLR端子マイク

オーディオインターフェース×2台(ASIOドライバ対応のもの)

USB Type-Cハブ

ハイレゾ対応USB Type-Cケーブル2本

使用ツール

Cantabile(マイクの入力音声の質を上げるのに使います)

VCClient(AIボイチェン)

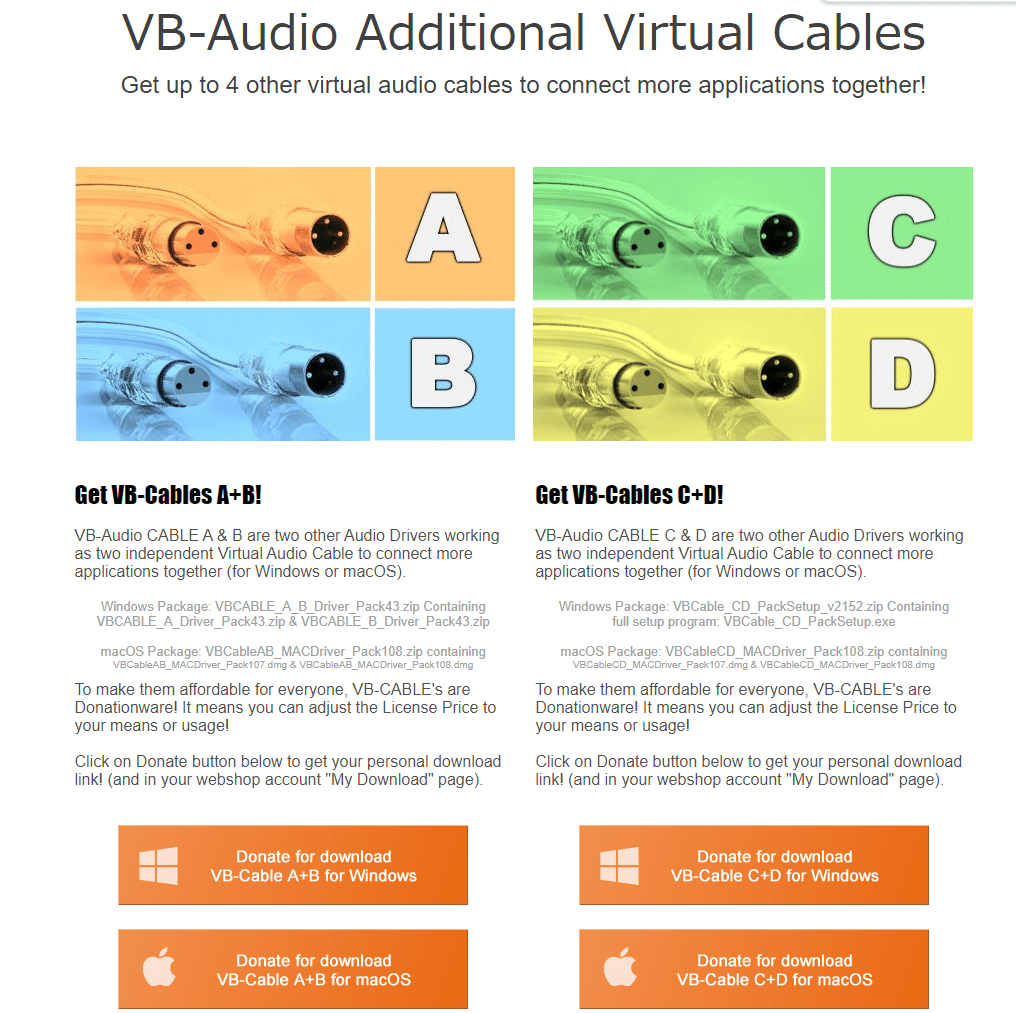

VB-Cable(仮想オーディオケーブル)

DAW(オーディオインターフェース付属のもので可)

オーディオインターフェース付属ミキサーソフト(Revelator付属のものがおすすめ)

reastream(DAWの音をOBSに送るプラグイン)

VSTプラグイン各種

waves StudioRack

OBS

ハイスペックPC

配信にはたくさんのツールを同時に起動して動かす必要があります。

そのため、かなりのスペックのPCが要求されます。

さらに、VCClientでもGPU処理を要求されるため、GPUのスペックも求められます。以下に推奨スペックを記載しておきます。

・CPU:Core i7 11世代 同等以上

・GPU:RTX4070 Super 同等以上

・RAM:48GB以上

・メインストレージ:M.2 SSD

・電源ユニット:900W以上(配信にはたくさんの機材を繋ぐため、電源容量はGPU負荷よりも余裕を持たせておきましょう)

・マザーボード:USB Type-C入力端子があるもの

マイク

XLR端子、単一指向のもので、なるべく音質が良いもの(1万円前後以上)を選びましょう。

RVCの学習モデルにもよるとは思いますが

微妙な発音は誤変換されてしまう可能性もあるので、もしかするとコンデンサーマイクよりダイナミックマイクの方が相性は良いかもしれません💦

ちなみに自分はAT2040(ダイナミックマイクを使用しています。)

オーディオインターフェース

ここが今回の本題にもなるところになります!

音声入力用のAI、音声出力用のAIに分けて使用します!

なぜ入出力用を分けて、オーディオインターフェースが2台必要なのかというと、ASIOドライバを2つ使う必要があるためです。

USBマイクであればオーディオインターフェースは2台必要ないのですが、ASIOドライバを使用することでVCClientでの低遅延ボイス変換が可能になるため使用します。

※ASIOドライバとは音源を高品質に管理するために作られた規格のオーディオドライバです。

オーディオインターフェースにはそれぞれ専用のASIOドライバが用意されていることが多いですが、搭載されていないものも多いためご注意ください!(特にゲーム配信向けに販売されているオーディオインターフェースには搭載されていないことが多いです)

マイク音声入力用オーディオインターフェース

・32bit float入力に対応 (音割れや誤変換を防ぎやすくなる)

・USB Type-C出力に対応(遅延&音質が変わってきます)

・ASIOドライバ対応 ※必須

自分は上記全て対応している

YAMAHA Steinberg UR22Cを使用しています。

使いやすいDAWのCubase AIがついてきますのでお勧めです。

こちらのミキサーソフトは使用しません。

他には、ZOOM UAC-232なんかも良いと思います。

音声出力用オーディオインターフェース

・入力用とは違うASIOドライバ対応のもの ※同じASIOドライバは同時に使用できないため

・専用ミキサーソフトの自由度が高いもの(入出力設定を細かく設定できるもの)

・USB Type-C 出力対応(音質よく音を聞くことができます)

上記のUR22Cを使用する場合、よく配信でおすすめされているAG03やAG06は使用できないのでご注意ください!(ASIOドライバが共通のため)

おすすめは自分も使用している PreSonus revelator io24です!

値段はそんなに変わりませんが、小型のio44でも大丈夫です。

こちらもDAWのStudio Oneがついてきます!

USB Type-C ハブ

Type-Cのみに特化した、高速伝送&電源供給が可能なBelkin製品のものがおすすめです!

自分はこれにオーディオインターフェース2台、webカメラ、VRデバイスを繋いで運用しています!

ハイレゾ対応USB Type-Cケーブル2本

必ずハイレゾ対応と書いてあるものを選びましょう!

充電用のものだと音がブツブツと伝送されてしまう場合があります!

自分は↓のELECOM製品を2本使用して、オーディオインターフェースにつなげています。

設定について

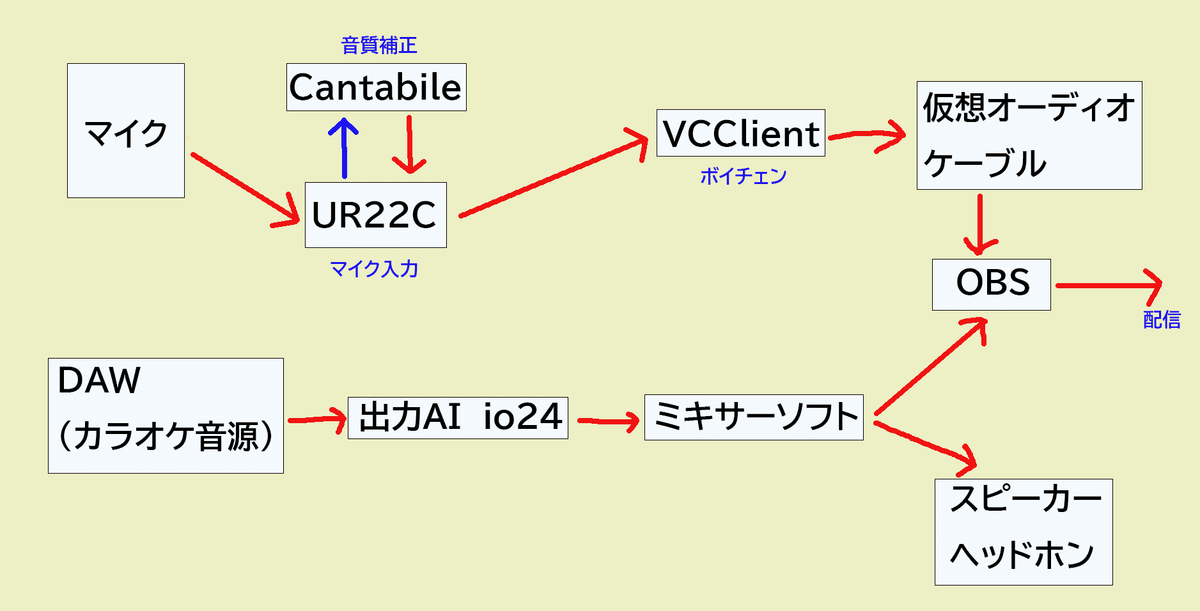

どういう設定で繋いで何をするのか、まず図解します。

マイク入力→Cantabileについて

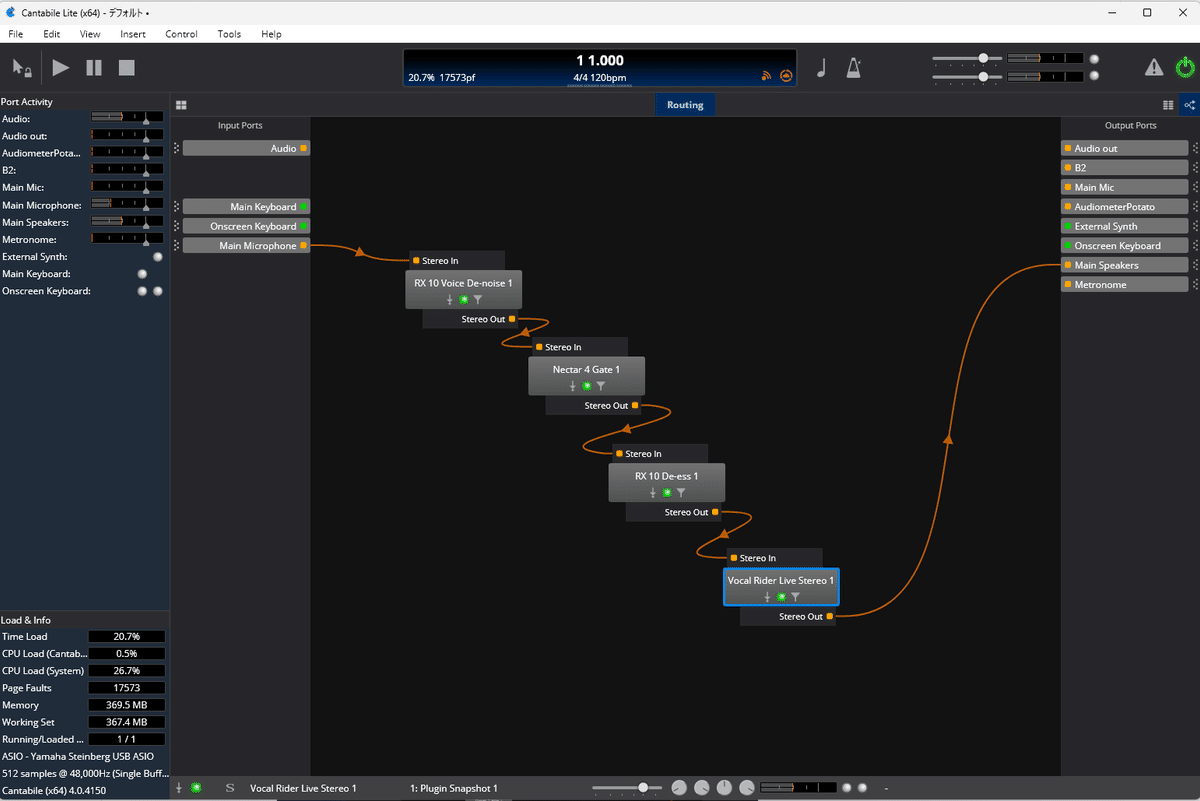

Cantabile

設定したオーディオドライバに流れる音を一度、全部Cantabileが吸い取り、VSTプラグイン(音質を制御するソフト)で補正等をした上でオーディオドライバに返すことができるソフトです。

Lite版は無料で使えます。

何をしているかというと、処理をしています以下のことをしています。

UR22Cで使用されるYamaha Sterinberg ASIOドライバの音(マイク入力音声)をCantabileに渡す

Cantabileでプラグインを使って音質補正(環境ノイズ処理、ゲート処理、ディエッサー、音量補正)

オーディオインターフェース(UR22C)に音を返す

プラグインについては自分は主にiZotope製品のRX10、Nectar4のものを使用しています。無料のものでも代用は可能です!

VocalRider

音量補正に用いているWavesのVocalRiderは有料ですがかなりおススメです!(セールで3000円くらい)

左のつまみで設定した範囲の音量にリアルタイムで自動的に補正してくれるというVSTプラグインです。

小さい音は持ち上げてくれますし、逆に大きすぎる音は自動的に下げてくれるという配信に便利なプラグインです!

VCClient

UR22CのマイクをVCClient上でボイスチェンジします。

出力に仮想オーディオケーブルであるVB-Cableに渡します。

出力にCABLE input(VB Audio)を選択します。

OBSやDiscord等の入力に CABLE output(VB Audio)を選択することで、ボイチェンの声を流すことができます!

もう少しCHUNKを下げて、遅延を下げることもできるのですが、品質はこれくらいが安定するのでこの設定にしています。

GPUがもっとハイスペックであれば、さらに小さい遅延にすることもできます!

設定は学習モデルや環境によって変わってきます。

このモデルで自分の声の変換には、TUNEは話すときは17が安定します。

歌うときは一気に11まで下げています!

INDEXは上げすぎると声の抑揚が崩れやすくなるので、0.5くらいがちょうどよかったです。(あくまで自分のモデルの設定です)

さらにここにVST Hostというツールを嚙ませることで、変換後のボイスにVSTプラグインでエフェクトを書けることができます。(OBSを使う場合はOBS上でプラグインを使うことができます)

VST Hostを使う場合は、更に有料版の仮想オーディオケーブルを追加する必要があります。

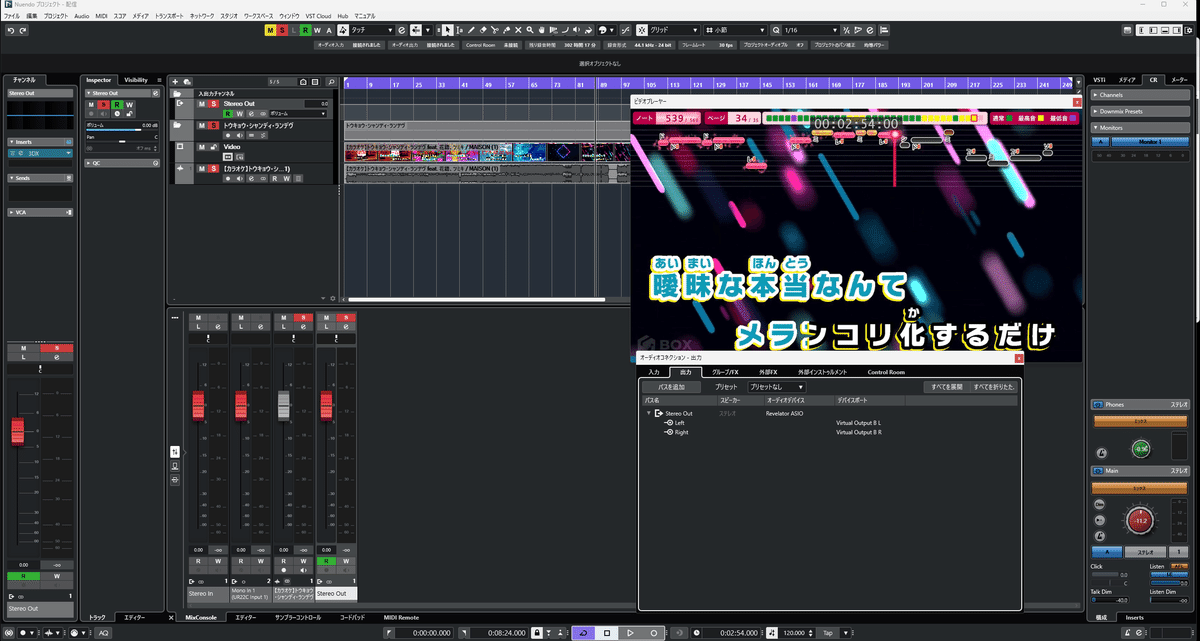

DAW

おすすめはCubase製品です!

DAWはNUENDO(Cubse)、StudioOne Artist、Ableton Live Lite、LogicPro、ProTools、Reaperと触ったことがありますが

中でもCubseが一番設定が簡単でした!

自分は最上位版に当たるNUENDOを持っていたので、それを使用しています。

UR22CにCubaseAIがついてきます。

Studio Oneは専用のリバーブプラグインがかなり良いので、Studio Oneもありですね!

ただ、プラグインの設定がちょっとめんどくさかった…💦

Cubseは動画も同時に再生できるのでカラオケ動画を見ながら歌えるのでやりやすいですね!

設定

・スタジオ→スタジオ設定→オーディオシステム からお使いの出力用オーディオインターフェースのASIOドライバを選択します。(ここではrevelator ASIO)

・スタジオ→オーディオコネクション→出力

revelatorではアウトプットをPlayback、Virtual A、Virtual Bの3つから選択できます。

Virtual AかVirtual Bのどちらかにしておけば大丈夫です。

基本PCの音はPlaybackに集約されており、ヘッドホンなどのオーディオ出力設定はPlaybackに設定しておけば大丈夫です。

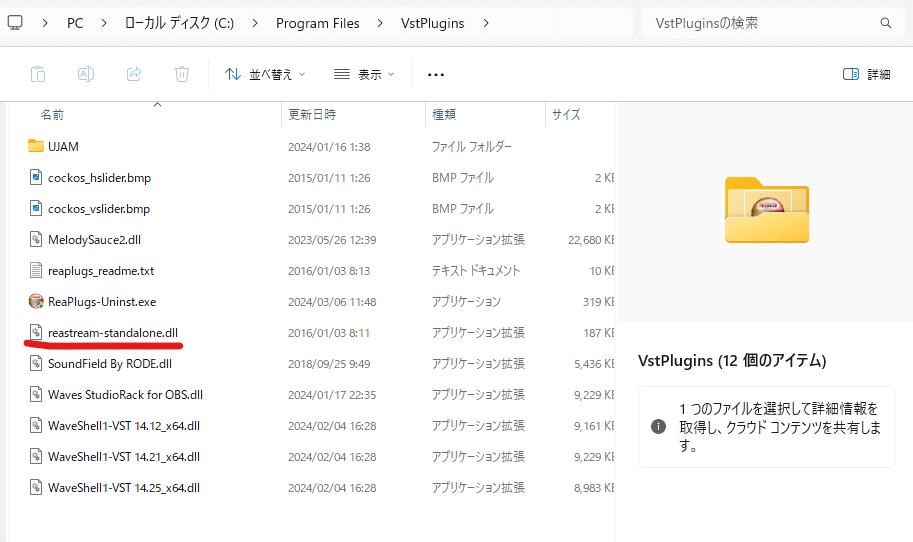

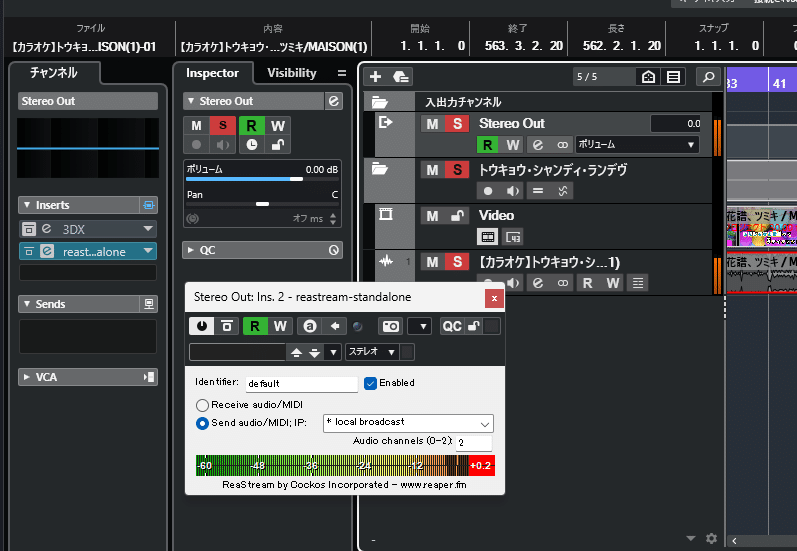

reastream設定

DAWの音をOBSに送るためにはreastreamというVST2プラグインを導入する必要があります。

ReaPlugsをインストールします。

色々沢山プラグインの✅がありますが、reastreamだけで大丈夫です。

インストールフォルダは注意してください!

必ず以下にインストールして下さい!

『PC』>『Windows (C:)』>『Program Files』にある『VSTPlugins』

DAWのStereo Outの一番下にreastreamプラグインを挿します。

Send audio→local broadcastに設定します。

付属ミキサーソフト

ここではrevelatorシリーズのUniversal Controlを使用します。

Universal Controlは何と直接OBS連携ができます!

右上にOBSのアイコンがあるのでクリックして、流れに沿って専用プラグインをインストールしましょう!

Playback、Virtual A、Virtual Bに入力されている音をそれぞれここで管理できます。また、出力の名前の変更やプリセットを3つまで登録できます。

たとえば、Virtual BにDAWの音を入れて、その他の音はPlaybackかVirtual Aに集約することで、Virtual BをソロモードにするとDAW以外の音は配信で流れないようにするといった設定が簡単にできます!

このアウトプットの管理の自由度が高いこともあり、io24は使いやすくてお勧めです!

Playbackではio24内の音を全て聞くことができる出力(ループバック)になっています。

OBS

最後にOBSの設定です!

音声出力キャプチャ追加→CableOutput(VCClient)

音声入力キャプチャ追加→Stream Mix B(DAW)→フィルタ→+ボタン→VST2.Xプラグイン→reastream(デフォルト設定)

プラグイン設定

VCClientの出力デバイスを右クリックでVST2.Xプラグインを選択します。

WavesのStudio Rackを導入します。

StudioRackでリバーブやディレイなどの様々なVST3プラグインを挿入できます!

遅延設定

続いて、遅延設定です。

VCClientで変換した音声はどうしても遅延が発生するので、音ズレが起こります。

音声ミキサーの歯車から、同期オフセットで調整します。

同期オフセットの数値を入力することで送らせて配信することができます。

まずはVCClientのCHUNKの遅延秒数を入力し、録画開始ボタンで録画しながら微調整していきましょう。

これで音声周りの設定は完了です!

あとはその他の配信画面周りを整えてください!

おわりに

最後まで読んでくださりありがとうございました!

これ以降の記事はありませんが、もし、この記事が「役に立った!」という方は以下から活動のご支援をいただけますと幸いです。

ここから先は

この記事が気に入ったらサポートをしてみませんか?