【VRChat】QuestProを手に入れたのでフェイストラッキングをしてみた(覚書リンクまとめメモ)【VRoid】

こんにちは。ペルキと申しますの。

昨年、QuestProを手に入れましたので、フェイストラッキングを使いたいと思って設定してみましたの。

詳細は先駆者様の記事を参考にしましたので、

そちらを参考に

今回ひっかかったこととかを書いていけたらなと思いますわ。

一応こんな感じにできましたの。

私のデータ

PC:Windows11

VRHMD繋ぐソフト:Virtual Desktop

モデル:VRoid製

Unity Ver:2022.3.6f1

プロジェクトテンプレート:Unity 2022 Avatar Project

経験:VRM Converter for VRChatでVRoidモデルを上げることが出来るレベル

使ったツール(データ)

VRCFaceTracking

Virtual Desktop(有料)

HANA_APP(有料)

VRM Converter for VRChat

FaceEmo

(Avatars3.0 VRoid Layers POWER UP Ver1.3)

※フェイストラッキングと関係なし

参考記事は、流れの中にリンクを張っておきます。

皆様ありがとうございました。

VRCFaceTrackingのインストール

こちらの記事がとても分かりやすいです。

モデルの作成

パーフェクトシンク対応モデルを作る(有料ツール利用)

通常通りにVRoidからVRMモデルをエクスポート(0.X)

(透明メッシュを削除、髪の毛メッシュ以外のポリゴン削減は利用しない)

HANA_APPを使ってパーフェクトシンク化

Unityにインポート

VRM Converter for VRChatを入れてUnityにインポート

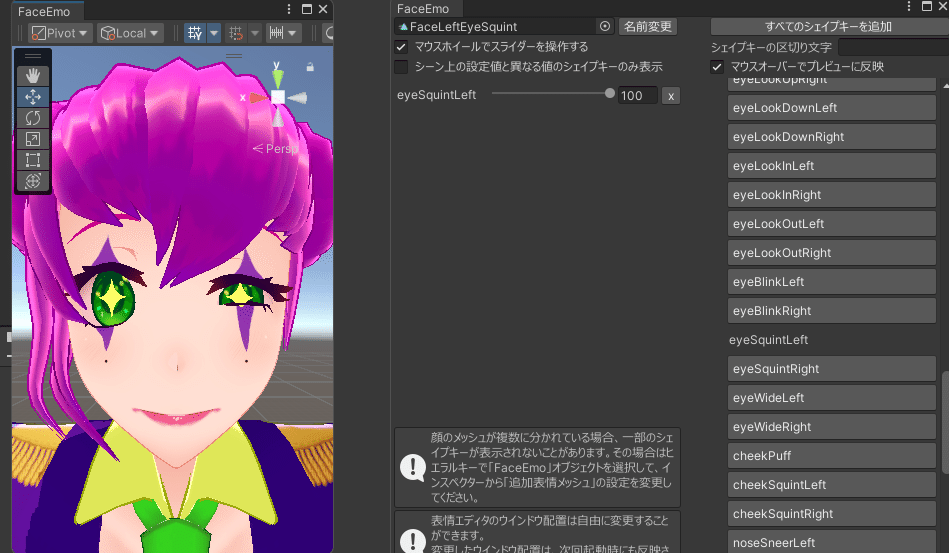

表情アニメーションの作成

表情アニメーション作成方法が分かりませんでしたので、

FaceEmoを導入して表情アニメーションを作ります。

ここでVRMがパーフェクトシンク化されていることにより、

いろんな表情を作ることができます。

手に表情を連動させるわけではないので、色んな要素を無視しで対応する表情の.animファイルを作っていきます。

対応する表情すべて作る必要はなく、動かしたいやつだけ作れば良さそうです。(まばたきとか眉毛とか)

今回は手に表情を付与するわけでないので割り当ては適当です

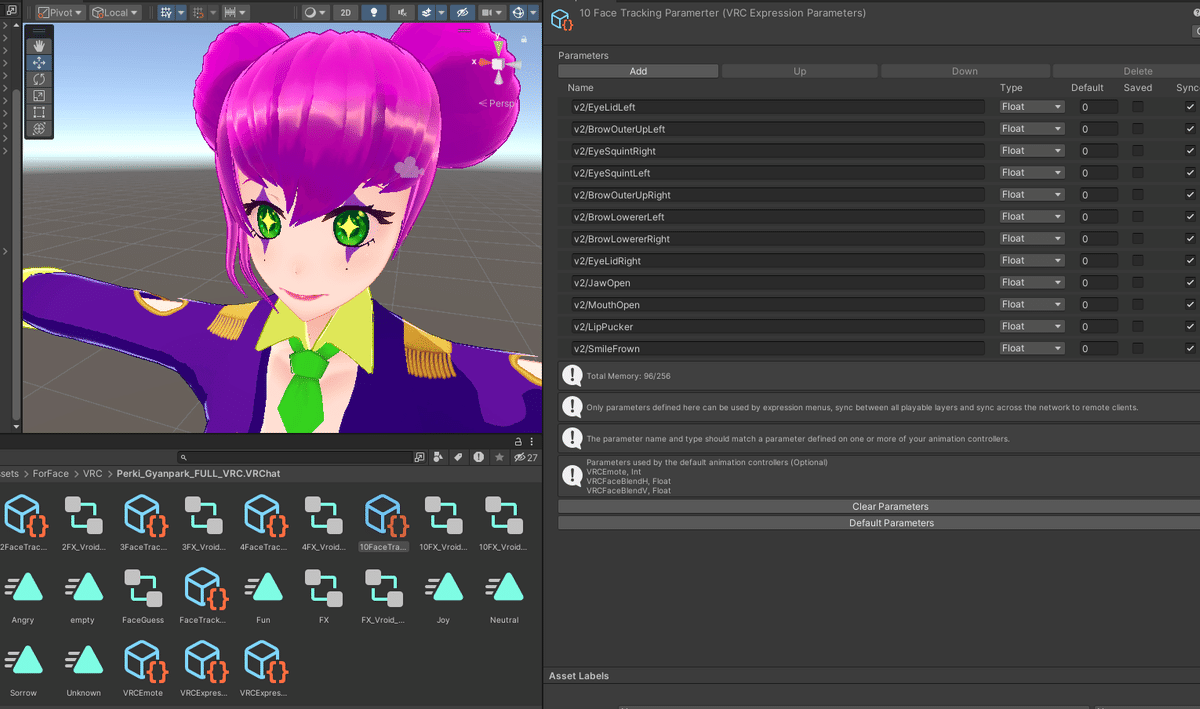

Expression Parametersの作成

こちらの記事と、記事内ハオランくんのサンプルを参考にさせていただきました。

とても分かりやすくて感謝しております。

Expression Parametersの生成方法がどこか分からなかったのでスクショしてみました。

右クリックメニューから作れました。

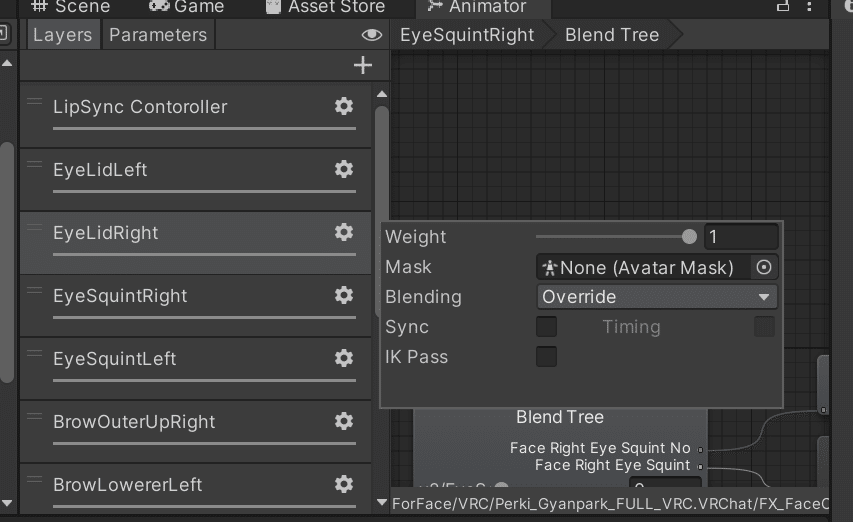

AnimationControllerを変更する(ここ引っかかった)

AnimationControllerにパラメータの設定をしていく

Blend Treeを設定する際に、Parameterの欄が対応するパラメータ名でないと、上手くフェイストラッキング出来ません。

左まぶただけ動くけど他が動かないみたいな1つのパラメータだけ何故か動いたときは、ここを疑うと良いと思います。

Weightを1にするのも忘れがち

PlayableLayersに入れる

FXのところにAnimationControllerで変更したのを入れる

フェイストラッキングと関係ないですが、VRoidで座り姿勢とか手とかを変えるのにこちらのPlayable Layersを利用すると、きれいになった感じがします。

アップロード

通常アップロード手順でアップロード

途中エラーが出たら、なんとかする()

動かす

サンプルアバターで動いて、自分のアバターで動かなければ

自分の設定が悪いので、設定を見直す。

感想

メリット

ハンドサインに縛られずに表情が出せる

この表情出すにはどうすればいいっけ……の時間がなくなります。

パラメータを設定すれば、実質無限の表情が出せる

デメリット

パラメータの設定がややこしい。調べても現行自動化ツールが見当たらない(2024/01現在)

自分の顔の技量が必要

難しいことが多かったですが、

表現できることはその分大きくなったと思いますし、フルトラッキング機材と合わせればさらに色んなことができそうだなと思いました!

最近だとハンドトラッキング系のものも多く出てきているので、

お金と時間に余裕があれば体験してみたいなと思います。

ここまで読んでくださり、ありがとうございました。

YouTubeで配信活動もしておりますので、もし気になったらチャンネル登録していただけるととても嬉しいですm(__)m

この記事が気に入ったらサポートをしてみませんか?